Google Colab で AutoGPTQ + Vicuna-v1.5 を試す

「Google Colab」で「AutoGPTQ + Vicuna-v1.5」を試したのでまとめました。

1. Vicuna-v1.5のGPTQモデル

「Vicuna-v1.5」で提供されている「GPTQ」モデルは、次の4つです。

・TheBloke/vicuna-7B-v1.5-GPTQ

・TheBloke/vicuna-7B-v1.5-16K-GPTQ

・TheBloke/vicuna-13B-v1.5-GPTQ

・TheBloke/vicuna-13B-v1.5-16K-GPTQ

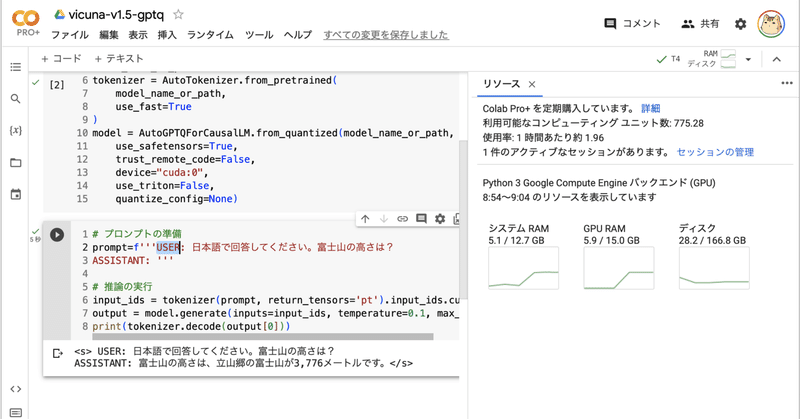

2. Colabでの実行

Colabでの実行手順は、次のとおりです。

(1) AutoGPTQのインストール。

# パッケージのインストール

!git clone https://github.com/PanQiWei/AutoGPTQ

%cd AutoGPTQ

!pip install .

!pip install transformers(2) トークナイザーとモデルの準備。

今回は、「TheBloke/vicuna-7B-v1.5-GPTQ」を使います。

from transformers import AutoTokenizer

from auto_gptq import AutoGPTQForCausalLM

# トークナイザーとモデルの準備

model_name_or_path = "TheBloke/vicuna-7B-v1.5-GPTQ"

tokenizer = AutoTokenizer.from_pretrained(

model_name_or_path,

use_fast=True

)

model = AutoGPTQForCausalLM.from_quantized(model_name_or_path,

use_safetensors=True,

trust_remote_code=False,

device="cuda:0",

use_triton=False,

quantize_config=None

)(3) 推論の実行。

# プロンプトの準備

prompt=f'''USER: 日本語で回答してください。富士山の高さは?

ASSISTANT: '''

# 推論の実行

input_ids = tokenizer(prompt, return_tensors='pt').input_ids.cuda()

output = model.generate(inputs=input_ids, temperature=0.1, max_new_tokens=512)

print(tokenizer.decode(output[0]))<s> USER: 日本語で回答してください。富士山の高さは?

ASSISTANT: 富士山の高さは、立山郷の富士山が3,776メートルです。</s>この記事が気に入ったらサポートをしてみませんか?