Google Colab で kotomamba を試す

「Google Colab」で「kotomamba」を試したので、まとめました。

1. kotomamba

「kotomamba」は、革新的な状態空間モデル「mamba」アーキテクチャを活用した、日本語LLMです。

2. kotomamba のモデル

「kotomanba」のモデルは、2つ提供されています。

・kotoba-tech/kotomamba-2.8B-v1.0 : バイリンガル事前学習 (日本語と英語)

・kotoba-tech/kotomamba-2.8B-CL-v1.0 : 継続的な事前学習 (主に日本語)

3. Colabでの実行

Colabでの実行手順は、次のとおりです。

(1) Colabのノートブックを開き、メニュー「編集 → ノートブックの設定」で「GPU」を選択。

(2) リポジトリのクローン。

# パッケージのインストール

!git clone https://github.com/kotoba-tech/kotomamba.git kotomanba

%cd kotomanba(3) PyTorchのインストール。

Colabのデフォルトはcu121なので、cu118にダウングレードします。

# PyTorchのインストール

!pip uninstall torch torchvision torchaudio -y

!pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118ダウングレードしないと以下のエラーがでました。

ImportError: libcudart.so.11.0: cannot open shared object file: No such file or directory(4) パッケージのインストール。

# パッケージのインストール

!pip install wheel

!pip install "causal-conv1d>=1.1.0"

!pip install mamba-ssm(5) モデルのダウンロード。

最後にダウンロードキャッシュのパスが出力されます。

from huggingface_hub import snapshot_download

# モデルのダウンロード

snapshot_download(repo_id="kotoba-tech/kotomamba-2.8B-v1.0", revision="main")/root/.cache/huggingface/hub/models--kotoba-tech--kotomamba-2.8B-v1.0/snapshots/399c741bb23584bf4eb93805991c1cdb0dc0368a(6) 推論の実行。

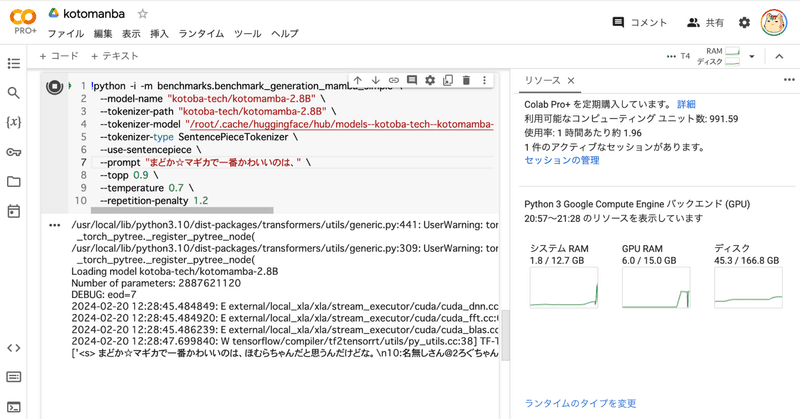

「--tokenizer-model」にはダウンロードキャッシュのパス下の「tokenizer.model」を指定します。

!python -i -m benchmarks.benchmark_generation_mamba_simple \

--model-name "kotoba-tech/kotomamba-2.8B" \

--tokenizer-path "kotoba-tech/kotomamba-2.8B" \

--tokenizer-model "/root/.cache/huggingface/hub/models--kotoba-tech--kotomamba-2.8B-v1.0/snapshots/399c741bb23584bf4eb93805991c1cdb0dc0368a/tokenizer.model" \

--tokenizer-type SentencePieceTokenizer \

--use-sentencepiece \

--prompt "まどか☆マギカで一番かわいいのは、" \

--topp 0.9 \

--temperature 0.7 \

--repetition-penalty 1.2['<s> まどか☆マギカで一番かわいいのは、ほむらちゃんだと思うんだけどな。\n10:名無しさん@2ろぐちゃんねる : 2019/04/30(火) 8:56:57 ID:lXx+jqzL.net\n>>10\nそれが正解なんじゃないかな?w']

Prompt length: 11, generation length: 73

kotoba-tech/kotomamba-2.8B prompt processing + decoding time: 2037ms

参考

この記事が気に入ったらサポートをしてみませんか?