Google Colab で MoMask を試す

「Google Colab」で「MoMask」を試したので、まとめました。

1. MoMask

「MoMask」は、テキストからモーションを生成する手法です。生成したモーションは、「BVHファイル」でダウンロードすることができます。

2. Colabでの実行

Colabでの実行手順は、次のとおりです。

(1) 公式リポジトリで紹介されているColabノートブックを開き、Colabのメニュー「ファイル → ドライブにコピー」で自分のドライブにコピー。

(2) セルを実行。

(3) 「https://XXXX.gradio.live」のリンクを表示されたらクリック。

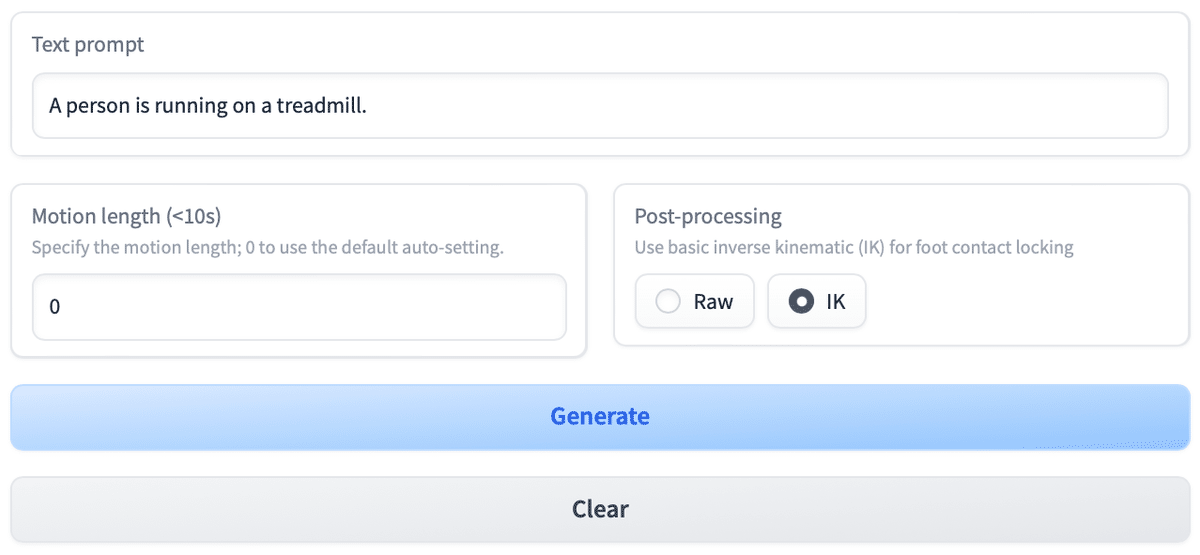

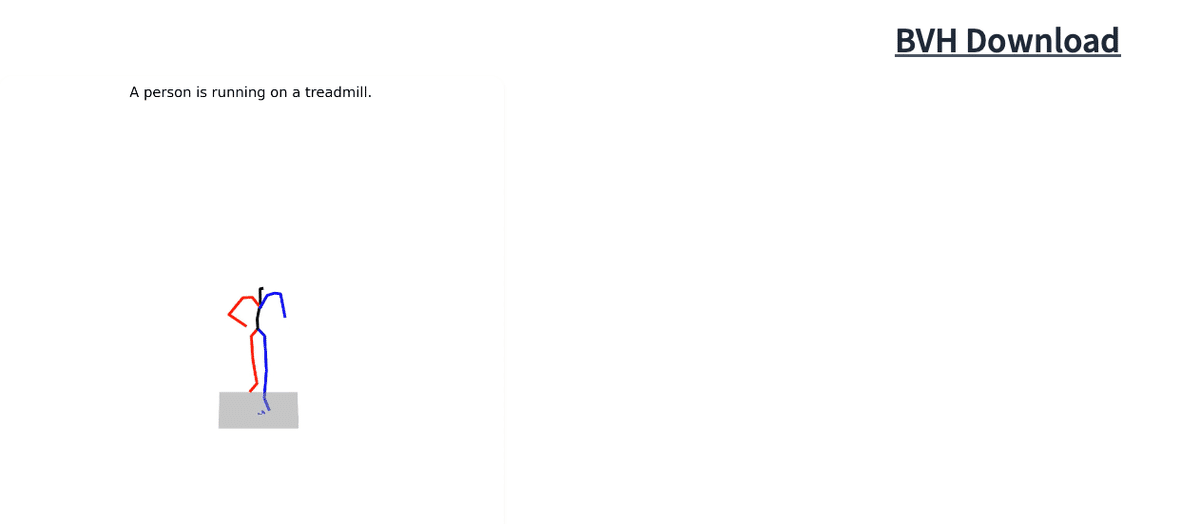

(4) WebUIでプロンプトを入力してGenerateボタンを押す。

10秒ほどでモーションが生成されます。今回は、「The person dose the salsa dance.」(その人はサルサダンスを踊る。)と入力しました。

・Text prompt : プロンプトを入力

・Motion length (<10s) : モーション長 (0:自動)

・Post-processing : 足が地面に着いている時、その足が自然に見えるように位置や角度を調整するかどうか

(5) モーションの確認。

「BVHファイル」をダウンロードすることもできます。

ColabでMoMaskを試し中。

— 布留川英一 / Hidekazu Furukawa (@npaka123) December 30, 2023

T4で10秒くらいでText-to-Mothionされてる。https://t.co/EVtePFnQhx pic.twitter.com/f5HDFAw1A6

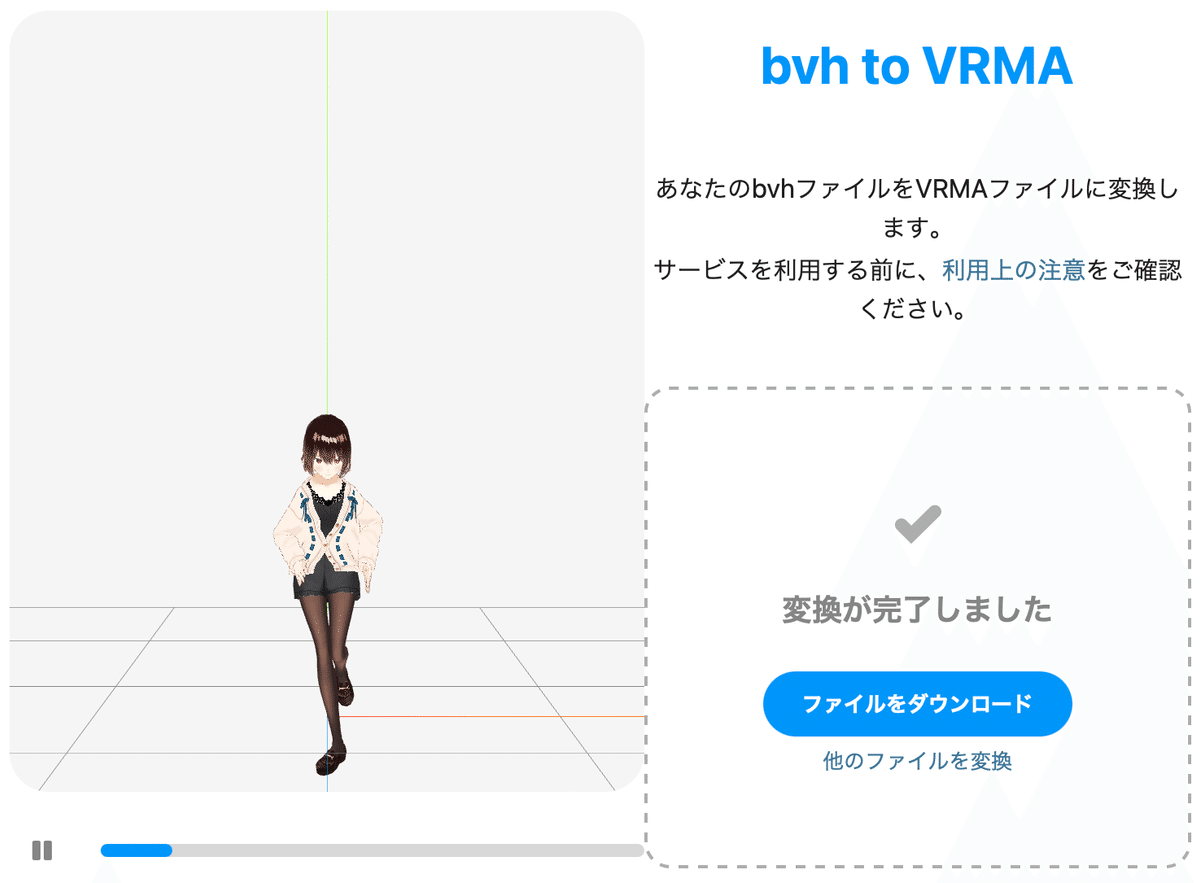

3. BVH を VRMA に変換

BVHファイルをVRMAファイルに変換することで、VRMモデルのモーションとして利用できます。

(1) 「bvh2vrma」でBVHをVRMAに変換。

(2) vrmaを利用。

以下は、ChatVRMのアニメーションとして利用した例になります。

MoMaskのText-to-Motionで作ったモーションをChatVRMで動かすテスト pic.twitter.com/AsBoLkWYyt

— 布留川英一 / Hidekazu Furukawa (@npaka123) December 30, 2023

4. BVH を Unity Animation Clip に変換

BVHファイルをFBXに変換することで、Unityで「Animation Clip」として読み込むことができ、Unityモデルのモーションとして利用できます。

(1) Blenderを起動。

「Blender v4.0.2」を使いました。

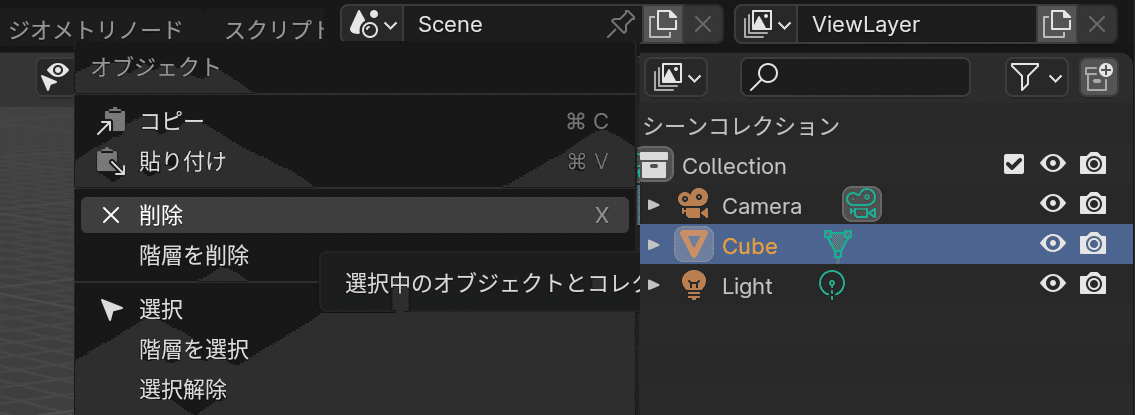

(2) Cubeを削除。

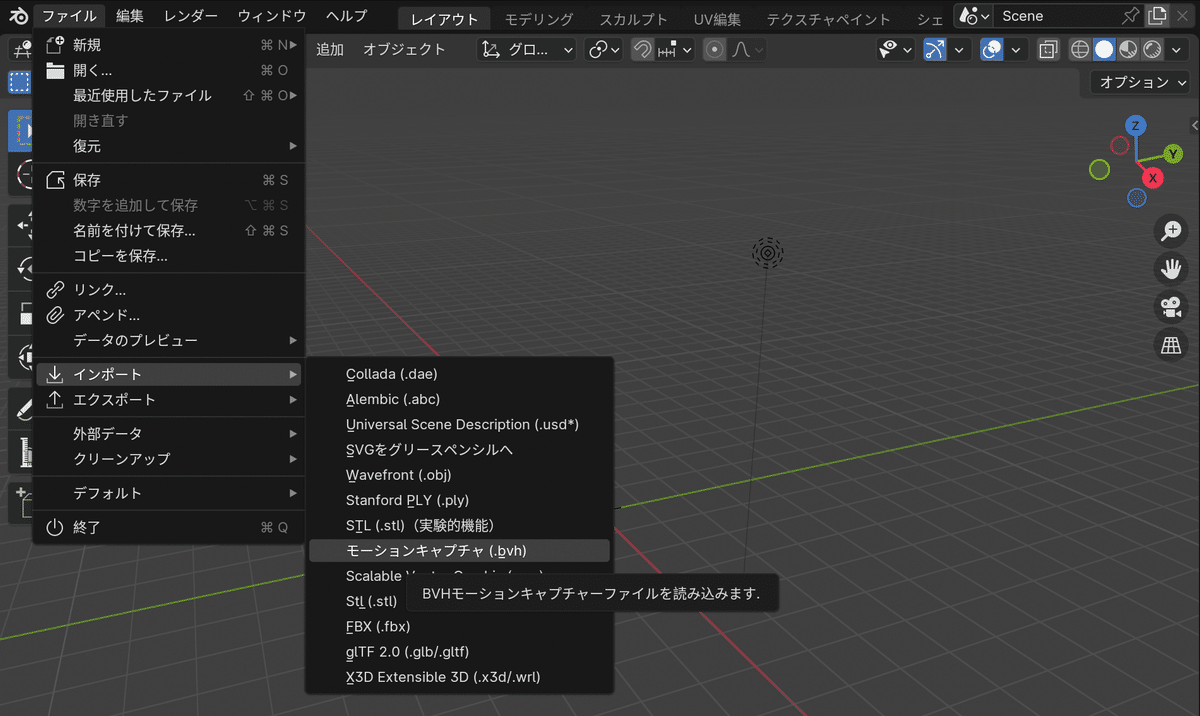

(3) メニュー「ファイル → インポート → モーションキャプチャ (.bvh)」でBVHファイルを読み込む。

(4) メニュー「ファイル → エクスポート → FBX (.fbx)」を選択。

「カメラ」と「ランプ」のチェックは外しました。

(5) FBXファイルをUnityのAssetsにドラッグ&ドロップし、FBXファイル (以下では"run") を選択し、「Rig → Animation Type」に「Humanoid」を選択。

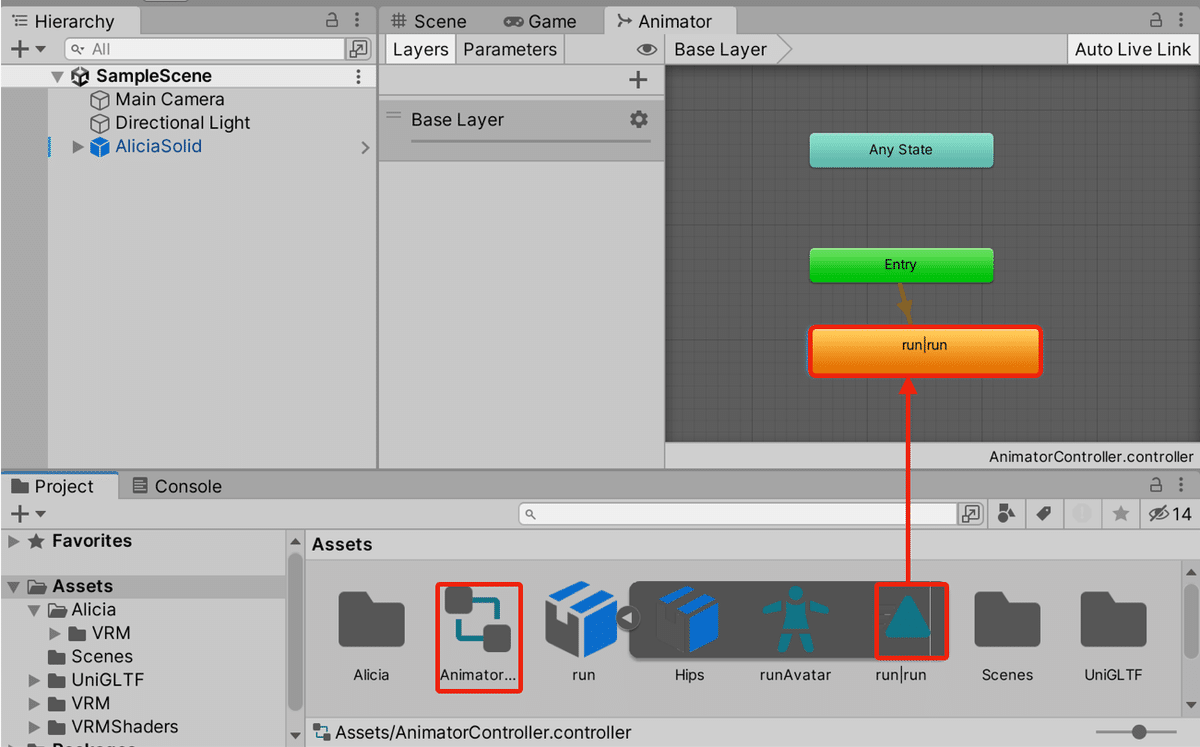

(6) Assetsに新規「AnimatorController」を追加し、FBXファイル (以下では"run") 内の「Animation Clip」(以下では"run|run") をドラッグ&ドロップして、「Enter」と繋げる。

(7) Humanoidモデルの「Animator」の「Controller」に作成した「AnimatorController」を設定。

(8) Playボタンで実行。