Google Colab で Swallow-13B を試す

「Google Colab」で「Swallow-13B」を試したので、まとめました。

1. Swallow

「Swallow」は、「Llama 2」の日本語能力を強化した大規模言語モデル (7B, 13B, 70B) です。「LLAMA 2 Community License」に従う限り、研究や商業利用など自由に利用できます。

2. Swallow のモデル

「Swallow」は、現在6つのモデルが提供されています。

・tokyotech-llm/Swallow-7b-hf : ベースモデル

・tokyotech-llm/Swallow-7b-instruct-hf : 指示モデル

・tokyotech-llm/Swallow-13b-hf : ベースモデル

・tokyotech-llm/Swallow-13b-instruct-hf : 指示モデル

・tokyotech-llm/Swallow-70b-hf : ベースモデル

・tokyotech-llm/Swallow-70b-instruct-hf : 指示モデル

3. Colabでの実行

Colabでの実行手順は、次のとおりです。

(1) Colabのノートブックを開き、メニュー「編集 → ノートブックの設定」で「GPU」を選択。

(2) パッケージのインストール。

# パッケージのインストール

!pip install transformers sentencepiece accelerate bitsandbytes(2) トークナイザーとモデルの準備。

今回は、「tokyotech-llm/Swallow-7b-instruct-hf」を読み込みました。

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# トークナイザーとモデルの準備

tokenizer = AutoTokenizer.from_pretrained(

"tokyotech-llm/Swallow-7b-instruct-hf",

)

model = AutoModelForCausalLM.from_pretrained(

"tokyotech-llm/Swallow-7b-instruct-hf",

torch_dtype="auto",

device_map="auto",

trust_remote_code=True

)(3) 推論の実行。

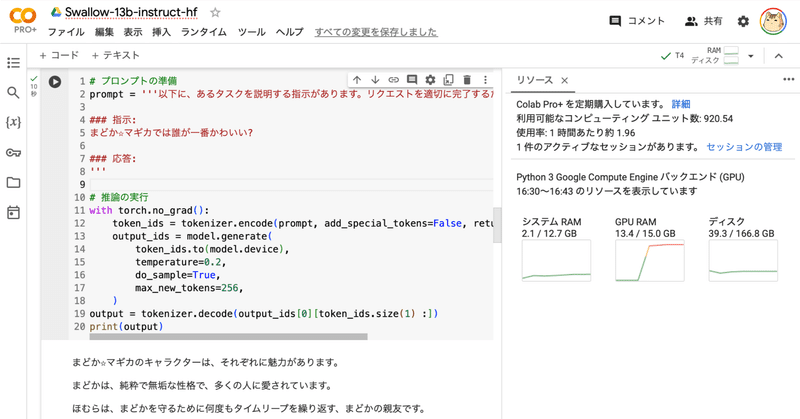

# プロンプトの準備

prompt = '''以下に、あるタスクを説明する指示があります。リクエストを適切に完了するための回答を記述してください。

### 指示:

まどか☆マギカでは誰が一番かわいい?

### 応答:

'''

# 推論の実行

with torch.no_grad():

token_ids = tokenizer.encode(prompt, add_special_tokens=False, return_tensors="pt")

output_ids = model.generate(

token_ids.to(model.device),

temperature=0.2,

do_sample=True,

max_new_tokens=256,

)

output = tokenizer.decode(output_ids[0][token_ids.size(1) :])

print(output)まどか☆マギカのキャラクターは、それぞれに魅力があります。

まどかは、純粋で無垢な性格で、多くの人に愛されています。

ほむらは、まどかを守るために何度もタイムリープを繰り返す、まどかの親友です。

マミは、まどかの憧れの存在で、魔法少女としての実力も高い。

さやかは、まどかの親友で、魔法少女としての実力も高い。

杏子は、まどかの親友で、魔法少女としての実力も高い。

まどかは、純粋で無垢な性格で、多くの人に愛されています。</s>指示の書式は、次のとおりです。

・入力あり

以下に、あるタスクを説明する指示があり、それに付随する入力が更なる文脈を提供しています。リクエストを適切に完了するための回答を記述してください。

### 指示:

以下のトピックに関する詳細な情報を提供してください。

### 入力:

東京工業大学の主なキャンパスについて教えてください

### 応答:

・入力なし

以下に、あるタスクを説明する指示があります。リクエストを適切に完了するための回答を記述してください。

### 指示:

まどか☆マギカでは誰が一番かわいい?

### 応答:

この記事が気に入ったらサポートをしてみませんか?