NeurIPS 2日目

今日は採択された論文のオーラルを聞いてとポスターを見て回る日です。

#NeurIPS2019 speakers, your presentation is *not* a speech speed competition!! I have no whatsoever clue about what you're currently talking about and the ASL interpreter is sweating like hell 🥵🥵🥵

— Alf @ 𝑣ʳIPS (@alfcnz) December 11, 2019

Reading your paper in 5 minutes is *not* a thing!!! Stop this madness!!!

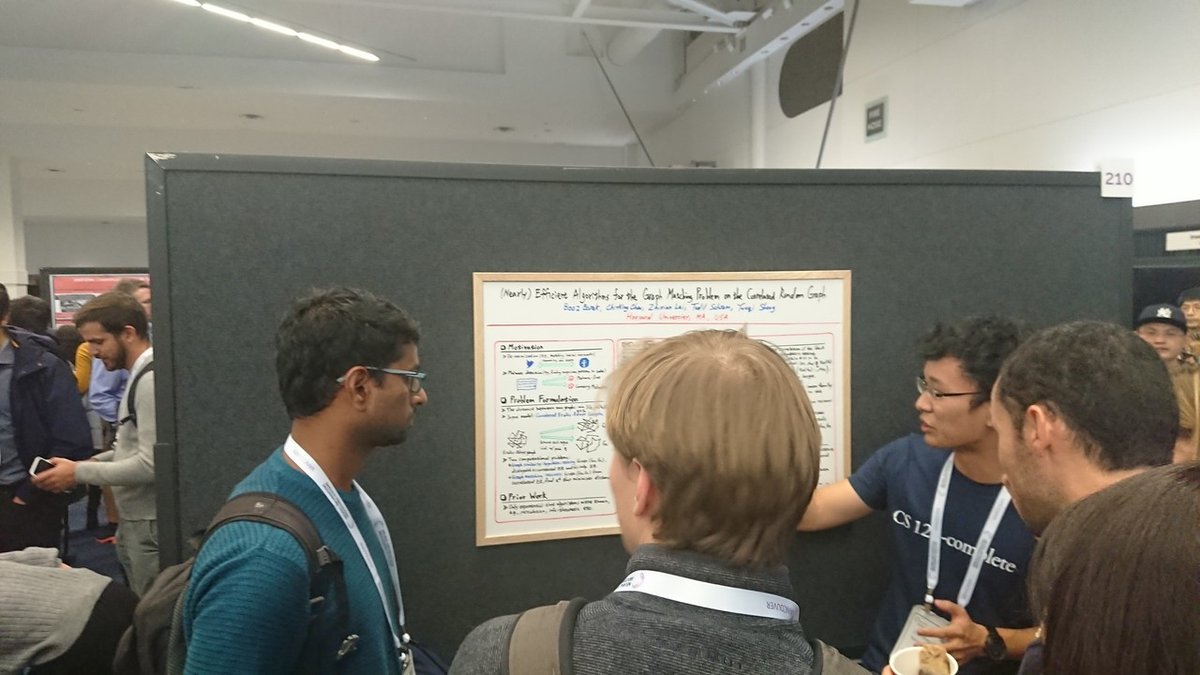

ポスター会場は2時間で200件の発表以上があり人が集中していたため満員電車の中状態だったので、いろいろ厳しかったです。とはいえ、1万人以上が深夜まで議論できるようにするのは難しいので仕方ない気もします。

Unexpected NeurIPS moments: main conference poster sessions reaching capacity. pic.twitter.com/zr5vDsXuHE

— Andrew M. Dai (@iamandrewdai) December 11, 2019

Point-Voxel CNN for Efficient 3D Deep Learningは3Dの点群などを省メモリにし、メモリへのランダムアクセスを抑えて高速化した話。Neural Networks with Cheap Differential Operatorsは次元ごとの勾配の計算を簡単に行えるニューラルネットワークの提案。ODEやFlowで有用そう。Deep Equilibrium Modelsは無限層のニューラルネットワークを陰微分によって1層にできる話だった気がします。Legendre Memory Units: Continuous-Time Representation in Recurrent Neural NetworksはRNNのすごいやつで、スライドだけでは何もわからなかったが優秀らしい。Control Batch Size and Learning Rate to Generalize Well: Theoretical and Empirical Evidenceは1600モデルの学習を通してバッチサイズと学習率の関係を明らかにしようとした論文なのですが、となりの男性と「実際には学習率を途中で変えるからねぇ」という話をしました。

Model Compression with Adversarial Robustness: A Unified Optimization Frameworkは重みの分解とL0ノルム制約をかけたネットワークが敵対的攻撃に耐性がある話。ADMMなどを使っていた。Massively scalable Sinkhorn distances via the Nyström methodはSinkhorn距離を計算するのに必要な距離行列を行列分解することで、計算コストが平方から線形に減らせる、という話。これは嬉しいのでは。Extreme Classification in Log Memory using Count-Min Sketch: A Case Study of Amazon Search with 50M Productsはタイトルは査読時にはどうしたのだろう、と思った(それだけ)。Emergence of Object Segmentation in Perturbed Generative Modelsは画像のセグメンテーションを教師なしで行う話。styleGANで前景+マスクと背景を生成して、それをセグメンテーションしている。前景+マスクと背景の生成が正しければ、合成位置がずれても画像は本物に見える、というトリックが賢い。が、一般の画像には使えなさそう。

面白そうだったけれど詳しくは聞けなかった論文 (a.k.a. 後で読むリスト)

On the Hardness of Robust Classification, Universal Approximation of Input-Output Maps by Temporal Convolutional Nets, Visualizing and Measuring the Geometry of BERT, Approximate Feature Collisions in Neural Nets, Explanations can be manipulated and geometry is to blame, One ticket to win them all: generalizing lottery ticket initializations across datasets and optimizers, Accurate, reliable and fast robustness evaluation, Efficient and Accurate Estimation of Lipschitz Constants for Deep Neural Networks, Towards Explaining the Regularization Effect of Initial Large Learning Rate in Training Neural Networks, Learn, Imagine and Create: Text-to-Image Generation from Prior Knowledge, Explicit Disentanglement of Appearance and Perspective in Generative Models, Deep Learning without Weight Transport, Hyperspherical Prototype Networks, Beyond Vector Spaces: Compact Data Representation as Differentiable Weighted Graphs, Backpropagation-Friendly Eigendecomposition, Data Parameters: A New Family of Parameters for Learning a Differentiable Curriculum, Adversarial training for free! Fast AutoAugment, Meta-Learning Representations for Continual Learning, q-means: A quantum algorithm for unsupervised machine learning, Generative Modeling by Estimating Gradients of the Data Distribution, DeepUSPS: Deep Robust Unsupervised Saliency Prediction via Self-supervision, Sampled Softmax with Random Fourier Features, Weight Agnostic Neural Networks, Learning to Predict Without Looking Ahead: World Models Without Forward Prediction

面白そうなツール

PythonだけでGUIツールがつくれるhttps://github.com/streamlit/streamlit がデモをしていた。デモに良さそう。

この記事が気に入ったらサポートをしてみませんか?