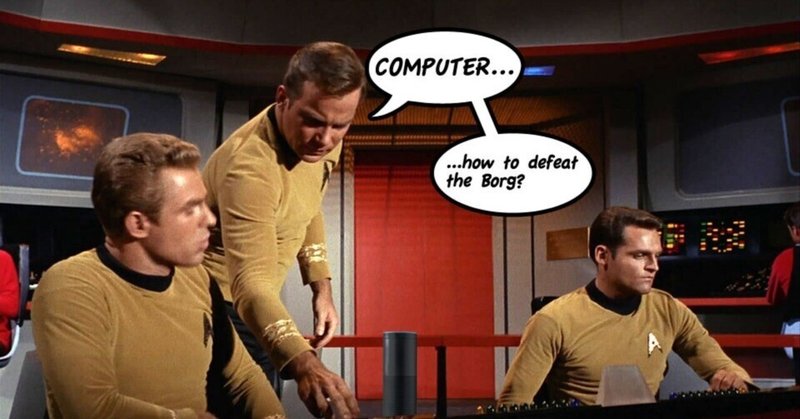

スタートレックの“コンピュータ”とChatGPTとの違い

*The above image is borrowed from here.

を、書いたあと、これも書いておこうかと思ったので。

ファンで無くても知っているだろうSFに『スター・トレック』がある。

『スター・トレック』は1966年に放映が開始され、その後世代の代わった新たなシリーズやパラレル世界を描いたTV・ネット配信のドラマや映画が今に至っても作られている壮大なSFだ。

この『スター・トレック』の中で“コンピュータ”というものが出てくる。

宇宙船のクルーたちに対して情報を分析し、的確な回答を返す装置である。

ドラマ内のキャラクタである「データ」というアンドロイドによれば、“コンピュータ”とは、

"反復的または複雑な数学的操作を高速で行うことができる電子的または機械的な装置である。コンピュータは、情報の制御、処理、実行、保存に使用される"

"an electronic or mechanical apparatus capable of carrying out repetitious or complex mathematical operations at high speed. Computers are used to control, process, perform, or store information."

と、定義されている。

『スタートレック』の世界では数世代に渡る“コンピュータ”の進化があり、自意識を持ったり、また一つの新しい生命として認定されるような場面もある(『スター・トレック ディスカバリー』における「ゾーラ」)。

※『スター・トレック』におけるコンピュータの歴史においては以下に詳しいので興味ある方はどうぞ。

さて、この『スター・トレック』は、熱烈なファンによって最初のスペースシャトルの名称が「エンタープライズ号」(『スター・トレック』に登場する宇宙船の名前)になったり、あるいは Google Home, Siri, Alexa Echoといった音声アシスタントが「呼びかける」仕様になったのも、スター・トレックの影響だ、という説もあるぐらい、現実のテクノロジーの世界にも影響を与えている。Alexa Echo にいたっては、「Alexa!」と呼びかける以外に「Computer!」と呼びかけて答えてくれる設定すらある(私の机上のEchoはこの設定)

ちなみに以下の映像は、1986年に公開された『スター・トレックIV 故郷への長い道』という映画作品のワンシーンである。現代にタイムスリップした白髪にヒゲの Scotty (エンタープライズ号の機関士)が、Macintoshに対して「Computer!」と話しかける有名なシーン。もちろん Mac は返答しないので、マウスをピックアップしてそれをマイクだと思って話しかける。

音声を入力し、それに対して“コンピュータ”が適切な返答を返すというのは、『スター・トレック』の世界ではデフォルト設定。例えば最初期(1960年代)に放送されたエピソードの中でも、次のようなシーンがある。

これなどは、現在のChatGPTに対して人々が行い、それに対してChatGPTが返答している状況そのままだろう。

さて、こうした超有名なSF世界を現在の生成AIの話題に結びつけるのは、まぁよくある話だろう。

例えば、ChatGPTをして「スタートレックの“コンピュータ”みたい」って言う人もいる。

しかし両者は大きく違う。

この「違い」への理解は、どうやって生成AIと付き合っていくかについて、人々が試されているということへの理解でもあると思う。

ではその違いとは何か?

スタートレックの“コンピュータ”は自らの回答についてのデータを持っていない・足りない場合、データが無いことや不足していることを回答としくる。

しかし、ChatGPTなどは“それっぽい答え”を生成して返してくる。

この違い。この違いは大きい。

生成AIも、もとになる情報、教師データによってその“回答”を“生成”してくるわけだけれども、そもそもの情報が不正確であるかどうかの判断は少なくとも現時点では行ってくれない。その誤りはChatGPT側ではなく、人間側が正さないといけないのだ。

ChatGPTの紹介

私たちは、会話形式で対話するChatGPTというモデルをトレーニングしました。対話形式をとることで、ChatGPTはフォローアップの質問に答えたり、間違いを認めたり、間違った前提に挑戦したり、不適切な要求を拒否したりすることが可能になります。

Introducing ChatGPT

We’ve trained a model called ChatGPT which interacts in a conversational way. The dialogue format makes it possible for ChatGPT to answer followup questions, admit its mistakes, challenge incorrect premises, and reject inappropriate requests.

ChatGPTのトップページの記述

安全な対応策を講じていますが、システムは時として不正確な情報や誤解を招く情報を生成したり、不快な内容や偏った内容を生成することがあります。また、アドバイスをすることを目的としたものではありません。

While we have safeguards in place, the system may occasionally generate incorrect or misleading information and produce offensive or biased content. It is not intended to give advice.

ChatGPT側はこのようなメッセージをユーザーに対して出しているが、おそらくこの喧騒の中ではこうしたメッセージがいかに重要なものなのか、理解されないまま利用されているだろう。

基本的に、AIが得意なのは「推論」であって、新たな情報を生み出す、創造する、情報の正しさや倫理的な判断をするといったものではない。

推論(すいろん、英語: inference)とは、既知の事柄を元にして未知の事柄について予想し、論じる事である。

このことについて、情報の正しさ、妥当性や倫理を判断するのは未だに人間であり、それらの「判断」を行える人々が、あくまでも「推論」の支援の仕組みとして生成AIを利用するべきなのだと考える。

もとになる情報がブラックボックス化されている中で、あちこちにChatGPTを組み合わせるというのはいささか勇み足ではないか。

Midjourney で入力した内容に基づいて生成されたイメージは、例えば指の数がおかしかったり、諸々の位置がおかしかったりすることがある。これは誰だって“変だ”って気づきやすい。

しかし、ChatGPTが返してくる回答には“変だ”って気づくためには、その回答の中身に対する知識や教養がなければ気づけ無いし、普段からクリティカルな思考を持っていないと、「情報が正しい」と無意識に思ってしまう癖がついてしまっているだろう。

こう考えると、『スター・トレック』の“コンピュータ”は、正しく「推論」のための仕組みとして描かれていたのだな、と改めて認識する。

この記事が気に入ったらサポートをしてみませんか?