「現代mix考。」How to understand EQ

前回は、Frequency(周波数)にまつわるおさえるべき理論について語ってきた。この周波数の分布を変更するエフェクターがイコライザー、略してEQだ。DAWに触ったことがある人なら必ず使ったことがあるはずだし、馴染みのあるエフェクターだと思う。

しかし、一見簡単に思えるこのエフェクターをどう使っていくか?がミックスの初心者と中級者を分けるひとつの壁になるように僕は感じている。

今回は前回語った理論をベースにどうやってEQを捉えていくべきか?について大いに語っていきたいと思う。

もし、今回の記事を読んでみて、言っていることの意味がはっきりと理解できないときは、是非、記事を遡って読んでみて欲しい。

EQをどう捉えるか?

EQについて調べてみると、以下のように捉えている記事が多い。

「EQとは、音質を調整するエフェクターで、帯域を整理するために使う。」

これは、教科書的な正解なのだが、最初からこのような捉え方をしてしまうと、「だったら、まずEQを使えばいいのか・・!」と感じてしまうのも無理がないことのように思う。

しかしながら、前章でも述べたように、「とりあえずEQ」というすすめ方をしてしまうと、全chにEQを挟まざる得なくなってしまい、結果としてミックスは濁ってしまう傾向にある。

EQにはEQなりのデメリットがあり、実は、使わなくて済むのなら使わない方がいいに越したことがないエフェクターなのだ。

もちろん、EQをエンハンサー的に利用する方法であったり、実機のアンプ部分を通した音が好きだ・・!という意見もわかる。否定はしない。ただ、それはあくまでも基本をおさえた上での話であって、ここで根源的な使い方を語りたいと僕は考えている。

では、EQをどう捉えるか?

僕なりの答えはこうだ。

「音を近づける(遠くするための)エフェクター」

「楽曲の3要素の優先順位を決めるエフェクター」

この捉え方について、どういう意味か?について本章では解説していきたい。

EQのデメリットについて

先ほどEQにはデメリットがある。というお話をさせていただいたが、具体的なデメリットは、位相が崩れるということだ。

位相というと、なんだか小難しい話のように聞こえるかもしれないが、話は簡単で、位相が変わるとその周辺の音の発生点がはやくなったり、遅くなったりしてしまう。

これによって、音の芯と呼ばれる部分であったり、スピード感といわれる部分がスポイルされてしまうことが問題なのだ。

どういう風に位相が変化してしまうか?に興味がある方はPlugin DoctorというソフトでEQを触ったときにどんな変化があるかを観測することができるので、試してみていただきたい。

ちなみに、EQ自体にはQ幅が広いほど位相の変化は少ない。

この位相の変化にまつわる話の一つとして、位相が変化すると脳が疲れるから不自然に感じるという説があり、大いに納得できる話だった。

確かに、自然界ではFrequencyの方向だけ位相が変わった音というのは存在しないので、無意識レベルで違和感を感じてしまうことがあるのかもしれない。

詳しい話は、以下のサイトの記事を参照してみて欲しい。

https://www.soundonsound.com/techniques/how-not-mess-your-mix#:~:text=use%20slow%20compression.,not%20guarantee%20a%20good%20mix.&text=By%20stabilising%20dynamics%20with%20a,rise%20over%20the%20surrounding%20sounds.

そのEQの弱点を補う、位相特性が変わらないリニアフェイズEQというエフェクターがある。しかし、今度はリニアフェイズではトランジェントの特性が変わってしまうという弱点を抱えており、あちらを立てればこちらが立たずといった状況だ。

(Plugin Doctorで位相の項目を見た図。

この傾きが急であるほど、位相に変化があることを示している。)

「音を近づける(遠くするための)エフェクター」としてのEQ

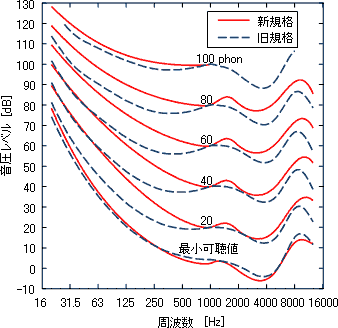

前章で、近い音、遠い音にはそれぞれの持っている性質があるというお話をさせていただいた。まさにこの方法を応用していくのが、このEQ方法になる。主に使うのは、等ラウドネス曲線の法則。

(経産省:聴覚の等感曲線の国際規格ISO226が全面的に改正にhttps://www.aist.go.jp/aist_j/press_release/pr2003/pr20031022/pr20031022.html より引用)

つまり、近い音をより近く、遠い音をより遠くしていく音作りをしていく。

小さい音=ちょうど声の帯域(1.6khz~5khz)以外は聞き取りにくい。

大きい音=250hz以降の低音と、10khz以降が聞き取りやすくなり、4khzから8khzの中高域も徐々にはっきり聞き取れるようになる。

簡単におさらいをすれば、人間は大きい音がハイファイに聞こえて、小さい音はくぐもって聞こえるという法則だ。

最もクリーンなEQの方法

この法則を素直に考えるとするなら、フェーダーをあげるだけで、250hzと10khz以降をシェルフで着いたような効果を得ることができる。

しかも、位相が崩れるというデメリットがないので、クリーンな状態を維持したまま、何もインサートせずにEQと同じ効果を実現させることができる。

これはある程度理想論で、前提としてレンジが広くレコーディングがされていて、距離感を計算されたレコーディングであることが前提になる。

ただ、やってみればわかる通り、フェーダーだけで全てをコントロールできるようにレコーディングしたとしても、やはりどこかしらで調整をする必要が出てきてしまう。

だからこそ、フェーダーでまずはバランスを取った上で、プラスαでEQをしていく必要がでてくる。

ここで強調をしておきたいのは、EQはフェーダーバランスの補足をするモノであって、フェーダーバランスの代わりになるわけではないということだ。

もしも、プロジェクト全体を見渡して、EQがトラックの6割以上にかかっているとしたら、それはフェーダーバランスを見直した方が仕上がりが良くなるはずだ。

EQを触り始めるその前に、試さなくてはいけないこと。

フェーダーで音量を操作すること。

→最もクリーンで、失うものがないEQ=フェーダーの音量操作

→まずフェーダー、次にEQの順で考える。

EQで目指すのは音の球同士の重なった箇所をデザインすること。

第一章でこんな図を見ていただいたのは覚えているだろうか?

立体感を最も視覚で感じるのは、大きい音と小さい音がバラバラに存在する状態ではなく、大きい音に隠れるように小さい音が存在する状況という図だ。

この球と球の重なったポイントの表現が、なかなかフェーダーでデザインできない。

小回りが聞かないのは、この球と球同士の重なりあいが、どちらが手前で、どちらが後ろなのか?という部分だ。

ここの関係性を固定化したいときに、EQは真価を発揮する。

EQを使わなくてはいけないタイミングというのは、相対関係のメリハリをつけなくてはいけない局面に出会ったときだ。

例えば、「ある箇所ではボーカルとギターの位置関係はちょうどいいのに、ある箇所ではギターがボーカルよりもどうやっても手前に聞こえてしまう。かといって、フェーダーで下げると単純にギターの音量が小さく聞こえてしまう。」そんなときにEQは強い味方になってくれる。

EQを使うタイミング

設計図でデザインした位置関係がフェーダーだけで固定化できないとき。

どちらの音が手前で、どちらの音が奥か?を音質上はっきりさせたいとき。

距離感を決定づける最も簡単なEQ法

その上で、簡単にEQを使いこなすことができるコツをお話したい。

それは、帯域をざっくりと3つの帯域に分けて考えることだ。

例えば、

「12.1kHzが少し強くて、432hzがややピーキーだよね」

こう言われたときに、実際に音がどうなってるか想像つくだろうか・・?

高度に訓練を受けたプロであればだいたいの感覚は持っているものの、大半の人は実際に触ってみるまで想像がつかないだろう。

そこで、僕が提唱をしたいのが、ミックス序盤のEQは3バンド縛りで使うというルールだ。

デジタルEQがアナログと決定的に違うのは、いくらでもバンド幅を増やせるし、精密なコントロールをすることができてしまうところだ。

それが物事を複雑にしてしまうフシがあるように僕は感じている。

もしも仮に、EQがどんなに頑張っても3バンドしかいじることができなかったら、物事は実にシンプルだ。

欲しいところ、邪魔なところだけを捻ればいい。

そもそも、DAWが登場する前のコンソールは、古いものであればあるほど、調整できる箇所が少なかった。今スタジオで中心に使われているようなSSLやNeveも多くて4バンド+フィルターであって、デジタルのように無限にコントロールできる場所を増やすことはできない。

これが意味するところというのは、少ないバンド数であったとしても、問題なくミックスをすることができるということだ。

それを実現する方法論が以下の方法だ。

是非試してみて欲しい。

ここから先は

¥ 300

記事のご購入をいただきましてありがとうございます・・! 読者さまの中にときどき、サポートをくださる方がいらっしゃって、すごく励みになっております泣 いただいたサポートは全額次回記事に向けての研究&出版の費用に使わせていただきます・・・! 次回更新もお楽しみに・・!!