Anything-v4.5でAIイラスト作成してみた

Hugging Faceを見ていたら、Anything-v4.5というのがありましたので、使ってみようと思います。作者はAnything-v4.0とは違う人なので、本当に大丈夫かは微妙ですが、何事もチャレンジですね。

今回は、Anything-v4.0と比較したいので、anything-v4.0の時のコードを利用して、モデルだけ変えるようにいたします。

コードは以下となります。Google Colabで動くようになっております。また、利用時は、Google Colabで/contentにimageanythingフォルダを作成して下さい。/content/imageanythingに作成された画像が保管されます。

!pip install torch

!pip install --upgrade diffusers transformers scipy

!pip install datetime

from diffusers import StableDiffusionPipeline

import torch

import datetime

model_id = "ckpt/anything-v4.5"

pipe = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype=torch.float16)

pipe = pipe.to("cuda")

prompt = "(((super realistic))), (((best quality))),((masterpiece)), ((ultra-detailed)), a girl, smile, (((super realistic black hair))), shirt, black eyes, an anime style"

for i in rane(30):

image = pipe(prompt).images[0]

timestamp = datetime.datetime.now().strftime("%Y%m%d%H%M%S")

image.save(f"/content/imageanything/image_{timestamp}.png")このプログラムは、Diffusionモデルを用いて、与えられた文章を元に画像を生成するプログラムです。以下に、プログラムの流れを説明します。

最初に、必要なライブラリをインストールします。torch、diffusers、transformers、scipy、datetimeなどが含まれます。

Diffusionモデルの事前学習済みモデルを読み込みます。"ckpt/anything-v4.5"というモデルを読み込んでいます。

モデルをGPUに転送し、処理を高速化します。

promptという変数に文章を格納しています。文章には、画像の要素が含まれており、それを元に画像を生成します。

forループを30回回し、画像を生成します。生成された画像は、タイムスタンプを付けたファイル名で保存されます。

以上が、このプログラムの流れです。これにより、Diffusionモデルを使って文章から画像を生成することができます。

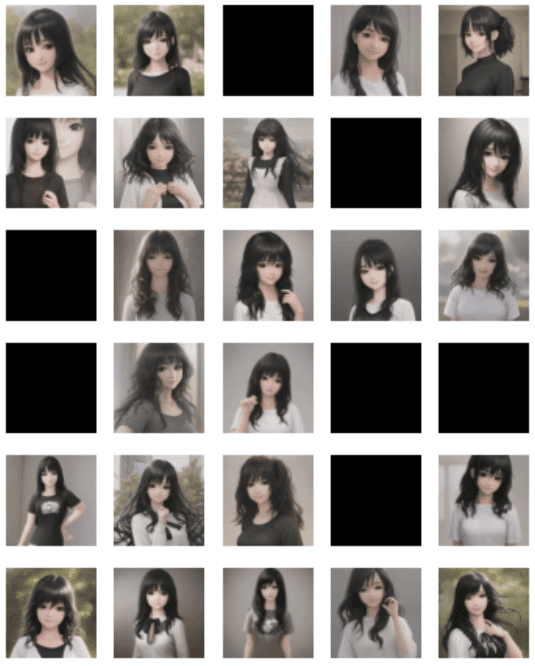

実行結果は、以下となります。全体的に、NSFWの数が多いようです。また、一括で表示していると、ぼやけているように見えますが、1枚の画像を普通に見てみると、髪の毛とかが細かく表現されてリアル感が増しているように見えます。

他のAnything-v4.5のAIイラストは下記にもあります。

この記事が気に入ったらサポートをしてみませんか?