【保存版】Stable Diffusion Web UI(AUTOMATIC1111)の環境構築・使い方

この記事では、Stable Diffusion Web UI(AUTOMATIC1111版)の環境構築方法と使い方について詳しく解説します。

Stable Diffusion Web UIを使うと環境構築が簡単で、無料で無制限で画像を生成できるようになります。

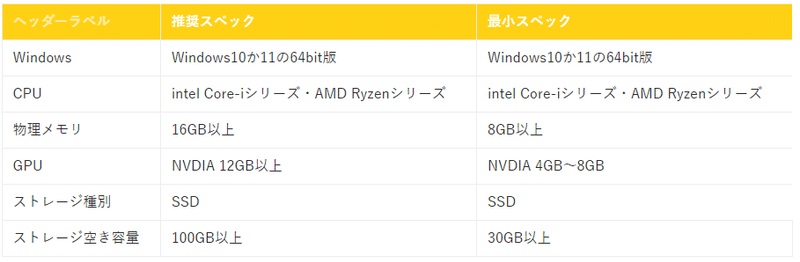

Stable Diffusion Web UIを使うには前提条件として、以下のスペック以上のパソコンが推奨とされています。

もしグラフィックボードがついていないなどの場合は、また今度記事にする予定の「GoogleColab版」を試してみてね。

GoogleColabは誰でも簡単に無料で使えて、ハイスペックなパソコンがなくても使えます。

Youtubeでも公開しています。

Stable Diffusionとは?

Stable Diffusionは画像生成AIの一種で、オープンソースモデルのため誰でも無料で使うことができます。

Stable Diffusionは、2022年8月22日(現地時間)に英Stability AI社によって全世界に公開された高性能画像生成AIであり、任意のテキストを入力するだけで、その内容に沿ったオリジナル画像を自動で生成することができるという特徴を有しています。

これから、このAIはもっといろいろなことができるようになる予定です。たとえば、アニメーションを作ったり、いろんなプログラムとつなげたりできるようになります。

まだStable Diffusionのことをよく知らない。という方は以下の記事がおすすめです。

Stable Diffusionを使う方法

画像生成AIの超定番「Stable Diffusion」は無料で使うことができます。

ただし、自力でインストールしようとするとパソコン初心者にはハードルが高いものとなっております。

まず、Stable Diffusionを使う方法は大きく分けて以下の4つがあります。

今回は「ローカル環境(Web UI)」のやり方を解説してきます。

Stable Diffusion Web UI(AUTOMATIC1111版)

Stable Diffusion Web UIは、AUTOMATIC1111氏が開発・提供するツールです。このツールは、画像生成AI「Stable Diffusion」を簡単に利用することを目的として開発されました。

Stabel Diffusion Web UIは、初心者の方でも簡単に画像を生成でき、多機能性により上級者も長く利用できるのがメリットです。

Stable Diffusion Web UIの特徴

公式ページ

動作に必要なパソコンスペック

Stable Diffusionはクラウド環境でもローカル環境でも動かせるのですが、ローカル環境で動かす場合はパソコンにある程度のスペックが必要です。

グラフィックボード:「NVIDIA GX20 30」以上

VRAM10G以上

Stable Diffusion Web UI(AUTOMATIC1111版)の導入方法

はじめに

以下GitHubに手順やファイルがあるのですが、英語で分かりにくい部分もあるかもしれないので、私が書いた手順通りに進んでいただければと思います。

手順は以下の4ステップです。

Pythonのダウンロード・インストール

Gitのダウンロード・インストール

Stable Diffusion Web UIの環境構築

Stable Diffusion Web UIの起動

それでは、実際にtable Diffusion Web UI(AUTOMATIC1111版)の環境構築を進めていきましょう。

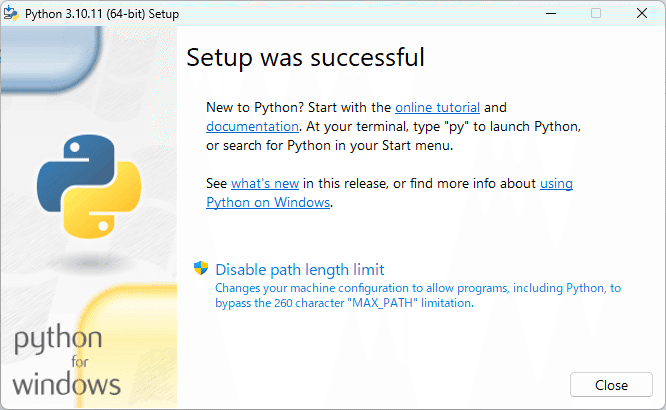

Python3.10.6をダウンロード・インストールする

まず、以下Pythonページを開いてください。

以下の通り、「Python 3.10.6」を探してwindows installerをダウンロードしてください。

ダウンロードしたファイルを実行してます。以下画面が出たら「Add python.exe to PATH」にチェックを入れて「Install Now」を実行します。

※インストール先など変更する場合は「Customeize installation」で変更してください。

インストールが完了すると以下画面が表示されます。「Disable path length limit」をクリックし、最後に「Close」ボタンを押してPythonのインストールは完了です。

Gitのダウンロード・インストール

以下リンクからGitダウンロードページを開きます。

Windowsの方はこちら

Macの方はこちら

Gitダウンロードページから該当するセットアップファイルをダウンロードしてください。

ダウンロードしたGitインストールファイルを実行し、Gitをインストールします。デフォルトの設定のままで問題ないので、「Next」で進んでください。

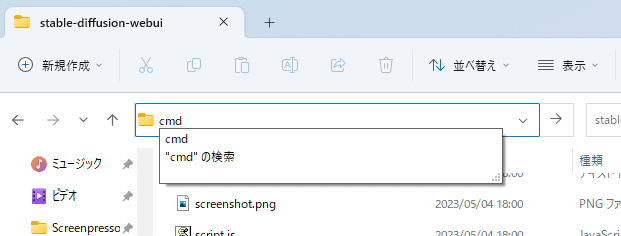

Web UIの環境構築実行

Web UIをインストールしたい任意のフォルダを開き、「エクスプローラー」のパスに「cmd」と入力します。

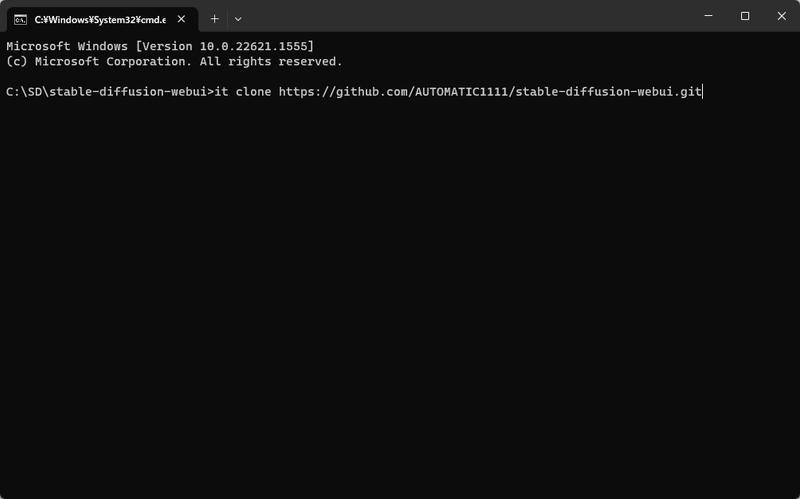

コマンドプロンプトの画面が開いてくるので、以下コマンドをコピーして貼り付け、「Enter」キーを押します。

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git

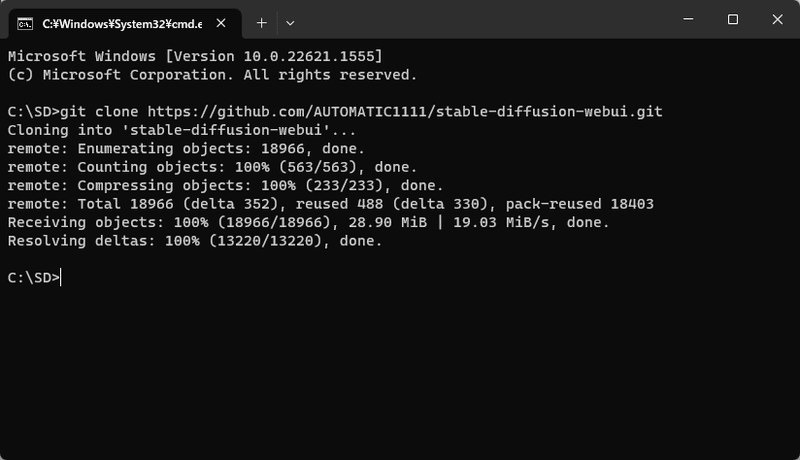

しばらく待って「done」と表示されれば完了です。

指定したフォルダ内に「stable-diffusion-webui」フォルダがコピーされているはずです。コピーされていれば成功です。

Web UIの起動

Web UIを起動する準備が整いました。

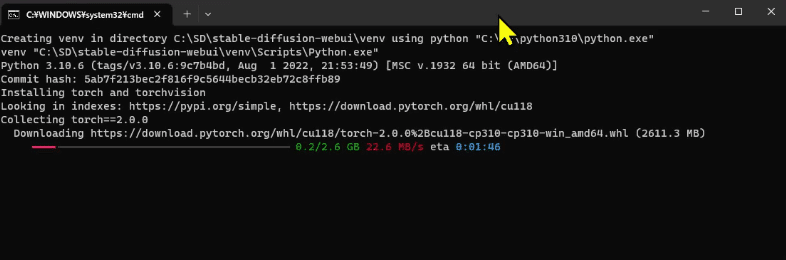

ステップ3でコピーされたフォルダ「stable-diffusion-webui」内にある「webui-user.bat」を探し、実行してください。

※「AssertionError: Torch is not able to use GPU; add --skip-torch-cuda-test to COMMANDLINE_ARGS variable to disable this」とエラーが出た場合は、「webui-user.bat」をメモ帳で開き「set COMMANDLINE_ARGS=」の後ろに「--skip-torch-cuda-test」を追記すると解決します。

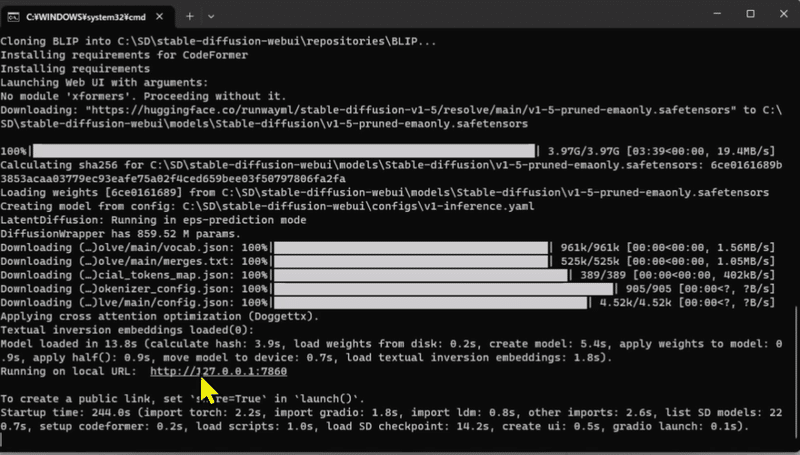

画面上に「Running on local URL: http://127.0.0.1」と出てきたら完了です。

「http://127.0.0.1」を「Ctrl」キーを押しながらクリックしてみてください。以下の画面が出たら成功です。

Stable Diffusion Web UIにモデルを追加する方法

Stable Diffusion Web UIの起動ができ、基本的な使い方が分かったと思います。

次はモデルファイルを入れてみましょう。

モデルを変更することで生成できる画像が大きく変わります。

試しに「Pastel Mix」というモデルを追加して画像を生成してみましょう。

慣れた方は任意のモデルをどんどん追加して試してみてね。

「Pastel Mix」のモデルファイルとVAEファイルをダウンロードする

Web UIを使う場合はモデルファイルとVAEファイルが必要となります。

VAEファイルは、モデルによって推奨されているVAEファイルがあります。基本的には

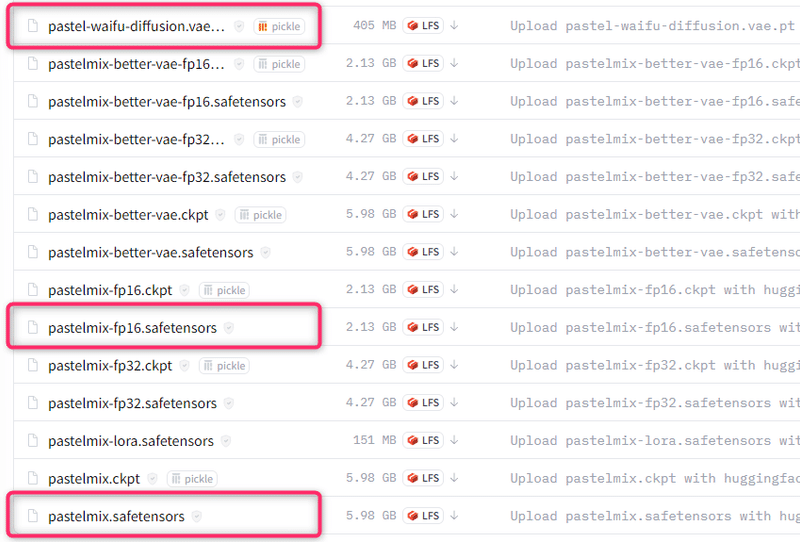

ページを開き「Files and versions」タブに移動します。下にスクロールするとダウンロードファイルが表示されます。その中から以下ファイルをダウンロードします。

モデルファイル:pastelmix.safetensors ※軽量版がいい方は fp16をダウンロードします。

VAEファイル:pastel-waifu-diffusion.vae

保存先は以下の通りです。ダウンロードしたファイルを移動させてください。

モデル:webui\models\Stable-diffusion

VAE:webui\models\VAE

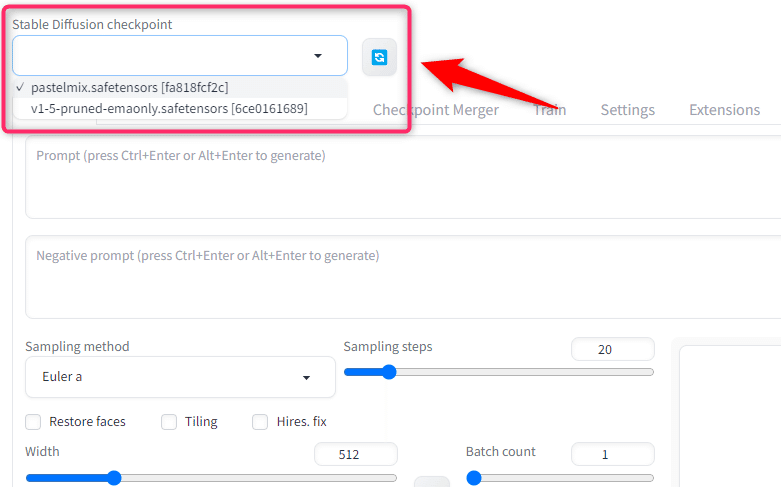

再読み込み

再読み込みボタンを押すと「pastelmix」が追加されているので、切り替えてからプロンプトを入力して実行してみましょう。

こんな感じの画像が出来上がります。

Stable Diffusion Web UIの使い方

さて、ここからはStable Diffusionの導入が終わって、これから使ってみようという方への記事になります。

画像を生成するために必要なプロンプト(呪文)は初心者の方だとよくわからないと思うので、「ちちぷい」というAIイラスト画像をプロンプトと一緒に投稿できるサイトがあります。

このサイトを利用することで、初心者の方でも精度の高い画像を生成できるので、そのサイトの使い方も解説していきます。

Stable Diffusion Web UIのインストール

Stable Diffusion Web UIのインストールがまだの方は以下の記事を参考にインストールしてください。

Stable Diffusion Web UIの使い方

Stable Diffusionの基本的な使い方を解説します。

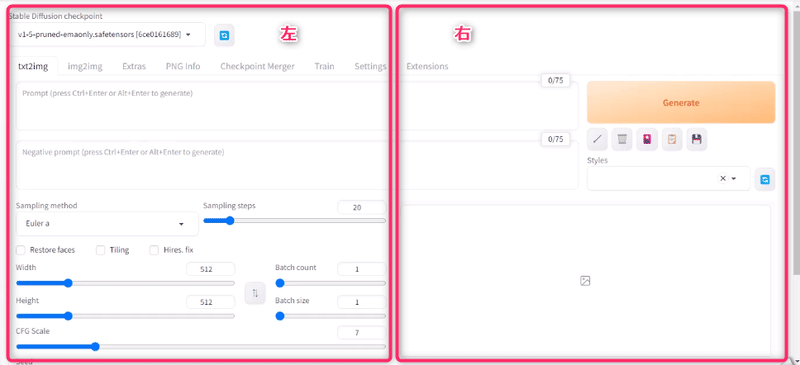

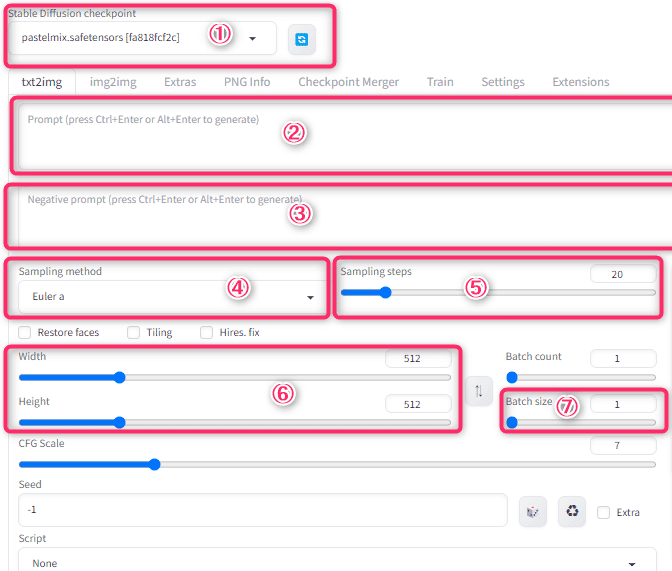

まずは左画面から

1.checkpoint:モデルの切り替え。

2.Prompt:画像の中に描いてほしいものを指示する

3.Negative Promt:画像の中に描いてほしくないものを指示する

4.Sampling method:サンプラーともいい、重要な役割です。モデルにあったサンプラーを選ばないとイラストの質が大きく下がります。

5.Sampling steps:ノイズ除去回数。大きくしすぎると遅くなります。20~30くらいがよいです。

6.Width,Height:画像の幅と高さ

7.Batch count 、Batch size:カウントとサイズをかけた数値が、生成する画像枚数になります。枚数を上げたい場合はsizeをあげることをおすすめします。

次に右画面

8.Generate:Generateボタンを押すと画像が生成されます。

9.画像表示画面:生成された画像が表示されます。

「ちちぷい」を参考に画像を生成してみよう

機能がたくさんあって初心者の方がすべての機能を把握するのは難しいので、とりあえずはStable Diffusionで画像を生成するうえで重要な部分だけ説明します。

プロンプトを一から作るのはなかなか難しいので、今回はちちぷいさんのサイトで気に入った画像のような画像を生成してみたいと思います。

ちちぷいから気に入る画像をみつける

以下リンクからちちぷいさんのサイトに飛びます

呪文を探す

画像をクリックすると画像の詳細が表示されます。

呪文をコピーして貼り付け

先ほど開いた画像の詳細画面に「呪文をコピーする」ボタンがあるので、「プロンプト」と「ネガティブプロンプト」の呪文をコピーしてStable Diffusionのプロンプト入力欄にはりつけてみましょう。

②にプロンプト

③にネガティブプロンプト

その他設定をする

ちちぷいの画像詳細画面の下のほうに以下のような設定が載っています。これをStable Diffusionへ設定していきます。

この設定をすると、ちちぷいに投稿されている画像により近い画像が生成できます。

Stepsを⑤のSampling stepsに合わせます。今回でスト40に合わせます

Scaleは番号を振っていませんが、CFG Scaleに合わせます。通常は7のままです

Seedは設定しなくても綺麗な画像が生成できます。より近づけたい場合は設定します。

Samplerは④のSampling methodに合わせます。

画像生成を実行する

設定ができたら画像を生成してみましょう。

Stable Diffusionの右画面に「Generate」ボタンがあるので押してみてください。

しばらく待つと⑨に画像が表示されると思います。

保存したい場合は「Save」ボタンでパソコンに保存しておきましょう。

まとめ

今回はStable Diffusion Web UIの環境構築から使用方法まで「ちちぷい」を使って好みの画像を生成するところまでを解説させていただきました。

慣れてきた方は、自分なりにプロンプトを変えて自分が求める画像を生成できるように練習してみてください。

この記事が気に入ったらサポートをしてみませんか?