Adobe ExpressでFirefly体験してみた

今日は2023年10月17日に行われたRPACommunityのイベント「画像生成AIで一緒に遊んでみよう!~Adobe Express|Adobe Firefly~」で触発されたのでとりあえず体験しました。

以前からAdobe Fireflyには非常に興味があったのですが、マニュアル類を全く読まないワタクシは入り方が判らずに挫折していましたが、イベントで使い方がわかったので早速チャレンジしてみました。

入り口はAdobe Expressから

Adobe FireflyはAdobeのML機能です。ついついChatGPTのようにWebページとして提供されるものではなく、Adobeの様々な製品・サービスに組み込まれる機能です。どっちかというとMicrosoftのAzure Open AI Serviceみたいな感じですね。

まずはAdobe Expressのページにアクセスします。

ちょっと小さいですが「生成AI」のタイルをクリックすると生成AIのサービス内容が表示されます。テキストから画像を生成する機能と、テキストにスタイルやテクスチャを与える機能があることがわかります。

早速ホーム画面の「adobe Expressを無料で始める」をクリックします。GoogleやFacebook、Appleアカウントなどを使ってログインできます。

アカウント登録画面になりますので登録します。

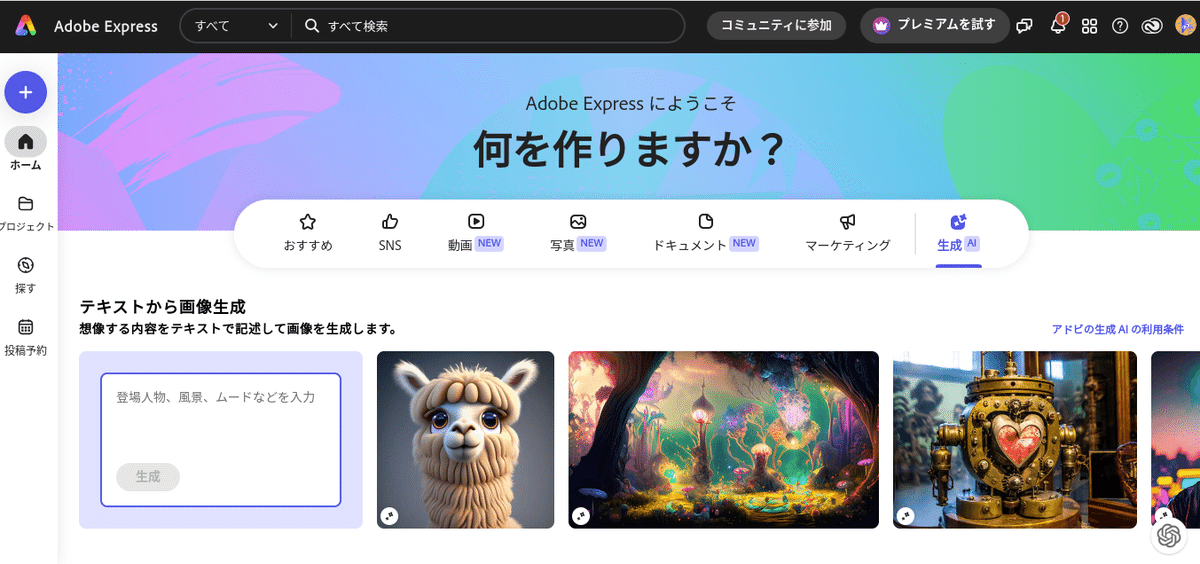

Adobe Expressのホーム画面になります。

生成AIを使ってみる

さっそく、生成AIを試してみます。メニューから一番右の「生成AI」を選びます。「テキストから画像を生成」の画面になり、プロンプトの投入エリアが表示されます。

プロンプトには以前使ったこれを投入してみます。当然、英語で投入してみます。

卒業シーズンの高校の校庭に桜が散って舞っている。桜の木の傍らに立って、スマホを持ってこちらに微笑みかける制服姿の女子高校生のイラスト。

Cherry blossoms are scattered and dancing in a high school playground during graduation season. Illustration of a high school girl in uniform standing by a cherry tree, holding a smartphone and smiling at us.

アドビアプリでの生成 AI の使用についての同意が求められます。このあたりは著作権にちゃんと対応しているAdobeらしいですね。

「同意する」をクリックすると画像が生成されます。左に4つのサムネイル、中央にその内のひとつが表示されます。ちょっと独特のセンス(高校生なのに幼い)のイラストです。

ちなみに同じプロンプトでMidjourneyの場合はこんな感じのイラストです。

試しに日本語で投入してみたらこんな感じです。そんなに変わりませんね。

画像を加工してみる

Adobe Expressの良いところは生成した画像が作りっぱなしではないところです。画像にテキストを追加したり装飾をしたりと、さまざまな加工がでいるようになっているのが魅力です。

この辺はイラストレーターを擁するAdobeっぽいですね。なにかの説明に使いたいイラストの場合なんかには重宝しそうです。

まとめ

Fireflyというか、Adobe ExpressはさすがAdobeさんと思うくらいの実用性でした。このあたりは「画像生成」という技術から入ったサービスなのか、「画像作成」という実務から入ったサービスなのか・・・・同じことでも視点が違うと提供の仕方が違うんだと感心してしまいました。

ただやはり生成AIによってセンスと言うか画風の癖はあるようで、このあたりを克服して使いこなすにははプロンプトやパラメータを使いこなさないといけない感じがします。

この記事が気に入ったらサポートをしてみませんか?