LINEの大規模言語もモデルでネット記事がちゃんと書けるのか?japanese-large-lm-3.6b

はじめに

日本語のテキスト処理技術が急速に進化している現代。中でも、LINE が公開した japanese-large-lm という36億パラメータという大規模言語モデルは、多くの関心を集めています。このモデルは、日本語テキストの精緻な処理を目的として開発され、優れた生成や解析能力を持っています。そこで、この記事では、Google Colab を活用し、実際にネット記事の生成がどれほど上手く行えるのかを検証してみます。結論としてはネット記事を書くの難しいです。

Google Colab で LINE の japanese-large-lm を試す

ほぼこちらの記事の焼き回しですが、japanese-large-lm-3.6bを使って本当に使えるようなネットの記事を書くことができるのということを検証して行きます。

今回はcolab v100 GPUを使いました。(ランタイムタイプの変更=>

v100)

それでは実際私がネットの記事を書こうと思っていたchatgptと仕事について書いてもらいたいと思います。コードは上記のサイトと同じくこちらを使わせていただきます。チャットGPTのようにほにゃららなな記事を書いてと言ったら書いてくれるタイプのものではなく続きの文章を書くタイプのAIのようです。(GPT2がそんな感じでした。)

prompt = "この記事では、chatgptと仕事について詳しく解説します。"

このようにお願いしてみます。

# プロンプトの準備

prompt = "この記事では、chatgptと仕事について詳しく解説します。"

# 推論の実行

input_ids = tokenizer.encode(prompt, add_special_tokens=False, return_tensors="pt")

tokens = model.generate(

input_ids.to(device=model.device),

max_length=300,

temperature=1.0,

do_sample=True,

pad_token_id=tokenizer.pad_token_id,

)

output = tokenizer.decode(tokens[0])

print(output)出力がこちら

この記事では、chatgptと仕事について詳しく解説します。 chatworkのチャットメッセージ一覧にメッセージを表示/非表示(非表示から非表示に変更も可能)にする2つの方法を徹底解説! chatworkにはメッセージを一覧化できる機能があるので、ここに表示したくない(表示させたくない)という時があるかと思います。そこで今回は、 chatworkのチャットメッセージ一覧にメッセージを表示させる方法 chatworkのチャットメッセージ一覧にメッセージを非表示にする2つの方法 をまとめて説明します。... ※ただし、chatworkに設定した「パスワード」を変更する方法は、2018年6月30日以降に利用停止した人以外は利用できません。 メールアドレスからパスワードの変更を行おうにも利用停止しているアカウントのパスワードは変更できないのが実情です。 メールからパスワードを変更する方法は2018年6月30日以前から利用している人に限定した方法となっています。 メールからパスワードを変更したい人は、以下のリンク先の「chatwork(チャットワーク)に登録したメールアドレスからパスワードを変更する方法 」をご覧ください。 chatworkに登録したメールアドレスからパスワードを変更する方法 chatworkのパスワードを忘れた場合は以下のページをご覧ください。 チャットワークのパスワードがわからない時の復旧手順 chatworkを退会して、chatworkへのログインを二度とできないようにする。 チャットワークを退会したい、または登録メールアドレスからのパスワードの変更ができない時は、 メールアドレスとプロフィールを削除しましょう。 登録メールアドレスとプロフィールを削除すれば、退会できます。 chatworkはチャットワークよりもセキュリティ

ChatGPTの話が突然チャットワークに変換されて話が進んで行きます。この店はきついですね。おそらくChatGPTという言葉が学習されていないんじゃないかと思いました。せっかくなので別の言葉で置き換えて記事を書いてもらいます。ChatGPTではなくAIという言葉を使ってもう一度試してみましょう。

prompt = "この記事では、AIと仕事について詳しく解説します。"

この記事では、AIと仕事について詳しく解説します。 AIで変わる仕事とは? AIの進化に伴い、無くなる職業や新たに生まれる仕事について考えてみたいと思います。 結論からいうと、これからAIの進化に伴って新しくなる仕事は2つです。 0から新しいものを作る創造的な仕事 2種類以上の仕事の組み合わせ 現在、日本の企業の98%以上が何かしらの形の仕事を担っています。 これらの仕事の多くはAIに取って代わることはできません。 それは、創造的な仕事と組み合わせによって成り立っているからです。 創造的な仕事は、アイデアを形にする 0から何か新しいものを作る創造的な仕事は、これからの時代、AIに取って代わることはできません。 AIは現在、機械学習などの分野が発展しており、AIを用いた分析によって今までにない物を生み出すことができるようになりました。 例えば、AIの機械学習を利用したAIスピーカーや、AI翻訳機などは、まさにAIによる革新的な発明といえます。 一方で、AIを使って何かを1から作り上げる能力は、そのAIの開発を行う企業にのみ与えられた特別な能力です。 2017年、IBMがAIと人間を組み合わせて、40年ぶりにチェスの世界チャンピオンに勝利しました。 しかしそれは、人間のAIがチェスの戦術を作り上げたのではなく、人間が用意したAIの戦略を人間が考え直し、改良していった結果でした。 このように、AIが考案した囲碁の戦略を人間が改良することは、AIと人間が手を組むAI開発企業しか行えないことです。 もちろん、AIと人間が手を組むような企業でも、AIを使って仕事をすることはできますが、創造的な仕事と比べると非常に難易度が高いです。 現在、AIを利用したサービス

ちょっと修正しなくてはいけないけどもギリギリ使えそうな文章ですね。

まだ続きがありそうだったので

max_length=500

にして再実行。出力はこちら、

この記事では、AIと仕事について詳しく解説します。 AIと仕事、その仕事内容に違いはあるの? まず、AIと仕事の関連について説明します。 「AIの普及と仕事のこれから」という記事で、AIの普及が加速する時代において求められる人材や、今後どのような職業がAIにとってかわられるかといった内容を展開しています。 記事の中で言及されている「データサイエンティスト」や「エンジニア」といった職業は、AIの導入や活用によってその業務内容が大きく変わる可能性のある職種として取り上げられています。 つまり、AIや人工知能に関する深い知識をもとにして、AIやその導入に関する企画を考え、導入したシステムを運用し、トラブルシューティングまでも行うという仕事内容です。 データサイエンティストとエンジニアの仕事内容の違い データサイエンティストとエンジニアの仕事内容の違いについて説明します。 データサイエンティストとはどのような仕事なのかについては上で触れた通りですが、エンジニアとの違いについても簡単に触れておきましょう。 ■データサイエンティストとは データサイエンティストは、大量のデータを用いながらAIを活用した調査分析を行い、ビジネス上の問題を分析するスペシャリストです。 データサイエンティストは、主に社内や社外のデータ分析のエキスパートとして業務に従事することが多いです。 マーケティングデータなどを収集・加工して、その結果を利用してビジネス上の課題解決や改善を行います。 具体的には、消費者の動向を分析することやニーズを把握すること、またそれをビジネスに繋げることなどが求められています。 ■エンジニアとは何か エンジニアは、IT機器やソフトウェアなどの開発や保守・運用を行うスペシャリストです。 エンジニアは自社内だけではなく、業界や会社を問わず、様々な場面で活躍することができます。 エンジニアは、顧客のニーズに合わせた設計やソフトウェア等の開発、導入までのすべての工程に携わり、導入後のサポートまでも行います。 具体的には、コンピュータシステムの発注者である顧客企業と、そのシステムに組み入れるソフトウェアを作成する開発会社が、互いのニーズを擦り合わせながら開発し、納品を行います。 また、コンピュータシステムに限らず、例えば食品会社やアパレル会社で、AIが分析した情報を店舗や販売促進に活かすといった業務を担当することもあります。 AIが普及すれば、データサイエンティストとエンジニアの仕事の垣根はなくなる? AIの普及により、データサイエンティストとエンジニアの仕事の垣根はなくなるのでしょうか? 結論から申し上げると、そこまで単純ではないでしょう。 AIや人工知能は、まだまだ未知数の領域です。 また、AIや人工知能が業務を行うには、まず膨大なデータの分析が必要となります。 そのため、AIや人工知能の導入を検討している企業の多くは、自社内に専門のエンジニアを抱えていることがあります。 ただし、データ収集方法や分析方法については、AIや人工知能と人間

パッと見使えないことはないんですが、文章にまとまりがないというか全体的なまとめを人間がしないと記事としては使えなそうなレベルです。

データサイエンティストとは データサイエンティストは、大量のデータを用いながらAIを活用した調査分析を行い、ビジネス上の問題を分析するスペシャリストです。

この辺もちょっと文章がおかしい感じがします。

prompt = "この記事では、AIとシンギュラリティについて詳しく解説します。"

max_length=700,

出力はこちら、

この記事では、AIとシンギュラリティについて詳しく解説します。 「シンギュラリティって何?」という人もいると思いますので、まずはシンギュラリティとAIのことをよく知っておきましょう! 目次 1 シンギュラリティとは? 2 AIとは? 2.1 AIの定義 2.2 AIの具体例 2.3 AIの定義と具体例の違い 3 シンギュラリティとAIの違いは? 4 シンギュラリティとディープラーニングの関係は? シンギュラリティとは? シンギュラリティとは「技術的特異点」とも呼ばれていて、AIの技術が進化によって人間の知性に追いつき、人間の支配が及ばない領域にたどり着くことを意味しています。 シンギュラリティは人工知能(Artificial Intelligence:AI)の分野における「次の大きな飛躍」を表すものとして、よく使われています。 シンギュラリティについてより詳しく知りたい人には、「人類の知能の進化によって人工知能が人間の領域に達する」と紹介した書籍もありますよ。 AIとは? シンギュラリティとAIについてよく分かりましたが、AIとシンギュラリティってどうやって使うんですか? また、具体的にどのような違いがあるんでしょう...? AIとは? AIとはArtificial Intelligenceの略で、人工知能と訳されますが、一般的にはAI=人工知能と考えられています。 ただ、AIの明確な定義は特に決まっておらず、「機械学習や深層学習(ディープラーニング)、汎用人工知能(AGI)などを含むものは全てAIと呼ばれることもあります。 定義は曖昧なものの、一般的にAIと言われるのは、機械学習や深層学習(ディープラーニング)、汎用人工知能(AGI)を含んだ人工的な知的システムのことを指しますよ。 ちなみに、2017年1月20日にGoogleが独自のAIの開発に関して公表しています。 AIの定義 AIの定義も曖昧なのですが、「機械による複雑な知的活動」とざっくりしたものが定義されています。 AIには機械学習や深層学習(ディープラーニング)、汎用人工知能(AGI)が含まれていますが、機械学習や深層学習(ディープラーニング)、汎用人工知能(AGI)を含まないアルゴリズムもありますが、AIの「アルゴリズム」を指してAIと呼ぶことが一般的です。 人工知能学会がAIを定義したときにも「人間が作成したルールに基づきコンピュータで実行可能な処理を行う知的活動をいう」としています。 つまり、人間が考えたプログラミングを解釈して動作できるシステムがAIなのです。 AIの具体例 AIの具体例と言えば、ロボットや画像認識が代表的ですが、今回はAIの最も代表例でもある画像認識を例に挙げます。 例えば、街中にAIが働く自動販売機があるとして、利用者が商品を注文すると、AIがそれに必要な商品を検索して、商品を自動的に選んでくれるシステムがある とします。 このときのAIは、2017年1月20日のGoogleの発表の「マシンラーニングや深層学習(ディープラーニング)を使用して、人間のように自律的に考えることができるコンピュータシステム」として説明されています。 2017年1月20日のGoogleの発表「マシンラーニングや深層学習(ディープラーニング)を使用して、人間のように自律的に考えることができるコンピュータシステム 」 画像認識の技術は近年飛躍的に発展しましたが、AIの定義は曖昧です。 画像認識の精度は向上する一方、人間のように思考できるのか?に関しては完全には答えられてはいません。 ただし、画像認識はAIの進化に大きく影響している分野です。 AIの定義と具体例の違い AIの定義と具体例の違いについて見てみましょう! まず、定義ですが、「人間が作成したルールに基づきコンピュータで実行可能な処理を行う知的活動をいう」となっています。 一方、具体例は以下のとおりです。

ChatGPT3.5レベルのものにこういう文章はなかなか出てこないなと絶望しました。

AIとシンギュラリティってどうやって使うんですか? また、具体的にどのような違いがあるんでしょう...?

シンギュラリティを使ったりはしないですね。正直、ChatGPT3.5を使っている私たちからすると文章生成の精度がまだまだ足りないなと思ってしまいます。文章の要約の性能とかがあまり良くないのですかね。文章全体もまとまっていない感じがします。

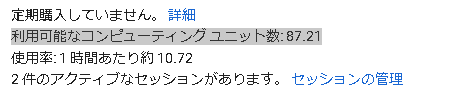

モデル自体は無料ですがcolab v100GPUを使ったら,

上記の4つの文章を出力したら、

利用可能なコンピューティング ユニット数: 87.21になりました。1200円くらいで100ユニットのうち約13ユニットを使いました。ざっくり150円分。

結論、3.6Bのモデルでもまだネット記事を書くのは少し厳しいようです。言葉がおかしい部分や間違えて話が進む部分など少し言葉の理解が足りていないように感じられます。まとまりのない文章が生成されています。まだChatGPT3.5のほうが使い勝手がいいですね。

この記事が気に入ったらサポートをしてみませんか?