記事一覧

iPhone単体でオンデバイスLLMを試してみた。LLMFarm

こんにちはIZAIエンジニアチームです。 今回は、「LLMFarm」というiPhone上でLLMを動かせるOSSを、iPhone 15 Proを使って試してみます。 https://github.com/guinmoon/LLMF…

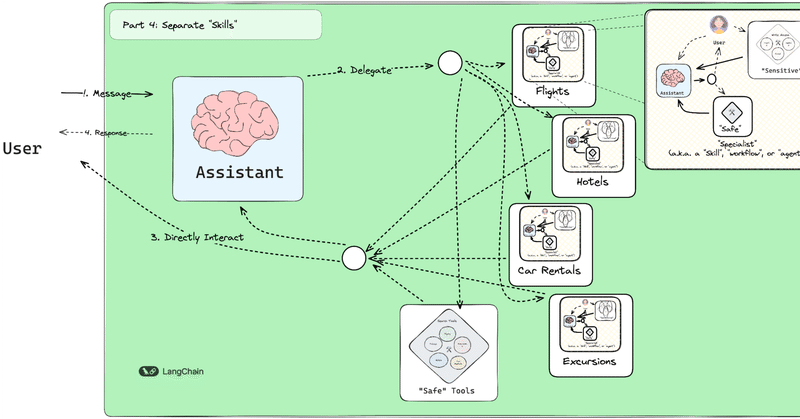

自動でプロンプトエンジニアリングする『APE(Automatic Prompt Engineering)』を試す。LangGraph

こんばんは、IZAIエンジニアリングチームです。今回は、自動プロンプトエンジニア(APE)についての論文のアイディアをもとに、遺伝的アルゴリズムチックにプロンプトを自動で調整する方法を試してみました。 APE(Automatic Prompt Engineering)とはAPEはAutomatic Prompt Engineeringの略で、その名の通り自動でプロンプトエンジニアリングを行うアルゴリズムです。与えられたタスクをもとにオリジナルのプロンプトと意味的に近しいプロ

RAGのチャンクサイズと検索手法(Vector Index / Summary Index)について考察してみた。Llama Index, LLM

こんにちは!株式会社IZAI、エンジニアチームです。 今回は、Llama IndexというOSSライブラリを使ってRAGを実装し、その検索精度に与える各パラメータの影響を考察してみます。 そもそもRAGとはRAG(Retrieval Augmented Generation)とはLLMにデータを入力する際に、 外部の知識ベースからその入力内容に合った情報を探し出し、その情報をLLMに渡すことで回答精度を上げる手法です。 RAG(Retrieval Augmented Gen

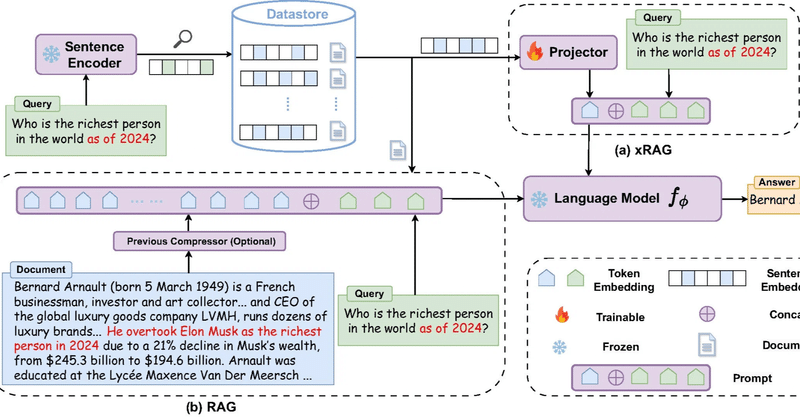

RAGの効率を劇的に向上させる手法 xRAG(Extreme Context Compression for RAG)を試してみた。

こんにちは、IZAIエンジニアチームです。 今回は、先日arXivに公開されたxRAG: Extreme Context Compression for Retrieval-augmented Generation with One Tokenという論文についてご紹介します。 xRAGとは?xRAGは、Retrieval-Augmented Generation (RAG)を拡張した手法です。RAGでは、検索結果のチャンク(文章断片)をそのまま言語モデルに入力するのに対し