video2video関連 動画データに対しての画風変換・生成まとめ

こんにちは、Hi君です。

こちらも少し古い情報にはなりますが、せっかく調べたので記事としてまとめてみました。お付き合いください。

Batch img2img

AUTOMATIC1111/stable-diffusion-webuiの拡張機能の一つであるBatch img2img。こちらは特定のディレクトリ内の画像群を入力し、画像生成を行うことができます。ただ画像群につき1つのpromptやcontrolnet設定・ガイド画像を適用出来ないことが大きな欠点の一つです。

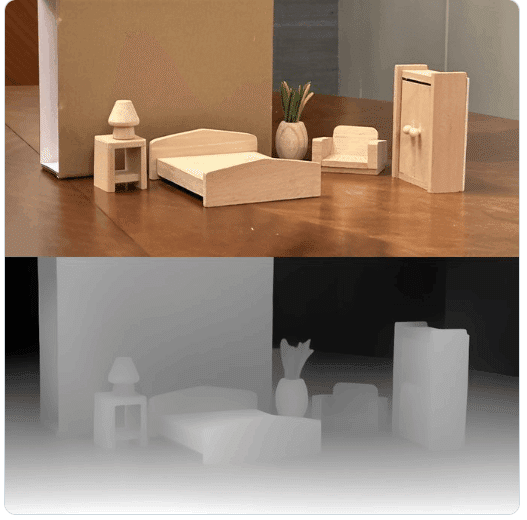

img2depth

img2depth はmulti-subject-renderにも使われているMiDasを使った単眼深度推定です。ControlNetやT2IAdapterはdepth2imageもサポートしているので、複数の対象物画像→深度画像としてコラージュ→コラージュ深度画像をガイドに所望の画像を出力する等の処理フローが可能となります。

ガイド画像に関して、どのような形でコラージュを行うか(深度画像的な変換は必須か)については、まだまだ議論の余地がありそうです。(ただ、ガイド画像としてはポーズスケルトンよりも多情報で生成物の一定の安定性はもたせやすいかもしれません)

ポーズ的なガイドを使えない対象物を含むシーンでの画像生成等は、この方法だと有効性はありそうですが、深度画像の品質次第ではあります。

セグメンテーション or インスタンスマスクや描画レイヤー階層情報等でも同様の事は恐らく可能 + T2IAdapterは複数種類のガイド画像情報が使えました。(スケルトンポーズ + セグメンテーションマスク等)

手元の環境では「depth_leres」が動いたので「depth」と比較してみました。

— えむえす (@msss_ai) February 19, 2023

結論だと「depth」+「Midas Resolution」を「高くする」(右上768)のが一番鮮明に奥行をとれていそうでした。

細かい画像など詳細は下記へhttps://t.co/lguW6zzqWj #AIピクターズ https://t.co/8VVlYX9VBn pic.twitter.com/kShynn1xZ0

画像生成AI「Stable Diffusion」を使って新しいインテリアデザインを作成しまくる試み

gif2gif

Animation with ControlNet, almost perfect!

ControlNET to Video - Stable Diffusion Automatic 1111 Tutorial

その他機能

ControlNetの画像入力を動画シーケンス的に行いたい場合

ControlNet用のガイド画像データ(canny, openpose等)についても、動画的なガイドデータ入力を受け付けられるような機能を追加するためのプルリク群

[Feature Request]: use one image in img2img to control multiple image styles #8214

フリッカー除去系のTips

マルチフレーム画像生成の際はseedを固定するとうまくいくようです。

#6. Here, to further reduce flickering, it is necessary to use a fixed value for Seed rather than a random '-1'. As is well known, Seed determines noise. Therefore, if the noise is fixed, the consistency rises. pic.twitter.com/BKmGrCieOG

— toyxyz (@toyxyz3) March 6, 2023

vid2vid実装?

以上です!

次回の記事もお楽しみに。

文:Hi君

協力:inaho株式会社