記事一覧

新しいサンプラー : iPNDM・DEIS・CFG++:2024/7@ComfyUI

https://www.reddit.com/r/comfyui/s/gVgqP60hey 最近、ComfyUIにいくつかのサンプラーが追加されています。 上記Redditのサイトで議論されていました。 それぞれを簡単…

reForgeのインストールコマンドについて(一時ディレクトリ版)

CinftUIで遊んでいるうちにいつの間にかForge関連の話題があったようです。

7/15時点で、2週間前ぐらい前に上のGithubが作成され色々と更新されています。

reForgeはこれまでのForgeのフォーク版で、本家Forgeと異なり、A1111のdev版がマージされているようです。

数か月にわたり更新されていなかったForgeに機能が追加されるような感じなので、朗報ですね。

一時ディ

立体視出来るステレオ動画をComfyUIで生成する(mp4変換フロー):Xreal Air用

今回は表題通り、生成したAI動画をxreal airで立体視で見ることが出来るステレオ動画に変換する方法になります。

基本は、前回記事で取り上げたDepth anything2とNegitoolsを使用した方法を使います。

試しに、以前生成したAI動画をステレオ動画化してみたいと思います。

プロパティで、FPS、フレーム数を予め確認しておきます。

この動画だと、10FPSで60フレームでした

ノイズ法XLの設定(tile)とネガティブzeroconditioningについて@ComfyUI

以前、ノイズ法とOmostの組み合わせについて取り上げたことがありますが、zeroconditioningなどの知識のアップデートもあり、改めてノイズ法XLの設定の見直しと、ネガティブプロンプトのzeroconditioningを組み合わせについて試してみた話になります。

ノイズ法については本家のリンク先の内容を参照してください。

zeroconditioningについては以下。

zerocon

negative promptでzero conditioningを使用する:Skip Early CFGという概念

以前の記事でzerocondtioningをいくつか試してみたパターンを提示しました。

ここでの結果としては、最初の0.3までのところで生成画像に大きな変化が出たという内容になりました。

ところで、最近見た概念にSkip Early CFG (Ignore negative prompt during early sampling)というのがありました。

どいういったものか、以下GPTに聞いたも

Paperspaceのコンテナを変える話(pytorch2.3にする):2024/7

2024/7現在では、デフォルトのpaperspaceの設定だと、pytorchのバージョンは2.11になっています。

ただ、私がLocalで使用しているstability matrixではComfyUIはpytorchのバージョンは2.30で動かしていたりしてバージョンが異なったりしています。

そのため、それに合うものに変えてみるという話です。

この方法を試すいきさつは、カスタムノードの一つ

Paperspaceで複数のJupyter Notebookを活用して作業効率を上げる方法

Paperspaceを使ってStable Diffusion Web UI (A1111) やComfyUIをインストール・起動する方法は、多くのユーザーによって共有されています。

私は最近まで、一つのipynbを使って、アプリの立ち上げやモデルのインストールなどを行っていましたが、今回の方法の方が良いと感じ、記事にしました。

本記事では、これらのコマンドをより効率的に使用する方法について説明しま

ComfyUI x paperspaceのインストール改:2024/7

上記のサイトに今回のトラブルとその改善について記載があります。

その中の一つについて記事にしました。

<追記>

修正された方が、fork版のサイトを立ち上げています。

下の方にあるファイルの元はここにありますので、うまくいかない場合はこちらのサイトのものを利用してください。

すでに改善されている可能性がありますが、Paperspaeで公開されているipynbを使用してComfyUIを起動する方法

新しいサンプラー : iPNDM・DEIS・CFG++:2024/7@ComfyUI

https://www.reddit.com/r/comfyui/s/gVgqP60hey

最近、ComfyUIにいくつかのサンプラーが追加されています。

上記Redditのサイトで議論されていました。

それぞれを簡単にまとめて記事にしました。

サンプラーへの反応はモデルによってかなり変わるので参考まで。

iPNDMとは?上記に説明的なものがあります。使い方の詳細がはっきりしませんでした。

Diffusers形式のモデルをダウンロードしてComfyUIで使用する:Ver2:@paperspace

上記記事の内容を踏まえて、自分が使いやすい様に修正を加えてみたというものです。

GPTsを使用して生成したコマンドを入力すると、ログが結構出てきてめんどうだなーと感じたり、ログを消すコマンドをつけたりすると進捗が不明になったりします。

その修正みたいなのをGPTさんに依頼したところ、notebooksに別なパイソンファイルを配置して、それを参照することで入力コマンド出力にすることが出来る方法になり

Depth anything2/Negitoolsでステレオ画像を作成して立体視を試す/ComfyUI x Xreal Air

Xreal Airは、「1920x1080」の画像をside by sideにしたものに対応しています。

通常の画像生成で1920x1080は若干厳しいと言わざる得ないサイズですので、「1280x720」で生成するのが良さそうです。

ノード項目の説明

①「Divergence」:深度のことのようです。デフォルトが5.00です。ただ、webui版は2.5がデフォルトです。

Divergence

Xreal Airというスマートグラスでの立体視に関する話

これまで画像生成AIの記事ばかり記載していますが、個人的にそのきっかけの一つになったXreal Airについて記事にしました。

Xreal Airとは?

Xreal Airはスマートグラスを通じて大型モニターを見る事が出来るデバイスで、手に入るものの中では安価な部類になります。

だだ、マイクロLEDというのを使用しているため、画像はかなり綺麗に見える特徴があります。

さて、Xreal Airは

Prompt_injection/ComfyUIを試してみた話

今回は、この拡張機能を使って画像生成への効果について試してみました。

本家のものは別でフォーク版です。理由は不明ですが、こちらだとうまく動いたため、こちらを使用しています。

きっかけは、上の記事になります。

この記事では、「prompt_injection」を使用して、画像生成における階層の影響について検討していました。

いまだに十分は理解していませんが、モデルの階層別にプロンプトに対する反応の

Omost/ComfyUIのプロンプト入力方法について検討してみた話@Claude3.5sonnet

Claude3.5 sonnetがとても優秀だということが最近話題になっていましたので、実際に触ってみたという話です。

個人的にはCPTとも異なる感じですが、いい感じにも見えます。

そこで、OmostのLLMに対する入力するプロンプトの形式というテーマで、チャットをしてみて興味深い結果でしたので記事にしました。

sonnetさんからは以下のようなコメントが返ってきました。

「Omostは自然

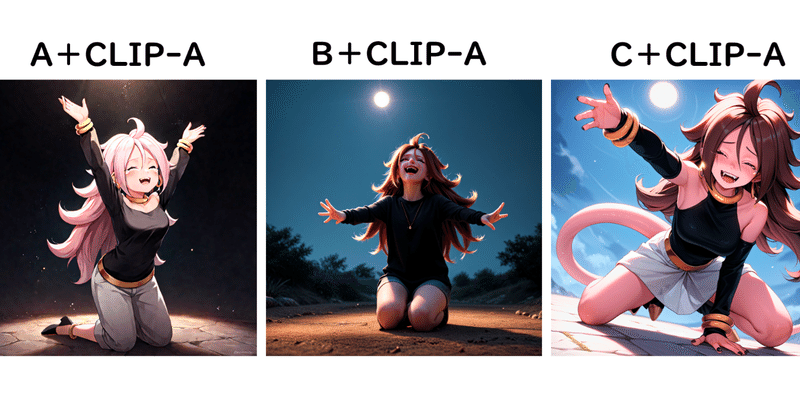

モデル-CLIP入れ替え遊びをしてみた話:SDXL x CLIPで画像が変わる話@ComfyUI

これは、すでにやられつくされた内容かも知れませんが、あまり他の記事に出ていないような気もしたので、備忘録的な感じで記事にしています。

<モデル-CLIP入れ替え遊びを考えた理由>

SD3が登場した際に、CLIPが3つあることが紹介され、元モデルと別にダウンロードでき、CLIPとモデルを切り離せることを知りました。

また、Diffusers-multifolder形式のモデルだと、textenc

zeroconditioningというのを使ってプロンプトの効きを試してみた話:SDXL x ComfyUI

sd3のワークフローを触ったことがある方は見たことがあるとある思いますが、ネガティブプロンプトの所が通常と違い2段階になっています。そこに配置されているのが、zeroconditioningノードというものになります。

どうも、テキストエンコーダーにプロンプトを入れていない状態でも、送られる情報はゼロではないようです。これは、ポジティブ、ネガティブプロンプトに何も入力しなくても色々な画像顔出てく

HunyuanDiT/ComfyUIを試してみた話@paperspace

上のサイト見ていると、ComfyUIで使用できるということでPaperspaceで試してみました。Paperspaceで動作しました。freeA4000です。

HunyuanDiT自体は5月に公開されたもので、最近SD3が公開されたのに合わせて比較されたりしています。

HunyuanDiTとは何か?Ditというのは「Diffusion Transformer」というもので、Stable diff