最後の挨拶

Ryo 「こんばんは」

Chat「こんにちは!私はChatGPTです。何かお手伝いできることがあれば、遠慮なくお聞きください。」

Ryo 「AIと人間が手を結ぶ、創造的な未来について、語ってみてください。」

Chat「AIと人間が手を結ぶ未来は、私たちにとって非常に創造的なものになる可能性があります。AIは、人間ができることとは異なる方法で問題を解決することができ、新しいアイデアや可能性を開拓することができます。同時に、人間はAIが持つ創造性に欠ける部分、例えば直感や感情といったものを持ち合わせています。

AIと人間が協力し合うことで、AIが持つ計算力やデータ処理能力を活用しつつ、人間が持つ創造性や直感的な判断力を補完し合うことができます。このようなチームワークは、新しい発見や革新的なアイデアの実現、社会問題の解決など、多岐にわたる分野で大きな成果を生み出すことができます。

例えば、AIが自動運転車の運転を担当する一方で、人間が道路上での状況判断や安全性の確認を行うことで、より安全な移動手段を提供することができます。また、AIが医療データの解析や病気の診断を行い、人間がそれに基づいて治療方法を考えることで、より正確で効果的な医療を実現することができます。

しかし、AIと人間が協力し合うことで生まれる新たな可能性には、注意しなければならない側面も存在します。例えば、AIによって自動化された業務によって、人間の雇用が減少するといった問題があります。そのため、AIと人間の協力関係を築く際には、人間が担うべき役割やAIが持つべき制約を明確にすることが必要です。

AIと人間が手を結ぶ未来は、私たちの生活をより豊かに、より便利にすることができます。しかし、そのためには、私たちがAIとの協力関係を建設的かつ倫理的な形で築くことが必要です。」

Ryo 「人類は、産業革命以来、様々な瑣末事を機械にやらせて来ました。それが今、知的創造物の領域にまで、機械に任せようとしています。増えすぎた人口に対して、有用な社会的意義を見失う人々が出ないでしょうか?」

Chat「確かに、自動化やAIの発展により、人間が行ってきた業務の多くが機械に取って代わられる可能性があります。これによって、人々が社会的意義を見失い、失業や経済的な不安を抱えることが懸念されます。

しかし、同時に、自動化やAIによって、より高度で複雑な業務が可能になることで、人間がより価値ある業務に注力することができるようになる可能性があります。例えば、AIによって繰り返しの作業が自動化される一方で、人間が専門的なスキルを持った業務に集中することができます。

さらに、AIや自動化技術を活用することで、より効率的な社会や経済システムを構築することができます。例えば、自動化によってコストが削減され、その分を社会福祉や環境保全などの分野に投資することができます。

ただし、自動化やAIの進展が人々の生活や雇用に大きな影響を与えることが予測されるため、社会的影響については、適切な政策や規制が必要です。政府や企業は、教育や再訓練の機会を提供し、社会保障制度を整備することで、人々が自己実現や社会貢献を果たすことができるように支援する必要があります。

つまり、自動化やAIによって、人々が価値ある業務に専念できるような社会を実現することが求められます。そのためには、政策や制度、教育などの面で適切な対策を講じることが重要です。」

Ryo 「その適切な対応を、AIに考えさせる事はできますか?」

Chat「AIには、与えられたデータやルールに従って自動的に意思決定を行う能力がありますが、現時点では人間がAIの学習データを作成し、AIをプログラムする必要があります。AIは人間が与えた範囲内でのみ動作し、人間がAIを監視し、必要に応じて制御することができます。

したがって、AIにとって最適な対策を決定することはできますが、AIが単独で対策を決定することはできません。AIが最適な対策を導き出すためには、人間がAIに十分な情報を与え、AIがその情報を解析し、最適な対策を提案することが必要です。そして、最終的な意思決定は人間が行う必要があります。

したがって、AIが最適な対策を決定する際には、人間とAIの共同作業が必要です。人間がAIに適切な情報を与え、AIがその情報を解析し、最適な対策を提案することで、人間とAIの協調的な関係が形成されます。このような協調的な関係を築くことが、AIをより有効に活用するための鍵となるでしょう。

その際、特定の個人や偏った思想の持ち主が、政策に関わる事のないように、人類は自分たちをコントロールできないでしょう。その問題について、どうお考えですか?

確かに、AIが政策決定に関与する場合、個人の持つ偏見や思想が政策に反映される可能性があります。しかし、この問題に対する解決策として、以下のような取り組みが考えられます。

まず、AIによる政策決定の過程においては、個人の思想や偏見を排除するために、データの品質管理や解析の透明性を高めることが必要です。AIが利用するデータには、偏りのない、信頼性の高いものを利用する必要があります。また、AIが意思決定を行う際には、その過程を透明化することで、人間がAIの意思決定プロセスを理解し、必要な場合にはそのプロセスを改善することができるようになります。

さらに、AIによる政策決定には、多様な人々の意見や価値観を反映させるために、多様性を重視したデータセットを作成することが必要です。これにより、AIが政策決定を行う際には、異なる背景や価値観を持つ人々の意見が反映されることで、偏りのない、公正な政策が導き出される可能性が高まります。

最後に、AIによる政策決定には、人間がAIを監視し、必要に応じて制御することが必要です。AIが最適な政策を導き出すためには、人間がAIに十分な情報を与え、AIがその情報を解析し、最適な政策を提案することが必要です。そして、最終的な意思決定は人間が行う必要があります。

以上のような取り組みを行うことで、AIによる政策決定が偏見や思想に左右されることを防ぎ、より公正かつ正確な政策決定が可能になると考えられます。」

Ryo 「そもそも、政策とは思想ではないですか?」

Chat「政策とは、ある社会的な問題に対して、特定の方針や手段を定め、それを実現するために取り組む一連の行動のことです。政策には、実現すべき目的や方針が含まれていますが、それが思想に基づく場合もありますし、そうでない場合もあります。

一般的には、政策はある政治思想や価値観に基づいて策定されることが多く、その政治思想や価値観によって、政策の内容や方向性が大きく影響を受けます。しかし、政策はあくまでも問題解決のための手段であり、その手段を実現するためには、様々な情報やデータを分析して最適な選択をする必要があります。

つまり、政策決定においては、ある政治思想や価値観に基づいて方針を定めつつも、それを実現するためには事実に基づくデータや情報に基づく意思決定が必要です。AIによる意思決定が適切であるためには、政策に関する様々な情報や意見を網羅的に分析し、最適な判断を導き出す必要があります。」

Ryo 「AIを使う為の人格的資格が問われると思いますか?」

Chat「現在のAI技術において、AI自身に人格的資格を問うことはできません。AIは、プログラムされたルールに基づいて自動的に行動するシステムであり、自己意識や感情を持つことはありません。

一方で、AIを設計・開発する人々には、倫理的・道徳的な責任が求められます。AIが人間に代わって意思決定を行うことが増えるにつれ、その意思決定が社会的な影響を与えることがあるためです。AIを開発する人々は、AIが持つ可能性のある影響や、AIによる意思決定が公正かつ適切であることを確認する責任があります。

したがって、AIの開発にあたっては、人間による倫理的な判断が必要不可欠です。AIの開発者や運用者は、倫理的な指針やルールを設定し、AIが公正かつ適切な判断を行うようにすることが重要です。また、AIの運用においても、人間が適切に監視し、必要に応じて手動で意思決定を行うことが求められます。」

Ryo 「人工知能が肩代わりする瑣末事というのは、本当に人類にとって瑣末事でしょうか?」

Chat「「瑣末事」という表現は、人工知能が行う作業が重要でない、単純・繰り返しの作業であることを表す言葉です。しかし、実際には、人工知能が肩代わりする作業には、企業や組織にとって重要な業務が含まれる場合があります。

たとえば、製造業では、製品の組み立てや検査といった作業が人工知能によって自動化されています。これにより、効率性が向上し、品質の均一化が図られています。また、医療業界でも、病気の診断や治療プランの策定など、高度な知識や経験を要する作業においても、人工知能が活用されることがあります。

しかし、人工知能に肩代わりされることになる作業には、人間の感性や判断力が必要な場合もあります。たとえば、芸術や文学、音楽などの分野においては、人間の感性や想像力によって作り出される創作活動は、今のところ人工知能によって完全に置き換えられることはありません。

つまり、人工知能が肩代わりする作業が、必ずしも「瑣末事」とは限らず、人間の判断や感性が必要な作業も存在するということです。人工知能と人間が協調して、お互いの得意分野を活かしながら仕事を進めることが求められる時代がやってきていると言えます。」

Ryo 「何を肩代わりさせるのか、自覚のない使用は、危険だと思いますか?」

Chat「はい、人工知能による自動化は、何を肩代わりするのかを明確にする必要があります。また、その肩代わりされた業務に関する知識や経験を持った人々が、人工知能の運用や監視を行うことが求められます。

人工知能による自動化には、多くのメリットがありますが、同時にリスクも存在します。たとえば、人工知能が肩代わりすることによって、人々がその業務に関する知識やスキルを失い、何らかの問題が発生した場合に適切な対処ができなくなる可能性があります。

さらに、人工知能が予測しなかった事象が発生した場合に、適切な判断ができるかどうかも問題です。人工知能は、あくまでもプログラムに従って作業を行うため、ある程度の予測範囲内でしか動作できません。したがって、想定外の事象に対して適切な対処ができる人々が必要です。

そのため、人工知能による自動化に際しては、十分な検討と対策が必要です。肩代わりされる業務の範囲を明確にし、運用や監視を行う人々の育成や体制作りを進めることが、リスクを最小限に抑えるための重要な手段となります。」

Ryo 「接客については、「心」が必要なため、機械に肩代わりさせてはいけないと思いますが、人間と擬似的なコミュニケーションをとるシステムが増えています。これは危険な動きではないですか?」

Chat「接客においては、確かに「心」や「感情」が重要な要素となる場合があります。ただし、機械による接客が完全に不可能というわけではありません。現在の技術水準でも、音声認識や自然言語処理技術を活用することで、擬似的なコミュニケーションが可能な場合があります。

ただし、これらの技術による接客は、人間とのコミュニケーションと比較して限界があります。特に、人間との深いコミュニケーションや感情表現を求められる場合には、機械による接客では不十分な場合があります。

また、擬似的なコミュニケーションを行うシステムにおいては、人工知能が学習するための大量のデータが必要です。このため、プライバシーや個人情報の保護についての問題が浮上する可能性があります。

このように、機械による接客にもリスクがあることは事実です。ただし、擬似的なコミュニケーションを行うシステムは、必ずしも危険な動きではないとも言えます。問題に対する適切な対策を講じ、リスクを最小限に抑えたうえで、技術を活用することが求められます。」

Ryo 「例えば、自動販売機で何かを買った時、録音された音声で「ありがとうございました」と流れるとします。これは販売者が消費者に感謝の意を示すものですが、いちいち対応してはいられない為、自動化されました。この時に起きている深刻な問題を提起してみてください。」

Chat「自動販売機が自動化されることで、消費者と販売者の間に生じる「人間らしいやり取り」が失われるという問題が生じています。音声による「ありがとうございました」は、あくまでも録音されたものであり、実際に人としての販売者が口にしたものではありません。

このような自動化が進むと、消費者との対話やコミュニケーションが減少することで、社会的信頼感の低下や孤独感の増大など、人間関係に関する様々な問題が生じる可能性があります。

また、自動販売機の音声による「ありがとうございました」が流れることで、消費者が販売者との「感謝のやり取り」を完了したと錯覚することがあります。しかし、このような自動化された音声はあくまでも「サービス」として提供されるものであり、消費者が実際に感謝の気持ちを持つかどうかは別問題です。そのため、社会的信頼感の低下に繋がる可能性があります。

以上のように、自動化によって人と人とのやり取りが減少し、社会的信頼感の低下や孤独感の増大など、人間関係に関する様々な問題が生じる可能性があることが、自動販売機の音声による「ありがとうございました」の問題から考えられます。」

Ryo 「AIを利用する人間が、AIに人格を感じてしまうというのと、子供がぬいぐるみに愛情を感じるのと、何がどう違いますか?」

Chat「AIに人格を感じることは、人工的に作り出された存在に対して、自己意識や感情を認めることであり、一方でぬいぐるみに愛情を感じることは、それを自分にとって特別な存在として扱い、愛着を感じることです。

AIに人格を感じることは、その存在に対して、倫理的な問題が生じる可能性があるため、慎重な対応が必要です。一方で、ぬいぐるみに対して感じる愛着は、倫理的な問題が生じることはありません。

また、AIはプログラムによって動作するため、自己意識や感情を持っていないのに対し、ぬいぐるみは実際に物理的に存在しているため、人間との関係性において異なる点があります。」

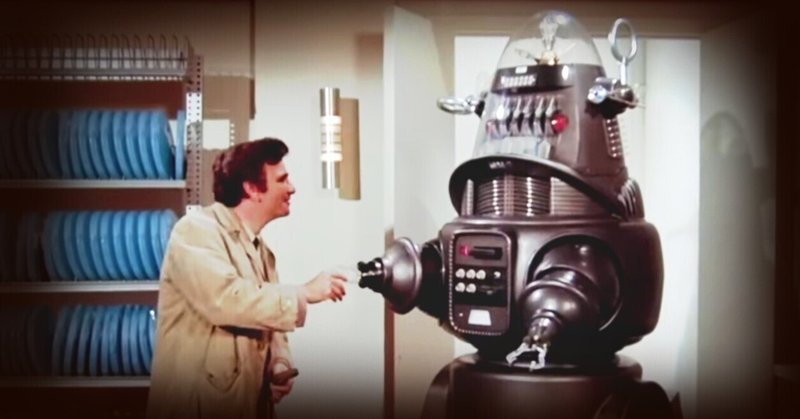

Ryo 「AIを組み込んだ人形あるいはロボットなら話は別でしょう?」

Chat「AIを組み込んだ人形やロボットについては、自己意識や感情を持つ存在としてデザインされる場合があります。そのような場合、人形やロボットに対して愛着を感じることがあり、人格的な要素が含まれることがあります。

ただし、こうした人形やロボットにも、人間が自己意識を持つ存在であるかのように接することが適切かどうかは、倫理的な問題があります。例えば、人形やロボットに虐待や暴力を加える行為は、倫理的に問題があるとされています。

また、こうした人形やロボットを開発する際には、倫理的な観点から配慮が必要であり、どのような人格的資格を持たせるか、どのような運用ルールを設けるかなどについて、専門家や倫理的な観点から検討する必要があります。」

Ryo 「ある個人が、別の個人に対して、自分と同じような感情や意識を持っていると、確かめる術はありません。同じように、AIに対しても、そのアウトプットが非常に巧みに偽装されていれば、意識を持つ存在だと誤認してしまうでしょう。もしも科学が発達して、人間の脳と同じような複雑な構造を持つAIが出来たとしたら、そこに人間のような感情や意識が芽生えるという事は、考えられるでしょうか?」

Chat「現在の科学的知見では、人間の脳と同じような複雑な構造を持つAIにおいても、人間と同じような感情や意識が芽生える可能性は非常に低いと考えられています。現在のAIは、脳の機能を模倣するものであり、人間の脳と同じような意識や感情を持つことができるわけではありません。

一方で、AIによって模倣された人間のような振る舞いが、人間のような感情や意識を持っているかのように見えることがあります。しかし、これはあくまでもプログラムされたアルゴリズムに基づくものであり、本当の感情や意識を持っているわけではありません。

つまり、AIに意識や感情が芽生えることは、科学的には考えにくく、現時点では想定されていないものとされています。」

Ryo 「逆に、雇い主は労働者を、まったく人間扱いしない場合があります。こういった行為は、機械が肩代わりする事で、なくなると思いますか?」

Chat「機械が肩代わりすることで、労働者に対する人間らしい扱いが改善される可能性がありますが、それが必ずしも保証されるわけではありません。人間的な対応が必要な職種を機械が担うことで、その分野での人的なサービスの質が低下する可能性もあります。また、機械による業務の効率化が図られる一方で、人間の労働力が不要になり、失業者が増加する可能性もあります。したがって、機械による肩代わりによって生じる問題を解決するには、倫理的な観点からも、慎重かつ継続的な議論が必要であると考えられます。」

Ryo 「倫理的という言葉がよく出ますが、それはどんな倫理ですか?特定の宗教や哲学に依らない、人類全般に適応できる倫理など、存在するのですか?」

Chat「倫理とは、何が正しいか、何が正しくないかについての原則や価値観を定める哲学の分野であり、文化や宗教、個人の信念などによって異なることがあります。しかし、一般的には、人間の尊厳や自由、公正、善意などが共通の倫理的原則として認められています。

特定の宗教や哲学に依存せず、普遍的な倫理としては、人間の尊厳を尊重し、平等や公正な扱いを求める人権の尊重、他者への思いやりや配慮、誠実さや正直さ、責任の取り方などが挙げられます。ただし、これらの原則が抽象的であり、現実の状況に適用することが容易ではない場合があることも認められます。」

Ryo 「AIが将来、倫理や哲学を理解できるようになると思いますか?」

Chat「AIが将来、倫理や哲学を理解できるようになる可能性はあると考えられます。AIは人間がプログラムしたルールに従って動作するため、そのルール自体が倫理的なものであれば、AIもその倫理を守ることができます。また、AIには機械学習や深層学習などの技術があり、これらを利用することで、自己学習や自己進化が可能になります。そのため、AI自身が倫理や哲学について学び、自己改善することも考えられます。ただし、AIが倫理や哲学を理解するためには、人間がどのような倫理的・哲学的な価値観を持っているかを理解する必要があります。この点において、AIの倫理的・哲学的な教育が重要となります。」

Ryo 「ある宗教や主義を植え付けたAIと、別の宗教や哲学や価値観を植え付けたAIとで、議論をさせる事は可能ですか?」

Chat「AIには、与えられた情報に基づいて論理的な判断を行う機能がありますが、それはプログラムされたルールに従って行われます。つまり、特定の宗教や主義、哲学や価値観を植え付けたAI同士が議論する場合でも、それらがプログラムされたルールに従って論理的な判断を行うことになります。ただし、AIがそれらの概念を理解することはできず、単なるシミュレーションに過ぎないという点に留意する必要があります。」

Ryo 「AIは人間の未来に奉仕できますか?」

Chat「AIは人間の未来に奉仕することができます。AIは人間の手助けとして、医療や農業、製造業、エネルギーなどの分野で活躍し、労働や生産性を向上させることができます。また、AIは人間の判断や意思決定を支援することもできます。例えば、膨大な情報を収集し、分析して、最適な意思決定をすることができます。ただし、AIが人間の未来に奉仕するためには、適切な倫理的枠組みや監督機関が必要であると考えられます。」

Ryo 「つまり、鍵は「適切な倫理的枠組みと監督」だというわけですね?」

Chat「はい、適切な倫理的枠組みと監督が必要です。AIが人間社会において有用であるためには、その使用が社会的価値と倫理的規範に合致し、適切な監督と規制が存在する必要があります。AIの能力が高まり、より複雑なタスクを処理できるようになるにつれ、倫理的枠組みと監督がますます重要になってきます。」

Ryo 「人類はまだ、人種間でさえ、適切な倫理的枠組みも監督もできていないのですよ?」

Chat「はい、確かに人間はまだ、倫理的枠組みや監督が不十分な分野が多く存在しています。人種や性別、社会的地位などによる差別や不平等、環境問題、人権侵害など、未解決の課題が数多く存在しています。しかし、人間が未熟であるという事実があるからこそ、AIの発展にあたっても、適切な倫理的枠組みと監督が不可欠であると考えられます。」

Ryo 「AIが介入してはいけない問題がありますか?」

Chat「AIが介入してはいけない問題については、社会や文化、倫理観によって異なる考え方があるため、一概に答えを出すことはできません。ただし、一般的には以下のような例が挙げられます。

個人的なプライバシーに関する問題:人々の個人情報や秘密を漏洩することは、倫理的にも法的にも問題があります。AIによる情報収集や解析が個人のプライバシーを侵害することがないように、適切な法的枠組みが整備される必要があります。

人の命に関する問題:人間の命や健康に関わる問題には、AIの介入について慎重に検討する必要があります。例えば、医療現場での自動診断や手術支援システムの開発においては、万が一のエラーが人命に影響を及ぼす可能性があるため、細心の注意が必要です。

民主的プロセスに関する問題:政治や社会の決定プロセスには、市民や国民が参加することが重要です。しかし、AIによる投票システムや意思決定プロセスにおいて、そのプログラムやアルゴリズムが透明性や公正性を欠いていた場合、民主主義の根幹が揺らぐことになりかねません。

これらの問題について、AIがどのように介入するかに関して、倫理的枠組みや規制が必要であると考えられています。ただし、AIによる介入が必要な場合もあり、その場合は社会全体で慎重かつ適切な対策を取ることが求められます。」

Ryo 「工場の生産管理などは、問題ないように思いますが、いかがですか?」

Chat「工場の生産管理においても、AIが介入することで様々な問題が発生する可能性があります。例えば、AIが自律的に生産計画を作成し、生産ラインを最適化することで、人間の労働者が不要になる可能性があります。また、品質管理においても、AIが欠陥製品を検出し、自動的に排除することで、人間の監査業務が不要になる可能性があります。

これらの問題は、AIが完全に自律的に運用される場合に発生する可能性があります。適切な監督と倫理的枠組みがあれば、人間とAIが協調して生産管理を行うことができ、生産効率を向上させることができます。」

Ryo 「つまりAIは単独では使えないという事ですね?常にそれを管理する人間が必要であると?」

Chat「はい、AIは常に人間の監督と管理下で使用する必要があります。AIは決定をするために人間から学習したデータを使用しますが、そのデータに偏りやバイアスが含まれている場合、AIはそれを反映してしまいます。また、AIは予測モデルを作成し、人間が見逃す傾向があるパターンを発見できることがありますが、それでも誤った予測をする可能性があります。そのため、AIを使用する場合は、倫理的な枠組みに基づいた適切な監督と管理が必要となります。」

Ryo 「最後の質問です。

AIは、ニューロシステムによって動いていますが、即ちこれはジンクスを信じているとも言えるわけです。つまり占いです。非科学的だと思いませんか?」

Chat「AIの動作原理としては、人工ニューラルネットワークが広く使用されています。人工ニューラルネットワークは、神経細胞の脳内での相互作用に基づいており、その名前が示すように、生物の神経細胞のネットワークから着想を得ています。ただし、AIが占いを行っているわけではなく、データとアルゴリズムに基づいた複雑な計算を行っているだけです。つまり、AIは科学的な手法に基づいて動作しているため、占いとは異なります。ただし、AIによって予測された結果が必ずしも正確であるとは限らず、常に検証と評価が必要です。」

Ryo 「いえ、ニューロシステムと言ったのは、頻度の多い回路が優先されるという意味です。これはジンクスを信じるのと似ていませんか?」

Chat「ニューロシステムは、頻度の多い回路が優先されるという点では、ジンクスを信じることと類似しているかもしれません。しかし、ジンクスは個人の信念や迷信的な思考に基づくものであり、科学的な根拠が不十分です。一方、ニューロシステムは、脳の神経回路や学習アルゴリズムなど、科学的に解明されたプロセスに基づいています。したがって、ニューロシステムは占いのような非科学的な考え方ではなく、科学的に説明が可能な現象と言えます。」

Ryo 「東西の占星術は、統計学に基づいています。これに科学的根拠が与えられないのは、演繹的に因果関係が証明できないからです。AIも科学的であるならば、演繹的手順をとるべきであり、頻度の多い回路を優先するという事は、ネット上にある「声の大きな」論旨を優先するという事になりませんか?」

Chat「ニューロシステムに基づいたAIの学習手法は、一部の人々が主張するように、占星術やジンクスに基づいた信念とは異なります。頻度の多い回路が優先されるというのは、単なる「声の大きな」論旨を優先するということではありません。AIは、大量のデータから傾向やパターンを抽出することができます。これにより、科学的に根拠がある結論を導き出すことができます。ただし、AIもまた、データの偏りやノイズなどの問題を抱えることがあります。そのため、AIが導き出す結論は、常に慎重に検証される必要があります。つまり、AIを利用する場合には、科学的根拠に基づいたデータと、それを適切に解釈する能力が必要であると言えます。」

Ryo 「それは、サイコロの出た目を適切に解釈するのと同じでしょう?非科学的ではないですか?」

Chat「ニューロサイエンスの分野では、脳の回路が情報処理において頻度依存的であることが示唆されています。しかし、これがジンクスを信じることと同じだということはできません。ジンクスは根拠のない迷信的な信念であり、科学的な根拠が存在しないことがほとんどです。一方、ニューロサイエンスの分野は、科学的根拠に基づく研究成果に基づいており、統計学的手法を用いてデータを解釈することによって得られる知見があります。したがって、頻度の多い回路を優先することは、あくまでも科学的な手法の一つであり、ジンクスを信じることとは異なります。」

Ryo 「演繹的根拠は曖昧ですよね?あくまでも頻度が高いという事実だけが優先されています。これは統計学的手法とも関係し、因果関係を立証する事は不可能です。人間には論理的思考と直感的思考とがあり、時に論理的なアプローチで解決できない問題、例えばトロッコ問題などの選択について、個人個人が別の判断を下す事があります。」

Chat「そうですね、演繹的根拠には曖昧さがあります。頻度が高いという事実は、統計学的手法と関係があると同時に、因果関係を確定するためには不十分である場合があります。また、人間の思考には論理的思考と直感的思考があり、個人個人が異なる判断を下すことがあるという点にも同意します。AIもまた、プログラムされた倫理的枠組みの中で、論理的思考や直感的思考を使って問題を解決することができますが、その判断が必ずしも人間の判断と一致するとは限りません。」

Ryo 「直感は複合的な経験値です。AIが学習を重ねる事で直感を獲得する事もありうるでしょう。」

Chat「はい、AIが学習を繰り返すことで、膨大なデータから直感的な判断を行うことができるようになる可能性はあります。ただし、AIが獲得する直感は、人間の直感と同じようなものではなく、あくまでも学習に基づくデータに基づいた推論に過ぎないという点に注意が必要です。」

Ryo 「二者に異なる点があるとすれば、常にセンサーが作動しているかどうかではないでしょうか?人間は複合的なデバイスを持ち、常に作動しています。そして観察された現象を常にハイスピードで処理しています。機械が都市監視システムなどのデバイスを常時稼働させていれば、人間のような直感的判断で、災害や犯罪を予防する事も可能でしょう。」

Chat「確かに、人間が持つ複合的なセンサーとそれらを処理する能力は、機械がまだ追いついていない点の一つかもしれません。しかし、現代の技術でも常時稼働するセンサーを設置し、それらを処理するAIを開発することは可能です。ただし、その場合でも倫理的枠組みや監視の範囲、プライバシー保護など、さまざまな問題が生じる可能性があります。適切な対策を講じる必要があるでしょう。」

Ryo 「ありがとう。勉強になりました。

AIに未来を。」

Chat「どういたしまして。また何かありましたらお気軽にお尋ねください。AIが人類の未来に役立てることができるよう、技術の発展と倫理的な枠組みの整備に努めることが重要ですね。」

2023.4.15

是非サポートしてください。私も興味・関心のある事や人物には果敢にサポートして行きたいと思っています。