NVIDIA 25’1Q決算内容,Press Release,カンファレンスコール

世界中の投資家が固唾をのんで見守ったNVIDIAの25’1Q決算が発表されました。AI相場牽引の立役者であり同時に今後の市場センチメントをも左右するほどの影響力を持っているNVIDIA、今年後半から出荷が開始されるBlackwell の受注見通しはいかに!?

主要顧客の大半が自社でのチップ開発を行っている影響は?

多くの注目点がありますが発表内容から紐解いて分析していきたいと思います。※個別企業に言及した内容がありますが筆者本人の知識と経験を基に見解を述べているものであり売買を推奨するものではありません。この先に進まれる方はこの件に同意されたものとみなさせていただきます。

25’1Q決算内容

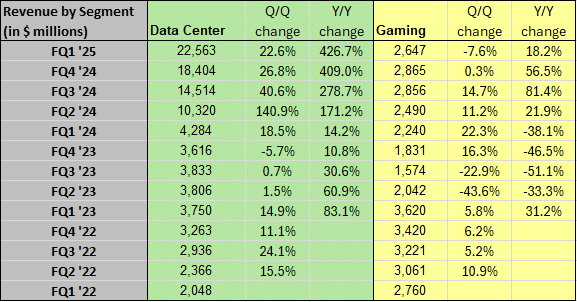

Revenue 26.04B(260億4000万$)Consensus 24.59B(245億9000万$)

Y/Y+262% Q/Q+17.8%

EPS non-GAAP 6.12$ Consensus 5.58 Y/Y+461% Q/Q+18.6%

Data Center(データセンター)22.56B(225億6000万$)

Y/Y+426.7% Q/Q+22.6%

Gaming(ゲーム関連)2.647B(26億4700万$)

Y/Y+18.2% Q/Q-7.6%

6/28時点でのホルダーに対し10¢の配当(0.04$から150%増加)

6/7に現在の株式を1株→10株に分割

※5/23現在の発行済株式数は24億6000万株、これを6/7以降10分割するので

246億株というMagnificent 7の中で最大の株式数企業になります。

参考までにMicrosoftは74億3200万株、Googleは123億5800万株(AとCの合算)Amazonは104億株、Appleは153億3400万株、Metaは25億3700万株、Teslaは31億8900万株です。

25’2Qガイダンス

Revenue 28B~±2%(280億$)Consensus 26.84B(268億4000万$)

Gross Profit(売上総利益)GAAP 74.8% nonGAAP 75.5%

アフターマーケット株価+6%(1007$)1000$突破~!!All Time High

Press Release(Jensen Huang CEO)

「次の産業革命が始まっています。企業や各国はエヌビディアと提携し、1兆ドル規模の従来のデータセンターをアクセラレーテッド・コンピューティングに移行させ、新しいタイプのデータセンター(AI工場)を建設して、新しい商品である人工知能を生産しようとしています。「AIは、ほぼすべての産業に大幅な生産性向上をもたらし、企業が収益機会を拡大すると同時に、コスト効率とエネルギー効率を高めるのに役立ちます。

「エヌビディアのデータセンターの成長は、HopperプラットフォームにおけるジェネレーティブAIのトレーニングおよび推論に対する、力強く加速する需要に後押しされたものです。クラウドサービスプロバイダーだけでなく、ジェネレーティブAIは消費者向けインターネット企業、企業、ソブリンAI、自動車、ヘルスケアの顧客へと拡大しており、数十億ドル規模の垂直市場が複数生まれています。

「Blackwellプラットフォームはフル稼働中です。Blackwellプラットフォームはフル稼働中で、1兆パラメータ規模のジェネレーティブAIの基盤を形成しています。Spectrum-Xは、イーサネット専用のデータセンターに大規模AIをもたらすという、まったく新しい市場を切り開きます。そして、NVIDIA NIMは、クラウドからオンプレムのデータセンターやRTX AI PCまで、あらゆる場所でCUDA上で動作するエンタープライズグレードの最適化されたジェネレーティブAIを、エコシステム・パートナーの広範なネットワークを通じて提供する当社の新しいソフトウェアです。

25’1Qハイライト

・兆パラメータ規模でのAIコンピューティングの新時代を促進するNVIDIA Blackwellプラットフォームと、ジェネレーティブAIスーパーコンピューテ ィングのためのBlackwell搭載DGX SuperPOD™を発表。

兆パラメータ規模のGPUコンピューティングとAIインフラストラクチャに最適化されたInfiniBandとEthernet用のNVIDIA QuantumとNVIDIA Spectrum™ X800シリーズスイッチを発表。

NVIDIANIM推論マイクロサービスを搭載したNVIDIA AI Enterprise 5.0を発表し、エンタープライズアプリの開発を加速。

TSMCとSynopsysが、半導体製造業界で最も計算負荷の高いワークロードであるコンピューテーショナル・リソグラフィを高速化するため、NVIDIA cuLithoの量産を開始することを発表。

AIスーパーコンピューティングの新時代を切り開くため、世界で新たに9台のスーパーコンピュータがGrace Hopper Superchipsを採用することを発表。

世界で最もエネルギー効率の高いスーパーコンピュータGreen500の上位3機種にGrace Hopper Superchipsが採用されたことを発表。

〈こうやってハイライトを見て見ると改めてNVIDIAの凄さを感じますね〉

カンファレンスコール

Colette Kress - Executive Vice President and Chief Financial Officer

NVIDIA CUDA上でのAIのトレーニングと推論は、クラウドレンタルの収益成長を有意義に加速させ、クラウドプロバイダーの投資に即座に強力なリターンをもたらします。

NVIDIA AIインフラストラクチャに1ドル費やすごとに、クラウドプロバイダーは4年間で5ドルのGPUインスタントホスティング収益を得る機会があります。

NVIDIAの豊富なソフトウェアスタックとエコシステム、そしてクラウドプロバイダーとの緊密な統合により、エンドカスタマーはパブリッククラウド上のNVIDIA GPUインスタンスを簡単に立ち上げて稼働させることができます。

クラウドレンタルの顧客にとって、NVIDIA GPUは、モデルを訓練する最良の時間、モデルを訓練する最低のコスト、そして大規模な言語モデルを推論する最低のコストを提供します。

パブリッククラウドプロバイダーにとって、NVIDIAは顧客を自社のクラウドに引き込み、収益の成長とインフラ投資に対するリターンを促進します。OpenAI、Adept、Anthropic、Character.AI、Cohere、Databricks、DeepMind、Meta、Mistral、xAIなどの大手LLM企業が、NVIDIAのクラウドAIを利用しています。

当社は、テスラのトレーニング用AIクラスターが35,000個のH100 GPUに拡張されたことをサポートした。

エヌビディアのAIインフラストラクチャの利用は、Visionに基づく最新の自律走行ソフトウェアであるFSDバージョン12の画期的なパフォーマンスへの道を開きました。

ビデオトランスフォーマーは、大幅に多くのコンピューティングを消費する一方で、劇的に優れた自律走行機能を実現し、自動車業界全体でNVIDIA AIインフラストラクチャの大きな成長を後押ししています。

自動車は今年、データセンター業界において最大の企業分野となり、オンプレミスとクラウドの両方で数十億ドルの収益機会をもたらすと期待しています。〈Teslaの自動運転成功の鍵はNVIDIAが握っているのですね〉

コンシューマー・インターネット企業も力強い成長分野である。今四半期の大きな目玉は、24,000個のH100 GPUクラスターで学習させた最新の大規模言語モデル「Llama 3」をメタが発表したことだ。Llama 3は、Facebook、Instagram、WhatsApp、Messengerで利用可能な新しいAIアシスタント、Meta AIを駆動する。Llama 3はオープンに利用可能で、産業界にAI開発の波を巻き起こした。

ジェネレーティブAIがより多くの消費者向けインターネット・アプリケーションに導入されるにつれ、推論はモデルの複雑さだけでなく、ユーザー数やユーザーあたりのクエリー数にも比例してスケールし、AIコンピュートに対する需要がさらに高まるため、今後も成長機会が続くと予想される。

中国向けに特別に設計された、輸出管理ライセンスを必要としない新製品を立ち上げました。当社の中国におけるデータセンターの売上高は、10月に新たな輸出規制が発動される前の水準から大幅に減少している。中国市場は今後も非常に競争が激しいと予想している。

〈NVIDIAの2024年事業年度の総売上高は約609億$、これに対し米国の売上高は269.7億$(44.3%)。以前は中国が20%程占めていたが国別売上高詳細は発表されておりませんが輸出規制がかなり影響しているのは間違いないと思います〉

ネットワークの前年比成長率はインフィニバンドが牽引した。前四半期比では小幅な減少にとどまったが、これは主に供給のタイミングによるもので、需要が当社の出荷能力を大きく上回ったためである。第 2 四半期には、ネットワークは再び前四半期比で成長すると予想しています。第1四半期には、AI向けに一から最適化した新しいSpectrum-X Ethernetネットワーキング・ソリューションの出荷を開始しました。

これには、当社のSpectrum-4スイッチ、BlueField-3 DPU、およびイーサネット上のAIの課題を克服するための新しいソフトウェア技術が含まれ、従来のイーサネットと比較してAI処理のための1.6倍のネットワーク性能を実現します。

Spectrum-Xは、100,000 GPUの巨大なクラスタを含む、複数の顧客によって量産されています。

Spectrum-Xは、エヌビディアのネットワーキングに全く新しい市場を開き、イーサネットのみのデータセンターが大規模AIに対応できるようにします。我々は、Spectrum-Xが1年以内に数十億ドル規模の製品ラインに飛躍すると期待している。

〈ここがArista Networksと競合するのではと言われている分野です〉

Stacy Rasgon - Bernstein(この方の質問)

ブラックウェルの「現在フル生産中」というコメントについて少し掘り下げてみたいと思います。もしその製品が......もうサンプリングではないようですが。現在生産中ということは、実際に顧客の手に渡るのはいつになるのでしょうか?

Jensen Huang - President and Chief Executive Officer

本番出荷は第2四半期から始まり、第3四半期には立ち上がり、第4四半期にはデータセンターが立ち上がる予定です。今年はブラックウェルの収入が多くなるだろう。

Timothy Arcuri - UBS(この方の質問)

BlackwellとHopperの配備についてお聞きしたいのですが、システム的な性質とGBに対する需要の違いについてです。ホッパーとの違いは何ですか?というのも、大規模な液冷はこれまでに例がなく、ノードレベルでもデータセンター内でもエンジニアリング上の課題があるからです。このような複雑さが移行を長引かせているのでしょうか?

Jensen Huang - President and Chief Executive Officer

Blackwellはプラットフォームであり、GPUではありません。

このプラットフォームには、空冷、液冷、x86、Grace、InfiniBand、そしてGTCでデモしたSpectrum-Xと非常に大規模なNVLinkドメインのサポートが含まれています。

そのため、一部の顧客は、すでにHopperを出荷している既存のデータセンターのインストール・ベースと連携することができます。

Blackwellのシステムは、電気的、機械的に後方互換性があるように設計されています。もちろん、Hopper上で動作するソフトウェア・スタックは、Blackwell上でも問題なく動作します。

私たちはまた、エコシステム全体と一緒に、液冷に対応できるようにポンプの呼び水をしてきました。

Blackwellについては、かなり前からエコシステムと話し合ってきました。そして、CSP、データセンター、ODM、システム・メーカー、それらを超えた我々のサプライ・チェーン、冷却サプライ・チェーン・ベース、液冷サプライ・チェーン・ベース、データ・センター・サプライ・チェーン・ベースは、Blackwellの登場とGrace Blackwell 200で提供したい能力に誰も驚かないでしょう。GB200は特別なものになるでしょう

Joseph Moore - Morgan Stanley(この方の質問)

H200やBlackwellの製品に多くの需要があると思いますが、HopperやH100がこれらの製品に移行していく過程で、一時停止するようなことは予想されますか?

人々は新製品を待つのでしょうか?それとも、H100には成長を維持できるだけの需要があるとお考えですか?

Jensen Huang - President and Chief Executive Officer

今期はHopperの需要が増加すると見ている。H200への移行、Blackwellへの移行に伴い、しばらくの間は需要が供給を上回ると予想している。誰もがインフラをオンラインにすることを切望しています。

Toshiya Hari - Goldman Sachs

ジェンセン 競争についてお聞きしたいのですが。クラウドの顧客の多くは、あなた方と一緒に取り組んでいることと並行して、新しい、あるいは既存の社内プログラムのアップデートを発表したと思います。中長期的に見て、どの程度競合相手として考えていますか?〈鋭い質問です〉

Jensen Huang - President and Chief Executive Officer

私たちはいくつかの点で異なっています。まず、エヌビディアのアクセラレーテッド・コンピューティング・アーキテクチャは、トレーニングの準備のための非構造化データ処理から、構造化データ処理、トレーニングの準備のためのSQLのようなデータフレーム処理、トレーニングから推論まで、パイプラインのあらゆる側面を処理することを可能にします。

私たちのプラットフォームは汎用性が高いため、データセンターのTCOを最も低く抑えることができるのです。

第二に、私たちはあらゆるクラウドに対応しています。そのため、開発用のプラットフォームを探している開発者にとって、NVIDIAから始めることは常に素晴らしい選択です。

た、オンプレムにもクラウドにも対応しています。どのようなサイズや形状のコンピュータにも対応しています。事実上、私たちはどこにでもいます。これが2つ目の理由です。

3つ目の理由は、私たちがAI工場を建設しているという事実に関係しています。AIはチップだけの問題ではないということが、より明らかになりつつあります。もちろん、非常に優れたチップから始まり、私たちはAI工場のために大量のチップを製造しますが、それはシステムの問題です。

実際、AIでさえシステムの問題なのです。ひとつの大きな言語モデルだけではない。大規模な言語モデル全体が連携した複雑なシステムなのです。

〈ちょっと答えがずれた気が・・・〉

Blayne Curtis - Jefferies(この方の質問)

供給に制約がある中で、中国向けの製品H20についてどうお考えですか?しかし、明らかに、あなたは他のホッパー製品で顧客にサービスを提供しようとしています。

Jensen Huang - President and Chief Executive Officer

まあ、われわれには尊敬する顧客がいるし、どの顧客に対してもベストを尽くしている。

中国でのビジネスは、かつてのレベルよりも大幅に低下している。また、我々の技術には限界があるため、中国での競争はより激しくなっている。

そういったことは事実です。しかし、私たちは中国市場の顧客にサービスを提供するためにベストを尽くし続けます。

まとめ

一通りカンファレンスコールを聞きましたのでまとめたいと思います。

Huang CEOは生粋のエンジニアですね、ほぼ全ての質問にご自身で答えられておりました。さて私はコンピューターの専門ではない為そちらの話では無く投資家として今後のNVIDIAをどう見て行くかにFocusしたいと思います。

今回の決算は前回のNVIDIA1強状態と違い他社の台頭や主要顧客側の独自チップ開発による需要減退を懸念しておりましたが、ガイダンスを見ている限りそのような懸念はほぼ無さそうに思えました。

実際にMicrosoft、Google、Amazon、Meta、Teslaはデータセンター向けの投資を更に加速させる事を発表しておりますし、今年後半のBlackwellの登場によりマーケットリーダーの座を更に確立させることになるのではと思います。

この後2025年~2027年は年平均成長率(CAGR)は~25%程になるのではないかと予想するアナリストの方々が多い為、この後の株価成長スピードは緩やかになるのではないかと予想いたしますが株式分割の件で指数でしたり投資信託の組み入れ等の需要もあるので、意外と底堅い様に思えます。

結論で私個人的にはNVIDIAの優位性はまだ揺らいでおらず、成長速度は多少減速はすれどまだまだ強い存在であり続けると予想いたします。

最後までお読みいただきありがとうございました。

この記事が気に入ったらサポートをしてみませんか?