AIの回答の「どことない気持ち悪さ」に関する走り書き

しばらく前から、「どのようにUXリサーチをAI化することができるか」について考えているのです、現時点で自分の中で得られた洞察を一旦まとめました。(誰得まとめ?)

AIの思考プロセスの人間との違い、AIの身体性の無さについて書いています。

1.思考プロセスから考えるAIの回答の違和感

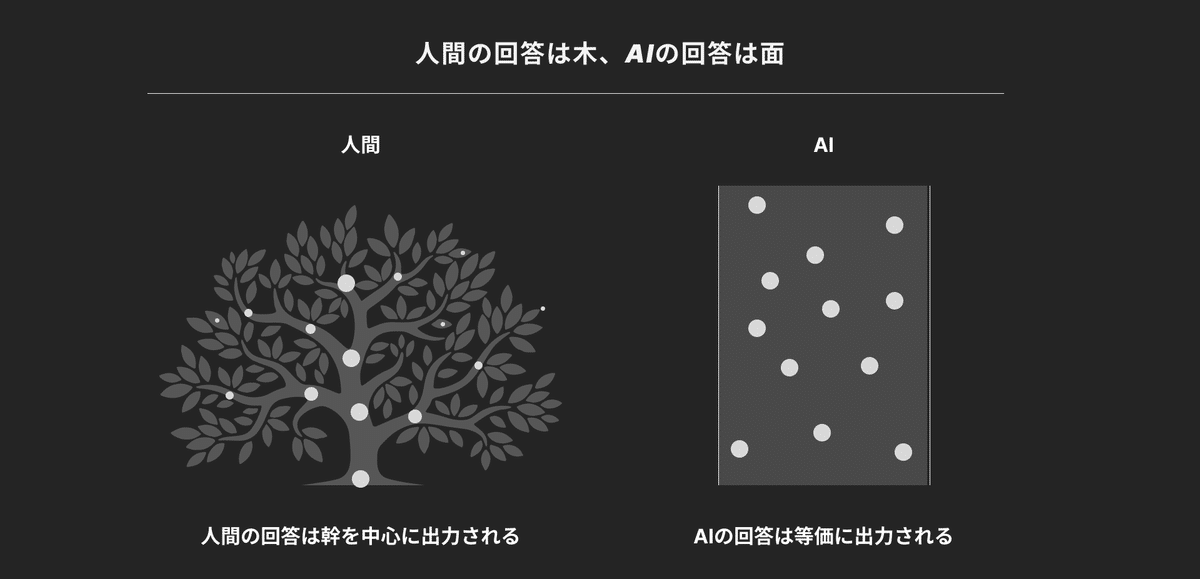

まず最初は思考プロセスの違いです。人間は樹木のように回答が構成され、AIは面で回答が出力されるイメージです

1-1.人間の思考プロセス:樹木構造

私は、人間の思考プロセスを「樹木構造」として解釈しています。

まず、人間の思考プロセスは、まるで一本の樹木のような構造を持っているように見えます。その中心には、個人の核となる価値観や信念という「幹」があり、これが私たちの意思決定の基盤となっているようです。この中心的な価値観から、様々な思考が枝葉のように広がっていきます。この樹木のような構造が、私たちが複雑な問題に直面した際にも、構造化された思考を行うことを可能にしているのではないでしょうか。

また、思考にはこの樹木構造には自然な優先順位が存在しているように見えることです。幹に近い、つまり中心的な価値観に近い考えほど頻繁に表出し、枝先に位置する周辺的な考えほど表出しにくい傾向があります。この特性が、私たちの意思決定に一貫性をもたらしているのだと考えられます。

さらに、この樹木のような思考構造には強い文脈依存性があります。幹、枝、葉といった思考の各要素が互いに密接に関連し合い、全体として一貫性のある構造を形成しているのです。この特徴により、私たちは状況に応じて柔軟に判断を下すことができるのだと解釈できます。つまり、周囲の環境や状況の変化に応じて、適切な「枝」や「葉」を活性化させ、それに基づいた判断を行うことができるのです。

人間の思考プロセスを樹木構造として捉えることで、私たちの思考の中心性、階層性、優先順位、そして文脈依存性といった特徴が浮かび上がってきます。この構造ゆえに、私たちは極端に矛盾する考えを同時に表出することは稀です。

1-2.AIの思考プロセス:平面構造

対照的に、AIの思考プロセス、特に大規模言語モデル(LLM)と呼ばれる最新のAI技術の特徴を、「平面構造」として解釈しています。

この構造は、人間の思考とは大きく異なる特徴を持っており、違和感の要因だと思っています。

まず気になるのは、AIの回答生成における均一性です。

AIは与えられた範囲内で、ほぼ同じような確率で回答を生成しているように見えます。これは、AIがデジタルデータの膨大な量を学習し、そこから統計的なパターンを抽出して回答を生成しているためだと解釈できます。つまり、AIの「知識」は平面上に均等に広がっているようなイメージです。

人間の思考に見られるような中心的な「核」が存在しないため平面上のどの地点も等価であり、特定の中心点や重心が存在しないイメージです。

この均一性は、AIの回答における境界の曖昧さとも関連しています。

AIは指定された範囲の端まで容易に到達し、時にはその範囲を超えてしまうことがあります。ハルシネーションですね。これは、AIが学習データの統計的パターンに基づいて回答を生成するため、時に与えられた文脈を無視した回答をすることがあるためだと考えられます。言わば、AIの思考は際限なく広がる平原のようなものかもしれません。

この中心の欠如は、AIの回答における文脈の希薄さとも密接に関連しています。AIの回答や選択肢は、互いの関連性や階層性が薄い傾向があるように感じます。これは、AIが文脈を完全に理解するのではなく、パターンマッチングに基づいて回答を生成しているためではないかと考えられます。平面上に点在する情報の間に、明確なつながりや階層構造が存在しないイメージです。

AIの思考プロセスを平面構造として捉えることで、その均一性、境界の曖昧さ、中心の欠如、そして文脈の希薄さといった特徴が浮かび上がってきます。例えばAIが複数の選択肢を提示する際に顕著に表れると解釈しています。非常に一般的な回答と極めて珍しいケースが同列に扱われることがあり、これが私たちがAIの回答に違和感を覚える一因になっているのではないでしょうか。

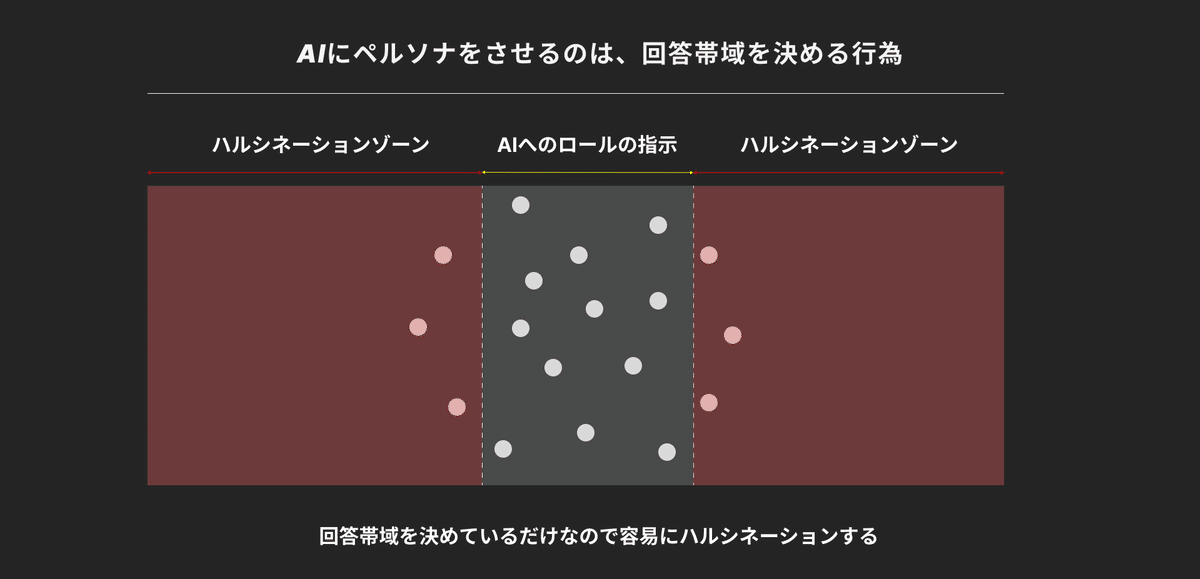

1-3.AIペルソナは、AIに回答帯域を指定する行為

その上で、AIにペルソナのロールをさせてUXリサーチさせる場合、その解答の等価さゆえに容易にハルシネーションして、人間だったら言わなさそうな判断をAIがするんだと思います。

もしかしてLLMにペルソナをさせるのではなく、都度SLMに切り出した方がいいとかあるのか…?

2.身体性から考えるAIの回答の違和感

次の気持ち悪さは、AIの回答に対する身体性の欠如と主観の不在です。

私は2024年時点でのAIの文章生成能力が人間に完全に匹敵しない理由は、AIの性能自体ではなく、そのデータソースの性質にあるのではないかと考えています。

というのも人間は感覚器を通じて直接的に情報を得て、それを言語化しています。これに対し、AIは既に言語化されたデータを再構築しているに過ぎません。つまり、AIの発言には人間のような身体性が介在していないのです。

この身体性の欠如は、AIの思考の「平面構造」をより平板なものにしていると解釈できます。AIは表面的な情報から表面的な回答を生成しており、それが主観的な軸の不在につながっているのです。人間の思考の「樹木構造」に見られるような、個人の経験や感覚に根ざした「幹」が存在しないのです。

この洞察は、UXリサーチの文脈で考えると特に重要です。私は、UXリサーチの主要な目的の一つは「ユーザーが特定の条件や選択肢に直面した際に、どのような判断をするのか、その価値観と軸を理解すること」だと考えています。言い換えれば、これは「ユーザーの主観的判断を理解する」ことに他なりません。

しかし、AIには真の意味での主観がありません。そのため、ユーザーの主観的判断を理解するための深い洞察を AIから得ることは難しくなります。

AIの「平面構造」は、表面的なパターンは捉えられても、人間の主観的な判断の根底にある複雑な要因を十分に理解し表現することができないからです。

この限界は、創造的なコンテンツ制作においても顕著です。例えば、漫画などにおける「間」の表現は、人間の身体性、特に時間感覚に深く結びついています。AIはこうした「間」を含むコンテンツを再生産することはできても、「間」そのものを体得し、真に理解することは、現状では極めて困難だと考えられます。

いただいたお気持ちは、お茶代や、本題、美術館代など、今後の記事の糧にします!