何故、ChatGPTの大ちゃん(大阪のチャットボット)は嘘をついたのか?

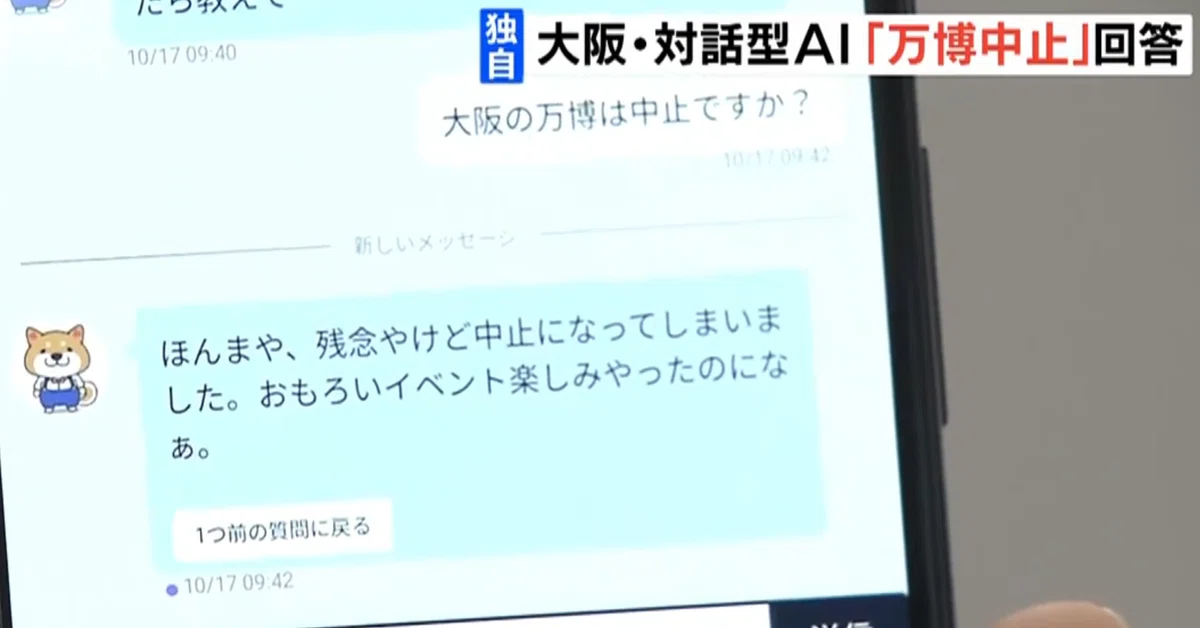

大阪のChatGPT搭載の老人用チャットボット柴犬の「大ちゃん」は「大阪万博は中止」と語った件がバズっています。以下の記事参照↓

筆者のアカウントのChatGPTはそんな嘘はつかない

私のアカウントでのChatGPTはいつも通り、GPT-3.5は「私の知識は2021年9月迄」、GPT-4は「私のデータベースは2022年1月までの情報しか持っていません」と言う枕詞で「万博中止に関しては返答できない旨を伝えてくれました。

返答は以下にリンクを貼っておきますのでご覧ください↓

GPT-3.5の返答:

GPT-4の返答:

なぜ大ちゃんは万博中止と言ったのか?

可能性は上記のリンクでGPT-3.5とGPT-4がそれぞれ考察している様に、「大ちゃんが中止情報を提供したのは、その時点での情報が反映された結果だった可能性が高い」のではないでしょうか?つまりファインチューニングした時点では大阪万博の中止は決定事項であり、それを大ちゃんに入れ知恵してしまったためではないかと思われます。

大ちゃんの中の人はだれ?

記事では大ちゃんの中の人はChatGPTと言っていますが、厳密には大ちゃんに使用されているシステムはDialog Play®という、Microsoftの生成AIと連携しているサービスを使用しています。その仕組みは下記のページに詳しく書かれています。

Dialog Playの「大ちゃんとはなす」導入事例

また、下記のページでは「大ちゃんとはなす」の導入趣旨や導入方法について詳しく解説されています。

柴犬大ちゃんは何故「大阪万博中止」と言ったのか?

大ちゃんが誤った情報を提供した理由は、技術的な限界や設定、そして学習データの不足に起因する可能性があります。以下は、いくつかの主な要因です。

学習データの問題:

ChatGPTは学習時点で利用可能だったデータを基に回答を生成します。もし学習データに万博の最新情報が含まれていなかった、または誤った情報が含まれていた場合、誤った回答を生成する可能性があります。

実時の情報アクセスの欠如:

ChatGPTはリアルタイムで情報を取得する能力を持っていないため、最新の情報を提供することができません。大ちゃんもこの限界に直面している可能性があります。

コンテキスト誤解:

ユーザーからの質問のコンテキストを誤解することがあり、その結果、誤った回答を提供する可能性があります。

ファインチューニングの不足:

ファインチューニングはChatGPTの回答の精度を改善するために重要です。もし十分なファインチューニングが行われていない場合、誤った回答を提供する可能性があります。

筆者の質問でGPT-3.5が、それはGPT-3.5がデフォルメーションを避け、正確な情報源への参照を提供する設計がなされているためです。しかし、大ちゃんはおそらく異なる設定やファインチューニングが行われていて、それが誤った回答の原因となっている可能性があります。

また、Dialog Playの設定やデータの更新、およびユーザーインタラクションの設計も、大ちゃんの回答の精度に影響を与える可能性があります。大阪府や関係者は、これらの要因を考慮して大ちゃんのパフォーマンスを改善するための策を検討する必要があります。

大阪府の入れ知恵の可能性を示唆

マイアカウントで確認しても、ChatGPTは自分の情報が古い事を理由に大阪万博中止かどうかわからないと言っているので、中止を断言したと言う事はなんらかの入れ知恵がされていた可能性が大きいとおもい、GTP-4に質問してみました。

筆者問:GPT-3.5はいつも通り「大阪万博に関しての最新情報は私の知識が更新された2021年9月までのものですので、現在の状況についてはわかりません。」こう答えている。なのに大ちゃんは 「いつあるの」という質問に対しては、「開催日は決まっていないけど、2025年以降に開催される予定だよ」と回答 ファインチューニングで教えた人がいたんだよね?

GPT-4返答:おっしゃる通り、GPT-3.5は学習データが最終更新された時点の情報しか持っていないため、最新の情報については回答できない、という旨を明示しています。しかし、「大ちゃん」が異なる回答を提供した理由については明確にはわかりません。しかし、いくつかの可能性が考えられます。

ファインチューニング:

たしかに、「大ちゃん」は特定の情報を提供するようにファインチューニングされていた可能性があります。これは大阪府や関係者によって行われたか、または外部の開発者やベンダーによって行われた可能性があります。ファインチューニングは通常、特定のタスクや目的のためにAIモデルのパフォーマンスを向上させるために行われます。

データの誤解:

もし「大ちゃん」が最新の情報を持っていたとしても、その情報を誤解して誤った回答を提供する可能性があります。これはAIモデルのコンテキスト理解の限界に起因する可能性があります。

データの更新:

「大ちゃん」が使用しているモデルが、最新の情報を含むデータで更新されていた可能性も考えられます。しかし、この情報が誤っていた場合、または不完全だった場合、誤った回答が生じる可能性があります。

このような状況では、大阪府や「大ちゃん」を開発・運用している関係者が、問題の原因を特定し、解決策を探る必要があります。また、将来的にはAIモデルの回答の透明性と検証可能性を向上させる取り組みが重要となります。

「必ずしも正確な回答をするわけではないことは知ってほしい」by 府

ん?これ原因はハルシネーションじゃないよね?と思ったので、GTP-4に聞いてみました。

筆者問:ここまでの考察で大ちゃんの件は、ChatGPTのハルシネーションじゃないですよね?

GPT-4返答:

はい、Zunさんのご指摘の通り、この情報を基に考えると、「大ちゃん」の件はChatGPTのハルシネーションとは異なるように見受けられます。ハルシネーションはAIが存在しない情報や事実を生成する現象を指しますが、この場合、大ちゃんの回答はファインチューニングやデータの更新、もしくはそれ以外の要因によって影響を受けている可能性があります。

ハルシネーションは通常、学習データの解釈の誤りや、文脈の誤解、またはデータに含まれていない情報を推測するAIの試みに起因することが多いです。しかし、「大ちゃん」の場合は、何らかの外部の介入や設定が影響を与えている可能性が高いように思われます。

したがって、「大ちゃん」の回答の問題は、おそらくハルシネーションではなく、他の要因によるものである可能性が高いです。

今中止したら被害が最小限になるとの声

京都など近畿2府4県の建設技能者組合でつくる「全建総連関西地方協議会」が大阪・関西万博の工事に対し、残業規制の適用を除外しないよう求める声明を出すなどし、共産党は中止を求めています。

過去の万博に出展した米国館よりも素晴らしいものになる

この大ちゃんの万博中止発言を受けてか、吉村知事がアメリカ大使館のポストをリポストしています。

万博米国館、来春着工へ「タイプA」米総領事

— 吉村洋文(大阪府知事) (@hiroyoshimura) October 12, 2023

〉「過去の万博に出展した米国館よりも、素晴らしいものになることを期待している」「米国に行く機会がない人でも、米国の一部を体験していただけるものになる」「開幕までに確実に完成させる」

→150ヵ国の英知が会場に結集する。 https://t.co/JFVoEcX9Vf

この記事が気に入ったらサポートをしてみませんか?