最近の記事

再生

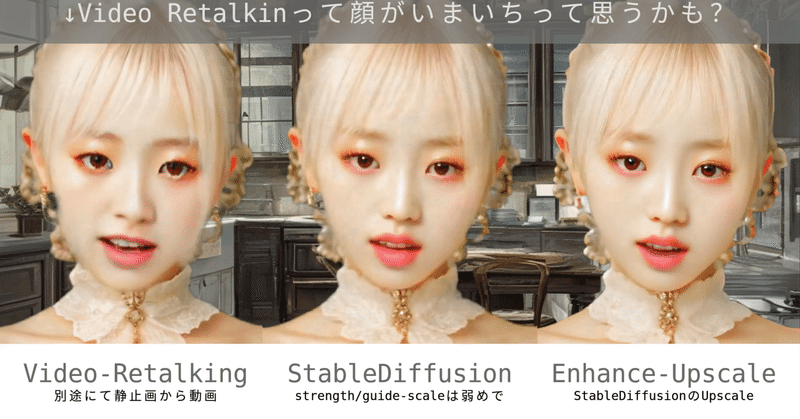

再生Stable Diffusion ガールとレディー・ウーマンのタグの結果を比較

Beautiful Girl/Lady/Womenのどれがいいかな? 違いが気にならなければ、気にしなくていい。 もちろん、GirlでもSeedによっては、面長になることもあるので、ややなりやすいという風に思うこことする。 結論は、シードとは違った結果になりやすいので、すべて試すのがいい。 印象としては ガールは、口半開きなりやすい。逆三角形の口とか あと、顔が丸い赤ちゃん顔になる。 いくらシード変えても、子供顔になるなら、タグを変えたほうがいい。 ウーマンは逆に、面長になりやすい。 顔長すぎが、続くなら、タグを変えると良い レディーは、そこそこバランス取れてる気がする。 以下モデルを使用しました。 https://huggingface.co/sazyou-roukaku/BracingEvoMix