AIデータのリスクマネジメントはなぜ重要?背景や具体的なフレームワークについて

AIデータの利用はビジネスに革新をもたらす一方で、さまざまなリスクが存在します。特にAIデータは特有のリスクを持っているため、リスクマネジメントの重要性は高いといえるでしょう。

AIデータのリスクに関しては、「AIデータのリスクとは何か?AIデータの基礎知識」をご覧ください。

本記事では、リスクマネジメントの基本知識からAIデータを取り巻く状況、具体的なフレームワークまで紹介します。

本記事の内容は、AIデータの適切な管理方法を学び、組織内でのAI活用をより安全かつ効果的に進める手助けになります。

AIデータの扱いに困っていたり、これからAIを導入しようと考えていたりする方は、ぜひ最後までご覧ください。

そもそもリスクマネジメントとは? 4つの基本

リスクマネジメントは、組織が直面するリスクを特定、評価、および管理するプロセスです。これにより組織は目標達成や資源の効果的な利用、法律と規制の遵守などを通して、リスクを最小限に抑えられます。

意思決定の際に、無意識にリスクマネジメントを行っている場合もあります。ただ、管理するデータの増加に伴い、近年は積極的なリスクマネジメントが求められているのです。

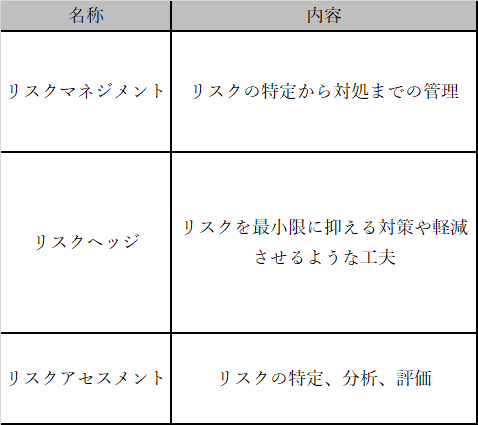

ちなみに、リスクマネジメントと似た言葉で、「リスクヘッジ」と「リスクアセスメント」がありますが、これらには違いがあります。それぞれの違いは以下のとおりです。

リスクヘッジは具体的な対策や工夫を指し、リスクアセスメントはリスクの特定から評価までで、実際の対処は含まれていません。

そのため、リスクを特定して実際に対処するリスクマネジメントが求められているのです。

リスクマネジメントの基本は、以下の4つとなっています。

リスクの回避

リスクの適正化

リスクの共有

リスクの保有

AIデータのリスクマネジメントにも共通する内容ですので、一つずつ見ていきましょう。

リスクの回避

リスクの回避は、遭遇する可能性のあるリスクを予測し、それらを「回避して未然に防ぐ」プロセスです。そもそもリスクに遭遇しないようにすることで、法律や規制の遵守、財務損失の防止、企業の評判の保護などに貢献します。

具体的な例としては、以下のような対応が挙げられます。

ヒューマンエラーによる情報漏えいに備えて、データはクラウド上で暗号化した状態で扱う

サイバー攻撃に備えて、セキュリティソフトを導入したり社員研修を行ったりする

特にAIにはさまざまなリスクが存在し、その中にはAI特有のものもあります。リスクマネジメントを行う際は、まずリスクを回避できないかを考えることが重要です。

リスクの適正化

リスクの適正化は、企業が遭遇する可能性のあるリスクを評価し、「受け入れ可能なレベルに管理する」プロセスです。

これはリスクを完全に排除するのではなく、リスクを理解し、適切にコントロールしてリスクを受容可能なレベルに保つことを目的としています。

具体的な例としては、以下のような対応が挙げられます。

データをすべてクラウド上で扱うとサーバーダウン時にデータを失うリスクがあるが、バックアップを取っておき最悪の場合でも対応できる状態にしておく

新ジャンルの事業で成功するか分からないが、万が一失敗しても企業の存続には影響しない程度の投資にとどめる

リスクの中には完全に排除しきれないものもあります。ただ、リスクはすべて悪ではなく、リスクがあるからこそ大きな成功が待っているといえます。

リスクはすべて排除するのではなく、適正化しておくのも重要なのです。

リスクの共有

リスクの共有は、企業が遭遇する可能性のあるリスクを「関係者や他の組織と共有する」プロセスを指します。これは、リスクの認識と理解を促進し、共同でリスク対策を講じることを可能にする重要なステップです。

具体的な例としては、以下のような対応が挙げられます。

保険に入り、万が一損失があったときに補填してもらう

自社では十分にセキュリティ対策ができないため、他社に委託する

リスクの共有では、すべてのリスクを他者に移すことはできません。しかし、共有することで、リスクに遭遇したときの損失を軽減できます。

自社でリスクの回避、リスクの適正化が難しいときには、リスクの共有も考えるといいでしょう。

リスクの保有

リスクの保有は、企業が「特定のリスクを受け入れて責任を負う」プロセスを指します。一部のリスクは避けられないため、企業はこれらのリスクを認識し、保有するのも一つの手です。

具体的な例としては、以下のような対応が挙げられます。

地震が来てオフィスが崩壊する可能性があるが、そのリスクを受け入れて今の場所で活動する

新システムで業務効率化を図りたいが、現状リターンの方が少ないためリスクを受け入れて導入を見送る

リスクを保有する基準としては、リスクに対する対策が不透明な場合や、かかるコストに見合うリターンが得られない場合などに検討するといいでしょう。

AIデータのリスクマネジメントが重要な3つの理由

AIデータのリスクマネジメントが重要であると言えるのには、いくつか理由があります。AIデータのリスクマネジメントが重要であるとする主な理由は、以下の3つです。

企業や自治体でもAI導入が進んでいる

AIでできることに限界がある

実際にAIの活用による問題が発生している

これらの理由はそれぞれ密接にかかわっているので、一つずつ詳しく見ていきましょう。

企業や自治体でもAI導入が進んでいる

2022年11月にChatGPTがリリースされて以来、AIは今もなお大きな注目を浴び続けています。

個人はもちろん、法人でも利用される機会が多くなり、企業や自治体でもAIの導入が進んでいるのが現状です。これにより効率化やコスト削減、そして新しいサービスの提供などを可能にしています。

総務省の調査によると、令和4年時点でIoTやAIなどのシステムやサービスを導入している企業は13.5%いました。

導入予定まで含めると、約4分の1の企業がAIに関心を示しているという結果です。なお、ChatGPTのリリースにより、令和5年の集計結果ではよりAIに興味を持つ企業が多くなると予想されます。

また、自治体でもAIの導入は進んでおり、チャットボットや申請システムに利用されています。総務省から「自治体におけるAI活用・導入ガイドブック」も発表されており、今後も自治体へのAI導入は進んでいくでしょう。

このように、企業や自治体でのAI導入は進んでいますが、導入には適切な知識と準備が必要です。また、AIは導入して終わりではなく、適切に運用していかなければなりません。

データ管理やプライバシー保護の観点から、リスクマネジメントは必要であると言えるでしょう。

AIでできることに限界がある

AIは非常に強力なツールであり、多くのタスクを効率化・自動化できます。しかし、人間のような直感や感情、倫理的判断を持っていないため、その能力には明確な限界があります。

例えば、AIは指定されたデータとパターンを学習し、それに基づいて予測や判断を行いますが、人間のような気づかいや感情はありません。そのため、時に冷たく事務的に感じてしまうことがあるでしょう。

具体的には、病院でAIが案内すると仮定して、「次は診察室」と言われるよりも、「次はまっすぐ行って突き当たりを右に曲がった診察室へ向かってください」と言われた方が親切に感じますよね。

また、AIの性能は利用されるデータの質と量に大きく依存しており、不適切なデータが供給されると、誤った結果を生む可能性があります。誤ったデータをもとに出力したデータは間違っている可能性が高く、そのまま信用できないというのが本音です。

このように、AIは多くの分野で革新的な可能性を提供していますが、その能力には限界があります。

特定のタスクや判断においては、人間の専門知識や経験、そして倫理的判断が不可欠です。これは、AI技術を導入する企業や組織がAIの限界を理解し、適切なリスクマネジメントと人間の監視を確保する必要があることを示しています。

実際にAIの活用による問題が発生している

AI技術の進歩と広範な導入に伴い、実際に多くの問題やインシデントが報告されています。

2016年にFacebook、Amazon、Alphabet(Google)、IBM、Microsoftの5社で立ち上げられた非営利組織「Partnership on AI」が作ったAIに関する事故データベース「AI Incident Database」に、多くのインシデントが掲載されています。興味がある方は、ぜひのぞいてみてください。

一例としては、以下のとおりです。

AIによる記事生成により、明らかな間違いや不自然な表現があった

音声ディープフェイクにより、詐欺未遂が発生した

無人タクシーが救急車を妨害し、搬送の遅れにより患者が死亡した

摂食障害の人に対し、チャットボットが有害なアドバイスをした

ChatGPTで作成した偽の判例法を提出した弁護士に罰金刑が科された

このように、実際にAIを活用したことによるインシデントは多数発生しています。

しかし、だからといってAIの使用を禁止すればいいというわけではありません。AIは非常に便利な技術で、今後必要不可欠になってきます。

そのため、このようなインシデントを起こさないように、人間がどのように向き合っていくのかを考える必要があるのです。

AIデータリスクマネジメントのフレームワークとその特徴

AIデータに関するリスクマネジメントについては、NIST(米国国立標準技術研究所)が発表した「AI Risk Management Framework 1.0(AIRMF)」が参考になります。

そこで、ここでは以下の分類に当てはめて内容を紹介します。

AI Risk Management Framework 1.0(AIRMF)とは

信頼できるAIシステムとは

組織内でのAI活用法

AIシステムのライフサイクル

リスクマネジメントフレームワークの7つのステップ

AI Risk Management Framework 1.0(AIRMF)とは

AI Risk Management Framework 1.0(AIRMF)は、組織がAIのリスクを効果的に管理し、プロジェクトを成功に導くためのガイドライン的な位置づけです。

フレームワークは「共通して利用できる思考の枠組み」という意味なので、AIRMFによって、AIデータに対するリスクマネジメントの考え方を知ることができます。

AIRMFでは、一般的なリスクマネジメントとは異なり、AI特有のリスクがあると指摘しています。例えば、「教師データの質によって出力データの質が左右される」「社会的影響が大きい」などです。

これらのAI特有のリスクに対応するためには、AIRMFが必要だということです。

信頼できるAIシステムとは

信頼できるAIシステムの条件として、以下の7つの項目が挙げられています。

有効性・信頼性:計画が実行され、要求を果たすことができるか

安全性:人間の生命、健康、財産、環境が危険にさらされないか

セキュリティ・回復性:予期せぬインシデントへの耐久性・回復性があるか

説明可能性・解釈可能性:AIシステムのメカニズムを説明し、結果の根拠を提示できるか

プライバシー保護:個人情報や機密情報などのプライバシーが保護されているか

公平性:平等・公平な結果を出力できるか

説明責任・透明性:AIシステムやデータの入手元、結果の説明などができるか

これらの項目が適切に管理されていれば、信頼できるAIであるとされています。しかし、もちろんすべて完璧にできるのが理想ですが、簡単ではありません。

例えば、自動車で事故の衝撃を感知し、自動で電話したり現在位置を送ったりするAIの場合です。安全性は高まりますが、電話番号や現在位置などのプライバシーは多少なりとも侵されてしまうと考えられます。

そのため、目的や提供するサービスにより、重点的に取り組む項目が変わってくるのが現実的な考え方になるでしょう。

組織内でのAI活用法

AIRMFでは、前述した「信頼できるAI」を構築して活用するために、どのような組織の在り方が必要かについても言及しています。

組織内では、統治(Govern)、位置づけ(Map)、評価(Measure)、管理(Manage)の4つが必要とされています。

統治(Govern)が中心に来ているのは、すべてに関連する基礎となる部分であるからです。それぞれについて詳細にどのような対応が必要かは、以下のとおりです。

AIには独自のリスクがあるため、組織内で適切に活用していく必要があります。そこで、この統治(Govern)、位置づけ(Map)、評価(Measure)、管理(Manage)が重要になってくるのです。

組織内でAIを活用するときは、この4つの役割を意識しながら運用すると、うまく事が運ぶ手助けになるはずです。

AIシステムのライフサイクル

AIRMFでは、AIシステムのライフサイクルについても言及されています。

例えば、ITシステムのライフサイクルは、ITシステムの企画・設計~開発~導入~運用という一連のサイクルを指します。AIライフサイクルの理解は、AIシステムの効果的な管理と最適化に不可欠です。

具体的なAIシステムのライフサイクルは、以下のように表されています。

内側2つの円がAIシステムの構成要素、外側の円が役割とライフサイクルを表しています。一番内側の「人々と環境」はすべての要素に絡むため、中心に配置されています。

各フェーズは、特定の目標と要件を満たすことを目的としており、このライフサイクルの理解は、AIプロジェクトの成功にとって重要です。

理想としては、以下の順番でリスク管理することが推奨されています。

アプリケーションコンテキスト

データと入力

AIモデル

タスクとアウトプット

また、特にAIシステムは各ライフサイクルで関与する人が異なるケースが多いです。例えば、データ入力にはデータサイエンティスト、システムの実装にはエンジニアなど、多くの人が関わります。

すべての人が知見や情報を共有することでより多くのリスクを発見できるため、AIシステムでは特にライフサイクルが重要とされているのです。

リスクマネジメントフレームワークの7つのステップ

リスクマネジメントフレームワークは、以下の7ステップで構成されています。

リスクマネジメントの準備(PREPARE)

情報システムの分類(CATEGORIZE)

セキュリティ管理策の選択(SELECT)

セキュリティ管理策の実装(IMPLEMENT)

セキュリティ管理策のアセスメント(ASSESS)

情報システムの運用認可(AUTHORIZE)

セキュリティ管理策の監視(MONITOR)

まず、リスクマネジメントの準備では組織全体のリスクを評価し、対策を練ります。このとき、対象となるシステムに対してもリスク評価を行い、セキュリティ要件を特定します。

次の情報システムの分類は、システムの特性を分析し、情報のタイプを特定するステップです。必要なセキュリティ対策を、機密性・完全性・可用性の観点からそれぞれ高、中、低と分類します。

セキュリティ管理策の選択では、ステップ2の結果をもとに、セキュリティ管理策を選択します。必要な場合は細かい修正を入れましょう。

セキュリティ管理策の実装では、文字通りシステムにセキュリティ管理策を実装します。

セキュリティ管理策のアセスメントでは、正しく実装され機能しているかを評価します。うまくいっていないところがあれば改善し、再度評価する流れを繰り返すのです。

情報システムの運用認可は、責任者にアセスメントの内容などを伝えて認可をもらう段階です。

セキュリティ管理策の監視では、システム認可後も継続して監視を行い、アセスメントを行っていきます。

初めて取り組む場合や、まだ不慣れの場合は、以上の順番でリスクマネジメントを行うことが推奨されています。

しかし、必ずしも同じ順番・内容でやらなければならないわけではなく、むしろ組織に合わせて柔軟に対応すべきです。あくまでフレームワークなので、基礎として把握しておきましょう。

適切にAIデータをリスクマネジメントしましょう

AIデータのリスクマネジメントは、企業や自治体でのAI導入拡大に伴い重要性を増しています。特に、AIの利用には限界があり、実際に問題が発生しているケースも見受けられます。

これに対し、リスクマネジメントフレームワークの導入や、信頼できるAIシステムの特徴の理解は不可欠で、具体的なリスク対応方法についても知っておく必要があります。

本記事を参考に、適切にAIデータをリスクマネジメントできるような体制を整えていきましょう。

AOSデータ株式会社では、バックアップやセキュリティ対策をはじめとして、さまざまなツールを提供しています。AIデータのリスクマネジメントに役立つツールもありますので、ぜひ一度チェックしてみてください。