img2img入門(3) PNG Infoを使ってみよう

これまで画像とプロンプトをもとにして新たな画像を生成する『image-to-image』について解説しています。

image-to-image(i2i)とは

『image-to-image』(以下『i2i』)とは、画像とテキストプロンプトをもとにして、新たな画像を生成する方法のことです。これにより、テキストのみでは伝えにくかった細かい雰囲気や色味などが再現しやすくなります。また、text2image(t2i)で生成した画像の一部分のみの修正も行うことができます。画面上部のメニューの左から2番目の『img2img』を選択することで使用できます。

PNG Infoを使ってみよう!

とてもカンタン、ドロップして数秒待つだけです!

Stable Diffusion WebUI で生成されたPNG画像には、そのプロンプトや使われているモデル、LoRAやControlNetに関する情報、ステップやCFG_Scaleといった細かな設定までが埋め込まれています。

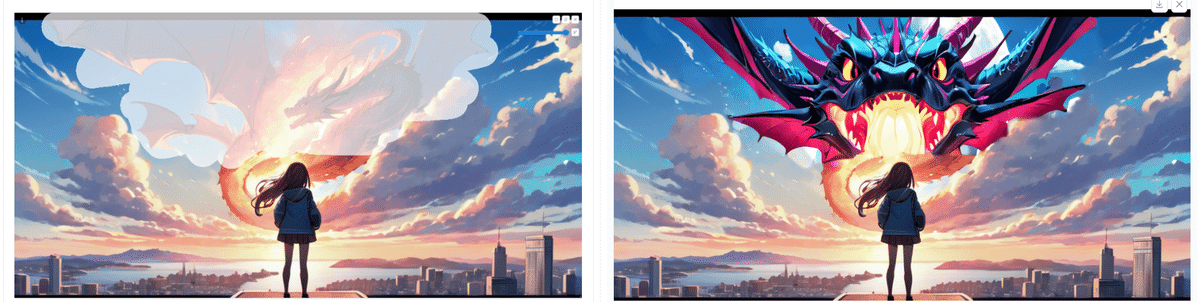

PNG Infoのタブに画像をドロップして数秒待つと……

右側にこんな感じに表示されています。

parameters

dragon_girl, school uniform, from behind, blue sky, building, city, cityscape, cloud, cloudy sky, day, evening, facing away, fire, gradient sky, horizon, jacket, letterboxed, long hair, mountain, ocean, orange sky, outdoors, scenery, sky, skyline, skyscraper, solo, standing, sun, sunset, twilight

Negative prompt: unaestheticXL unaestheticXLv13,(blur, blurry, depth of field:1.5),(3d:1.2), EasyNegative

Steps: 20, Sampler: DPM++ 2M Karras, CFG scale: 7, Seed: 2839006714, Size: 1016x512, Model hash: 8c462a80f4, Model: bluePencilXL_v050, Denoising strength: 0.75, Version: 1.6.0

Template: dragon_girl, school uniform, from behind, blue sky, building, city, cityscape, cloud, cloudy sky, day, evening, facing away, fire, gradient sky, horizon, jacket, letterboxed, long hair, mountain, ocean, orange sky, outdoors, scenery, sky, skyline, skyscraper, solo, standing, sun, sunset, twilight

Negative Template: unaestheticXL unaestheticXLv13,(blur, blurry, depth of field:1.5),(3d:1.2), EasyNegative

更に下側にあるこの4つのボタンを押すと、次のステップにこの情報と画像を持っていくことができます。

「Send to txt2img」テキストからの画像生成へ

「Send to img2img」i2iのプロンプトへ

「Send to inpaint」インペイントのプロンプトへ

「Send to extras」画像の拡大機能へ持っていきます。

ここでは inpaintについて復習してみましょう

Send to inpaint

PNG Infoの右下、「Send to inpaint」ボタンを押すと、インペイントのプロンプトへ移動します。

この状態では不要なプロンプトも含まれているかもしれません。適時削っていきましょう。

(他人が作ったPNG画像の場合には自分の環境にインストールされていない機能が含まれているからです)

そしてインペイントの復習です。前回のSketchと同じ要領で

右上の描画ツールを使って「描き直す対象」を白塗りしていきます。

この場合はドラゴンを大胆に描きなおしていきましょう。

ポジティブのプロンプトを描き直しする「dragon」にします。

描き直す対象のことなので、制服の少女のことはこの際忘れましょう。

でも画像サイズなどはきちんと引き継ぎできています。

ちょっと画風が合っていませんね。

元の画風に合わせる場合は Denoising Strengthを下げます。

Denoising strengthを0.75→0.5とした場合の結果です。

もしi2iの元絵が他人の作品だった場合、あまりこの値を下げすぎることは倫理的におすすめしません。元絵のパクリになってしまう可能性が高いからです。

しかしどれぐらいの値を入れれば「元絵とは違う」という感じになるのでしょうか。こういう時は実験をしてみましょう。

X/Y/Z plotを使って実験してみよう

いい感じの出力が出るシードを見つけたら、Seedを「♻」を再利用(固定)します。

さらに下の方にある「Script」から「X/Y/Z plot」を選んで、「X type

」を「Denoising」を選び、「X values」に、段階的に試したい値、ここでは「0,0.2,0.4,0.6,0.8」と +0.2 づつにして「Generate」をしてみます。

複数回の画像生成が進み最終的にこんな感じの画像が生成されたはずです。

やはり0.4以下はほぼ元絵、0.5~0.75ぐらいが良さそうです。

このように「X/Y/Z plot」は多段階生成をして、パラメータの実験ができます。YやZを設定することで多次元的に評価できます。またパラメータを変更できるかどうかの選択肢はプルダウンで選ぶだけです、あとは実験する値を入力するだけです。直感に頼らずに、実験的に試したほうがゴールに辿り着く速度は速くなります。是非いろんなケースで活用してみてください。

<次回>img2img入門(4)「Extraを使って画像を超解像化をしてみよう」

img2img入門(5)「インペイントの基本」

※本ブログは発売予定の新刊書籍に収録される予定です。期間限定で先行公開中しています。

メンバー向けには先行してメンバーシップ版をお届けします

Stable Diffusionをお手軽に、しかもめっちゃ丁寧に学べてしまう情報をシリーズでお送りします。

メンバーは価値あるソースコードの入手や質問、依頼ができますので、お気軽にご参加いただければ幸いです!

この下にGoogle Colabで動作する「AUTOMATIC1111/Stable Diffusion WebUI」へのリンクを紹介しています。

メンバーシップ向けサポート掲示板はこちら!応援よろしくお願いします!

ここから先は

この記事が気に入ったらサポートをしてみませんか?