チャットGPTはスターウォーズに出てくるC-3POなんですよ!

『だれにでもわかるNFTの解説書』の足立明穂です。

っていうか、最近はチャットGPTのことしか書いてないじゃん!w

でも、NFTの仕事もしてるんですよーw

それは、それとして、チャットGPTがウソをつくポンコツだという記事を、あちこちで見かけます。

確かに、間違ったことを、自信満々で答えてくるし、詳しいことを知ろうとしても、一般論を繰り返すばかりで細かなことは曖昧なまま。

数をかぞえるのだって、適当すぎて、本当にコンピュータかよ!って言いたくなるぐらいポンコツですw

そんなポンコツなのですが、実は、スターウォーズに出てくるオシャベリなC-3POなんですよ!w

今回は、何がポンコツで、何がすごいのかを考えてみましょう。

「間違ったことを回答する」って言うけれど・・・

確かに、誰でも知ってるようなことを質問しても、適当すぎて、めちゃくちゃな回答を自信満々で回答します。

で、こういうのを見ると、

「だから、チャットGPTなんて、使えないポンコツ」

「こんなのに仕事を任せるなんて、おかしいんじゃないか?」

「子供がこれを信じて勉強したらとんでもないことになる!」

ええ、その通り! ポンコツな情報を信じたら終わります。

終電逃したので、AIに夜中も営業してるサウナをきいて、その通りに行ったら、サウナなんてなかったという話もありますw

でも、これ、確信犯(あえて地図もみないで、行ってみるところが、なかなか酔狂でよろしいw)なので、楽しめますが、マジ質問してたら大変ですよねw

ただ、今のチャットGPTは、2019年のインターネットなどの情報で学習しているので、古い情報だったり、そもそも、インターネットの情報であることから、正しい情報を学習してるかどうかも怪しです。

そもそも、「正しい」って何ですか?

いきなり、哲学的な問いになりますが、チャットGPTは間違っているというときに、反対に「正しい」とはどういうことなのでしょうか?

何か知りたいときに、「正しい」ってどこで判断していますか?

「〇〇さんが言ってたから正しい」

「辞書に書いてあるから正しい」

「研究結果があるから正しい」

そうなのでしょうか?

改めてきかれると、あなたの「正しい」と思っていることがぐらつきませんか?

簡単に「正しい」とか「間違っている」とか言いますが、あなたの頭の中の「正しい」であって、客観的に正しいかどうかは別の話ですよね。

先の「2023年4月の日本の総理は菅義偉氏」にしても、頭の中にある情報と照らし合わせて、判定しているだけ。

「エリトリアの大統領は、イサイアス・アフェウエルキ」って答えられても、正しいかどうかなど分かりません(^^;

詳しい人にきいたところで、その人の勘違いとか思い違い、情報を収集した後に変わったということもあります。

2019年以前のビジネス書を読んでみると、コロナ前なのでテレワークとか、リモート会議とかは出てきません。

経営リスクにも、パンデミックのようなことが起きて、いきなり来店客がゼロになる可能性なんて、書かれていません。

しかし、今は、そんなことを書かなくても誰もが体験しましたよね。

それぐらい変化があったのです。

ポンコツGPT、じゃない、チャットGPTを擁護するわけじゃないけど、そんな情報を求めても、そもそも学習してないデータなので無理な話なんですよね。

じゃ、そんなポンコツを使うのは意味ないのか?

って、ことになってくるのですが、ここが、チャットGPTの「GPT」が面白いところなのです。

GPTとは、Generative Pretrained Transformerの略で、無理やり日本語にすると、事前学習された生成モデルってな意味になります。

平たく言えば、事前に学習した内容に基づいて作り出す装置なのです。

事前学習というのは、大量のテキストデータを読み込んで、そこに出てくる単語と単語のつながりを桁違いに多い文章で学びます。

そして、その学習した内容に沿って、入力されたテキストから、生成したテキストを出力するようになったのがチャットGPTなのです。

これ、なんか人間のちびっこと似てません?

最初は意味も分からず、親の言葉を真似し、そこから、応答を学びます。

「いってきます」 → 「いってらっしゃい」

「ただいまー」 → 「おかえりー」

「ありがとう」 → 「どういたしまして」

これと同じようにチャットGPTも大量の文章を読み込んで、もっと細かく、単語と単語の関係を学習しています。

ここで、重要なのは、上の記事にも書いてるように、意味は全く理解していないという点です。

「ほら! やっぱ、ポンコツGPTじゃん!」

え? そう思いました?w

いえいえ、意味を理解してないからこそ、日本語だろうが、英語だろうが、ドイツ語だろうが、関係ないのです。

もちろん、画像だって、動画だって、音声だって、同じこと。

学習データが大量に集まれば集まるほど、どんどん対話の精度が上がっていきます(対話の精度が上がるのであって、正しい情報を提供するのではないところがポイント。驚異的な速度で学習できるところが大きい)。

チャットGPTは、C-3POかも!?

スター・ウォーズに出てくるオシャベリ・ロボットC-3POって、知ってますよね?

「600万を超える言語を流暢にこなす」ってところが、まさに、チャットGPT!!

C-3POは、どんな言葉でも通訳できるというのが大きな特徴で、相棒のR2-D2が、ピーピュー言っているのを翻訳できます。

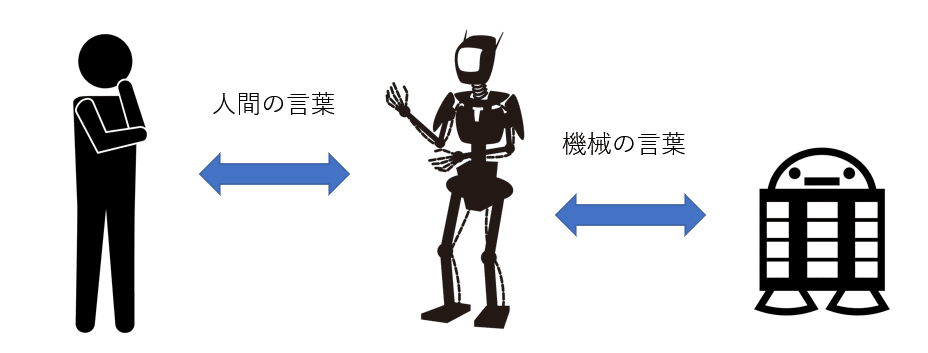

なんとなく、こんな図式になりませんか?

人が話した言葉を、C-3POが理解し、機械に分かる言葉に翻訳します。

その言葉(プログラムとかデータ)をR2-D2が理解し、膨大な情報から結論を導き出し、C-3POに伝える。

C-3POは、それを人間の言葉にして、伝える。

なんか、このC-3POが、チャットGPTと似てるようなぁって感じるのです。

翻訳するには、膨大な言語のデータを学習して、それぞれの単語の関係性を学びます。

ここでは、意味を理解する必要などなく、とにかく翻訳ができればいいのですよね。

そして、今、チャットGPTをさまざまな他のプログラムやサービスとつなげて使うというのが広がってきています。

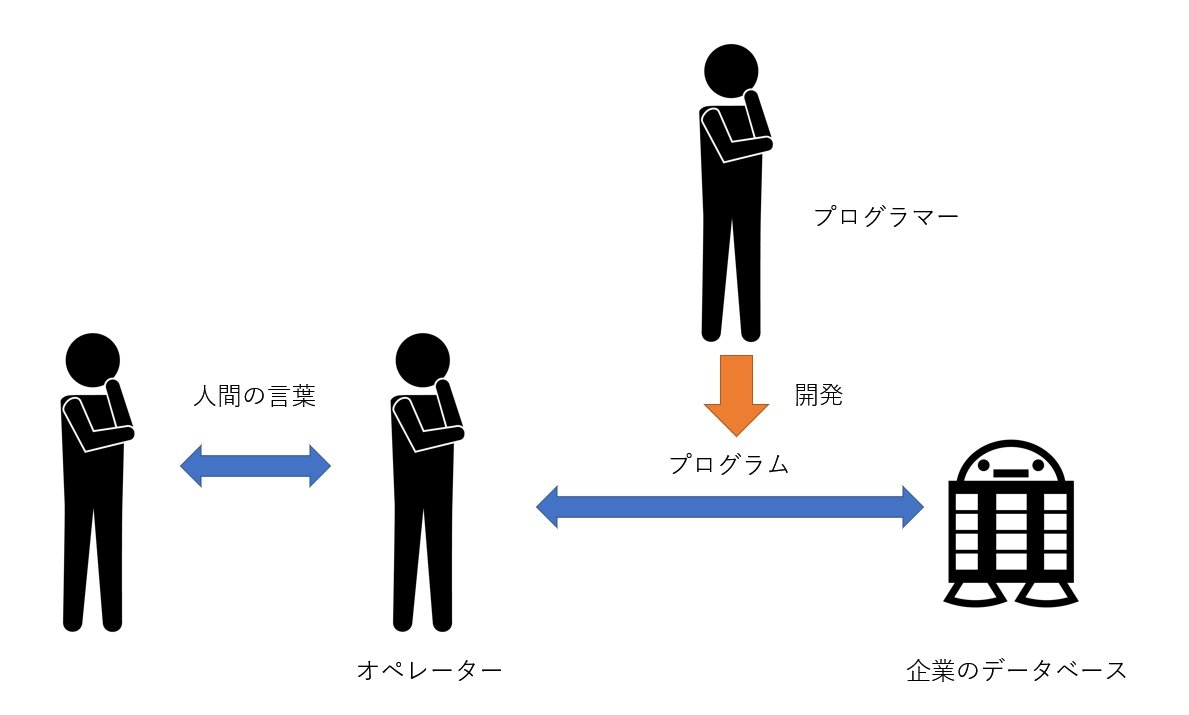

少し細かく言うと、従来というか、今のコンピュータを使おうとすると、直接、人間の言葉は理解できないので、コンピュータを操作できるオペレータに伝えます。

オペレータは、操作して必要な情報を引き出すことができます。

その結果を依頼された人へ渡して終わり。

ただ、オペレータが操作するプログラムは、プログラマーが開発しているので、このプログラマーが人間の言葉と機械の言葉の橋掛け役になっているのです。

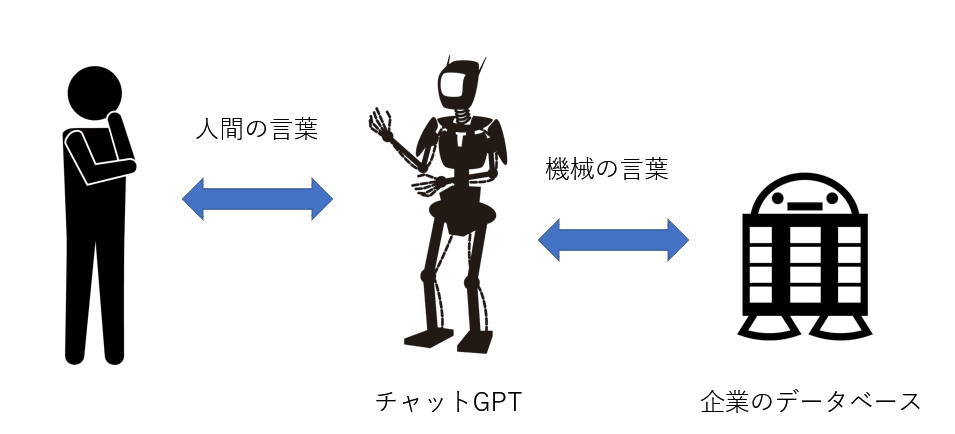

ところが、チャットGPTが登場したことによって、人間の言葉を機械の言葉に翻訳できるようになったのですね!!

まず、操作するオペレータが必要なくなります。

そして、プログラムも一旦、チャットGPTが学習すれば、それ以上作る必要はなくなる可能性があります。

あ、もちろん、企業のデータベースなどの構築は必要ですが、機械の言葉を知らない人のために操作する画面などは不要になってくるでしょう。

このように、人間の言葉と機械の言葉を翻訳できるのがチャットGPTであり、人間が、直接、コンピュータに話しかけて、操作できるようになったのです!!

ほらほら、とんでもない世界になってきたって思うでしょ??

おまけ:チャットGPT単体で利用するのは、C-3POだけで仕事をさせようとしてるから、ポンコツに感じるw

こんな状態で、使っていれば、そりゃ、正しい情報とか、最新のデータとか、画期的なこととか出てこないですよw

スターウォーズの映画の中でも、C-3PO単体では、うるさく喋っているだけで、これといって活躍しないですよねw

R2-D2と一緒になってこそ、真価を発揮するのです。

だから、今の状態のチャットGPTだけで「間違った回答する」とか言っている人は、全体像が見えてないですよー!w

この記事が気に入ったらサポートをしてみませんか?