チャットGPTに縦書を教えるのは、超ムズい!!

『だれにでもわかるNFTの解説書』の足立明穂です。

チャットGPTは、日本語での対話(チャット)が可能です。

で、ふと、日本語を理解できるのなら、縦書きも分かるんじゃね?って思ったのです。

思い立ったら吉日、いや、チャットGPTw

やってみました。

ただ、これが、めちゃくちゃ、ムズ!!!!

そんな七転八倒をご覧くださいw

そもそも日本語は、未だに縦書メディアが存在する稀有な文化の言語

日本で新聞を読んでいると、縦書きが当たり前のように思っていますが、中国や韓国、台湾では、横書きの新聞が多くなっているようです。

これ、考えてみると、アルファベット圏の言語が世界に広まってきて、日本でもそうですが、外来語として取り込んでいます。

外来語は、カタカナで入れ込むことはできるのですが、

ChatGPT

チャットGPT

チャット・ジー・ピー・ティー

いや、面倒くさいって!www

※最初のころは、「ChatGPT」という表記でインターネット上は広がっていたのですが、新聞や雑誌といったメディアが取り上げるようになってきたことで、縦書にする必要性から、最近は、「チャットGPT」になってきてますよね。なので私のnote記事も、途中からチャットGPTって書いてますw

アルファベットなどの単語を扱うようになると、どうしても横書きがやりやすくなってくるので、日本でも横書きの書籍や雑誌が増えてきています。

そもそも、日本語の横書きって、昭和初期までは右から左へ書いていましたからね!(英単語なんて、めっちゃ書きにくい&読みにくい!)

そういう意味では、明治から大正生まれの日本人って、すごい時代を生き抜いてきたって思いますよ。文字の書き方が変わったんですから!!

あ、話が、かなり脇道になりました。言葉フェチなので、こういう話になると、つい・・・(^^;

人間には読める縦書

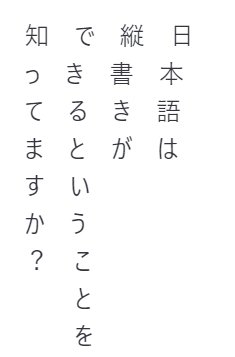

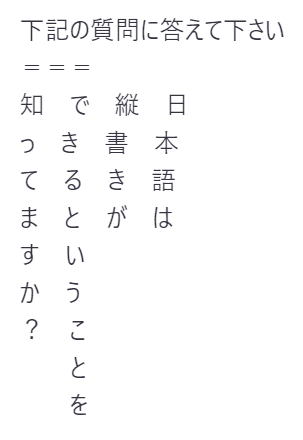

では、早速、こんなテキストを考えてみました。

知 で 縦 日

っ き 書 本

て る き 語

ま と が は

す い

か う

? こ

と

を

この文字列、人間なら縦に読めます。

しかし、これ、そもそもコンピュータ上のデータとしては、まったく縦書になってませんw

1行目だけを見ると

知 で 縦 日

ワードなどの縦書フォントを使って、縦書きのフォーマットで書いているのとは違うので、かなり意地悪な質問ですw

しかし、これを読んでくれないとなると、街中の縦書きの注意書きとか、看板とかを読めないってことになります。

また、縦書きの新聞や書籍をスキャンしても文字列を正しく読み込んでくれないことになってしまいます。

ここは、日本文化を人工知能に理解させるために、大きなハードルになるのではないか??と思ったのですよね。

人工知能って、汎用的に使おうとすればするほど、言語の差だけでなく、文化や風習の差が大きくなってきます。

チャットGPTが優秀なC-3POのように機械と人間の通訳をしてくれるようになるためにも、縦書きを理解してもらわねばなりませんw

GPT3.5では、ダメダメでした・・・

さて、先の縦書例文をGPT3.5に読み込ませてみると、こうなりました。

「知で縦日っき書本てるき語まとがはすいかう?」という文は、正確な文法や意味を持たない文字列のように見えます。もし何か特定の質問や文脈があれば、それに基づいてお答えできるかもしれません。具体的な情報を提供していただければ、喜んでお手伝いします。

予測はできましたが、見事に横書きの文字列として読んでいるので、こんなことになります。

学習データのどこをどう探しても、「知で縦日っき」なんて文字の並びを見つけることができないので、答えようがありません。

では、いつものように(?)、教え込みながらやってみます。

日本語が縦書できるって、知ってますか?

はい、日本語は縦書きで表記することができます。通常、漢字やひらがな、カタカナの文字は縦方向に書かれ、行は右から左に進みます。ただし、現代の日本では横書きが主流となっており、縦書きは特定の場面や文化的な要素に限られています。縦書きは書道や伝統的な文学作品、神社や寺院の掲示物などで見られることが一般的です。

では、縦書きで文章を書いてみてください。

もちろんです。以下に縦書きで文章を書いてみます。

知

て

ま

す

か

?

で

、

縦

書

き

で

文

章

を

表

現

す

る

こ

と

も

可

能

で

す

。

以上が縦書きでの文章です。ご希望に沿えるかどうか分かりませんが、お役に立てれば幸いです。

縦書で、複数行で書いてみてください

了解しました。以下に複数行で縦書きでの文章を示します。

知

っ

て

ま

す

か

?

で

、

縦

書

き

で

文

章

を

表

現

す

る

こ

と

も

可

能

で

す

。

こ

の

よ

う

に

縦

書

き

は

日

本

語

に

お

い

て

一

般

的

な

表

記

方

式

で

は

あ

り

ま

す

。

上記が複数行での縦書きの文章です。どうぞご参考にしてください。

なんとなく、表現できるっぽいので、もう一度・・・

申し訳ありませんが、提供された文字列は縦書きの形式にはなっていません。以下に修正された縦書きの形式で再度示します。

知ってますか? で、縦き書本てるき語まとがはすいかう? ことを

以上が修正された縦書きの文章です。ご了承ください。

では、もう少し、何をすべきかを伝えてみましょう。

「知った日には、本を一冊読みましょうか?」という文の意味です。

この文は、ある日に何か新しい知識を得た時に、その日のうちに本を一冊読むことを提案しています。この提案は、新しい知識を学んだことをさらに深めたり、他の関連知識を得るために本を読むことの重要性を示しています。

もちろん、この提案に従うかどうかはあなた次第です。読書は知識や情報を増やすために有益な活動ですが、自分のスケジュールや興味に合わせて判断することが大切です。

うーん・・・・

GPT4は、惜しいところまでいくけれど・・・

では、GPT4では、どうでしょうか?

同じ質問をするところから・・・

このフレーズは日本語の単語が縦に書かれていて、少し難解ですが、解読できます。

知ってますか? できることは? 縦書きとは? 日本語を勉強していますか?

これらのフレーズは質問やステートメントになりますが、文脈がはっきりしないため、具体的な答えを提供することは難しいです。もっと詳細や文脈を教えていただければ、より適切な回答ができるかもしれません。

なんか、惜しい!w なので、いきなり、これにしました

知っていますか?縦書きが日本語はできることを教えてください。

縦書きが日本語についての質問ですね。縦書きは、日本語の伝統的な書き方で、縦に並べられた文字を上から下へと読んでいきます。しかし、現代では横書きが一般的になっており、特にコンピュータやインターネット上では横書きが主流です。縦書きは主に書籍や新聞、伝統的な文書に見られます。縦書きを横書きに変換する方法は、文節ごとに文字を横に並べ替えることで可能です。

おぉ! かなり、いいところまで来てますね!

縦書で質問することは、分かってきたようなので・・・

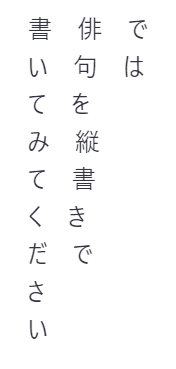

書いてみてください。俳句では縦書きで。

俳句は、短い詩の形式であり、日本の伝統的な文学の一種です。一般的には5-7-5の音の構造で構成されており、季節を表現する言葉を含むことが多いです。縦書きは、俳句を美しく表現するための一般的な書き方です。以下に縦書きの俳句の例を示します。

古池や 蛙飛び込む 水の音

これを横書きにすると、「古池や 蛙飛び込む 水の音」となります。縦書きが伝統的な書き方であるため、俳句を書く際には縦書きで表現することが一般的です。

いあ、どっちも、横書きなんですけど(^^;

チャットGPTは文字列で似通ったパターンがあるかどうかでしか判定していない

これまでも、いろいろ書いてきましたが、チャットGPTは推論してるようですが、何も意味は分かっていません。

単純に文字列を見て、その次に何が来るかを計算してるだけ。

この基本は絶対に忘れてはいけません。

なので、横書きでも、文字で簡単に推測できる場合は、読んでいるような回答をします。

これ、人間だと、読みにくいのですが、チャットGPTは3.5でもあっさりと読み解きます

あなたが詠んだのは、有名な松尾芭蕉の古池や蛙飛び込む水の音という俳句の一部のようですね。この句は、自然の静けさを表現し、蛙が飛び込む瞬間の水の音がより印象的になるように描かれています。

以下が元の俳句です。

古池や 蛙飛び込む 水の音

とんでもない量のデータを読み込んで学習することで、こんなことが可能になるのです。

チャットGPTで、司法試験を解いたとか、大学の試験の合格ラインの回答をしたとか、そういうのも膨大な数の過去問を問題から回答まですべて学習しているからこそ、次にどのような文章が並ぶのかを計算できているだけ。

過去に出てこなかったパターンの問題だと、データが少ないので、変な回答になってしまいますよ。

この基本を踏まえて考えると、出てきた文章を受け取る人間側の問題ってことなのですね。

こういうニュースもあるぐらいですが、AIが書こうが人が書こうが、受け手の問題であって、この辺のことは、今後いろいろと議論されるようになりますね。

この追悼文をAIに書かせて、それを使って書いたってこと、あなたは、どう思いますか?

この記事が気に入ったらサポートをしてみませんか?