Apple Vision Proデベロッパラボで実機を体験してきた話

2024年2月2日、ついにApple Vision Proが発売されました。僕は過去に開催されたApple Vision Proデベロッパラボに複数回参加しました。

その時の感想を開発者の観点で記載していきたいと思います。

※ ここに記載する内容は製品版になる前のApple Vision Proであり実際に発売された製品とは異なる場合があり、ソフトウェアのアップデートなどによる改善されている可能性が高いです。その前提で読み進めてください。

装着感

デベロッパラボではSolo Knit BandにTop Bandが着いた特別仕様でした。Solo Knit Bandだけでも十分な装着感はあったが、体を激しく動かすようなゲームやアプリで利用するにはズレる可能性が高そうで不向きでした。それもあってか、製品版には頭頂部と後頭部でしっかり固定するDual Loop Bandが付属されています。これなら激しく動くゲームでも快適な利用ができそうです。

顔の接地面にあたるLight Shieldも接続状態を検知しているようで起動中に外すとアラートが表示されました。Optical Inserts Lensも同様で外すとアラートが表示され、セットアップからやり直しになった。

電源アダプターはUSB-Cで30wのものが使用されていました。バッテリーはiPhone 14 Proとほぼ同じサイズで厚みが約二倍あり、重みはあったので長時間バッテリーのみで使い続けるようなアプリだと疲労はありそう。電源ケーブルはMBPなどについている物と似ている上質な編み込み式で長さも2mほどあり取り回しは良さそうでした。ただ、左の耳元の上辺りに接続するため操作する時に邪魔にはなった。

パススルーの解像度

前に人がいたので外したり付けたりしてみたが、人のサイズ感、色味は現実に近いが、現実と全く同じ解像感というのは流石に大げさに感じた。例えば、MBPの液晶の文字は読めなくはないがくっきりではない。プロジェクターで壁に映し出されていた美しい環境映像をパススルーでみるとディテールが失われていて水彩画みたいだった。MBPのキーボードの文字を読むことはできた。また、首を速く横に振ると遅延しているのか映像がブレていた。

パススルーを使ったアプリを作る際にはあまり速く動くような動作を求めると目の疲れに繋がりそうなので慎重に検討する必要がありそうだ。

ちなみに、無理やり視線だけ動かしてVision Proのパネルの端っこを見ると色収差的なものも発生していた。

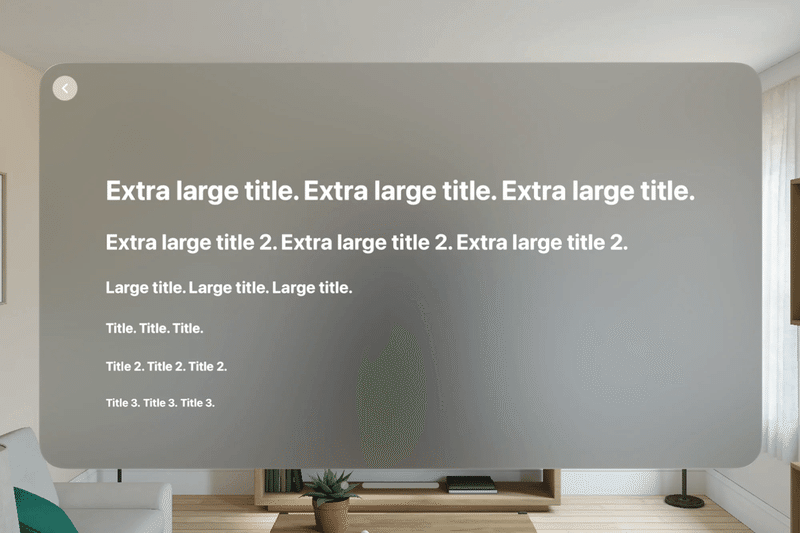

アプリ解像度

アプリの解像度は流石のクオリティで、visionOSに準備されているテキストスタイルの一番小さい文字でもRetinaディスプレイで見ているように問題なく読めた。

会場はかなり明るい部屋だったが、Glass Windowに表示した白い文字もしっかり視認することができた。Appleが示しているガイドラインに沿ってテキストやボタンをデザインすれば見にくいということはなさそうだった。

視線トラッキングの精度

視線トラッキングの精度は本当に素晴らしい。何度かボタンに視線をあわせてもホバーされないことはあったが数える程度だった。試しに、ソフトウェアキーボードでA〜Zまで視線トラッキングで入力してみたが、誤字は3文字のみだった。

文字入力においては、不満もあり途中まで入力して間の1文字だけを削除する術はなさそうで後ろから全部消す必要があった。初期のiOSも確かそうだったが非常に使いづらい。また、ソフトウェアキーボードでダイレクトタッチで文字入力してみたが、フィードバックが無いので押しにくかった。キーボードに指を近づけてフォーカスしたときのホバーが控えめで分かりにくいのでこの辺りが改善されることを願っている。

アプリで沢山の入力や操作が必要となる場合にはダイレクトタッチでの操作よりも視線トラッキング+ハンドジェスチャーでの入力を前提とした設計にするほうが良さそうだ。

ちなみに、数時間使っていると視線トラッキングの操作が当たり前になって体が馴染んでいた。ラボ終了後にホテルに戻ってMBPで仕事をしていた時、トラックパッドを使わずにカーソルを動かしたい位置を凝視してしまったくらいだ。

MBPの液晶を拡張表示

これはラボでは試すことができなかった。

しかし、聞いた話によると27inchのStudio Displayがそこにある状態と同じ解像度で文字が見えるらしい。実際にVision Proのアプリの文字の解像度はかなり高いのでStudio Display並みの解像度で見える可能性はありそうだ。

また、Vision Proに映し出されたMBPの画面でそのままコードを書いて、ビルドしたものを空間に表示させるのは可能なようだ。これはスクラッチ&ビルドを繰り返す開発者にとっては新たな体験になりそうである。

既存アプリは動くか?

iPad、iPhoneアプリはSupporterd DestinationsにApple Visionを追加すればそのままでも動いた。タッチ可能なアイコンのスペースが狭すぎて視線で選びにくいなどはあったが動きとしては概ね問題なかった。

iPhoneのアプリだと縦に長いアプリが多いが、Vision Proだと縦長は使いにくい。縦長だと首が痛くなりそうで体験として良くなかった。

アプリ内のカメラ機能からVision Proのカメラは使えなかったが写真とファイルから選択することは可能だった。

パスワードはアスタリスク表示にならなかった。誰にも覗かれることが無いのであえてそのような実装にしている可能性はありそうだ。

フリーフォームの使い勝手

フリーフォームのペンのフォーカスは視線でなくて、指の先から白い線がでていてつまむと書き始められる仕組みだった。

既存アプリで写真にフリーで書き込めるものを試してみたが、ペンのフォーカスは視線で、つまむと書き始められた。ただ、視線のフォーカスはホバーが表示されないのでどこに書き込もうとしているか分からず非常に書きにくかった。

フリーフォームの様に全体を見ながら書くような仕組みの場合には視線トラッキング使わずにあえて、指の先をフォーカスとするほうが使いやすいアプリになりそうだ。

開発

ラボのVision Proは開発機だったようで、右側にはMacとUSBで接続する為のDeveloper Strapが着いていて、有線接続してビルドしたものを実機に転送することができた。製品版の画像を見てもVision Proには電源接続のコネクタしか見当たらないので有線接続する方法が見当たらないのは気になる所だ。ただ、WiFiによるConnect via networkも使えるようなので、無線接続でMBPとVision Proを接続して開発はできそうである。

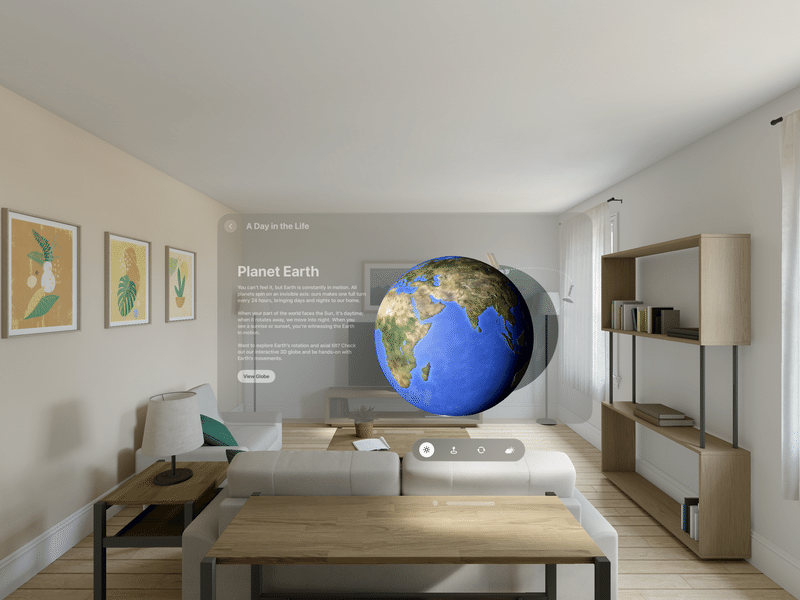

Hello World

Hello Worldのサンプルは非常に良く出来ているのでvisionOSの開発の際には是非参考にしてほしい。Hello Worldでは地球儀の3Dエンティティが出てきて掴む事ができる。両手で包み込んで、広げると地球儀が広がり、狭めると小さくなる。リアルな行動と3Dエンティティが連動するので今まで感じたことがない新しい体験だった。

ただ、Hello Worldの3Dエンティティには深度情報が適用されていない(Reallity Kitを使えばできるらしい)のか手前の親指よりも前に3Dエンティティが配置されて不自然な表現となっていた。

まとめ

残念ながらApple Vision Proを米国の発売日当日に手に入れるこはできなかったが、ラボで体感した限りでは現在のコンシューマー向けHMDとしてかなりの精度だった。物理的に自分の手の動きと連動するソフトウェアを作ることができる体験は今までの開発体験とは異なり、不思議な感覚を覚えたが今後も作っていきたいと思えるものだった。

参考

この記事が気に入ったらサポートをしてみませんか?