階層型ニューラルネットワークについて

階層型ニューラルネットワーク(Hierarchical neural network)は、異なるレベルの抽象化を持つ複数のレイヤーで構成されたニューラルネットワークの一種です。これはディープラーニングの一部と見なすことができ、データからより複雑で高レベルな特徴を段階的に学習する能力があります。

主要な特徴

多層構造: 階層型ネットワークは、入力層、複数の隠れ層、出力層で構成されています。各層は前の層からの入力を受け取り、次の層への出力を生成します。

抽象化の増加: 下層の隠れ層は比較的単純なパターンや特徴を抽出し、層が上がるにつれてより抽象的で複雑な特徴が学習されます。例えば、画像処理の場合、初期の層ではエッジやテクスチャが検出され、上層では物体の部分や全体の形状が認識されます。

逐次的学習: 各層は前の層からの情報に基づいて学習を行い、情報は階層を通じて逐次的に精緻化されます。

アプリケーション

階層型ネットワークは多岐にわたる分野で応用されています。以下はその例です:

画像認識: CNN(畳み込みニューラルネットワーク)は階層型のアプローチを利用しており、画像のローカルな特徴からグローバルなパターンまでを学習します。

自然言語処理: RNN(リカレントニューラルネットワーク)やTransformerなどは、テキストデータの文脈的な理解を深めるために階層的な構造を用いています。

音声認識: 音声の波形から発話の意味まで、異なるレベルの特徴を段階的に抽出することで、より効果的な認識が可能になります。

利点と課題

利点:

複雑なデータ構造を効率的に学習できる。

高いレベルの抽象化により、汎用性の高い特徴を抽出することが可能。

課題:

訓練には大量のデータと計算リソースが必要。

モデルの解釈性が低くなることがある。

階層型ネットワークはその構造と機能によって、多様な問題に対して高い性能を発揮することができ、今後もさまざまな進化が期待されています。

階層型ニューラルネットワークの各階層

階層型ニューラルネットワークの各階層がどのように異なる特徴を抽出し、処理するかについての説明を改めて行います。具体的な例として、画像認識を行う畳み込みニューラルネットワーク(CNN)を用いて説明します。

1. 入力層

機能: 画像データのピクセル値をそのまま受け取る。

特徴: 入力層は単にデータをネットワークに供給する役割を担っており、処理や変換は行われません。

2. 初期の隠れ層(低レベル特徴抽出)

機能: エッジやテクスチャ、色のグラデーションなど、基本的な視覚的特徴の抽出。

特徴: 畳み込みフィルターを使用して局所的な特徴を検出し、これにより画像の基本的な構成要素を識別します。活性化関数(例: ReLU)が非線形性を導入し、有用な特徴のみが次の層へ伝えられます。

3. 中間層(中間レベル特徴抽出)

機能: 初期層で検出された特徴を組み合わせて、より複雑なパターン(形状の一部など)を形成。

特徴: この段階での特徴は、単純な形状や特定のオブジェクトの一部として認識されます。プーリング層がしばしば使用され、入力の次元を削減しつつ重要な情報を保持します。

4. 高位層(高レベル特徴抽出)

機能: より抽象的な特徴の統合と、複雑なオブジェクトの認識。

特徴: これらの層では、完全なオブジェクトや、それらが存在するシーン全体の理解が行われます。例えば、犬や自動車などの特定のカテゴリがこの段階で識別されることが多いです。

5. 出力層

機能: 最終的な分類や回帰タスクのための出力生成。

特徴: 一般に、全結合層が使用され、特徴マップが特定のタスクに応じた出力(例えば、クラスラベルの確率)に変換されます。分類問題では、ソフトマックス関数が最終出力を正規化し、予測確率を提供します。

階層型ニューラルネットワークは、このようにして段階的にデータを抽象化し、最終的な出力まで情報を精緻化していきます。各層は前の層からの出力を入力として受け取り、特定の処理を加えることで、次第に複雑なデータパターンを学習することが可能になります。このプロセスにより、ネットワークは高い精度でタスクをこなすことができるようになります。

積和演算について

積和演算は、特にデジタル信号処理(DSP)や機械学習の分野で広く使用される基本的な数学演算です。この演算は、入力された複数の数値データの積を求め、それらを合計する処理を指します。ニューラルネットワーク、特に畳み込みニューラルネットワーク(CNN)においては、積和演算が核となる計算処理であるため、高速な積和演算は重要です。

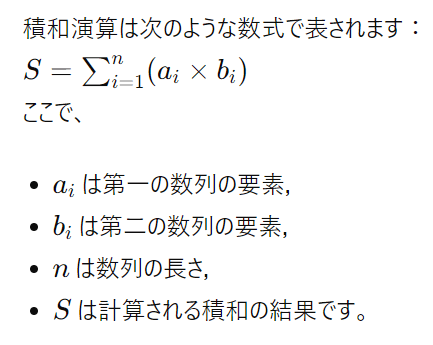

積和演算の基本的な形式

積和演算の応用

デジタル信号処理: フィルタリング、信号変換など多くのDSPアルゴリズムが積和演算を基礎としています。たとえば、FIR(Finite Impulse Response)フィルターでは、入力信号とフィルタ係数の積和が出力信号を生成します。

ニューラルネットワーク: CNNの畳み込み層では、入力データ(画像など)とカーネル(フィルタ)との積和が計算され、特徴マップが生成されます。また、全結合層では、入力ベクトルと重み行列の積和が行われ、次の層への入力が生成されます。

画像処理: 画像の平滑化、シャープニング、エッジ検出など、様々な画像処理技術も、畳み込み操作を通じて積和演算に依存しています。

積和演算の実装

積和演算は、ハードウェアレベルでの最適化が一般的です。特に、GPU(グラフィックス処理ユニット)や専用のDSPチップは、多数の積和演算を並列に高速に処理することができるため、ニューラルネットワークの学習や推論を効率的に行うことができます。また、FPGA(Field-Programmable Gate Array)などのプログラマブルなデバイスを使用して、特定のアプリケーションに最適化された積和演算の実装が行われることもあります。

このように、積和演算はその単純さに反して、多くの先進的な技術分野で中核的な役割を果たしています。

この記事が気に入ったらサポートをしてみませんか?