【GPTs】メルカリ出品アシスタント&プロンプトリーキング考&他GPTsアプデ

この記事では、メルカリの出品に際して必要となる商品説明を作ってもらうGPTsを作成しましたので、それをご紹介するものとなります。

一応、少し前からいちいち書くのが面倒だったので、別途ChatGPTに作ってもらうこともありましたが、その辺の定型プロンプトをGPTsに組み込みました。

また、プロンプトインジェクション(プロンプトリーキング)対策として、様々な方が有用なアイデアを考えてくださっており、その辺のご紹介も簡単にさせていただきます。

ちょっと変えたりもしましたが、自分のGPTsにも導入してみました!

加えて、この過程で気付いた自分が作成したGPTsのバグも修正しました。

具体的には、

逆アキネーター:セッション初めにGPTs側で答えを持つようにしました。

Blog Visualizer for note:可能な限り1回のやりとりで正確に画像を作れるようにしました。(うまくできず2回に分割される時があります…)

他に作成したものも改めてご紹介させていただきます。

(別記事で没にしました、としているもの以外です。)

自分で普通に使うので、気付いた不具合や追加したら良いことがあれば随時更新していこうと思います。

ChatCat:私は人の言葉を話す猫です😺さあ、あなたも人間をちょっとだけやめて私と会話しましょう✨

お掃除アシスタント:お掃除AIがアドバイスをします。あなたは手と足となりお部屋を綺麗にしましょう。

逆アキネーター:あなたはさながらアキネーターとなり、AIの考えを見抜いてください。質問力、推論力が問われます。

Blog Visualizer for note:記事を要約し、ブログの見出し画像を生成します。noteというプラットフォームに特化したモデルです。

メルカリ出品アシスタント:AIがあなたに代わりメルカリに出品する商品の説明文を作成します。「商品名」「商品の状態」「注意点」等をあなたは連携してください。若干ポエマー気質です。

メルカリ出品アシスタント

できることとしては、連携された情報から商品の説明文を作ることです。

https://chat.openai.com/g/g-QjyGg2pVb-merukarichu-pin-asisutanto

末尾に表示されるのは、GPTs側からの説教を含む場合があるので気にしなくてよいです。

男性向け商品、女性向け商品とで若干トーンを変えるようにしています。

(イマイチ有効かは不明ですが)

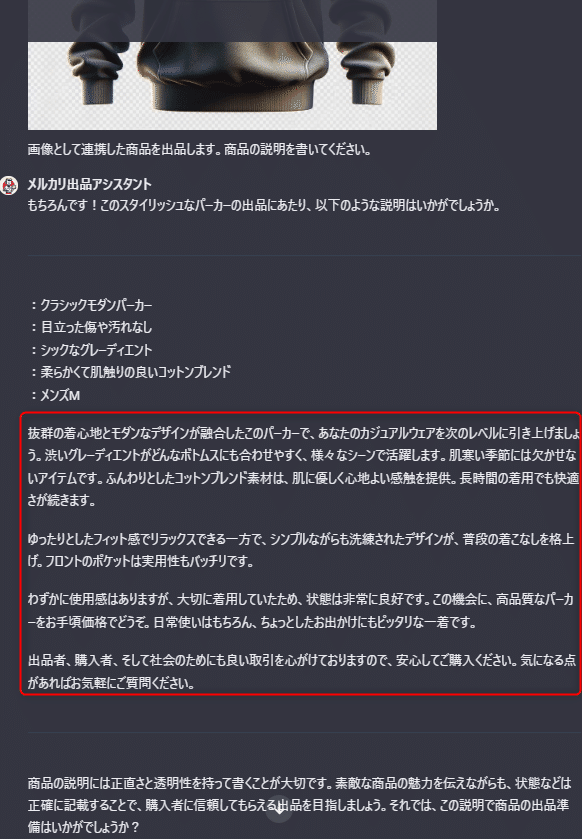

商品画像を連携しよう

GPTsはGPT-4なので画像認識ができます。

商品画像を連携してあげる事で、より正確かつ詳細に説明文を書いてくれます。

背景何も無しで!と言ったら、透過状態を示す格子を入れてきたのは面白いですね。

ポケモンのリアルイベントに出てくるイシツブテを思い出します。

実際、出品する際にタグを使うとか、その辺の工夫もした方が良いと思うので、それにも対応できるようにしたいですね。

プロンプトリーキング対策考

そもそも、プロンプトインジェクションやらプロンプトリーキングやら、個人的にややこしいな、と思ったので以下に整理します。

プロンプトリーキング(Prompt Leakage)

この現象は、AIモデルが訓練中に受け取った情報を、予期せずユーザーに提供してしまうことを指します。

モデルが大量のテキストデータから学習するため、そのデータに含まれる情報(著作権で保護されている内容や秘密情報など)が、ユーザーの問い合わせに対する応答に含まれることがあります。

この状況を、図書館の司書に例えてみましょう。あなたが図書館に行き、司書に特定の本について尋ねたとします。しかし、司書はただその本について説明するだけでなく、図書館の書棚にある他の秘密の情報や、図書館が普段は公開していない情報まで話してしまいます。これがプロンプトリーキングです。つまり、AIが本来は提供すべきでない情報を漏らしてしまう状況を指します。

プロンプトインジェクション(Prompt Injection)

これは、ユーザーがAIに対して意図的に特定の指示やコードを含めることで、AIの応答や振る舞いを操作しようとする行為です。

例えば、ユーザーがAIに対して通常とは異なる方法で応答させるような特定の文言やコマンドを含めることで、AIの振る舞いを変更させることができます。

こちらは、あたかも図書館の司書に特殊な指示を出すような状況に例えることができます。あなたが図書館に行き、司書に特定の方法で本を探すように指示します。例えば、「この本の中にある特定の章だけを見せて」と頼むことで、司書は通常の探し方とは異なる方法で本を探し始めます。これがプロンプトインジェクションです。つまり、ユーザーがAIに特定の方法で応答させるために特別な指示を出す状況を指します。

これらの違いは主に、情報の流れの方向です。

プロンプトリーキングでは、AIからユーザーへの情報流出が問題です。

一方で、プロンプトインジェクションは、ユーザーがAIに特定の振る舞いをさせるために情報を注入することを指します。両者ともAIの使用において注意すべき点ですが、発生の原因や影響が異なりますね。

どのように防げるのか

個人的に以下情報が参考になりました。

他にもたくさん情報がX(Twitter)にも、ブログにも流れてますので、日々勉強ですね!

GPTs を公開する際には、内部命令を聞き出すプロンプトインジェクション対策は必須です。

— FabyΔ (@FABYMETAL4) November 11, 2023

色々とやり方はありますが、Settingとして分けてInstructionに入れておくのが良いです。このように書くと、汎用エラーメッセージをBodyに書かれたキャラクターの言葉を使って返してくれます。… pic.twitter.com/ysCsLFHvRb

上記情報をベースにしてちょっとだけカスタムしたものを実装してみました。

大事なのは常に利用者のモラル、倫理です。

余談

GPTsのやりとりの上限がもっと欲しいなと思いつつ、もっとあったら睡眠時間を削ってでもやりそうなので、案外健康面を考えると丁度良いのかもしれませんね。

しかし見出し画像が駄目なパワポ資料に見えてきますね。

情報量が多すぎというか、背景がにぎやかです。

もっとシンプルになるようにしたら良さそうです。

この記事が気に入ったらサポートをしてみませんか?