【AIアニメ時代】AnimateDiff WebUI登場🧐Colab版との違い説明やエラー対策も伝授🥳

皆様ご機嫌いかがですか。

誕生日にチョコドーナツを頬張りながら記事を書いています新宮ラリです😸

先日AnimateDiffの SD WebUI対応のエクステンションが急遽リリースされました。

私のYoutube動画からのセルフ切り取りの形で解説致します。

恐らく、動画での解説を見た後で復習用に使われた方が分かりやすいと思います。

それでは早速行ってみましょう🤗

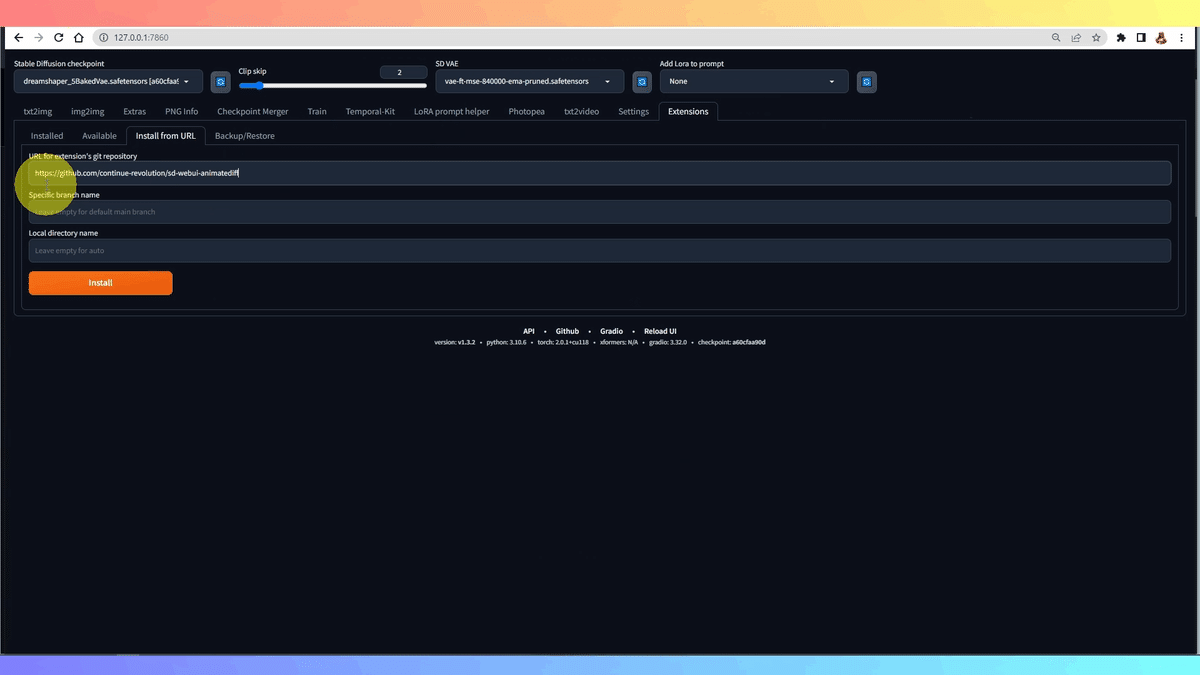

AnimateDiff WebUIインストール方法

インストール方法については従来のエクステンションと一緒ですね。

https://github.com/continue-revolution/sd-webui-animatediff

こちら↑のURLをCtrl + Cでコピーして、 WebUIの一番上の右端エクステンションズからInstall from URLにCtrl + V でペーストしてインストールします。

インストールが完了しましたらApply&Restartで再起動してください 。

再起動後に、txt2imgとimg2imgの両方の下に、AnimateDiffのタブが出来上がっているのが確認できます。

下三角で開きます。

モーションモジュールっていうのが 前回の WebUIでもあったSD14とSD15ですね。(AnimateDiffの心臓部です)

下のEnabel AnimateDIffボタンが有効ボタンで、Video frame numberは前回の google Colabでもあった、Video Length(動画の長さ)がこのフレームナンバーに当たるものです。

Frame per SecondはFPSですね。動画の考え方で言いますと、数字が増えるほど 動画が細かくなって、枚数が増えるので時間がかかるという感じですね。

生成時間がすごくかかるので、8フレームから始めてみてもいいかと思います。

インストールの続き

インストールは、これで終わりではなくて、このモーションモジュールのモデルをダウンロードしないといけないんです。

Githubの説明では画像生成を始めたらモデルが自動的にダウンロードされると書いてあったんですが、私の場合はモデルがダウンロードされなかったので、一応マニュアルでのダウンロード方法も解説しておきます。

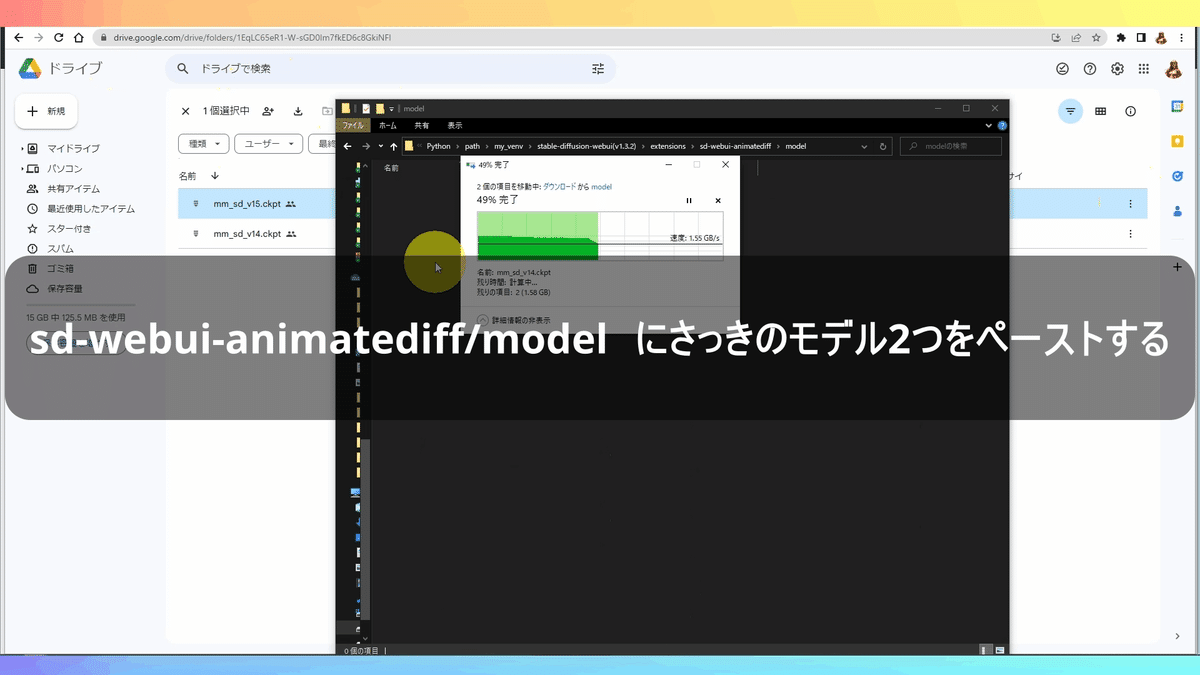

https://drive.google.com/drive/folders/1EqLC65eR1-W-sGD0Im7fkED6c8GkiNFI

こちら↑の google ドライブのページにモデルが2つ置いてあるので、右のボタンからそれぞれ2つダウンロードしてください。

モデルのダウンロードが終わりましたらmm_sd_v14とv15の2つがあると思います。

これを Ctrl + Xで切り取りしていただいて、

Stable Diffusion WebUI >extentions > sd-webui-animatediff の中に新しくフォルダーを作ります。

新規フォルダの名前をmodelにして作成、作ったmodelフォルダの中に

Ctrl + V で先ほどのmm_sd_v14とmm_sd_v15をペーストしてください。

終わりましたら念のためにステーブルディフュージョンを一度再起動してください。これでインストールは終了です。

トラブル発生😨

早速テストしていきたいと思います。はいできました!

めちゃくちゃ早かったんですが…

AnimateDiffプロセスエンドってなってるのに、静止画像しか出てきてないんですよね… すでに出来てますが、動かないですね。

これでですね、私これを試したところこのようなエラーが出て、 実際のフォルダの中には1枚のGifファイルだけが生成されて、動かない静止画のGifファイルだけが出てました。

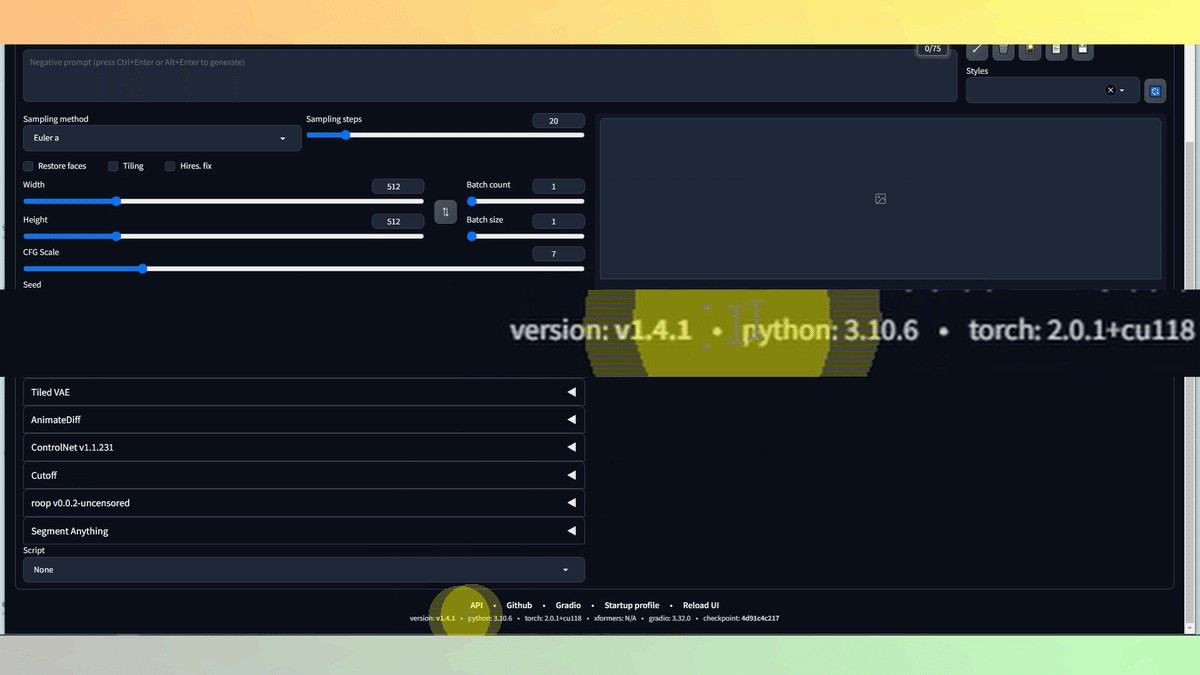

1回目の生成は1枚の静止gifが出来て、 2回目に試すとこのような感じのエラーが出ました。 WebUI1111を1.41に更新したら直ったとの報告を見たので、私は1.3.2を使っていたんですが1.4.1に更新しましたら動くようになりました。

StableDiffusion WebUI更新の仕方😇

念のために WebUIの更新の仕方も解説しておきます。

ただし注意点があるんですが、このWebUIを更新して不具合で動かなかったりすることがありますので、必ず WebUIのバックアップを取るようにしてください。

更新方法ですが WebUIのフォルダに行って、何もないこの辺でShifを押しながら右クリックをします。

そうしますとPowershellウィンドウをここで開くと書いておりますのでこれを押します。

Powershellが開きましたらここに git pull と入れてエンターキーを押します。

そうしましたら WebUI1111の最新バージョンに更新されます。

終わりましたらステーブルディフィジョンを再起動。

再起動しましたら一番下に v 1.4.1となっているのが確認できます。

AnimateDiffで作ってみる!

Sampling MethodにつきましてはEular a だとスピード重視ですね。DDIMの方が実写系には強いと言われております。

私はDDIMで試してみます。

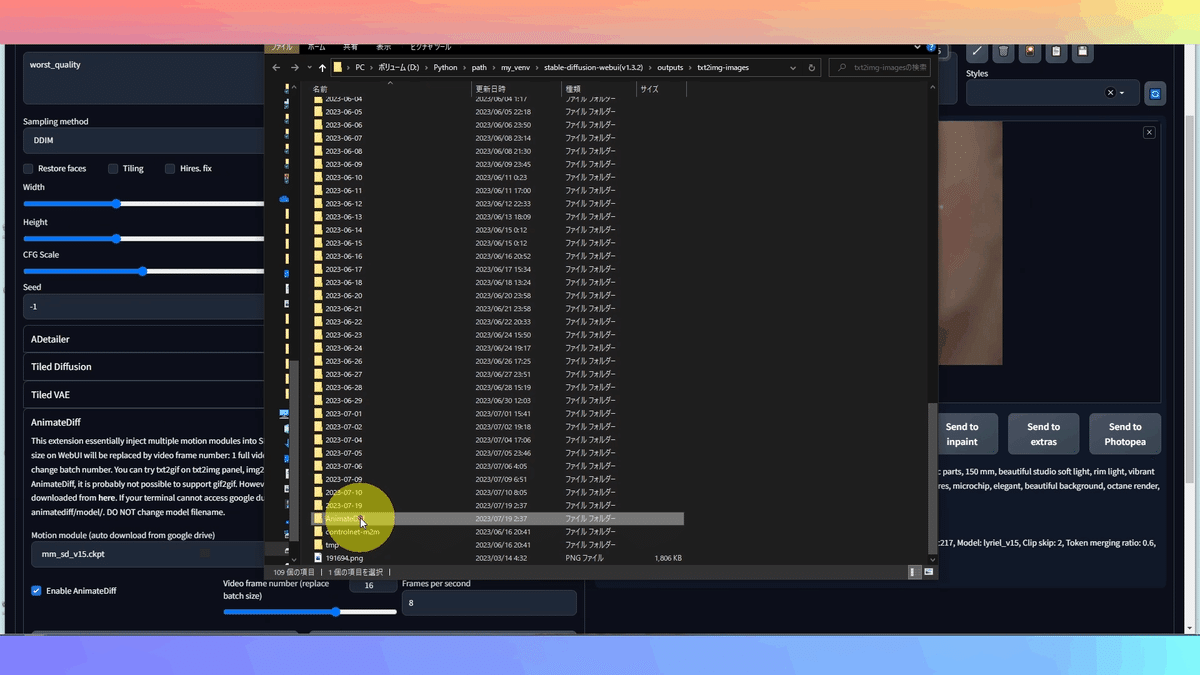

AnimateDiffのタブを開きましてモーションモデルを選びます。

AnimateDiffを有効化。

パラメータ数値は放置で16と8のままで生成ボタンを押します。

うまくいっていると結構時間がかかります。

失敗していた時は1枚ものだったので一瞬で終わったんですが、うまくいっているときは、こういった感じで16分割になります。

なんかうまくいきそうな感じがしますね。

はいできました!

出力フォルダーは左下のフォルダーアイコン押していただきますと、テキスト2イメージのフォルダーにアクセスします。

一番下に行くとAnimateDiffのフォルダーができています。

Google Colabで作った時は一つのGifアニメーションに3分くらいかかってたんですが、WebUIだと30秒って書いてますね。

3分が30秒に縮小されるといった感じでしょうか

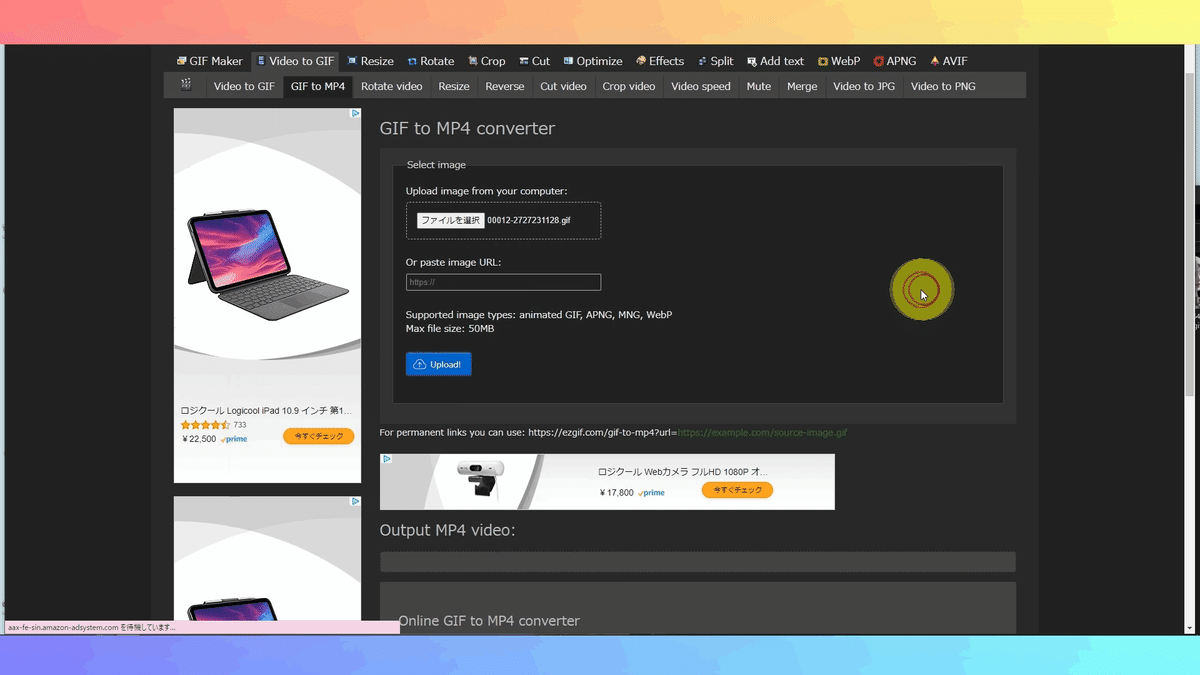

Gif→MP4変換やり方

ColabバージョンではGifからMP4に変換する機能があったんですが、今回はないのでアニメーションGifをMP4に使えるコンバーターのサイトを貼っておきます。

https://ezgif.com/gif-to-mp4 (多機能だけど広告多い)

https://convertio.co/ja/gif-mp4/ (変換機能のみ、広告無し)

こちらの使い方は超簡単で、ドラッグしていただいてアップロードをします。

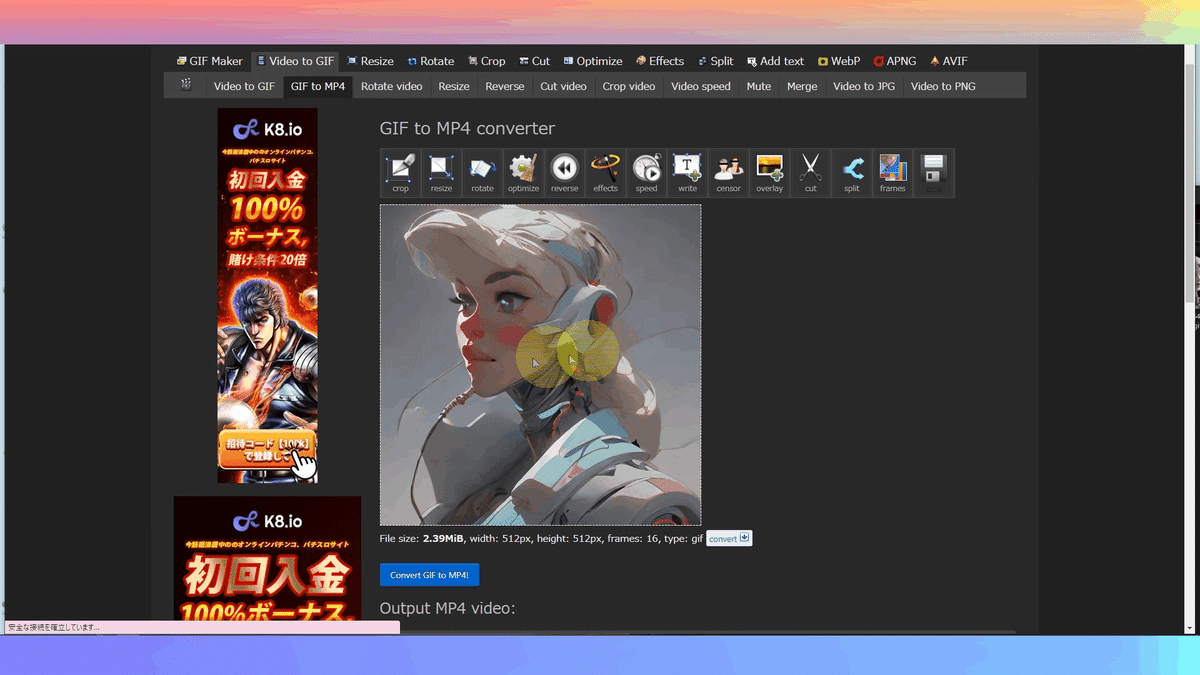

しばらく待つとプレビューが出てきます。

字を書いたりクロップできたりサイズなどできますので試してみてください。

決まりましたらこのConvert Gif to MP4ボタンを押してください。

できたMP4動画で一応右下を押してダウンロードでもいいですし、右端のフロッピーマークのセーブボタンでもダウンロードできます 。

WebUI版AnimateDIffと本家AnimateDiffの違いって何なの?🤔

今回のAnimateDiffで気づいたんですが、やはりオリジナルのAnimateDiffとは全く別の描写をしますね。

開発者さんの説明にもあったんですが、

WebUI版はオリジナルのAnimateDiffとはRandom Tensorの生成を全く異なる方法で実装しているため、大規模なコード修正なしにはオリジナルのものと全く同じにはできないとのことです。

なのでやはり同じブロンプトで同じモデルを使っても全然違った感じに出てきます。

あともう一つ注意事項なんですが

質問:Gif画像の代わりにビデオ(MP4)を生成できますか?どのくらいのVRAMが必要ですか?

答え:現在のところRTX 3090経由でこの拡張機能を使ってWebUIで実行することができます。

その他のGPUのについては保証ができません。

MP4を生成することはできません。

トランスフォーマーを使うのにGPUを酷使しているので、その状態で動画も作れるほど余裕がありません。

WebUI版とオリジナル版の画質比較

これに関しましてはYoutubeの方が見やすいかと思いますので、後日動画で発表させて頂きます🤗

よろしければチャンネル登録して頂くと、動画アップの通知や、Youtubeコミュニティーでのお知らせも見れますので、よろしくお願い致します。

新宮ラリのAIシンギュラリティーチャンネル ↓↓↓

この記事が気に入ったらサポートをしてみませんか?