NVDAのGTC WRAP UPの内容(特にメタバース関連のOmnineverseに注目)

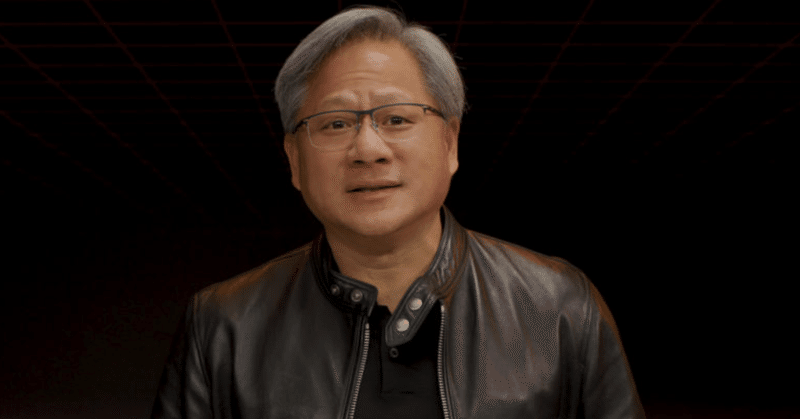

自動運転車、アバター、ロボット工学、地球の気候モデルなど、あらゆる分野で現実と仮想の世界のシミュレーションを実現するNVIDIAの創業者兼CEOであるジェンセン・ファン氏は、火曜日、数兆ドル規模の産業を変革する技術を紹介しました。

フアン氏は、NVIDIA Omniverse AvatarとNVIDIA Omniverse Replicatorをはじめとする多くの発表、デモ、広範囲に及ぶ取り組みを紹介した、NVIDIAのバーチャルGTC集会で基調講演を行いました。

フアン氏は、NVIDIA Omniverse(3Dワークフローのための仮想世界シミュレーションとコラボレーションのプラットフォーム)が、NVIDIAの技術をどのようにまとめているかを紹介しました。

また、カスタマーサポートのためのProject Tokkioや、Omniverse Avatarを使ったビデオ会議のためのProject Maxineのデモを披露しました。

フアンは、「Omniverseが、倉庫、工場、物理的・生物学的システム、5Gエッジ、ロボット、自動運転車、さらにはアバターなどのデジタルツインをシミュレートするためにどのように使われているかということが、皆さんが目にする一貫したテーマです」と述べました。

フアンは最後に、NVIDIAが気候変動のシミュレーションと予測のために、E-2(Earth Two)と呼ばれるデジタルツインを構築することを発表しました。

フルスタック、データセンタースケール、そしてオープンプラットフォーム

加速されたコンピューティングが現代のAIを立ち上げ、それが起こした波が科学や世界の産業に訪れているとフアンは述べました。

それは、GPU、CPU、DPUの3つのチップと、DGX、HGX、EGX、RTX、AGXというシステムから始まり、クラウドからエッジまでを網羅するという。

NVIDIAは300万人の開発者のために、グラフィックスやAIからサイエンスやロボティクスまで、150のアクセラレーションライブラリを作成しています。

そして、NVIDIAはGTCで65の新規および更新されたSDKを紹介しています。

"NVIDIAアクセラレーション・コンピューティングは、フルスタックでデータセンター規模のオープンなプラットフォームである "とフアン氏は語った。

フアン氏は、「これまでに作られた中で最も先進的なネットワーキングプラットフォーム」であるNVIDIA Quantum-2を紹介し、BlueField-3 DPUとともに、クラウドネイティブなスーパーコンピューティングを歓迎しました。

Quantum-2は、クラウド・コンピューティング・プロバイダーやスーパーコンピューティング・センターが必要とする究極のパフォーマンス、幅広いアクセス性、強固なセキュリティを提供すると述べました。

サイバーセキュリティは企業や国家の最重要課題であり、フアンはこの課題に取り組むための3本柱のゼロトラストフレームワークを発表しました。

BlueField DPUは、アプリケーションをインフラから隔離します。最新のBlueField SDKであるNVIDIA DOCA 1.2は、次世代の分散型ファイアウォールを実現します。NVIDIA Morpheusは、侵入者がすでに内部にいると仮定して、「加速コンピューティングと深層学習のスーパーパワーを使って、侵入者の活動を検出します」とフアンは述べています。

メタバース実現に向けたOmniverse AvatarとOmniverse Repricator

Omniverseによって、「私たちは今、新しい3Dの世界を創造したり、私たちの物理的な世界をモデル化したりする技術を手に入れました」とフアンは述べています。

開発者がOmniverseを使って、見たり、話したり、幅広いテーマについて会話したり、自然に話された意図を理解したりできるインタラクティブなキャラクターを作成できるように、NVIDIAはOmniverse Avatarを発表しました。

フアンは、Project Maxine for Omniverse Avatarが、コンピュータ・ビジョン、RivaスピーチAI、アバター・アニメーションおよびグラフィックスを接続して、リアルタイムの会話型AIロボットであるToy Jensen Omniverse Avatarを完成させる様子を紹介しました。

また、「Project Tokkio」のデモでは、レストランのキオスクに設置された接客用アバターで、2人のお客様を見て、会話して、理解することができます。

フアンはさらに、Project Maxineがバーチャルコラボレーションやコンテンツ制作のアプリケーションに最先端の映像・音声機能を追加できることを示しました。

デモでは、騒がしいカフェで女性がビデオ通話で英語を話している様子が映し出されたが、背景の雑音がないため、彼女の声ははっきりと聞こえます。

彼女が話すと、その言葉はリアルタイムでフランス語、ドイツ語、スペイン語に転写され、翻訳されます。また、Omniverseのおかげで、彼女と同じ声やイントネーションで会話ができるアバターが話しています。

NVIDIAは、AIの学習に必要な膨大なデータを開発者が作成できるよう、ディープニューラルネットワークを学習させるための合成データ生成エンジン「Omniverse Replicator」も発表しました。

NVIDIAは、一般的なロボット用のレプリケーター「Omniverse Replicator for Isaac Sim」と、自律走行車用のレプリケーター「Omniverse Replicator for DRIVE Sim」を開発しました。

昨年末の発売以来、「Omniverse」は500社のデザイナーによって7万回ダウンロードされました。

Omniverse Enterpriseは、年額9,000ドルからご利用いただけます。

その他の記事でのOmniverseの補完的説明

以下の記事でOmniverseについて取り上げられています。

世界中の何百万人ものプロフェッショナルにとって、3Dワークフローは必要不可欠なものです。

自動車から製品、建物に至るまで、彼らが作るすべてのものは、まず仮想世界でデザインされたり、シミュレーションされたりしなければなりません。その一方で、ハイブリッドな職場環境に適応しながら、複雑なデザインに取り組む企業も増えています。

その結果、デザインチームは、3D制作パイプラインを管理しながら、リモートコラボレーションを改善するのに役立つソリューションを必要としています。そして、NVIDIA Omniverseがその答えです。

現在発売中のNVIDIA Omniverse Enterpriseは、様々な業界のプロフェッショナルが複雑な3Dデザインワークフローを変革するのに役立ちます。この画期的なプラットフォームにより、複数のソフトウェアスイートで作業するグローバルチームは、共有された仮想空間でリアルタイムにコラボレーションすることができます。

Omniverse Enterpriseは、従来のビジュアライゼーションのワークフローを強化する新しい機能を備えています。Omniverse Enterpriseは、あらゆる規模の3D企業に完全にサポートされたソフトウェアを提供する、新たなサブスクリプションです。

Omniverseの基盤となっているのは、Pixar社のUniversal Scene Descriptionというオープンソースのファイルフォーマットであり、ユーザーはアプリケーション間のリアルタイムな相互運用性によってデザインプロセスを強化することができます。さらに、このプラットフォームは、NVIDIA RTX技術をベースに構築されているため、クリエイターは、より速くレンダリングし、機会費用をかけずに複数のイタレーションを行い、最終的なデザインを驚くほどフォトリアリスティックなディテールで素早く実現することができます。

大手通信会社のエリクソン社は、Omniverse Enterpriseを使用して5G無線ネットワークのデジタルツインを作成し、信号の伝搬と性能をシミュレーションして可視化しています。エリクソンは、Omniverseの中で、Esri CityEngineからシーン、モデル、データセットを取り込んで、現実に近い都市規模のシミュレーション環境を構築しました。

Omniverse Enterpriseは、世界的なコンピューターメーカーであるBOXX Technologies社、Dell Technologies社、HP社、Lenovo社、Supermicro社を通じて世界中で販売されています。すでに多くの企業が、このプラットフォームの高度な機能を体験しています。

Epigraph社は、Black & Decker社、Yamaha社、Wayfair社などの企業に提供しており、物理的に正確な3Dアセットやeコマース向けの製品体験を作成しています。BOXX Technologies社は、Epigraph社がOmniverse EnterpriseとNVIDIA RTX A6000グラフィックスを用いて、より高速なレンダリングを実現するのを支援しました。Omniverseに搭載されている高度なRTX Rendererにより、Epigraphは必要な計算リソースを大幅に削減しながら、最終フレームの品質で画像をより速くレンダリングできるようになりました。

Media.Monks社は、HP社と共同で、Omniverse Enterpriseを用いて仮想世界でワークフローを強化・拡張する方法を模索しています。リモート・コンピューティングとコロケーション・ワークステーションの組み合わせにより、Media.Monksのデザインチーム、クリエイティブチーム、ソリューションチームは、より分散化された未来に向けてクライアントのデジタル変革を加速することができます。Media.Monks社は、NVIDIAとHPとのコラボレーションにより、ブランド仮想化の新時代に向けた新しいアプローチと、コラボレーション、リアルタイムグラフィックス、ライブブロードキャストの融合を模索しています。

Dell Technologies社は、GTCにおいて、Dell Precisionワークステーション、Dell EMC PowerEdgeサーバ、Dell Technologies Validated Designsを用いて、Omniverse社がどのようにハイブリッド・ワークフォースを推進しているかを紹介します。インタラクティブなパネルディスカッションでは、なぜユーザーが今日Omniverseを必要としているのか、また、デスクトップからデータセンターまで、より多くのプロフェッショナルがこのソリューションを導入するために、デルがどのように支援しているのかについて掘り下げていきます。

また、レノボは、Omniverseのような先進的なテクノロジーがいかにしてリモート・コラボレーションをシームレスにするかを紹介します。レノボ、TGX、NVIDIAの3社は、外出先でパワフルなモバイル・ワークステーションに接続する場合でも、オフィスに戻って物理的なワークステーションに接続する場合でも、データセンターで仮想的なワークステーションに接続する場合でも、リモート・ワーカーにオフィスでの作業と同じ体験を提供しています。

これらのシステムメーカーは、Kohn Pedersen Fox、Woods Bagot、WPPなど、Omniverse Enterpriseの他のお客様にも、リアルタイムコラボレーションによる効率と生産性の向上を実現しています

AIモデルとシステム

Huang氏は、Nemo Megatronを大規模な言語モデルのトレーニング用に導入しました。このようなモデルは、「これまでで最大のメインストリームHPCアプリケーションになるでしょう」と述べています。

最近のデータサイエンスにおいて重要なデータ構造であるグラフは、Pythonの新しいパッケージであるDeep Graph Library(DGL)によって、ディープニューラルネットワークのフレームワークに投影することができます。

火曜日に発表されたNVIDIA Modulusは、物理法則を学習し、それに従うことができる物理情報に基づいた機械学習モデルを構築し、訓練します。

また、すべてのワークロードに対応する推論サーバー「Triton」のアップグレードにより、森林モデルの推論や、大規模な言語モデルのマルチGPUマルチノード推論が可能になりました。

また、Huangは3つの新しいライブラリを発表しました。

ReOpt - 10兆ドル規模の物流業界向け。

cuQuantum - 量子コンピュータの研究を加速するためのもの。

cuNumeric - Pythonコミュニティの科学者、データサイエンティスト、機械学習やAIの研究者のためのNumPyを加速するためのもの。

NVIDIAのAI技術をベースにしたサービスをエッジに提供するために、フアンはNVIDIA Launchpadを発表しました。

NVIDIAは、データセンター大手のエクイニクスと提携し、世界中のデータセンターにNVIDIA AIをプレインストールして統合します。

ロボティクス

NVIDIAのIsaacエコシステムには、現在700社以上の企業やパートナーが参加しており、その数は過去4年間で5倍に増加しています。

フアンは、NVIDIA Isaac ロボットプラットフォームが、ロボットアプリケーション用のソフトウェアライブラリとツールのセットとして広く利用されている ROS(Robot Operating System)に簡単に統合できるようになったことを発表しました。

Omniverse上に構築されたIsaac Simは、これまでで最もリアルなロボットシミュレーターであるとフアンは説明します。

「目標は、ロボットが、自分がシミュレーションの中にいるのか、現実の世界にいるのか分からないようにすることです」とHuangは述べています。

このプロセスを支援するために、Isaac Sim Replicatorはロボットを訓練するための合成データを生成することができます。

リプリケータは、センサーをシミュレートし、自動的にラベル付けされたデータを生成し、ドメインランダム化エンジンにより、豊富で多様なトレーニングデータセットを作成することができるとHuang氏は説明する。

自律型運転車両

フアンは、「動くものはすべて、完全または大部分が自律的に動くようになるでしょう。「2024 年までには、新しい電気自動車の大部分が実質的な AV 機能を持つようになるでしょう」とも述べています。

NVIDIA DRIVEは、自律走行車のためのNVIDIAのフルスタックでオープンなプラットフォームであり、Hyperion 8は、NVIDIAの最新の完全なハードウェアおよびソフトウェア・アーキテクチャです。

そのセンサー群には、12台のカメラ、9台のレーダー、12台の超音波、1台の前面ライダが含まれています。これらはすべて、2つのNVIDIA Orin SoCによって処理されます。

フアンは、Hyperionに組み込まれているいくつかの新技術について詳しく説明しました。その中には、Omniverseをベースに構築された自律走行車用の合成データ生成システムであるDRIVE Sim用のOmniverse Replicatorも含まれています。

NVIDIAは現在、Hyperion 8センサー、4dパーセプション、ディープラーニングを用いたマルチセンサーフュージョン、フィーチャートラッキング、新しいプランニングエンジンを稼働させています。

車の中も革命的なものになるでしょう。 NVIDIA Maxineの技術は、私たちが車とどのように接しているかを再考します。

「Maxineがあれば、あなたの車はコンシェルジュになります」とフアンは言います。

この記事が気に入ったらサポートをしてみませんか?