Unityでリップシンクを導入する方法【uLipSync】

自己紹介

\ ココナラ実績160件達成 /

こんにちは!ゲーム開発所RYURYUのりゅうやと申します。

本記事では、Unityを使用して、音声に合わせた3Dアバターの口もとの動きを再現するリップシンクの導入方法について解説します。

はじめに

最近のゲームやアプリケーションでは、キャラクターのリアルな表情や動きが求められることが多くなっています。

その中でも、特に音声に合わせた口の動きを再現するリップシンクは、キャラクターの表現力を大幅に向上させる重要な技術です。

本記事では、UnityのアセットであるuLipSyncを使用して、簡単にリップシンクを導入する方法を紹介します。

リップシンクとは

リップシンク(Lip Sync)とは、キャラクターの口の動きを音声に合わせて同期させる技術です。

これにより、キャラクターが話しているかのようなリアルな動きを再現できます。リップシンクは、アニメーションやゲーム、VRコンテンツなどで広く利用されています。

uLipSyncとは。

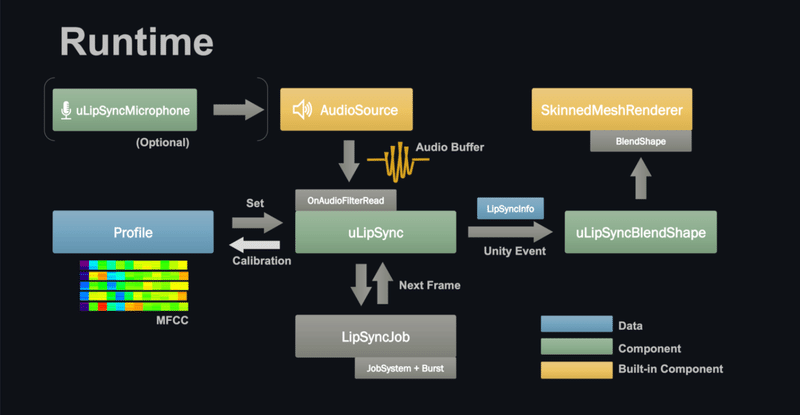

uLipSyncは、Unity向けのリップシンクアセットです。

このアセットを使用することで、簡単にキャラクターの口の動きを音声に合わせて制御することができます。

uLipSyncは、音声解析とBlendShapeを利用してリップシンクを実現します。

BlendShapeとは。

BlendShapeとは、3Dモデルの特定の形状変化をアニメーションさせるための技術です。

リップシンクでは、口の動きを表現するために複数のBlendShapeが使用されます。

例えば、「あ」「い」「う」「え」「お」の各音に対応する口の形状をBlendShapeとして設定し、これを音声に合わせて制御します。

uLipSyncをダウンロードする。

①下記のURLの[Code] > [Dawnload ZIP] よりデータをダウンロードします。

②ダウンロードデータを解凍します。

③解凍データをUnityのプロジェクトビューへドラッグ&ドロップする。

uLipSyncの利用方法

【3Dアバターの準備】

リップシンクを適用するために、3Dアバターを用意します。

アバターにはリップシンク用のBlendShapeが設定されている必要があります。

最初に試す場合は、無料のモデルであるUnity-Chanのダウンロードをオススメします。

【リップシンクに必要なコンポーネントの追加】

• アバターのGameObjectを選択し、「Add Component」ボタンをクリックして、下記の4つのコンポーネントを追加します。

1. Audio Source

2. U Lip Sync

3. U Lip Sync Blend Shape

4. U LIp Sync Microphone

【リップシンクに必要なコンポーネントの設定】

「BlendShape Mapping」セクションで、各BlendShapeと音声の対応を設定します。

例えば、「あ」音には「Mouth_A」というBlendShapeを対応させます。

U Lip Sync コンポーネントで、音声に合わせて BlendShape が更新されるように設定を変更します。

プロファイルには、uLipSyncに既存のデータを利用することも、自分で作成することもできます。

U Lip SyncのAudioSourceProxyに、U Lip Sync Audio Source コンポーネントを設定して、紐づけを行う。

マイクの入力デバイスを選択します。マイクの入力を利用しない場合は、AudioSourceで再生された音源に合わせてリップシンクをします。

【リップシンクのテスト】

設定が完了したら、再生ボタンをクリックしてリップシンクの動作を確認します。音声に合わせてアバターの口が動いていることを確認しましょう。

おわりに

リップシンクに関してご不明な点や開発代行のご依頼がありましたら、ぜひゲーム開発所RYURYUのサービスをご利用ください。

私たちは、テキストやビデオチャットによるサポート、開発代行、そして「リップシンクを利用したアプリ」の受託開発も行うことが可能です。

ご興味のある方は、以下のリンクからぜひお問い合わせください。

\ 無料相談・お見積もりは公式LINEから /

【自己紹介】

はじめまして、ゲーム開発所RYURYUの"りゅうや"です。Unityを利用したゲーム・VR開発が得意です。お客様の期待に応えるため、迅速かつ丁寧な対応を心掛けております。

【ゲーム開発所RYURYUとは】

「あなたに、テクノロジーの翼を」をコンセプトに、Unityを活用した「ゲーム・VRの受託開発」「Unity開発のサポート・レクチャー」「オンライン動画教育サービス」を展開するゲームスタジオです。

TOP記事

よろしければサポートお願いします! いただいたサポートはクリエイターとしての活動費に使わせていただきます!by ゲーム開発所RYURYU