Einstein Analyticsの導入順番はレシピ→データフローだと思う

Einstein Analytics講習に来ています。三日間のうちのDAY2です。事前に、勉強&実践していたので割とサクサクと頭に入ってくるので、ノウハウ的なことについて質問する形ですすめています。

講習の流れとしては、昔からあるデータフローをやってからレシピに移行する形になっているのですが、おそらく逆のほうがいいですねこれ。

レシピとデータフロービルダーの違い

機能的な差異はほとんどなくなってると思います。Einsteinノードがレシピだと使えないっていうくらいしか差がないのでは。

あとは、JSONファイルがレシピだと手に入らないみたいです。

レシピのより玄人版がデータフローだという認識で良いでしょう。

レシピをまずはじめにやる理由

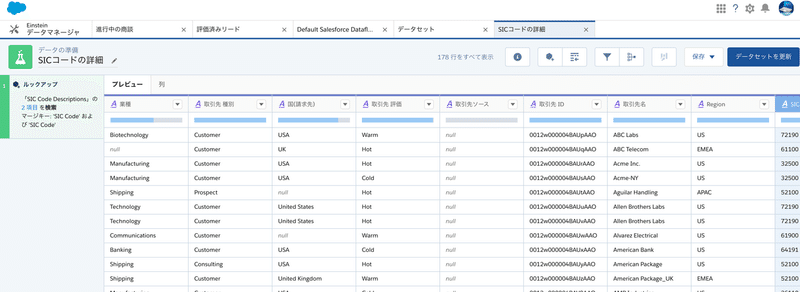

GUIがよく出来てるからです。データの内容のプレビューもあるし、SalesCloudでレポートに慣れ親しんだ人なら、わかりやすい流れになっていると思う。

ここで、データの結合方法・フィルタ・データの変換・バケット化みたいなところをマスターしておけば、十分戦力になります。sfdcDigestとかいって出力しなくても、レシピを保存して右上にあるデータセットを作成ボタンを押すことでデータセットが作られ、すぐさま利用可能です。フローを気にするまでもないですね。

そしてこれを理解しておけば、データフローは余裕だと思います。

データフローを使うシーンとは?

Einsteinノードは、ノードの手前までに作ったデータをEinsteinのモデルに通して、スコアを得るというノードです。Einsteinのモデルでスコアリングした結果を使ったレンズを作りたい場合はデータフローを通してsfdcDigestでデータセットを出力する必要があります。これもそのうちレシピに加わりそうな気がするのですが(笑

あとは、データフローっていうくらいなので、データの流れが視覚的にわかります。レシピでも、左カラムに処理の順番が書いてあるので一応そこがフローだろうなというイメージではあるのですが。

Date項目に会計年度のオフセット入れるみたいなものはこちらで教えられることのほうが多いかもしれません。

データフローはアップデートが来る

もうすぐリリースになるはずなのですが、データフローがもっとリッチになる予定なので、そこで住み分けがなされるのかな。Sales CloudやMarketing Cloudのフローエディタに似た形式になるようです。

noteにはこれまでの経験を綴っていこうかと思います。サポートによって思い出すモチベーションが上がるかもしれない。いや、上がるはずです。