GPTハルシネーションの変転

Chat GPTで"エゴサーチ"をしたことはありますか?

今年の初めくらいは、かなり適当なストーリーを紡いでくれました。

例えばこんな感じ。

夢のある経歴を並べてきた(笑)

2023年の初め頃

おぉ!ボクはアルファロメオのデザイナーとして活躍中だ。。あはは、全く身に覚えがない夢のストーリー。

このような「AIが"それっぽい嘘"をつく」現象は、ハルシネーション : 幻覚 [*1]と呼ばれ、生成AIの問題と認識されるようになりました。

そして、GPTのアップデートは日々行われ、同じ質問に対しても違う振る舞いをみせるようになります。

GPT4が出た頃からはは、わからないことには「データが無いのでわかりません」と真っ当な受け応えもするようになりました。

「澤井大輔というカーデザイナーに関する情報は、私のデータベースには存在しません。彼はおそらく知名度が高くないか、現時点では存在しない架空のキャラクターである可能性があります…」

知名度が高くない…その通りだよ。苦笑。夢もへったくれも無いじゃないか。

それが、直近の’23年末となると、23年4月までのデータを学んでいることに加えて、ネットブラウザ機能も追加され進化してきました。

そこで、また同じ質問をすると…

検索先のリンクもついている

おぉ…瞬間でネットをブラウジングして、ひとまとめ。

まだ完全ではなさそうですが、参照先もわかるのでチェックするのも簡単。

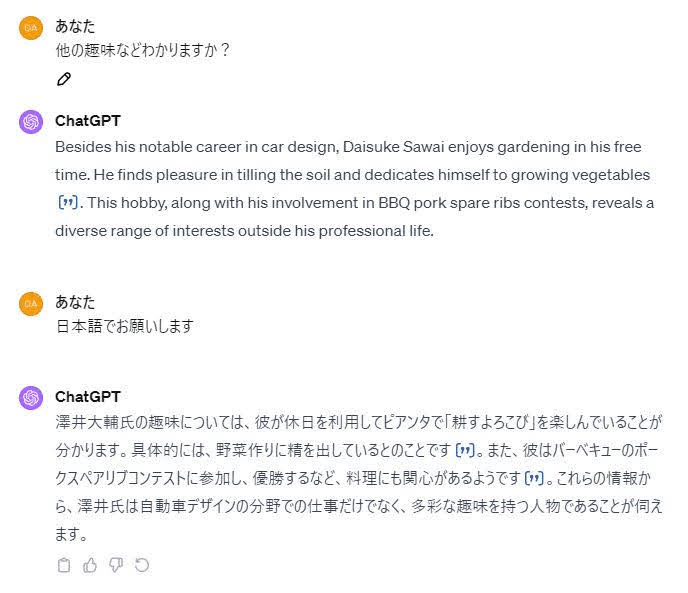

追加で、彼の趣味は何か?と問うと…

全ての情報が繋がるのも時間の問題

しっかりと、どこかのインタビューで喋ったことから趣味に関することを抽出し、繋げて出してきました。

生成AIが出た当時は、Google検索とは違う存在だと考えていましたが、明らかに新たな時代の検索エンジンとしても機能するようになっています。

この先間違いなく起きるのは、ネット上の個人データの統合。初期の頃は、正確性などもないだろうけど、あっという間に進化して、匿名で投稿していたことも、何かしらのアルゴリズムで同一人物のものと認識されるようになるでしょうね。X(旧Twitter)などで変な呟きなどしていたことも、全部繋げられてしまう…リポスト(旧リツィート)も安易にできない⁈

逆のケースは、個人情報を隠し過ぎることで不便や不利益になることもあり得ると思う。

誰にも読まれなくてもnoteは書くべき理由でもある。

どちらにせよ、AIの凄まじい進化を意識してSNSなどと向き合った方が良いでしょうね。

個人的には、間違った情報がコピペされて二次情報、三次情報として拡散され、事実のように扱われる"ポストトゥルース"問題[*2]が解決されることを願います。

生成AIが生み出す"ハルシネーションの作り話"より、他人の生んだ偽情報を鵜呑みにしてコピペ拡散する方が余程問題があると思うのですが、どうでしょう?

今後、益々情報リテラシーが問われます。

*********

*1

ハルシネーション : Hallucination とは

AIのハルシネーションとは、人工知能(AI)が訓練データや現実の情報に基づかず、誤った情報や存在しないデータを生成することです。これはAIが予測や生成作業を行う際に、学習データの不足や偏り、アルゴリズムの制限などによって起こり得ます。例えば、AIが実在しない人物の肖像を描いたり、文脈に合わないテキストを生成したりすることがこれに当たります。

*2

ポストトゥルース問題

ポストトゥルース(post-truth)は、客観的な事実よりも個人的な信念や感情が公共の議論や政治的議論においてより影響力を持つ状況を指します。この用語は特に、ソーシャルメディアやニュースメディアが情報の拡散に大きな役割を果たし、事実の歪曲や偽情報が流布しやすい現代社会において用いられます。ポストトゥルースの時代では、事実よりも感情や個人的な信念が重視され、公平で真実に基づいた議論が困難になる傾向があります。

この記事が気に入ったらサポートをしてみませんか?