AIでヌルヌル動画を生成する方法を一挙公開!自分だけのオリジナル動画を作ろう

拝啓

AI大好きな皆様いかがお過ごしでしょうか。

まずはこちらをご覧ください。

#AIart #AI #AI美女 #AI動画

— CIG(健全AIグラビア) (@cigmatari) October 3, 2023

おはよっボーン! pic.twitter.com/tn3WiK8ura

ご紹介が遅れました、

ヌルヌル動画・ギャル乳膨らまし職人ことCIG(健全グラビア)です。

誰がなんと言おうと健全です。

わたしは最近AIで動画を生成することに生き甲斐を感じております。

ご存知の方もいるかと思いますが、AnimateDiffの技術を利用しています。

この技術が公開されしばらくすると、

TDSさんという方が2枚の画像から動画を作る技術を公開しました。

Stable Diffusion web UIのControlNetをAnimateDiffに対応させたブランチを公開しました

— TDS (@TDS_95514874) August 23, 2023

2枚の画像から動画を作れます

ControlNetは近々大型アップデートがあるそうなので、プルリクエストはその後になる予定です

試したい方は現行のVerを使用してください

使用法は続きです pic.twitter.com/4mSFQ2mpIh

天才か!?

しかし、環境設定がわたしには難しく、

変化なく髪がふよふよする動画しか作れず枕を濡らしました。

「動かねぇよ…しくしく。」

そこへ救世主が!

プロンプトだけで簡単に動画を生成できる『簡単プロンプトアニメ』のローカル版です。https://t.co/cQf3hpmoXg

— Zuntan (@Zuntan03) September 21, 2023

セットアップ・ダブルアプスケ・フレーム補間などを自動化しています。

VRAM 8Gから使え、RTX 3060 12GでFHD相当

作例は一発出し無調整(FHDは流石に生成長い)https://t.co/uOXsQy6Qxd pic.twitter.com/wV7m20ZbP6

Zuntanさんありがとう!

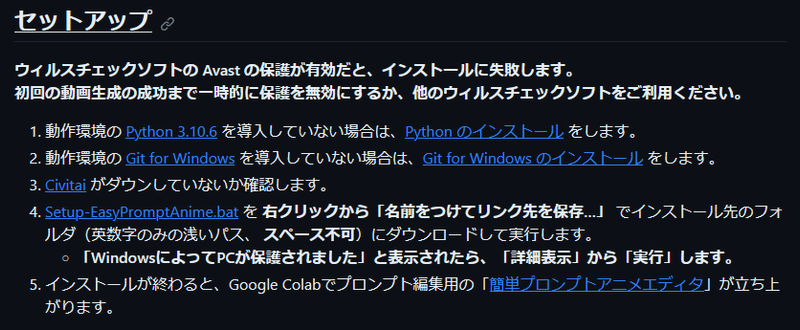

EasyPromptAnimeのはじめ方

・ページ内にある動作環境を確認する

・ローカルにインストールする(git cloneするなりZIPをDLするなり)

srcフォルダ内にある

Setup-EasyPromptAnime.bat を実行

・動作確認 sample/UpscaledGacha.bat を実行してみてください。

動画のテスト生成がはじまります。

・簡単プロンプトアニメエディタを使う

導入したら

・OpenColabEditor.batをダブルクリックするとブラウザが起動

簡単プロンプトアニメエディタ(Colab上)画面へ

(1個目の▶を押す)

①ヘッダー(H:)、フッター(F:)、ネガティブprompt(N:)を書く

※ L: でLoRAも足せるよ!

②フレームごとにpromptを書く

prompt例)

0: closed eyes,

10: surprised

20: smiling, head tilt,

30: sleeping

③model設定する

(マージしたmodelなどmodel名が長いとエラーが起こるので注意)

(2個目の▶ を押す)

jsonがcolabで書き出される

DLしたjsonファイルをGenerate.batにドラッグ&ドロップする

(GenerateForever.batで無限生成)

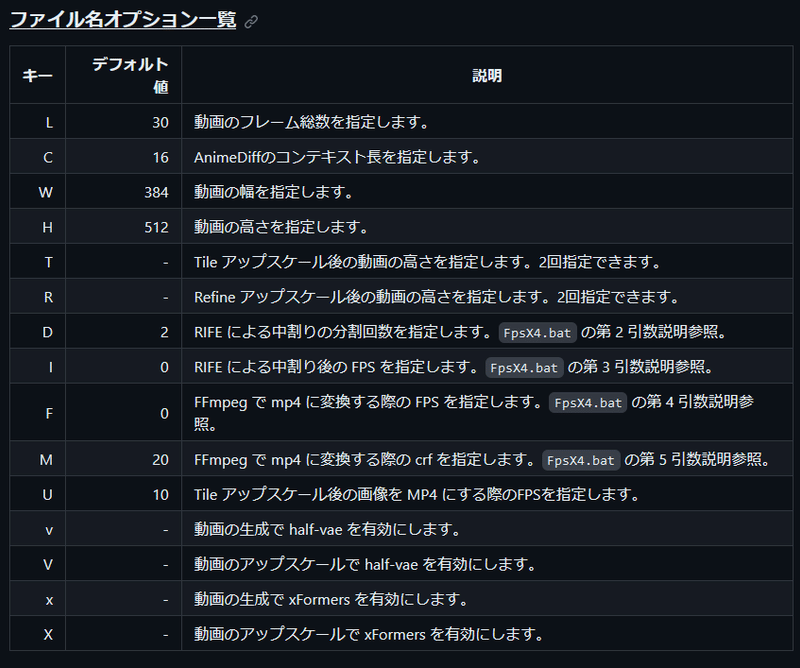

※jsonのファイル名が生成の動画サイズや長さを調整するコマンドになっているので各自調整してください。

わたしの場合は

ファイルの名前-L50-C16-W448-H512-T1024-v-V-x-X.json

として少し長い動画をつくったりしています。

(instagram投稿は3秒以上必要なので)

ファイルの名前の部分は全角にしておくとコマンドと干渉しないので無難。

Generate.batにjsonを入れるとコマンドが走り、

jsonと同じフォルダに3つの動画が生成されます。

1)オリジナルがupscaleされた動画

2)フレーム補完されヌルヌルfps化した動画

3)軽量化した動画

おめでとう 無事終わりです。

さて安心したところでEasyPromptAnimeフォルダを確認すると

・animatediff-cli-prompt-travel

・RIFE

・ffmpeg

といった技術の塊が並んでいます。

フレームごとに指定のpromptで書き出されたpng

→動画化

→upscale

→ヌルヌル化

→軽量化

この全体の流れが自動化されています。

この場を借りてZuntan氏に感謝申し上げます。

さらにbatファイルもたくさん並んでいますね?

たとえばFpsX4.batにヌルヌル化前の動画(1)を入れると2・3が出力されます。便利です。

ここまで来ると全容がわかってくるハズです。

(おまけ)一貫性を追加しよう

#AIart #AI #AI美女 #AI動画

— CIG(健全AIグラビア) (@cigmatari) October 4, 2023

動画に一貫性を持たせるテストに成功したにゃ! pic.twitter.com/NatVdSwVXx

まず、1歩前の前提の段階、AI画像の生成についてお話します。

それはノイズ画像を元にpromptの導きに合わせて最終的に指定の画像を生成するという流れになっています。

さてここに2コマ目、3コマ目として時間の概念を入れようとすると

某監督に生命の侮辱と一喝されることうけあい

promptで制御しきれないキャラクターや背景が暴れ出し、

一貫性がとれていない液体のようにつながった映像となります。

(これはこれでAIらしくダイナミックで正直好きです。)

実はすでに動画生成の際に時間に対しての軸を通すため モーションモジュールという技術が使われています

mm_sd_v15_v2.ckpt ←こういうやつ(たぶん自動DLされてる)

場所: EasyPromptAnime\animatediff-cli-prompt-travel\data\models\motion-module

また、モーションLoRAという特化学習も作られています。きっとスクワットで太ももと臀部を鍛えるLoRAもいずれ出てくるでしょう。マジたのむ。

話を戻して、これだけでは物足りないという方向けに

IP-Adapterという ControlNetでもお世話になっている新技術を紹介します。

https://x.com/cigmatari/status/1701875729494081987?s=20

(技術共有💡)

— CIG(健全AIグラビア) (@cigmatari) September 13, 2023

今回かなりヤバい。

「IP-adapter」は画像を読ませてpromptとして使うモノ

・いつものモデル

・フリー素材(左の画像)

・prompt : 1girl

※注意※

plusはトレース性能と濃度が高すぎるので、オススメしづらいです。

どうしても使うならフリー素材を使うことをお勧めします。… pic.twitter.com/MWSyyXHuzi

これは画像を指定するとprompt化し衣装などの細かい情報を保持してくれるといった取り扱い注意の劇薬のような手法です。(トレースはアカン!)

フリー素材やご自分のAI生成画像などでお試しください。

さてEasyPromptAnimeでの使用方法です。

C:\AI\映像\EasyPromptAnime\EasyPromptAnime\animatediff-cli-prompt-travel\data\ip_adapter_image

こちらにtest0001フォルダを作りAI生成画像を入れてください

pngの名前は000.pngが無難とのこと⇐名前がフレームに影響するよ

※jpgは当方の環境だと読み込まれなかったので注意。

生成用jsonの記述にIP Adapterを追加しましょう。

追加する場所は lora mapの下です。

"lora_map": {

},

↓ココから下をコピペ↓

"ip_adapter_map": {

"enable": true,

"input_image_dir": "ip_adapter_image/test0001",

"save_input_image": true,

"resized_to_square": false,

"scale": 0.1,

"is_plus_face": true,

"is_plus": true

},"ip_adapter_image/test0001", フォルダ名は任意です。

"scale": 0.1, ←ココの値は画像promptの適用比率です。

1.0で画像promptが最大強調となります。

(prompt/ネガティブは空にしないほうが無難とのこと)

参照の画像と同じものをprompt/ネガティブに入れるのが好ましいです。

動画を同様に生成したら、

EasyPromptAnime\animatediff-cli-prompt-travel\output

の下部フォルダ内にオリジナルフォルダが生成されています。

その中に00_ip_adapter という参照画像が入ったフォルダが作られていればIP-Adapterの適用に成功しています。

他にもControlNet関連の項目は使えるので

こちらを参考にいろいろ試して投稿してください。

あと、記事を読んでいただいたみなさんに動画生成にトライしてほしいのはもちろんですが、

ZuntanさんやTDSさんのような技術のブレイクスルーが起きたときに

見落とさずハッキリ

かがくのちからってすげーーーー!!

と反応してその素晴らしさを広めていただきたいです。

そう、いいねとリポストを1000回連打する気持ちで。

みなさんの発信力はAIの世界にエネルギーを与えて底上げするパワーがあると信じております。

なので独占すればお金持ちやん!?ウハウハ!な技術を躊躇ゼロで公開しております。

これはもちろん先駆者の方も同様に考えておられるかと思います。

AIに触れドキドキした初心を忘れず、生成の喜びをアウトプットし共有された技術をまたインプットする循環の輪ができれば幸いです。

敬具

P.S.

ここからはお願いですが、

アウトプットに慣れてきたら自分ならこうする、というアレンジを加えてアウトプットしてください。

健全な動画ですよ?ホントに。

あとコーヒー代ください。☕

ではまた次の技術で会いましょう。

(追記:2023/10/13)

※現在は簡単アニメプロンプトのローカル版が出来ています。

EasyPromptAnimeEditor.bat(ローカル版)

IP adapterなども使いやすいハズなのでやり方が一通りわかった方はこちらを使ってみてください。

こちらはjson→D&Dの作業をスキップして動画生成がはじまるので注意

EasyPromptAnime\animatediff-cli-prompt-travel\output

jsonファイルでログが残っているので確認してください

CIG(健全AIグラビア)

この記事が気に入ったらサポートをしてみませんか?