BrushNet を使ってみた話

はじめに

AI画像生成界隈では、日々さまざまな技術が発表されています。この記事ではその中のひとつの BrushNet というものを試してみます。

公式レポジトリはこちら

「 A Plug-and-Play Image Inpainting Model with Decomposed Dual-Branch Diffusion」というものですが、精度良くインペイントするものの”ようです”(すみません、あまり深く見ていません)。

とりあえず使ってみます。導入方法は README.md に記載されています。Anaconda (conda) と pip を利用する導入方法です。

※ GUIのワンクリック・インストーラを利用せずに、コマンドラインでの標準的な導入方法をマスターしておけば、さまざまな最新のAIプログラムを利用する事ができます。パッケージ管理の話ですので、プログラマや技術者である必要はありません。コマンドラインで導入の基礎を理解しておくことで、GUIツールを利用したとしても、トラブルに対処する事も可能になります。

※(いまのところ BrushNet は記載していませんが)筆者がよく利用しているツールや Anaconda を利用したコマンドラインでの導入方法を下記にて紹介しています。 ほとんど同じですので、いくつかインストールを試せば、その流れと概要が理解できると思います。

実行する

簡単にデモを試せるように、Brushnet 作者が GUI(gradio)を用意してくれています。

python examples/brushnet/app_brushnet.py

下部にはデモ・サンプルが用意されています。

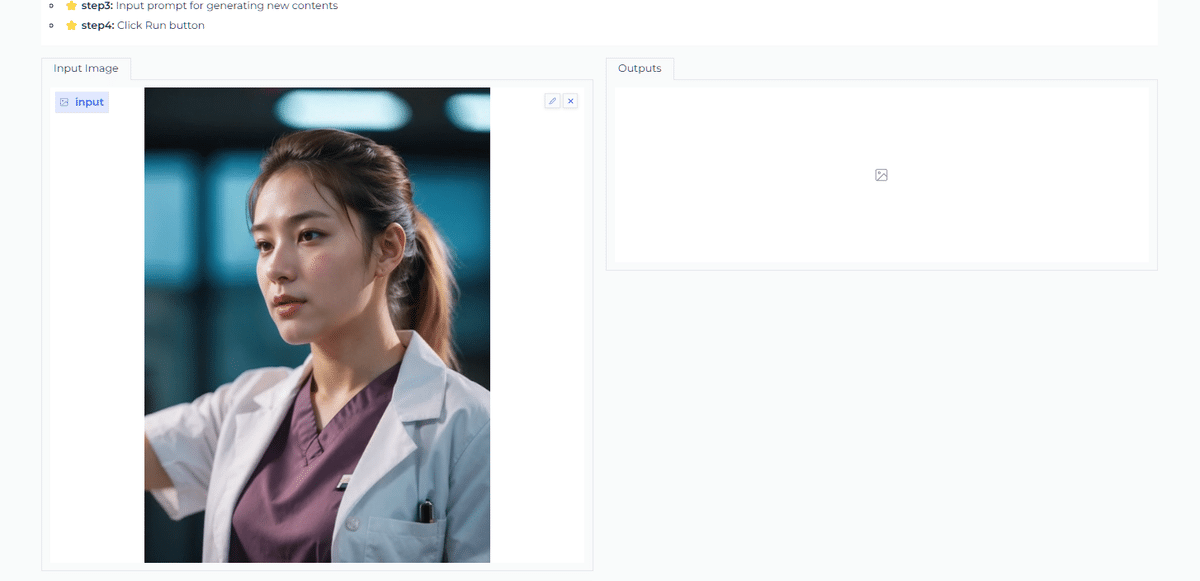

使い方ですが、まずは、左側の「input Image」に画像を読み込ませます。※ AI生成画像です

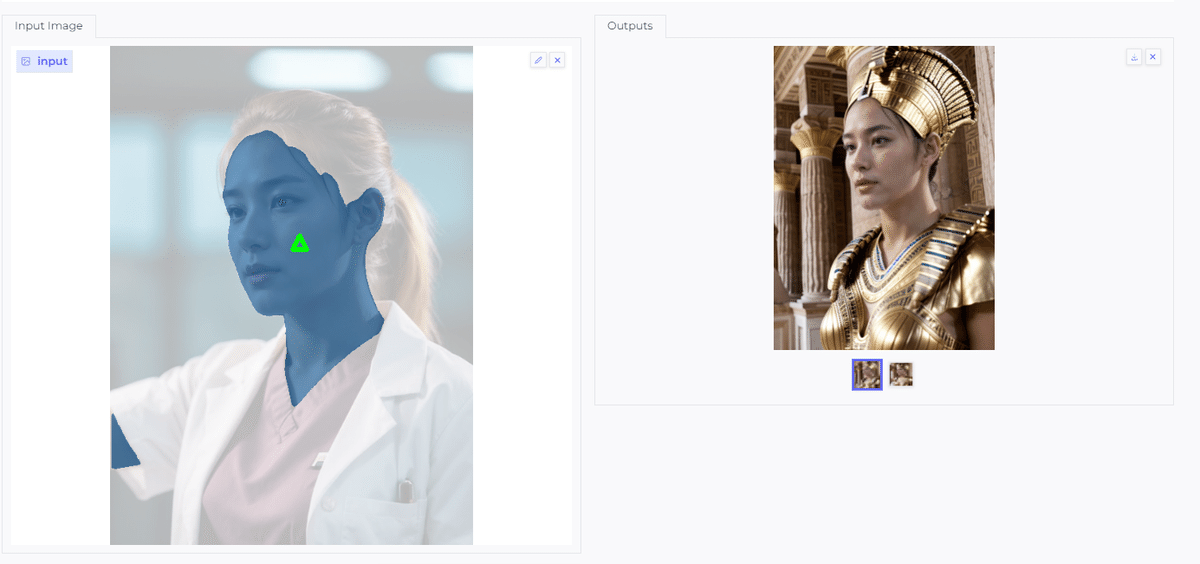

マスクを設定します。残したい箇所をクリックします。複数クリック可能です。

プロンプトを入力します。「wearing Egyption Cleopatra's gorgeous gowns in a hall, palace」としました。

Run で生成します。

服が変わりました。GUIでは解像度などは設定できないので、試してみる程度のものですが、webUI や ComfyUI に取り込まれれば、使いやすいツールになるかもしれません。

どちかかと言うと、アプリやアパレルメーカーが利用しそうな技術ですね。

モデルはデフォルトで用意されている realisticVisonV60B1 なので、あのメイド衣装は生成してくれませんでしたが、自分でモデルを diffusers 形式へ変換すれば他の SD1.5 モデルも利用できるとの事です。

この記事が気に入ったらサポートをしてみませんか?