Stable Cascadeの使用経験

こんにちは、Browncatです。

Stable Diffusionの開発元のStability AIが、2月12日、画像生成AIの新プラットフォーム「Stable Cascade」を発表し、同社のGitHubページに学習コードと推論コードを公開しました(注)。

以下は「Stable Cascade」公式サイトの日本語の紹介ページです(英語版とは時差の関係で日付がリリース日が1日ずれています)

「Stable Cascade」リリース後、利用メモリを最適化したコード例や、さらにComfyUIのワークフローも外部で開発・公開に至っています。

そこでComfyUIのStable Cascadeワークフローを利用していくつかの画像を生成し、SDXLによる生成と比較します。

ComfyUIのStable Cascadeワークフロー

ComfyUIのStable Cascadeワークフローとそのインストール方法について詳細は、まゆひらさんのnoteを参照してください。

特に重要なのがモデルの選択で、Stability AIから提供されているベースモデルを使用する場合、GPUのVRAMが8GB以上の環境では、以下のモデルの組み合わせを推奨します。

Stage A(SD1.5/SDXLのVAEに相当するもの):stage_a.safetensors

Stage B:stage_b_bf16.safetensors

Stage C:stage_c_bf16.safetensors

stage_b.safetensors, stage_c.safetensorsの組み合わせも自身の環境(Geforce RTX 4070Ti)で試しましたが、bf16版と画質がほとんど変わりませんでした。

生成例

それでは実際の生成例を提示します。

Stable Cascadeのモデル(チェックポイント)は前述の推奨の通り、stage_b_bf16、stage_c_bf16を利用しました。

比較対象のSDXLはComfyUIではなく、WebUIのForge版を用いました。SDXLのモデルは各生成例をご覧ください。

どちらも解像度は横896 x 縦1152ピクセルで拡大はしませんでした。

1.公園のアイドル女子

【Stable Cascade】

【SDXL】モデル:fuduki_mix 2.0

【プロンプト】※共通

【Positive】 cinematic photo Imagine a young Japanese woman adorned in gothic and lolita fashion, standing in a picturesque garden. She wears a frilled corset and has two-tone hair, a unique blend of blue and purple. Her outfit and surroundings exude the essence of gothic art, creating a captivating and enchanting scene. The contrasting colors of her hair add a vibrant touch to the serene garden setting, making her presence truly mesmerizing . 35mm photograph, film, bokeh, professional, 4k, highly detailed

【Negative】 drawing, painting, crayon, sketch, graphite, impressionist, noisy, blurry, soft, deformed, ugly

【講評】

Stable Cascadeはベースモデルながら、プロンプトに「Japanese woman」と書いても顔が「変なアジア人」にならず、衣装・背景含め、SDXLの成熟度の高いモデルの生成結果と並べても見劣りしない描出力を持っています。

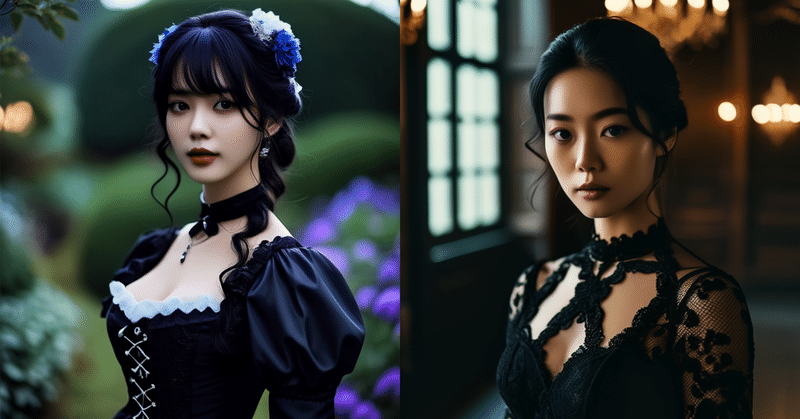

2.黒いドレスの女性

【Stable Cascade】

【SDXL】モデル:fuduki_mix 2.0

【プロンプト】※共通

【Positive】 cinematic photo a Japanese woman young girl ballet dancer wearing cleavage black lace dress is posing in the Victorian room . 35mm photograph, film, bokeh, professional, 4k, highly detailed

【Negative】 drawing, painting, crayon, sketch, graphite, impressionist, noisy, blurry, soft, deformed, ugly

【講評】

Stable CascadeはSDXLと同様に、プロンプトをきちんと反映した画像を生成できています。コントラストの若干の違いは、Stable CascadeとSDXLの違いというよりも、モデルの個性と考えられます。

3.液体金属に浮いて寝そべっている女性

以前にSD系をMidjourney, DALL-E 3と比較した画像のプロンプトをStable Cascadeにも適用してみました。

【Stable Cascade】

【SDXL】モデル:dreamshaperXL_alpha2Xl10

【プロンプト】※共通

【Positive】A young Japanese woman with silver hair in silver cleavage dress is lying in the flowing (liquid silver metal texture:1.7), (full body:1.2)

【Negative】なし

【講評】

やや抽象的な表現の画像ですが、Stable CascadeはSDXLと同様の表現ができています。

結論

Stable Cascadeは、初期のテストバージョンであるにもかかわらず、SDXLのベースモデルより画質の高いモデルの生成結果と並べても見劣りしない描出力を持っており、今後の正式版のリリースが待たれます。

注

注1:Stability AIはその後の2月22日、さらなる新プラットフォームの「Stable Diffusion 3」を発表しましたが、本稿は「Stable Cascade」に関する内容です。Stable Diffusion 3の開発コードは、記事執筆時点では公開されていません。

注2:Stable Cascadeは原稿執筆時点では、初期のテストバージョンで、商用利用も認められていません。ベースモデルも含めあくまでも暫定仕様であって、今後改善が見込まれます。

この記事が気に入ったらサポートをしてみませんか?