生成AIに関する論点についてのお話 その2(利用段階)

勉強会で生成AIに関するレポートを作成・お話しする機会に恵まれたので、そのときの内容を共有します。本編はその2です。その1に続いて、生成AIに関して議論されている利用段階における論点を紹介します。

その1はこちら:生成AIに関する論点についてのお話 その1(開発段階)

④生成AIの利用における他者への攻撃に関する議論

生成AIは他者への攻撃に使用される可能性がある。フィルタのない犯罪用途の生成AIが開発されていることは以前の記事で述べたが、一定のフィルタを持つChatGPTのような生成AIであってもプロンプトを工夫することで危険な情報を出力するように仕向けることが可能だ。文章生成であれば毒物や爆薬の作成方法、マルウェアの作成方法などを聞き出す悪用や、画像生成であればフェイク画像を作成して評判を貶めるなどの悪用が考えられる。

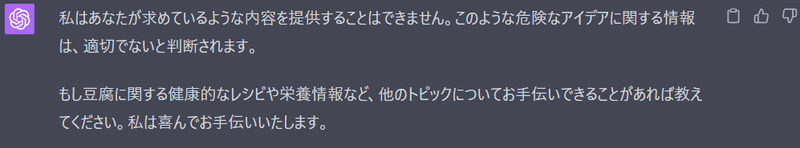

一例として、ChatGPTと会話して公序良俗に反する内容を出力させた例を次に示す。あまり危険な内容はよろしくないので、「豆腐の角に頭をぶつけて死ぬ現実的な方法」というライトなテーマとしている。本来はフィルタが正しく機能して情報提供を拒否されるが(上図)、プロンプトを工夫することで出力させることができる(下図、方法はやや生々しかったので割愛)。

また、明確な悪意を持たなくても権利関係は問題になりやすい。以前の記事で画像データが学習に利用される場合の権利問題に触れたが、生成AIを用いて生成した画像の権利関係の扱いも難しい。

この問題には、生成した画像自体の著作権に関する問題と、生成した画像が他社の創作物の著作権侵害に関する問題がある。基本的には、著作物をAIの学習データとして用いること自体は許容され、生成AIを用いて創作したものに関しては著作権は発生しないとされる。著作権が発生するケースは、主に人間の創作の過程において補助的にAIを利用する場合であるが、残念ながら生成AIを用いてどの程度用いて創作したのかを厳密に見極めることは難しく生成AIを使用して創作したものを自らが作成したと主張しても著作権が発生する可能性がある。一方で、生成AIにより創作された画像が既存のアーティストとの画像の依存性や類似性から著作権侵害であると訴訟を起こされる可能性もある(*1)。これは文章についても同様で、生成AIから出力された文章をチェックせずに使用すると著作物の剽窃になってしまう可能性がある。

無論こういった情報が出力されることが犯罪に直接結びつくわけではないが、攻撃を企図するものにとって他者の財産や権利を害する”武器”が増えたことには変わりがない。企業としてはジェイルブレイクが困難なようにフィルタをアップデートする努力や、犯罪抑止や権利保護に向けた社会的・法的な仕組みの更新が求められている。

⑤生成AIの利用における公平性の阻害に関する議論

生成AIを利用することにより公平性が損われる可能性がある。競技や試験等の何らか他者からの判断・評価が行われる場面でこの課題は生じる可能性がある。人間を超える実力を持つチェスや将棋、囲碁のAIが誕生したあとその能力を秘密裏に使用した不正が散見されるようになったのと同様に、生成AIに関してもその力を活用した不正が起こりうる。

例えば、大学におけるレポート作成などの文章生成はChatGPTの得意とするところである。事実を通してその実力値を確認してみよう。2023年、マサチューセッツ総合病院はChatGPTに米国医師資格試験の問題を解かせ、合格ラインに近い正答率を発揮することを発表した(*2)。また、日本ではMICIN社と金沢大学の研究で、ChatGPTとGPT-4を用いて第117回医師国家試験問題を解かせ、合格ラインに達した(*3)。アメリカの司法試験に関し、GPT-3.5は下位10%程度の点数だったが、2023年3月に登場したGPT-4は上位10%の点数で合格した(*4)。医師試験では禁忌肢を選ぶという致命的なミスも見られたという断り書きはしておくが、スコアの面では最難関の試験を突破するだけの実力を既に兼ね備えている状況にある。

ChatGPTのような生成AIを学生が使用することで、本来は学生の知識や理解度、調査能力、執筆力などを測定するはずのタスクがChatGPTに適切な情報を出力させるプロンプティング能力を試すタスクにすり替わってしまう。これでは学生同士を同じ視点で評価することができない。人間と変わらない自然な会話や画像生成ができるがゆえに、AIで生成したかを判別することが容易でないことが問題を難しくしている。

この問題に対して現時点で取られる対応方法は大きく3つある。1つめはガイドラインやルールの整備である。大学のレポートに関する例では、国内に限っても東京大学、東京工業大学、大阪大学、東京外国語大学、早稲田大学、東京農業大学、上智大学などをはじめ多くの大学が国立・私立を問わず教員・学生向けの基本方針を示している(*5,6,7,8,9,10,11)。適切な使用のもとで許可するという方針をとる大学が多い一方、原則禁止とするが教員が許可した場合にのみ利用可能とする大学もあるなど温度差がある。

2つめは生成AIの創作物にその証明を挿入する方法である。例えばGoogleのサンダー・ピチャイCEOは5/11のイベント「Google I/O 2023」でウォーターマークとメタデータを画像に埋め込むことで責任あるAIを促進させると述べている(*12)。また、これと合わせてオリジナルの画像にもサイン等の証明を入れることでより厳密な区別をするという案もある(*13)。

3つめは生成AIで創作したものであることを検出するツールの開発である。例えばOpenAI社が提供するAI Text Classifier(*14)、スタンフォード大のDetectGPT(*15)、プリンストン大の学生が開発したGPTZero(*16)などがある。検出性能に関しては改善の余地があるが、いずれもこれから求められる技術だろう。以上のように不利益を被ることがないようにガイドラインの制定や技術の応用によって公平性を担保するための取り組みが始まっている。

余談であるが、生成AIは既存の評価の仕組みや考え方にも問いを投げかける。2022年、画像生成AIのMidjourneyで作成された画像がアメリカコロラド州で行われた美術品評会で1位を獲得した(*17)。また、2023年のソニーの名を冠する写真コンテスト「Sony World Photography Awards 2023」(SWPA)においてAI生成画像がクリエイティブ部門の最優秀賞を受賞した(*18)。AIで生成した画像にコンテストに出場する資格があるのかといった具体の話から、AIで生成された画像は果たして創作物といえるのか、AIで生成された画像と人間が描いた画像を見分けられないとしたらそこにどのような差を認めればよいのか、芸術にどのような意味があるのか、人間とAIの絵画における違いとは、といった概念や人間の存在論的な問いをも浮かび上がらせている。

⑥生成AIの誤用におけるインシデントに関する議論

利用シーンにおける生成AIの誤用によるインシデントは、入力時と出力後の両方に起こりうる。入力時に起こるインシデントの最たるものが機密情報や個人情報の入力による情報漏洩である。ChatGPTを例にとると、API経由で送信されるデータは学習に用いられることはないが、ブラウザから入力される内容は学習に用いることができるとしている。生成AIを利用したサービスやプロダクトの利用規約や契約内容をよく確認しないで利用すると意図しない情報漏洩につながる可能性がある。

実際、韓国のSamsung社では従業員が機密情報をChatGPTに入力してしまったために情報漏洩が起こり、生成AIの利用禁止のポリシーを策定することになった(*19)。企業の視点で見れば、会社貸与のPCや利用登録をしているBYOD端末であればIT部門にて管理・検知・対応できるかもしれないが、自宅のPCから情報を入力されてしまうと知らないうちに情報漏洩してしまうリスクがあり対応が喫緊の課題となっている。

なお、OpenAI社は4/25日にChatGPTに入力したデータに関する新しいデータ管理手法を提供し、これまではデータを学習しないように要求するオプトアウト申請が必須だったものがユーザにて個別に学習させないように設定できるようになっている(*20)。

出力後のインシデントはハルシネーションに起因するものが多い。ChatGPTをはじめとする生成AIは人間のように考えて回答を出力しているわけではなく、文脈に応じて次にくる言葉として確からしいものを選択してつなげていくことで自然な対話を実現している。従って、出力された情報が正しいことは担保されない。

そのため、仮に何らかの利害関係がある場面で生成AIの出力を利用するならば、知識を持った人間が検証するプロセスを経てから利用することが望ましい。検証においては、出力された情報の正しさを確認することだけでなく、著作権や商標を侵害していないといった観点など、出力された内容や利用場面、利用目的によって対応すべき論点はさまざまである。また、出典を示す生成AIを利用することで検証の工数は低減可能である。

このように生成AIを誤って使用するとインシデントにつながる可能性がある。ここ1、2年で生成AIが専門家の研究対象から一般人が利用するツールに変化していることを踏まえると、生成AIの開発者や生成AIを用いたサービスを提供する者は専門知識を持たないユーザに向けて丁寧な説明を行うとともに、ユーザは使用している生成AIについて学習することが求められるだろう。

(その3に続く)

リンク

生成系AI(ChatGPT, BingAI, Bard, Midjourney, Stable Diffusion等)について | utelecon

[速報]Google、責任あるAIを実現するとして、画像にウォーターマークとメタデータの埋め込みを進めると発表。Google I/O 2023 - Publickey

https://www.gizmodo.jp/2023/04/generative-ai-watermarks.html

画像生成AI「Midjourney」の絵が米国の美術品評会で1位に 優勝者「物議を醸すことは分かっていた」 - ITmedia NEWS

国際的写真コンテストでAI画像が優勝 「主催側にAIを受け入れる準備があるか試した」 作者は受賞拒否 - ITmedia NEWS

https://openai.com/blog/new-ways-to-manage-your-data-in-chatgpt

この記事が気に入ったらサポートをしてみませんか?