ラビットチャレンジ:応用数学レポート

第一章:線形代数

機械学習、ディープラーニングの基礎である応用数学の学習。講義動画からのまとめ、知らなかった用語の解説を踏まえつつ記載していく。

第一章:線形代数

●行列はスカラが表のようにまとまったもの。

スカラ:数の大きさ、数字それがより集まったもの。

●連立方程式を解くことにも応用が可能

加減法を使って解くことが可能。これは逆行列(A×Bが単位行列)を求めていることでもある。

●逆行列の計算

逆数の計算は掃き出し方でも可能だが、2×2の場合は別の方法もある。そして、逆行列が存在しないものも有る。

●固有値、固有ベクトル

正方行列Aとベクトルとスカラーは以下の条件を満たす場合。ベクトルはAはの固有ベクトルλはAはの固有値と言う。

●【固有値分解】としてまとめて書くと。。。

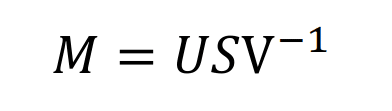

●【特異値特異ベクトル】

第二章:確率・統計

●集合の復習

これらが理解できているか。

●条件付き確率

ベイズの法則

例題を自分なりに解説。

笑顔の母数は街の子供1/3が分母。飴をもらって笑顔になった子供が、1/4×1/2 = 1/8 が分子。

(1/8)/(1/3) = 3/8 となる。

●確率変数確率分布期待値

サイコロの出る目で例えるなら

期待値はこの場合出る目(確率変数)と確率の掛け算の合計

●分散標準偏差

データの二乗の平均-平均の二乗

分散にルートを付けると標準偏差になる。

第三章:情報理論

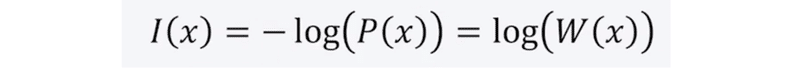

●自己情報量

概念的に、確率が低い事象程、自己情報が大きくなる。

●シャノンエントロピー

自己情報の期待値

●カルバック ライブラー ダイバージェンス

同じ事象の確率分布の違いを表したもの。

とある低い確率で起きる事象があった場合の分布と、実際に起きた場合の分布の違いを表す。

●交差エントロピー

カルバック ライブラー ダイバージェンスの一部を取り出す

Pについて取り出したものの平均を取っている。

この記事が気に入ったらサポートをしてみませんか?