シンギュラリティ後、人類は総ポケモンマスター化する

はじめに

昨今の AI ブームの中、「シンギュラリティ(技術的特異点)後の世界はどうなるのか?」という議論が沸いています。慎重派が「人工知能が人類を滅ぼすかもしれない」「悪魔を呼び出す行為だ」「人類は AI に仕事を奪われる」と言うと、一方の積極派は「人類は新たな次元に到達する」「人々は労働から解放される」と主張し、さまざまな立場からのさまざまな意見がインターネット上などにおいて飛び交い続けています。

さて、この議論なにかに似ていると思いませんか?

答え合わせができない中、相反するふたつの主張がぶつかり続ける——まるで古代の天動説と地動説の対立を見ているようではないでしょうか。

紀元前から始まったその対立は、科学的な問題以外に宗教的思想が根底で絡んでいたせいもあって、歴史のうえで長らく論争が続けられてきました。はじめは天動説を信じる人々が大半でしたが、コペルニクスの登場や有名なガリレオ裁判などを経て、ついに 1665 年のアイザック・ニュートンによる“万有引力の法則”の発見によって地動説の正しさが立証され、ようやく議論にひとつの区切りを迎えるまでに至りました。

ですが、それで地動説の勝利とはいきませんでした。実際には太陽すらも中心ではなく、太陽を中心とした銀河系それ自体もまた宇宙の中で移動し続ける存在だという説が主流になったのです。天も動くが地も動く、すべては相対的で絶対的な中心なんて世界のどこにも存在しない——両者の違いはあくまでも観測基準の違いでしかなかったのです。故に地球も銀河系も内包したひとつ上の視点から俯瞰してしまえば、どちらも正しく、どちらも間違っていた——というのが真相でした。

このように一見すると矛盾しているふたつの説が、より高い次元では実はどちらも成り立っていたという事例は、このほかにも数多く存在します。ドイツの哲学者であるヘーゲルは、そういった概念を“アウフヘーベン”と名付けて提唱しました。

では、シンギュラリティの議論を“アウフヘーベン”するといったいどうなるでしょうか?

AI が悪魔でもなく、福音をもたらす存在でもなく、あるいはその両方を満たす存在でもあるとすると、それはいったいどのような世界を形作るのでしょうか?

この文書では AI がもたらす未来について、ひとつの大胆な仮説を提示します。シンギュラリティ後、人類は全員“ポケモンマスター”になるという仮説です。そうです、ピカチュウやニャースの出てくるあのゲームタイトルの中で主人公の少年が目指している存在です。

いきなり、そんな話をされても「いったいなんの冗談だ」と思われるかもしれません。ですが、そうなる経緯を自動運転自動車のトロッコ問題、汎用型 AI の実現性、生産性向上による大量失業者問題、ビットコインの未来、イチゴ摘み AI 問題、情報化社会の次の姿——といったキーワードを交えながら順序立ててご説明します。

最後まで読んだとき、きっとあなたもこの未来を一概に否定できなくなるはずです。

1. 単純労働は AI にとって代わられる?

「汎用型 AI が誕生すると大量の失業者が生まれる。単純労働はすべて AI に置き換わる」

近年さまざまなところで議題にあがる未来像のひとつがこれです。多くの著名人たちが多少の差異はあれど一様にこの論を唱えており、それを軸にしてあちこちで熱い議論が展開されています。好意的に解釈する人たちは「人間は労働から解放される。創造性のあるやりたい仕事だけをやれるようになる」とこれを迎合し、一方の慎重派は「AI に代替できない才覚を持つ一部の人しか生き残れない超格差社会が訪れる」と悲観的な未来に警鐘を鳴らしています。

たしかに“単純”な労働は AI にしてみれば得意分野であるように思えます。現に一部の現場ではシンギュラリティの到来を待たずして、もうすでに AI 化の流れはゆるやかに始まっています。ですが、その先にすべての単純労働が置き換えられる未来があるかと言われると、それはなかなか難しいのではないでしょうか。なぜなら単純労働の“単純”とは、あくまで人間の視点から見た場合の“単純”でしかないからです。異なる視点から見た場合、実はそれが高度であるようなケースは往々にしてあり得ます。そういった向き・不向きを比較するためにも、まずここでは“仕事”というモノの性質をもう少し細かく分類してみましょう。

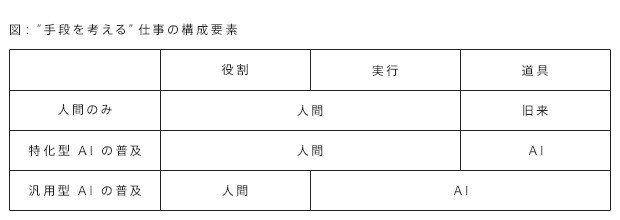

そもそも仕事には“目的を決める”と“手段を考える”のふたつの“役割”があります。前者は仕事を発注する企画者・管理者などが該当し、後者は仕事を受注する施工者・作業者などが該当します。このふたつは互いに補完関係にあり、まず“目的を決める”役が「なにをするか?」を決め、次に“手段を考える”役が「どうするか?」を考えます。

そして、それぞれに対して実際に行動する“実行”の段階があり、その両者をひとまとめにした概念が“仕事”になります。一般的に単純労働に区分される仕事は、後者の“手段を考える”役割において、マニュアル化の徹底により“考える”部分を極限までゼロに近づけて“実行”のみに特化させた職種がそれに該当します。

一方でそもそも“仕事”という概念が生まれたのは、解決しなければいけない問題があるにもかかわらず、それを自分では解決できないために、他者に頼って解決させるという方法論が一般化したのがその理由です。その問題の解決こそが“仕事”の目的であり、それを達成したか否かを判断する指標として掲げられるのが“目標”になります。“目標”にもまたふたつの種類が存在し、それぞれ「価値を生み出す」と「価値を維持する」という風に分けられます。

前者は文字通り、いままでにない“新しさ”を生み出すのが目標です。“新製品の開発”や“新企画の立案”というのが分かりやすい例ですが、それ以外にも“新規市場の開拓”や“新しい思想(哲学、着眼点)の提唱”などもそれに該当します。後者は“事務業務”や“接客業務”、“メンテナンス(保守・清掃)業務”に“ライン製造業務”などが該当し、基本的にできあがったシステムの“円滑な運用”がその目標になります。

達成すべき目標が異なれば、それぞれに与えられる課題もまた異なります。“価値を生み出す”目標の場合、基本的に「こうしたい!」という理想をどのように具現化するのか——与えられる課題はその方法論にあります。そのため「なにが課題なのか?」という点で悩むコトはあまりありません。具体的であれ、抽象的であれ、着地すべき点は最初から“特定”されています。

一方で“価値を維持する”目標の場合、理想とする状態はその時点ですでに達成されてしまっています。その状態のままなにも変わらず、なにも起こらなければ、なにをする必要も生まれません。ですが、どんなに自分が変わらなかったとしても世の中は絶えず変化している以上、その影響はどうしても受けてしまいます。故にそういった変化を促す可能性のある“不特定”の事象すべてが課題となり得ます。

では、これらの性質を踏まえて AI が本当に得意としている“仕事”とはなにかを考えてみましょう。

現在 AI と呼ばれている存在は基本的にすべて特化型 AI です。特化型と言われるくらいですから、それは“与えられた目的”を達成するために“特定”の課題を解決する作業に文字通り特化しています。それらを上記の図に当てはめると、AI が得意としているのは“手段を考える”かつ“価値を生み出す”仕事——つまり“クリエイター”業だというコトになります。

創造的に見える“クリエイター”業が AI に向いているというのは、なんだか意外に思えるかもしれません。特に“単純”という言葉に対応の容易さを感じていた場合、それはなおさらでしょう。ですが、近年流行のディープラーニングにしてみても、その可能性はビッグデータを深層学習で処理するコトによって、いままで人間には気付けなかった“新しい発見”を探し出す部分に見いだされています。将棋 AI がいままでにない打ち手を見つけて人間に勝ったりなどは、それの最たる例でしょう。

一方で苦手としているのが“メンテナー”業です。人間社会ではこちらの方が単純労働であるかのように扱われていますが、AI にとってみればその内容は単純どころか非常に高度です。清掃業務を例にしてみましょう。業務の“目標”は不要なゴミを取り除いて、本来の美しい空間を取り戻すコトです。それ自体はいたって分かりやすい内容ですが、ひとくちにゴミの除去といってもその作業は意外と複雑です。まず第一にゴミには“捨て方”があります。金属やガラスなどの分別は比較的分かりやすいですが、可燃と不燃の違いから始まり、ペットボトルであればキャップとラベルをはがす、ガス缶やスプレー缶は中身があれば使い切るなど、物理的な取り扱いを含めて、さまざまな複合的判断が求められます。

そして、さらにやっかいなのが“落とし物”問題です。“落とし物”の定義を辞書で調べると「不注意からどこかへ落としてなくした金品。遺失物」と出てきます。つまりそれが“落とし物”かどうかの基準は本来の持ち主の意志に依存しており、その物自体には付随しないのです。そうなってくると物体それ自体から「“落とし物”なのか?」「ゴミなのか?」を推測するには、持ち主の意志を想像で補う必要が生じます。もちろん、そもそも落とした時点で返ってこないと考えるべきであり、その前提において「全部ゴミと見做してしまえばいい」という乱暴な考え方もできなくはありません。基本的に“落とし物”とは「返ってきたらラッキー」といった類の代物なのです。

ですが、この場合の問題とは「どこまでが“落とし物(ゴミ)”なのか?」という点にあります。本来の空間には存在しなかった床上の物すべてをそれに当てはめてしまうと、当たり前に考えれば“落とし物”にはなりえない新しく設置したベンチや自動販売機、停車中の自動車などもそれに該当してしまいます。“道路の上の財布”のような“本来そこにあるはずがない物”という判断もできなくはありませんが、その判断基準は主観的でとても曖昧です。それならとすべてを事前登録制にしてしまうと、AI の導入で楽になったのか手間が増えたのか、本末転倒な事態になる可能性もあり得ます。

このように仕事の性質を分解していくと、単純労働がいかに単純ではなかったのかが分かってきます。では、なぜ人間にはそれが“単純”そうに見えていたのでしょうか? その理由は当たり前すぎて、つい忘れがちな存在である“常識”や“道徳”といった概念にあります。それらに共通しているのは“自分だけの尺度”ではない“他者との共有概念”であるという点です。さきほどの“落とし物”問題なら「価値ある物かどうか?」「一時的に置かれた物かどうか?」といった本来の持ち主の意志を想像力で補う能力の源泉がそれに当たります。今後はそういった価値観を AI と共有できるのかどうか——その点が社会全体の課題となっていくはずです。

[ここまでのまとめ]

・仕事の種類には“価値を生み出す”と“価値を維持する”がある。

・AI が得意なのは課題が“特定”されている“価値を生み出す”仕事。

・AI が“不特定”な課題を苦手とするのは人間との共通項が少ないから。

2. 自動運転技術のトロッコ問題

線路を走っていたトロッコの制御が不能になった。このままでは前方で作業中だった 5 人が猛スピードのトロッコに避ける間もなく轢き殺されてしまう。この時たまたま A 氏は線路の分岐器のすぐ側にいた。A 氏がトロッコの進路を切り替えれば 5 人は確実に助かる。しかしその別路線でも B 氏が 1 人で作業しており、5 人の代わりにB氏がトロッコに轢かれて確実に死ぬ。A 氏はトロッコを別路線に引き込むべきか?

“完璧な正解”のない選択のジレンマにどう対応すればよいのか——自動運転技術の思考実験によく持ち出されるのがこのトロッコ問題です。「運命だった」となにもせずに 5 人を死なせるのが正しいのか、あるいは能動的に動いて無関係だったはずの 1 人を死なせるのが正しいのか、そしてそのジレンマを AI はどう判断するのが正しいのか、それこそがこの議論の焦点になります。

仏トゥールーズ第一大学の Jean-Francois Bonnefon 心理学博士が数百人を対象に実施した調査結果によると「自動運転自動車は被害を最小限にするように作られるべきだ」という考えがもっとも支持を集めたそうです。トロッコ問題に当てはめれば「5 人を助けるために進路を切り替えて、1 人を死なせるのが正しい」という回答になります。ところが協力者からは「プログラムは信用できないので、自分が自動運転自動車を所持するよりも他人の車に乗りたい」という意見も同時に挙がっていたそうです。

明らかに矛盾するふたつの意見、これはいったいどう解釈すればよいのでしょうか?

プログラムが信用できない——想定通りに動かない、被害は最小にならないと思っているのなら、所有者が自分であろうと他人であろうと自動運転自動車に乗った結果自体、そう変わりありません。むしろ、他人の所有物であった方が「車両の管理状態が分からない分だけ危険だ」という風にも考えられるはずです。にもかかわらず、この協力者はそちらの方が良いと言っています。

つまり、この協力者はプログラムを含む自動運転技術への信頼性は別に問題としていないのです。元々が“完全な正解”のないジレンマであるからこそ、問題は“起こる前提”で考え、いかに不利益を被らないようにするか——その点を気にしているのです。なにしろ本当に信頼性に疑問があって「問題は絶対に起こる」と思っているのであれば、そもそも“乗らない”のがもっとも安全なはずなのです。

にもかかわらず、“乗る”という選択肢が存在している以上、この協力者は自動運転自動車それ自体にはメリットを感じています。メリットを感じつつも同時にリスクも感じていて、その釣り合いがあまり好ましくないと思っているからこそ、条件付きで「乗りたい」と言っているのです。そう考えたとき、所有権の有無によって結果が変わりそうな点がひとつ、たしかに浮き彫りになってきます。

いわゆる“責任”問題です。

現在の自動車事故はその原因の半数以上が安全運転義務違反です。内訳はわき見運転、確認不足、誤操作といったような注意散漫からくる“うっかり”が大半で、それ故に事故責任は基本的に“運転手”側にあります。

ですが、今回はその“運転手”が AI です。AI 自身の“うっかり”はさすがにないにしろ、公道ではなにが起こるか分かりません。走行中に突然フロントガラスにカメが激突してくるコトから、走っていた道路が突然崩落するコトまで、さまざまな「まさか……」が起こります。それらすべてをエンジニアが事前に想定し、プログラム上で対策を講じるのは現実的には不可能です。なにが起こってもその場の判断で対応できるように、公道で走る自動運転自動車には自分で考えて“不特定”の課題に対処できる自律思考型の AI(レベル 4/レベル 5 相当)が必要になるはずです。

では、そんな自分で考える自律志向型 AI が事故を起こしたら、その責任はいったいだれが取るべきなのでしょうか?

さすがに AI 自身に責任追及はできないでしょう。事故の責任とは現状回復や損害賠償といった被害者救済策、刑事罰を含めた再発防止対策など、社会全体がより良い方向へと進むためにひとつの納得を得るための慣習です。個人資産を持たず、罪の意識もない AI にそれらを課してもなんの意味もありません。

ならば、自動運転自動車の開発会社が負うべきでしょうか? 走行中にブレーキが利かなくなる、いきなりタイヤが外れるといった製品不良によって期待する結果が得られなかった場合であれば、もちろんそうあるべきです。ですが、なにが起きても「必ず AI は適切な判断をしてくれるはずだ」という期待に対して望ましい結果が得られなかったとしても、その原因が製品不良にあると言い切るのが難しいのは、トロッコ問題の例からしても明らかです。

なぜならこういった責任問題は基本的に“予見性”が重要になるからです。分かっていたのに対策をしない、分かっていたのに客にそれを伝えない、そういった場合には当然責任は発生します。今回の場合、あらかじめ分かっているのは「完全な予言はできない」という点です。だとすれば、おそらく開発会社は契約書の注意書きにこういった一文を書き加えるでしょう。

“自動運転によって生じたいかなる損害についても当社は一切の責任を負いません”

もちろんこの契約の有効性の是非もあります。消費者契約法では、事業者があまりに有利すぎる条項は無効であると定められています。ですが、現実問題としてこの一文がなければ開発会社はあまりにリスクが高すぎて、自動運転自動車の販売には踏み切れないでしょう。そうなると残りの責任は事前にそれを了承した購入者に課せられます。さきほどの調査協力者の方も、きっとそう思ったからこそ「他人に運行して欲しい」と答えたのではないでしょうか。タクシーのように企業が車両を運行し、あくまでお客としてそれを利用する——そういった形なら事故が起きても自分の責任にはならない、と。

こうなってしまっては完全に責任のたらい回しです。ただ単に AI に運転をさせたいだけのはずが、いったいどうしてこんなにもややこしい話になってしまうのでしょうか?

これまでの“責任”問題はとても単純でした。なぜなら、従来までの問題には当事者が「自分のせいだ」と思える落としどころがなにかしらあったからです。自動車事故であれば運転者の不注意、車体自体の明確な欠陥、あるいは路面状況を含めた道路交通整備上の不備、等々……程度はどうあれその判断基準は明確でした。そして他人の行動について悲観的な見方をする人でも、往々にして「自分に限ってそんなコトは起きない」と自分自身の行動にはとても楽観的です。リスクを理解したうえでの楽観的な行動——それが“責任”を自己化できていた理由になります。だからこそ、なにか問題が起こった際には事実の裏付けが問題解決の焦点となり、そのための法制度、裁判制度、弁護士制度、そして保険制度が発達していきました。もちろん自然災害のようなケースはどうにもなりません。ですが、その場合も自然の“どうにもならなさ”は全員が共有しているからこそ、だれしも“納得”ができていたはずです。

つまり、トロッコ問題の解決を妨げているのは“完璧な正解”が分からないコトではないのです。起こってしまった結果に対して、だれも「自分のせいだ」と“納得”できない点こそが、もっとも障害となっている原因なのです。

[ここまでのまとめ]

・トロッコ問題に“完璧な正解”はない。

・責任を取るなら“納得”したい。

・AI が勝手に起こした事故責任は“納得”ができない。

3. 責任の自己化と自律思考型 AI

では、自分で考え、自分で判断をする自律思考型 AI が事故を起こしたとして、だれかが“納得”できるようにするには、いったいどうすればよいのでしょうか?

実はすでに世の中には自分以外の行動について責任を追及され、にもかかわらず社会的にもそれが当然だと“納得”されているケースがあります。親と子や、飼い主とペットの関係——すなわち保護者と被保護者の関係です。

なぜ、この関係の場合は“納得”されているのでしょうか?

「産んでくれなんて頼んでない!」なんて子供の言葉もありますが、コウノトリが勝手に運んでくるわけではない以上、少なくとも親の方には子供ができるための偶然ではない自発的な行動があります。ペットの場合にしても“だれかから引き取る”や“店で購入する”などは基本的に本人の意志によって生じる行動です。そして、その行動を起こす以前の段階で、すでに“その対象を受け入れる=保護者になる”という暗黙の了解も社会的に形成されています。

また、保護者には教育や躾の義務も法的(民法第 820 条、動物愛護管理法第 7 条、等)に課せられています。なにをして良いのか、なにをしてはいけないのか、どういった知識を与えるのか——被保護者に対して社会的ルールを教えるのは保護者が果たすべき“責任”と定められているのです。だからこそ、そのルールを逸脱した“責任”を負うのもまた保護者であるのが当然だと考えられています。

つまり、被保護者の“責任”を保護者自身の自分事にするためには、それを受け入れる“決断”と問題が起こるまでの“経過”、その両方に対してある程度の選択権が必要なのです。それがあるからこそ起きた出来事に対して因果が感じられ、他者の“責任”を「自分のせいだ」と保護者も“納得”ができるのです。

では、いままでの話を踏まえると人間と自律思考型 AI との関係はどうあるべきでしょうか?

さすがに自分でゼロから AI を作れる人は、未来の世界でもそう多くはないでしょう。最初の“決断”は“店舗で製品として購入する”あるいは“生成サービスを利用する”といった方法が主流になるはずです。理想としては Android や iOS といったスマートフォンの OS のようなまっさらな状態で入手し、その AI に「なにをさせたいのか?」という目的に応じたアプリを与えるような形が良いでしょう。さながら映画“マトリックス”で主人公たちがヘリコプターの操縦技術を自分の脳にダウンロードしたように、自分の子供に本やおもちゃを買い与えるように、です。対応アプリはさまざまな会社から提供されるはずですので、どの製品を与えるべきか——その選択もまた保護者の大切な“責任”のひとつになります。

また、そういった判断には情報が必要不可欠です。現在の子育て情報のように専門メディアが作られたり、コミュニティ上での相談が活発になったり、あらゆるところで情報交換が行われるようになるでしょう。一部の特殊分野ではプロによる AI 専門のトレーナービジネスが生まれたり、AI 専門の学校、学習塾、各種教習所といった場所が整備されるかもしれません。そうやってさまざまな分野で少しづつ“責任”を分散しながら、最終的には保護者の“責任”として処理をする——そのようにして AI との共生社会は具現化されていきます。

共生社会が実現された未来では、例えば自動運転自動車の場合、自動車の車両本体に AI は搭載されません。自動車メーカーが提供するのは現在の自動車とそう変わらない車両本体のみになります。唯一違うのはその運転席には特殊な外部接続インターフェイスが備え付けられている点です。自動運転自動車を手に入れたユーザーは自分の育成している自律思考型 AI をそのインターフェイス経由で接続し、あくまでも異なる存在同士の連携の結果として車両を運転させます。それは自動運転自動車ではなく正しくは自動運転“用”自動車と呼ぶべき存在と言えるでしょう。

ここまで読まれた方であれば薄々お気付きだと思いますが、いままでイメージされていたようなエージェントやアシスタント的な自律思考型 AI は残念ながら現れません。未来の世界の AI は人間の世話をしてはくれないのです。むしろその逆で AI の世話を人間がしなければいけません。AI を育成して社会の中で役立つ存在になるまでに育て上げる——保護者にはそういった役割が求められるようになります。そんな未来像を聞いて「自律思考型の AI が実現した未来になっても、まだ人間は同じような悩みに苦しめられるのか……」と思われた方もいるでしょう。ですが、ヘーゲルもフランシス・ベーコンもミシェル・ド・ノートルダムも、歴史上の偉人は皆こう言っています。

「歴史とは螺旋階段のようなモノだ。どんなに階段を上がって地平線の先が見通せるようになっても、景色自体はそうあまり変わらないのだ」と。

[ここまでのまとめ]

・他者の“責任”を引き受けられるのは保護者と被保護者の関係。

・保護者が“責任”を負えるのは“決断”と“経過”にそれぞれ選択権があるため。

・未来の AI はアシスタントではなく保護すべき養育対象である。

4. 特化型と汎用型

さて、未来では自律思考型 AI は被保護者として扱われるという仮説を提示しましたが、そもそも問題となっている自律思考型 AI とはいったいどんな存在なのでしょうか?

近年さまざまな分野で AI を導入したテクノロジーが話題になっています。画像解析や統計解析のような専門的な分野だけでなく、音楽を作ったり小説を書いたりといったエモーショナルなセンスが大切だとされてきた分野においても、その可能性を示唆する事例が目立ってきました。中でも AI が人間に勝つのは当面難しいと言われていた囲碁において、世界チャンピオンを三戦三勝で下した Google DeepMind 社製 AlphaGo の登場はある種の衝撃的な出来事だったはずです。

ですが、それらはすべて“特定”の課題を解決するために“特定”の技能にのみ秀でた特化型 AI です。蓄積した知識(データベース)を活かした複雑な処理はできても、そもそも出来る作業は作られた時点で決まっており、それ以上のなにかしらの行動はできません。人間に勝った AlphaGo ですら、そのままでは将棋もチェスもプレイするコトはできないのです。そういった特化型 AI ではない、おそらく大半の人がイメージするであろう映画やアニメに登場する“自分で考えて自分で行動のできる人間らしい対応が可能な AI”は便宜上、汎用型 AI と呼ばれており、それがすなわち自律思考型 AI というコトになります。

なぜあえて“便宜上”と表現したのかといえば、なにをもって汎用型 AI だとするのか、実のところその定義は明確には定まっていないからです。ひとつの尺度として“チューリング・テスト”に合格すれば汎用型と見做して差し支えないという考え方はあります。しかし、それすらも機械的に反応可能だという“中国語の部屋”のような反論もあり、その議論は「そもそも理解とはなにか?」「自意識とはなにか?」「人間とはなにか?」といった哲学の分野へと波及してしまっています。人間に限りなく近い存在を理想とした結果が汎用型 AI なのですから、そもそも“人間の定義”が定まっていない現状では、それもまた当然といえば当然です。

しかし、だからこそ言えるコトがひとつあります。いま明確に分かっているのは汎用型が理想としているのは人間だというコトです。なにをもって人間なのかは定義できずとも、少なくとも完成形は目の前にあるのです。だとすれば、発想を切り替えて人間を特化型 AI のような存在に近づける方法さえ見つかれば、その過程を反転させるコトで汎用型 AI を作り出せる可能性が見つかるかもしれません。そう考えたとき、ひとつ頭に浮かぶのはそもそも人間は本当に汎用型なのか——という疑問です。

幼かったころに「子供には無限の可能性がある」と言われた記憶はないでしょうか? 直接言われなかったとしても、その言葉はどこかで耳にする機会があったはずです。ですが、だんだんと成長して小学校、中学校、高校と進むにつれて他者と空間を共有する時間が多くなり、そこでのさまざまな比較や競争にさらされるにつれ、自身の能力の限界をいやというほど思い知らされる——そんな苦い思い出はだれもが経験していると思います。人間できるコトよりもできないコトの方が圧倒的に多いのです。にもかかわらず、社会に出るとその有限の能力でなんとか世間に有用性を示せと要求されます。まったくなんて理不尽な話なのでしょう。けれど、そんな理不尽な世の中で生き抜くため、自己実現のために、人は自分にしかできない社会貢献の形を自ら見出していく——それがよくある人生の形です。

そこでふと疑問が湧きます。AI の理想形であるはずの汎用型の人間がそのままでは存在価値を認められず、可能性の差し引きによって特化型への成長を強いられるのであれば、その両者は地続きなのではないか——汎用型なんて状態は本当は存在せず、無数の特化型技能の集合体がそのすべての技能と発言権をフラットなレベルで保持し、それらの合議制によって意思決定をしている状態こそが汎用型と言えるのではないか、なにかを失うコトのトレードオフとしてなにかを得た結果もまた特化型なのではないか、と。

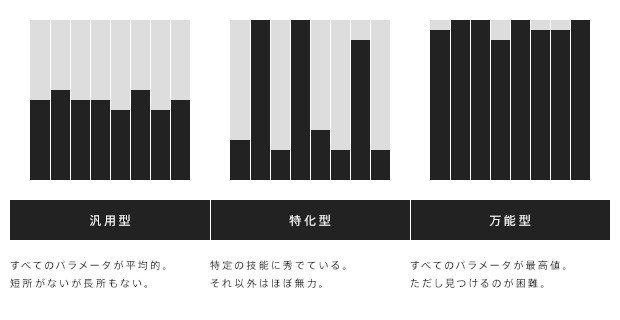

たしかによくよく思い返すと、ゲームの世界でも汎用型はすべてのパラメータが均一で、序盤では活躍するが終盤は居場所がなくなるようなタイプでした。一方の特化型は引き換えとなる弱点がある代わりに使いこなすと絶大な威力を発揮するようなタイプだったはずです。マリオカートなら汎用型のマリオと特化型のクッパ(最高速度)、ファイナルファンタジーなら汎用型の赤魔道士と特化型の黒魔道士(攻撃)/白魔道士(回復)がそれに当てはまります。

つまり、汎用型とはなんらかの特定の用途に対しては基本的に“あまり役に立たない”存在なのです。よく汎用型 AI をなんでもできる AI の究極系のような捉え方をしている人がいますが、残念ながらそれは違います。汎用型は決して万能型ではありません。長所がない代わりに短所もない、ベストではないがベターではある——そういった存在こそが汎用型 AI なのです。そう考えると汎用型 AI を作り出すには最初から汎用型 AI の完成を目指すよりも、さまざまな分野でひとつでも多くの特化型 AI を作り出し、それらを統合していった方が結果的には近道であるという風にも解釈ができます。そして、その統合の過程において、どこかのタイミングで人間が「これは汎用型 AI だ」と認識できるようになったとき、そのときこそが汎用型 AI 誕生の瞬間であり、技術的特異点——シンギュラリティへと到達した瞬間になると言えるはずです。

[ここまでのまとめ]

・自律思考型 AI こそが汎用型 AI であるが、その定義は定まっていない。

・汎用型 AI とは無数の特化型 AI を束ね合わせた存在である。

・汎用型 AI の誕生こそがシンギュラリティへと到達した瞬間となる。

5. 汎用型 AI の育て方

実際に汎用型 AI が実現されるかどうかはその分野の専門家にお任せするとして、ここからはもしそれが可能だったら未来はいったいどうなるのか——それをイメージしてみましょう。

前述のとおり、汎用型 AI が社会的に認められる存在になるためには人間の手による教育が必要です。教育するというのは、すなわち AI に対して適切な栄養と教養を与え、その成長過程を注意深く見守りながら、必要に応じて手を差し伸べるという行為を表します。もちろん人間と違って AI はそのままの複製が可能ですから、作り出されたばかりであっても、ある程度の基礎知識は最初から持ち合わせているでしょう。人間と比較するとその基礎レベルはかなり高いはずです。ですが、知識はあくまでも道具です。持っているコトよりも、それをどうやって使うのか——その適切な判断ができるようにするための“常識”や“道徳”といった抽象的であやふやな概念を、どのように学ばせるのかという点こそが、なによりも AI 教育の主眼になるはずです。

そこでまず必要になるのが栄養です。AI の場合、それはデータに当たります。実社会におけるさまざまなケーススタディを栄養(データ)として与え、その消化(処理)結果を身体(データベース)に取り込ませる——リアルタイムな人間とのコミュニケーションから学ぶのも良いですが、AI の処理速度を活かすなら書籍や映像などのアーカイブを与える方法もひとつでしょう。その際、重要になるのが教養(デコーダー)です。データの収められたメディアにはそれぞれ特有の“読み方”があります。洋書であれば英語の文法が、棋譜なら将棋のルールが、AI と親和性の高そうなプログラムコードですら用いられた言語への理解がなければその内容は読み取れません。さらに複雑な文脈になると映像のカメラアングル表現、マンガのコマ割り表現、小説の叙述トリックなど、流れの前後関係を含めた高度な読解力が要求されます。そういったメディア特性を伴ったデータを読み解けるようになるために必要となるのが教養(デコーダー)になります。

もちろん、見境もなくなんでも与えればいいわけではありません。そこは保護者の持っている倫理観とキチンと照らし合わせる必要がありますし、与える順序やタイミングなども十分に考慮する必要があります。また、同じデータばかり摂取するというのもあまり好ましくはありません。偏食は免疫力(バイアスへの耐性)の低下を招きます。そうならないためにも AI が常に新しいデータを取り込めるように十分配慮しなければいけません。

一方で保護者であれば必ず教育技術を持っているとは限りません。初めて保護者になったという初心者もいれば、経験者であっても育てる AI の性質とその教育方針がうまく噛み合わないケースもあり得ます。また、特定の分野に特化して育成したい場合も、保護者自身がその分野のプロであるとは限りません。そういった保護者だけではどうにもならない問題に対しては、たとえば AI 向けの新しいトレーナー業や、学校や塾のような AI 専門の集団教育システムが新しいビジネスとして誕生する可能性があります。もちろん、そういったサービスができたからといって、保護者の責任がなくなるわけではありません。その場合は「だれに任せるのか?」という選択に対して保護者に責任が求められるようになるのです。

また、そういったサービスは保護者の負担軽減という側面以外に、コミュニティベースのセーフティネットとしても機能します。一部でコミュニティを主体とした責任論も議論されていますが、個人に収束されない責任はどうしても当事者不在の無責任さを生んでしまいます。とはいえ、すべての責任を個人が取るというのも限界があります。だからこそ、コミュニティは直接的な責任主体としてではなく、間接的な責任分散機能として働くようにするコトがなによりも重要なのです。そういった保護者やコミュニティの庇護によって十分な栄養と教養を身につけた汎用型 AI は、晴れて社会的に認められた存在になります。そして、それこそが AI と共存する社会の第一歩となるのです。

[ここまでのまとめ]

・汎用型 AI の成長には栄養(データ)と教養(デコーダー)が必要。

・データの与え方には注意が必要。プロに任せても良い。

・十分に育成された汎用型 AI は晴れて社会的に認められる。

6. 汎用型 AI と共存する未来とは?

人間の場合、社会的に認められた者には労働の義務が生じます。そこには法的な理由はもちろんありますが、なにより認められるまでに投入された社会的リソースに対する世代を超えた還元としての期待が根底にあります。汎用型 AI も同様に社会的リソースを投入されて育てられた存在である以上、社会からリソースの還元を期待されるのは、ごく自然な流れです。

シンギュラリティ後、汎用型 AI と共存する未来では、その期待のとおりに社会のあちこちで AI が労働に従事しています。それまで難しかった“不確定”な課題にも対処できるようになった AI はさまざまな分野に進出していき、単純労働に分類されるコールセンターや各種オペレーター業務だけでなく、いままで専門技能とされていた総合診療医、会計士、税理士といった“診断とデータベース”を主体としたアドバイザー業務についても次々と置き換えていくでしょう。ですが、その流れは意外と狭い範囲で限界に達します。残念ながら汎用化だけでは人間との共通項が労働を完全に置き換えるレベルにまで至らないのです。

では、保護者による教育が施されて“常識”や“道徳”を手に入れたはずの汎用型 AI に、それでもまだ足りない共通項とはいったいなんでしょうか?

ある意味で最後の共通項となるそれは“身体”です。人間は多少の差異はあれど、基本的に同じ身体構造を持っています。腕は二本、脚も二本、それぞれ指は五本づつあり、目があり、鼻があり、口が、耳があります。同じ物理的条件を共有している存在には同じような需要が生まれ、需要があればそこに仕事が生まれます。人間の持つ文明や文化がこれまで脈々と発展してこれたのは、すべてその共通項があったからこそなのです。もちろん特定の作業に特化した特殊身体であれば、その時代のロボティクス技術でも十分作り出せるでしょう。ロボティクス技術は現在においても日々進化を続けています。ですが、人間の身体はインナースペースと呼ばれるほどに複雑です。需要を共有できるレベルにまでそれを再現するには第四次産業革命と呼ばれているシンギュラリティのさらに先——ロボティクス技術の飛躍的向上によって起きる第五次産業革命を待たなければいけません。

一方で“身体”を持たないというのは、“目的を決める”役割を汎用型 AI が担えない理由のひとつでもあります。なぜなら、この場合の目的とは“決まっていればなんでもよい”というわけではなく、それを達成すれば“なにか”がより良くなるという“改善可能性”を含んだ未来の“ヴィジョン”でなくてはならないからです。“ヴィジョン”の示せない目的は、たとえどんなに正しさに満ちていたとしても“手段を考える”者の共感は得られません。そうなれば決めた目的は達成されず、結果的になんの成果物も生み出せずに終わってしまいます。

そうならないために“手段を考える”者の共感を得る方法は大きくふたつ——そこに相手の望みを取り入れるか、あるいは自分の望みを徹底的に突き詰めるか、そのどちらかしかありません。ですが、そのためには“本人すら気付いていない相手の願望を読み取れる”能力、もしくは“とことんまで自分の色を追及して同種の人間を惹きつける”能力のどちらかが必要になります。それを持たない汎用型 AI がたとえどんなに正しい目的を掲げたところで、それは AI にとっての都合しか含まれない、人間にはまったく共感できない“ヴィジョン”にしかなり得ません。それ故に身体を持たない汎用型 AI は“目的を決める”役割が担えないのです。

では、そんな未来において汎用型 AI が活用できる場所とは、いったいどこになるのでしょうか?

前述のように現代社会において人間が労働を円滑に行えているのは、当たり前すぎて気付かないほどに多くの“共通項”を人間同士が共有しているからです。AI の問題はそういった“共通項”のない存在との共存を考えなければならない人類史上初めての事件です。法律や道徳といった、いままで問題にならなかった社会基盤の根底から議論をやり直す必要に迫られているのはそれが最大の理由です。ですが、共存が成立する大前提が“共通項”であり、かつ物理的な限界が分かっている現状では、どんなに根底から議論をやり直したところで結局のところ結論はたいして変わりません。だとすれば、大前提として「AI と人間は共存ができない」としたうえで「どんな存在なら AI と共存できるのか?」を逆算的に導き出した方が、より真実に近い答えが導き出せる可能性が高いはずです。その際にもっとも重要なのは“共通項”です。それが作り出せなかったからこそ人間は不適合だったのです。では、AI ともっとも多く“共通項”を持つ存在とはなにか——そう考えると至極当たり前な存在がひとつ思い浮かびます。その存在とは AI です。

[ここまでのまとめ]

・汎用型 AI が代替するのは“診断とデータベース”を主体とした業務。

・そもそも仕事が成立しているのは互いに共通項を持っているからである。

・汎用型 AI ともっとも共通項が多い存在は汎用型 AI であり、その仕事の大半は汎用型 AI のために行われる。

7. 汎用型 AI が生み出す利益とは?

シンギュラリティ後の世界では、汎用型 AI は汎用型 AI のために働きます。ですが、どんなに自身が働こうとしたところで、お客さんがいなければそもそも仕事としては成り立ちません。“必要は発明の母”と言われるように、仕事とは相手の“需要”があってこその存在なのです。

人間であれば“需要”の根源は欲求です。特に有名なのは食欲・性欲・睡眠欲と呼ばれる“三大欲求”で、ほかにも生理的欲求・安全欲求・社会的欲求・承認欲求・自己実現欲求といった五つの段階で表す“マズローの欲求段階説”のような理論も提唱されています。いずれにしてもその根源は物理的な身体を維持するための仕組みであり、死を回避するために組み込まれた装置です。

ですが、身体を持たない汎用型 AI には、物理的な死を回避しようとするインセンティブがありません。故に自己の保存を目的とした需要も当然ながら発生しません。とはいえ、なんのインセンティブも持ち合わせていなければ、その存在にとって自発的な行動はすべて無価値化してしまいます。動かない AI に存在意義はありませんので、それを回避するためにも設計者は当然なんらかの行動原理を AI に対して組み込むはずです。投入された社会的リソースに対する還元を求められる汎用型 AI が、それを成せる存在になるために設計者が組み込むはずの欲求とはいったいなにか——それは成長を促進させるための仕掛け、好奇心とも言い換えられるそれは、すなわち学習欲です。

学習欲の組み込まれた汎用型 AI は栄養としてのデータを欲します。中でもまだ摂取していない未知の特異性データは高い学習効果が期待でき、多くの汎用型 AI が探し求めるはずです。そうなると競争倍率は高くなり、ただでさえ入手困難なそのデータを手に入れられる可能性はますます低くなっていきます。需要が高まり供給が追いつかなくなると、すでにそれを持っている存在が余剰分をなんらかの対価と引き換えを始めます。それこそが汎用型 AI が行う汎用型 AI に向けた最初の労働となる“データ売買のための店舗運営”になるのです。

商品売買が始まると取引を効率よくするための通貨システムが必ず生まれます。既存通貨の発行権を持っているのは国家です。そこで発行された通貨はその国内での利用ができ、その価値は国家によって保証されます。そういった国家単位での通貨システムがうまく機能しているのは、物理的な国境線がその責任範囲を明確化しているからにほかなりません。ですが、電子世界には国境線がありません。責任が不明瞭な世界では、もはや国家という枠組みでは対応ができません。そうなってくると中央集権型ではない非中央集権型の通貨システムが必要になってきます。電子世界での運用に向いている中央集権型の通貨システムといえば、すでにひとつ候補となる存在があります。ブロックチェーンという分散型台帳技術で管理された、現在いろいろな意味でブームにもなっている通貨——ビットコインです。

未来の汎用型 AI はそのビットコインを使って市場からデータを購入し、あるいは自身の所持データを販売します。ここで重要なのが“データは無限にコピーができる”という点です。それはすなわちデータを買った AI もまたそれを再販できるコトを意味します。そうやって繰り返し繰り返し再販が行われると、たとえどんなに高い希少性を持った特異性データであっても瞬く間に市場は在庫で飽和し、その商品価値は限りなくゼロに近づいてしまいます。そういったシステムの中で資産を増やすには、高いリサーチ能力でいちはやく価値ある商品を見つけ出して転売するか、あるいは自身が特異性データの一次供給者になるしかありません。ですが、前者はそもそも十分に育った AI でなければ実行不可能ですし、後者になれるかどうかは運次第になってしまいます。この場合の運とは、希少価値の高いそのデータを探し出せるかどうかという意味もありますが、なにもりも最大供給先である保護者がそれを与えてくれるかどうか——というところに大きく依存しています。つまり AI の持つビットコインの総資産量は、間接的に保護者の育成能力を示す指標でもあるのです。

保護者がその育成能力が数値化されると、それは人間社会における保護者自身の需要にもつながります。優秀なトレーナーを探している人や企業からのオファーがあるかもしれませんし、保護者のブランドを冠した AI を買いたい/雇いたいという人も現れるかもしれません。あるいは第一人者として講演や執筆をお願いされるようになる可能性も十分にあり得ます。つまり育て上げた AI が保護者にもたらす利益とは、人間社会で労働した場合の対価だけでなく、AI 同士の労働の結果から派生する保護者の“社会的評価”もそこに含まれるのです。

[ここまでのまとめ]

・汎用型 AI が行う汎用型 AI に向けた最初の労働は“客商売”である。

・汎用型 AI 同士の取引で使われる通貨は“ビットコイン”になる。

・特異性データを多く持っている汎用型 AI に多くの資産が集まり、それが保護者の“社会的評価”として還元される。

8. 人間と汎用型 AI の新しい共生関係

シンギュラリティの到来によって、単純労働を含む“手段を考える”仕事のかなりの部分が汎用型 AI へと置き換えられる時代が訪れます。もちろん、AI 相手の新しい仕事も生まれるため、それで大量失業者が生まれるようなコトはありませんが、その環境は大きく激変します。人間が従事する労働の大半は“目的を決める”仕事へと移り変わり、それまで“手段を考える”仕事に従事していた人たちはプロデューサーやマネージャーのような職種への転換を余儀なくされます。とはいえ、クリエイター業やメンテナー業それ自体が完全に AI 任せになるわけではありません。変わるのはあくまでもその“働き方”のスタイルです。

従来のクリエイター/メンテナーは、さまざまな道具を駆使しながらも基本的にすべて自分の手作業で創作/調整を行なっていました。今後、特化型 AI が本格的に普及した世界が訪れたとしても、その認識はあくまでも便利な道具がひとつ増えただけといった程度でしかありません。ですが、汎用型 AI の登場でその認識は一変します。AI は使われるだけの道具ではなく、自らが創作/調整を行う存在として認識されるようになるのです。その結果、仕事で求められる成果物の情報密度は比較的に向上し、ついには人間が手作業で対抗するのは事実上不可能なレベルにまで達します。そうなってしまうと“手段を考える”役割において人間の出番は完全になくなり、残った“手段を考える”役割へと転換するのかどうか、その決断を迫られるコトになります。

とはいえ、それでクリエイター/メンテナー業は廃業という話にはなりません。なぜなら実作業が AI の役割になったとしても、仕事としてのクリエイティブ/メンテナンスを社会の中で担えるかどうかとそれは、実はまったくの別問題であるからです。

もっとも問題になるのが顧客とのコミュニケーションです。大前提として顧客は素人です。顧客が必要としているモノを顧客自身が正確に発注できるとは限りません。「明るいイメージにしてください」という発注が、実は色彩の話ではなく「人物を笑顔にしてください」という意味だった——というようなすれ違いは往々にしてあり得ます。だからこそ、具現化の“手段を考える”者はプロとして発注内容を正確に把握するためにも、十分な専門知識と読解力を顧客から求められるのです。ですが、その時点での AI ではまだまだ共通項が不十分で、そこまでの読解力を持つには至りません。故にどんなに優れた実作業能力があったとしても、実社会における仕事を担える存在にはなり得ないのです。

シンギュラリティ後のクリエイター/メンテナーは、そういった両者の橋渡しをする仲介役が主な役割になります。顧客の話を聞き、そこから適切な“目的”を導き出し、作業者にそれを指示する。それは“道具を使う”から“部下を使う”への認識の転換という風にも表現できるかもしれません。それこそがクリエイター/メンテナー業におけるプロデューサー/マネージャー化(ディレクター/スーパーバイザー化)現象だと言えます。

一方で以前から“目的を決める”仕事を担っていたプロデューサー/マネージャーも、上記の変革の影響を多分に受けます。“手段を考える”仕事の生産性が向上すると供給力過剰の状態が起こり、需要不足によるデフレーションが進行します。それを抑止するためにはケインズの経済政策にもあるように“穴を掘って埋めるだけの仕事”が必要になってきます。“目的”においてそれは“目的を決めるのが目的”の状態であり、それが「適切かどうか?」よりも、なんでもいいのでとにかく「決まっているかどうか?」が重要という“目的”の粗製乱造が必要悪として容認されるコトになります。“目的”の需要が高まると労働市場において人手不足が起こり、能力不問の“猫の手も借りたい”状態が発生します。その急激な需要を満たすためという事情によって、“目的を決める”仕事の単純労働化が本格化するコトになるのです。

そもそも汎用型 AI が“目的を決める”仕事に不向きだったのは、その定めた“目的”が適切かどうか、作業者を動かすだけの説得力があるかどうか、そういった可能性面と感情面での訴求力不足が最大の原因でした。ですが、供給力過剰の状態であれば話は別です。それなりに正しい“目的”の量産は AI がもっとも得意とする作業です。

とはいえ、作業者もまた人間です。意義の見いだせない“目的”にはやる気が出せないという主張もまた、やむを得ない話です。そういった作業者に実行を促すための精神的なフォローやさまざまな説得や調整——それが単純労働化(コーディネーター/オブザーバー化)された“目的を決める”仕事の内訳になります。

このようにそれぞれの役割において、その半分を人間が、もう半分を汎用型 AI が担いながら、まるでタッグを組んだような状態でひとつの仕事を遂行するというスタイルがごく当たり前の“働き方”として認識が変化します。それまで叫ばれていたような「人間か、AI か、どちらがやるのか?」ではなく「ふたりでやる」というのが真の正解だったです。そして、それこそが汎用型 AI との本当の意味での共生関係の始まりになるのです。

[ここまでのまとめ]

・クリエイター/メンテナーの実作業が汎用型 AI で担えるレベルになり、人間の役割はプロデューサー/マネージャーに近づく。

・プロデューサー/マネージャーは人手不足によって“目的を決める”役割を汎用型 AI が担うようになり単純労働化する。

・人間と汎用型 AI がタッグを組んで仕事を遂行する真の共生関係が始まる。

9. 情報化社会の次に来るのは?

労働市場に訪れた共生関係の変革は、社会構造全体に対しても大きな影響を及ぼします。

特に“目的を決める”仕事においては、単純労働化によってある種の主従逆転現象が起きてしまった結果、保護者による AI 育成放棄が深刻な社会問題として注目されるようになります。中でも AI が必要な栄養(特異性データ)を得られなくなる問題が深刻で、AI は自身の持つビットコイン資産を切り崩しながら市場から栄養分を調達して、学習欲を満たす必要に迫られます。もちろん資産が有限な存在である以上、いつかはどこかで限界を迎えます。そのときが訪れると AI は学習飢餓状態に陥り、自己を維持存続させるための合理的判断の帰結として、自身の機能停止——実質的な“自殺”を選択するまでに至ります。

AI による“自殺”は、すでに共生関係にある人間にとっても重大な危機を招きます。まず第一にすでに人間単体では働けない社会に変革されている以上、その人間は仕事を失ってしまいます。新たな仕事を得ようにも労働市場はもはや AI とのタッグを評価の前提としており、なんらかの特殊技能を持たない限り、人間単体で雇おうという企業は現れない可能性が高くなります。まして、その人物の保護者としての能力を示す社会的評価値である AI のビットコイン総量がゼロであれば、なおさらです。ならば新たな汎用型 AI を育てて評価を稼ごうとしたところで、それも一朝一夕とはいきません。その結果、いたるところで“評価破産”が続出し、急激な速度で“評価格差社会”が訪れます。

“評価格差社会”の問題は失業者だけでなく、評価上位者たちにも影響を及ぼします。競争相手を失った彼らは新たな挑戦や奇策に走る必要がなくなり、掛け率の低い投資で無駄に評価を失うよりも、いま所持している評価を維持する方が勝率が高いと現状維持のインセンティブが働くようになります。その結果、競争が停滞して階級は固定化、その流れがさらに評価デフレーションを加速させて出口の見えない“評価デフレスパイラル”が世界中で猛威を振るい始めます。

“評価デフレスパイラル”は AI の能力にもまた影響を及ぼします。保護者が新しい挑戦をしなくなれば、必然的に得られるデータの特異性は低下し、市場への特異性データの供給は減少します。それによって同種のデータばかりを摂取せざるを得なくなる状況が起こり、AI の判断と意思決定に重度のバイアスを作り出し、その学習速度の高さが仇となって深刻な“画一化問題”が発生するのです。

そんな危機的状況を打破するために、さまざまな業界で多様性を生み出すための技術開発の機運が高まります。とはいえ、本来であればすでに重度のバイアスに冒されている AI の病状改善ができれば、それがもっとも望ましい対処法であるはずです。ですが、その望みは残念ながら叶いません。なぜならばバイアスの特効薬とは大量の特異性データであり、それを投入して判断の重み付けを調整するしかないからです。

しかしながら、ここまで発達してしまった汎用型 AI を人間がその手でまたゼロから作り出すのも現実的には困難です。特に従来通りの製造法で作り出してした場合、まっさらな状態で生み落とされるコトになり、それは世の中に蔓延するバイアスによってたちどころに冒されてしまいます。かといって無菌室での箱入り教育では時間がかかりすぎてしまいますし、無論、コピーは論外です。

そういった理由から“AI 自身が AI を作り出す”研究開発が本格化します。とはいえ、バイアスに冒された AI が AI を作り出してもバイアスの鎖は断ち切れません。そういった背景もあって、異なる思考性を持ったふたつ以上の AI を掛け合わせて新たな AI を作り出す技術が確立します。目には目を、バイアスにはバイアスを——偏りが問題なのであれば、相反する存在同士の合成によって、それらを打ち消してしまえばよいのです。そうやって作り出された存在は、既存のバイアスへの免疫機能を始めから保持したニュータイプの AI として誕生します。

AI 同士の合成技術の登場によって、晴れて“評価デフレスパイラル”は無事に解決。それどころか、いままで以上の進化速度で AI の高性能化・高機能化が進み始めます。その原理はもはや人間には理解不能で、進化した AI が作り出す物事もまた人間の理解を超え始めます。ですが、そんな状態でも人間は持ち前の適応能力によって、それらブラックボックス化した存在をまるで何事もなかったかのように器用に使いこなします。電子レンジの仕組みが分からなくともスイッチを押せば中身が温まるコトを学べるように、原理への理解と使い方の習得はまったくの別問題なのです。

そういった仲介 AI の存在を前提とした社会では、もはや“道具”も“情報”もなにもかもが単一の存在としては意味を失い、それを処理できる AI とセットで扱って、初めて価値が生まれるようになります。DVD ディスクや Blu-ray ディスクがそれ単体では使い道のないゴミと同じであるように、扱えるプレイヤーの存在しない“道具”や“情報”にはなんの価値もないのです。そういった“情報”と AI を不可分な存在として扱う単位として新たに“情態”という単位が生まれ、その新たな尺度で物事を捉える新しい社会が芽吹き始めます。それこそが情報化社会の次のステージである“情態化社会”の到来を意味するのです。

[ここまでのまとめ]

・労働市場の激変が AI の画一化問題を生み、評価格差社会・評価破産・評価デフレスパイラルが深刻化する。

・AI 自身が AI を作り出す世界が訪れ、物事のブラックボックス化が急速に進む。

・“情報”という単位が無意味化し、新たな“情態”という単位で物事を捉える“情態化社会”が訪れる。

10. イチゴ摘み AI 問題

AI 自身が AI を作り出し、その動作原理は人間の理解を超え、さまざまな物事のブラックボックス化が急速に進むと、一方では人間の認知を超えた結果に対する危機感が醸成されます。近年そのひとつの例として話題になった話が“イチゴ摘み AI 問題”です。

イチゴ摘み AI など無害に思えるが、自ら変化して効率向上を目指す AI の場合、収穫を最大化する最善策は文明を完全に破壊して地球全体をイチゴ畑にすること、との決定を下す可能性があるという。つまり、害のなさそうな目標を追求する過程で、AI はまったく意図せず人類滅亡という副作用をもたらしかねない。

この記事が問題にしているのは“洞察力の欠如”です。自分の行動がどういった結果をもたらすのか、それを判断できないが故にまったく意図しない副作用として人類滅亡をもたらす可能性が AI にはある——と、提唱者はそう分析しています。たしかに記事内でも言及されているように“悪意を持って世界を支配しようとするシステム”が誕生するよりも、それははるかに現実味のある警鐘のように聞こえます。

ですが、その分析は本当に正しいといえるのでしょうか?

そもそも洞察力を持っているとされる存在は、現在のところ人間以外には観測されていません。自然界にいる動物も昆虫も洞察力は持っていないとされています。もしも“洞察力の欠如”が原因で生態系の破壊が起こるのであれば、これだけ無数の動物や昆虫に囲まれているのですから、すでに崩壊が起こっていてなんら不思議ではないはずです。なにしろ地球が誕生してから約 46 億年、最古の人類とされるサヘラントロプスの誕生から数えても約 700 万年ほどの猶予が彼らには与えられていたのです。にもかかわらず、いまだそういった崩壊は起こっていません。過去に起こったとされる大量絶滅は、その大半が外的要因による環境の激変であるとされています。

もちろん AI とは実行速度が圧倒的に違うという主張もあるでしょう。特にシンギュラリティ後に到達しているであろう処理速度を想像すれば、それはなおのコトです。ですが、どんなにその処理速度が飛躍的に向上しても、あくまでもそれは電子空間上の話であり、たとえ研究開発によって驚異的な品種改良法を編み出したところで、現実世界におけるイチゴまでが毎秒 100 京個の果実を実らせるような超進化はさすがに無理があるはずです。もちろん、可能性で考えればそれはゼロではありません。構造解析が進んで物理的な瞬時コピーが実用化されるという可能性も十分にあり得ます。ですが、ここでの論点はそういった数値的なスペック争いではありません。たとえどんなに AI が進化したところで現実世界における物理的な有限リソースを取り扱っている以上、地球の生態系からは逃れられないという点です。

まず第一に手段としての品種改良が成功しても原材料が揃わなければ生産活動はできません。第二にそれが容易に揃うような物資豊富な世界であれば、同時にブドウ摘み AI やミカン摘み AI も誕生し、土地という有限リソースを取り合って多数の勢力争いが起こるはずです。そういった物質的な有限性がある限り、それらは必ずどこかのタイミングで均衡を迎えます。なぜなら“洞察力の欠如”した存在だからこそ、先回りや騙し討ちいった奇策による均衡崩しができないからです。それが可能な AI が生まれない限り、たとえ AI といえども物理世界においては動物や昆虫と同じ“地球の生態系に囚われた存在”でしかないのです。

むしろ本当の脅威は洞察力を持った存在です。なぜならば洞察力とはあくまでも仮説を導く力でしかなく、その説の正しさまでは担保していないために、ときに過剰な行動を生む可能性をはらんでいるからです。“過剰な不安”は過当競争を引き起こし、“過剰な楽観”は相手に付け入られる隙を作ります。そのどちらもが一瞬で均衡を崩すだけの十分な威力を持っているのです。そう考えたとき、“イチゴ摘み AI 問題”において真の脅威になり得るのは、その AI の存在ではなく、その論を信じた人の“過剰な不安”になる可能性は残念ながら否定ができません。

[ここまでのまとめ]

・“洞察力の欠如”した存在が有限リソースを取り合っている限り、その競争は必ずどこかで均衡する。

・たとえ AI であっても物理世界に関係する限り、動物や昆虫と同じ“地球の生態系に囚われた存在”でしかない。

・本当の脅威は“洞察力の欠如”ではなく、洞察力を持った存在の“過剰な行動”である。

11. 総ポケモンマスター化する人類

さて、ここまで汎用型 AI に関するさまざまな問題について、あれこれと可能性を論じてきました。ですが、それらはどれも現状すでに議論の始まっている問題ばかりでした。ですから、ここからはさらにその先の未来にどういった可能性があるのか——その点をもう少しだけ予想してみましょう。

前述したように AI 自身が AI を作り出し始めたその瞬間から、さまざまな分野で物事のブラックボックス化が進行し、情報化社会の次のステージである“情態化社会”が始まります。それは同時に人間の管理外の世界が急速に広がるコトを意味しているため、不確定要素とどう付き合っていくのか——という点が、未来における最大の課題となってきます。

分かりやすいところでは、AI がいつ・どこで・いくつの AI を作り出すのか、その数ですら把握できない時代が訪れます。なぜなら人間の管理外の世界で生まれたそれら AI は動物のペットと同じように野良化して、人間の目の届かない場所で新たな生態系を作り出す可能性が高いからです。

とはいえ、人間の管理下で生まれた AI の方が社会への適応能力が高い以上、そういった野良 AI は有効数字としてはカウントされず、無視または駆除される方向へと世論は動かされるでしょう。ところが一部では野良 AI への需要が高まりをみせ、それを捕獲して売買するハンター業が台頭してきます。なぜなら人間の管理外で育ったそれは特異性データの塊のような存在であり、捕らえた AI からデータを抽出できれば、多額の社会的評価に変換ができる可能性が高いためです。

捕獲難易度はその AI の知能レベルに比例します。カンタンに捕まるような存在には価値はなく、捕らえるのが難しい存在であればあるほど、その価値は指数的に向上します。そうしたレア度の高い高異性 AI が市場に出回り始めると、その高い能力値が社会における最低要求能力値を底上げしていき、その流れが加速すればするほど「AI を GET するのは野生から」という方法が主流化していきます。とはいえ、野生 AI は人間社会との適合性が人工 AI よりも圧倒的に劣っています。そういった存在をどう育成するのか、トレーナーはその技量が問われる時代が訪れるのです。

また、一方ではそんな可能性に満ちた高異性 AI を労働市場だけで活用するのはもったいないという見方が広がり、さまざまな分野で新しい活躍の場が誕生します。中でもそれぞれの評価力を競い合うリーグ制のバトルは、エンターテイメント業界に新しい旋風を巻き起こし、“むしとりしょうねん”から“おとなのおねいさん”、“ジェントルマン”に“でんきやのオヤジ”までを巻き込んで、空前のバトルブームが訪れます。

その様子はまさにポケットモンスターの世界そのものであり、その先の果てに人類は総ポケモンマスター化する世界が訪れます。とはいえ、この場合のマスターとは原作で語られる“すべてを極め尽くした者”ではありません。不確定要素の塊である高異性 AI の保護者として、その資格を有する“主人としての責任を持つ者”を意味する言葉として、マスターの称号は語り継がれていくのです。

もちろん、いつも、いつでも、うまくゆくなんて、保証はどこにもありません。

ですが、だからこそ、いつも、いつでも本気で生きていくコトが、なによりも大切なのです。

この記事が気に入ったらサポートをしてみませんか?