【NovelAI】AI画像生成の事はAIに聞く + その他諸々

AI画像生成の仕組みはAIに聞くのが一番…?

つい先日のことですが、非営利の人工知能(AI)研究組織OpenAIによってChatGPTという人間と対話できるシステムが公開されました。

これが大変優れものでして、既に巷では

・プログラムコードに関する質問をしたらバッチリ応えてくれる

・データベースのテーブルの設計を提示してくれる

・このプログラムを高速化したいと投げたらコードを返してくれる

などなど、主に技術畑の人から喜色めいた阿鼻叫喚の声がもたらされているようです。

OpenAIのChatGPTヤバすぎワロタ

— いぐぞー!! ✈️ 旅するプログラマー (@igz0) December 1, 2022

生半可なスキルを持つITエンジニア全員廃業するわこんなん pic.twitter.com/fyQiMEBwZ5

ChatGPT君にバグ見つけてもらった。

— しいたけ (@yuroyoro) December 2, 2022

マジですごいな……こいつ…… pic.twitter.com/2A5sVsmDUC

ちなみにプログラム関連の知識だけではなく、割と広範な知識も勉強済みで少なくともWikipediaに乗ってるレベルの質問なら概ね真っ当な応えが返ってくると期待していいでしょう。

ははーん、さては相手の顔色見て回答を変えるタイプだなオメー?

ちなみに割とマニアックな分野に関する質問も、ややオウム返し的なところがあるものの文字数限界まで答えようとしてくれるナイスガイ(?)っぷり

ところでここからが本題ですが、現在のStableDiffusion系のAI画像生成システムにおいては人間側の要望である言語(我々がプロンプトと呼んでるもの)を処理する仕組みとしてCLIPというシステムが使われています。

まずCLIPについてChatGPTに聞いてみましょう。

この質問の後に例えば「人間の言葉をベクトルとして変換する仕組みとはどのようなものか?」とか「潜在空間とはどのようなデータが入っているのか?」とか色々な質問ができますが、それはひとまず置いておきます。

要はChatGPT君もCLIPもOpenAIが開発した言わば同郷という点です。

なので餅は餅屋、あるいは蛇の道は蛇というように同郷の上に既に技術的には大変優れた回答を出してくれる事が証明されているChatGPT君に効果的なプロンプトの作り方を質問してみましょう。

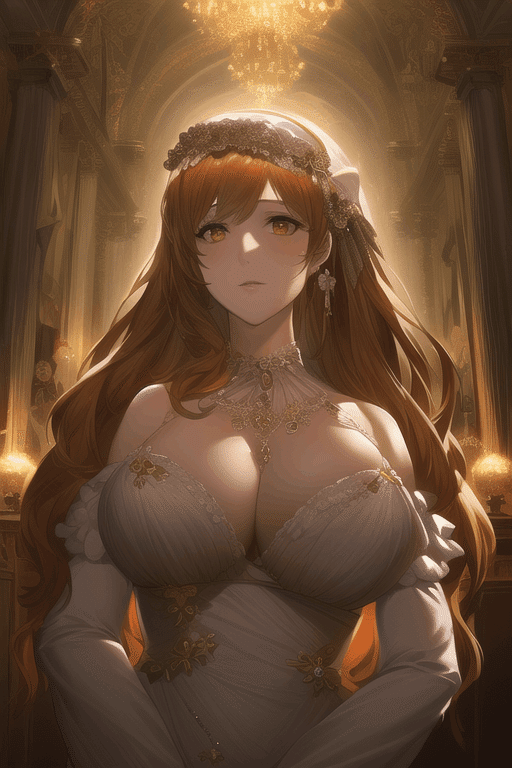

この回答のプロンプト(コピペ可)をNovelAIに投げた結果が下記になります。(実際にはちょっとUCを付け足してます)

いやぁ…これ凄いです。

実は今までintricate carvingsとかdelicate carvingsとart nouveru styleで出そうとしてたんですが、そうかplantも必要だったか〜とか、それ以前に今まで書いてたプロンプトと全然書き方が違うとか、色々な驚きがあるんですが何よりも短さの割に素晴らしいクオリティです。

次に別の質問を投げてみます。

これもやってみます。

いい感じです。

次はもっと漠然とした質問を投げてみることにします。

上から4行分の結果が以下になります。

更に「このプロンプトをもっと良くするにはどうしたらいいか?」という質問に対しても回答を返してくれます。

その結果がこのようになって……。

更に調子に乗ります。

「このコンテンツは、当社のコンテンツポリシーに違反している可能性があります。このコンテンツが誤りであると思われる場合は、ご意見をお寄せください。あなたのご意見は、この分野の研究に役立ちます。」

ポリシー違反とか言われましたがちゃんと返答してもらえました。もちろんこの回答もNAI君にシュートします。

なるほど、wearing revealing clothing とか posing seductively あるいは touching herself suggestively みたいな書き方でエロくなるのか…と、たぶんこんな感じで「よりキラキラと綺麗に」とか「よりリアルタッチで美しく」とか様々な質問とその回答によって出力したい絵に近づけることができるでしょう。

また特に「これこれこんな感じの絵はどういう書き方で出せるんだろう?」という質問には覿面に効きそうな感じがします。

もっともこういう一般的な書き方以外にも、サービスごとの特徴や学習データの癖に応じたハック的な書き方となるとCLIPの仕組みだけには留まらなくなるため、元素法典みたいな活動が直ちに無価値になるというわけではないでしょう。

しかしCLIPの仕組みに対して通りやすい書き方は同じAIに聞くというのが非常に有用な攻略法になりそうなのは間違いなさそうです。

それにしても凄いのはChatGPT公開初日頃からこの仕組みをバリバリ使いこなしていた人達だよなぁ、と。

記事を公開停止にしました

以前公開していた

「『包括的な』画作りに使える語句(ライティング重視のイラスト編)」

ですが、先月下旬頃(2022-11月下旬)既に公開を停止しています。

その理由なのですが、その後記事の内容をあらためて検証したところ「ちょっと正しくないな…」って箇所が多く見つかったためです。

あの記事では主に

1)ライティング

2)テーマカラーの指定

3)ポストエフェクト

以上の要素を指定して画作りをするという趣旨だったのですが、各項目で解説してるプロンプトに盛り込む語句の効果がちょっと疑問になってきました。

というのもまず1のライティングですが、

ligitingという語句がある程度効果はあるものの、実際にはcinematicあるいはdramaticという語のほうがライティングにかかる影響が大きい「傾向」にあり、またキャラクターの顔立ちをリアルにする方向でも勝手にライティングが有効になったりします。

現状のイメージでは「ある程度のリアル度の閾値を超えると、急にライティングが大袈裟に効き始める」という感じです。このリアル度(?)という漠然とした感覚が掴みづらく、例えば「マダム(a madame)」などの大人キャラだとライティングが反映されやすく、逆にロリキャラみたいな設定だとリアル度を上げるために盛る語句が多くなります。

またcinematic dramatic などの語句を足した結果、キャラクターの造型が変化するという記事内での述べた逆方向の影響もあります。

なおこの「リアル度」と勝手に呼んでる尺度ですが、これとマスピ顔の補正を突き抜ける絵柄の枠はまた別のものらしく、マスピ顔の状態でライティングだけは大袈裟に効いているという状況も成立し得ます。

2のテーマカラーについては検証を重ねましたが、特に問題はなかったのでスルー。

そして3のポストエフェクトですが、ライティング同様にpost effectsという言葉自体にはあまり効果がなく、むしろこれもcinematic dramaticなどの形容詞で盛られる傾向が多く、それ以外の欲しい個別の効果についてはプロンプトの適当な位置に欲しいもの(ブルームライト、色収差、トレイルレンダラー等など……)を適宜書くほうが効果的のようです。

そしてこれが最終的な問題なのですが、いわゆる元素法典で有名になったクオリティタグ(masterpiece, best quality, amazing, beautiful, extremely detailed CG unity 8k wallpaper…などなど)がライティングやポストエフェクトの意味を含んでいるという点です。

確かに「素晴らしい絵」には当然複雑なライティングやエフェクトが多く含まれているために、クオリティを上げると必然的にそれらもONになる…と。

これでは統一的な説明には追いつかず、先の記事の内容は

「真っ赤なウソではないけど、正確な内容とは到底言えない」

という事になった結果、公開停止としました。

UC: {{3D}}, LQBA, {{{inaccurate limb, inaccurate hands and fingers}}}, text, ui,k_euler_ancestral Scaleは7

こういう画が作れないことはないのですが……

上記の訂正箇所についてのあくまで「現状の検証結果」なので、もう少し煮詰めて明快な説明にできてから訂正版として公開できれば……とは考えてます。ご迷惑をおかけしますが、よろしくお願い致します。

NovelAI君もまだまだやれる子?

Anything-V3.0をはじめ様々な美少女イラストに特化したStable Diffusion用のモデルの登場と、なによりnijijourneyの登場によってすっかりクオリティ的には微妙な立ち位置になったNovelAI(以下NAI)君。

既に内心では刃牙シリーズにおける本部以蔵みたいな立ち位置だったりしませんか?いや個人の価値観なんで仕方ないですが。

しかしChatGPTが考案したプロンプトで出した絵などをはじめ、むしろ根底にあるStable Diffusionから継承した部分をうまく引っ張り出せればむしろまだまだ底力はある部類だと思ってます。

というわけでnoteを更新しなかった時期はこんな感じの画像を作ってました、いずれもNovelAI使用です(もちろんWeb版)

一時期Anything-V3.0(以下AV3)に随分と傾倒していた時期もあるのですが、両者の比較については概ねこういう結論になっています。

・根っこのStable Diffusionの学習データを引っ張り出して大胆なライティングや構図を出す分にはNAI>AV3

・特徴が異なるAとBを融合させるというAI特有の常識はずれな事をやらせるとNAI君のほうが圧倒的に芸風が広い(逆に言えばAV3の芸風が狭い)

・クローズアップした顔の精緻さについてはクオリティタグの盛り方次第ではNAIはAV3に負けてない。ただし中距離以降になると顔の描き込みは圧倒的にAV3に軍配。

・多人数を出す構図はAV3の圧勝、というかNAI君が弱すぎ(すぐ顔が崩れる)

などなどトータルではNAIとAV3は甲乙つけ難いわけですが、ただ大多数的なニーズである「エロ可愛い女の子を綺麗に仕上げる」という一点においてNAI君はAV3に平均点という意味ではほぼ負けてます。散々批判されたDanbooruで学習した部分はなんだったんだしかし苦手とする弱点の部分を避ければまだまだ良い画を作れますし、そういう部分で作り手の知識・経験はまだ生きる気がします。

一方で最近は色々なモデル(学習データ)があり、芸風が広いけど細部が甘かったり、狙ったところに落としづらいタイプと、芸風が狭いけど仕上げの精度やクオリティが高いモデルという風に傾向が別れてる感じがします。

であれば芸風が広いモデル・サービスで案出しやimg2img用の素材あるいはカラーラフを出して、自分好みの画風のモデル・サービスで仕上げるという使い分けをするというやり方も有効なのではないかと思います。

これについては以前の記事でNAIで作った画像をAV3で仕上げるという内容を書いているので、お暇だったらご一読ください。

やはりよりクオリティを追求するにはこういった使い分けが大事かな?とも思いつつもこれらは相応に時間や手間がかかるために、今後はAIイラストといえども安易な量産は難しいのではないかと漠然と思っています。それにクオリティで競うとなれば今後は加筆なども当たり前という世界になると思われますし。

そしてそれは決して悪い事ではないとは思います。

それではまた記事のテーマができ次第更新していく予定なので、気長にお付き合い頂ければ助かります。

今後ともよろしくお願いします。

この記事が気に入ったらサポートをしてみませんか?