Claudeに長文を入れる時のコツ

最近、生成AIの世界で大きな注目を集めているのが、Anthropic社から登場したClaude3というモデルです。

今回は、そのClaude3について簡単に紹介した後、Anthropic社が公開した長文を扱う時のコツについて解説していきます。

1. Claude3の基本的な特徴

Claude3は、元OpenAIの社員が立ち上げたAnthropicという会社が開発した言語モデルです。

最近のバージョンアップでリリースされたClaude3はGPT-4よりも精度が高いと言われています。また、Claude3の大きな特徴は、最大20万トークンの長文を扱えることです。

GPT-4の12.8万トークンと比べると、かなり多くの情報を入力できます。

また、入力した情報をほぼ完璧に記憶できるのも魅力的です。

2. 長文を扱う際の2つのポイント

Anthropicのブログ記事によると、Claude3で長文を扱う際のコツは以下の2点です。

関連する回答例を複数含める

回答の根拠となる引用箇所を提示させる

一方で、関係のない回答例を含めても精度は向上しないそうです。

また、文章の後半部分の情報を扱うことをClaude3は得意としているとのことです。

3. 実験内容と結果の概要

Anthropicは、以下のような実験を行いました。

外部の文章を用意し文章をセクション毎に分割する

各セクションに関連する4択問題を生成

分割したセクションをランダムに並び替え、連結させて一つの文章とする

(位置による精度への影響を確認するため)様々なプロンプトで2の問題を与えたときの精度を確認

用意した文書と質問文を、以下の4パターンのプロンプトに組み込んでモデルに入力し、評価しています。

普通の入力:文書と質問文のみをモデルに入力

関連する回答例を含める:文書と質問文に加え、他のセクションの質問文と回答を2つまたは5つ含めてモデルに入力

関連しない回答例を含める:文書と質問文に加え、文章と関連しない回答例を含めてモデルに入力

引用箇所の提示を求める:文書と質問文に加え、回答の根拠となる引用箇所の提示をモデルに求める

また、モデルはClaude instant 1.2 を使用しています。これは、モデルが強すぎると関連情報以外の知識を使ってしまって、プロンプトの影響が見えなくなってしまうからということでした。

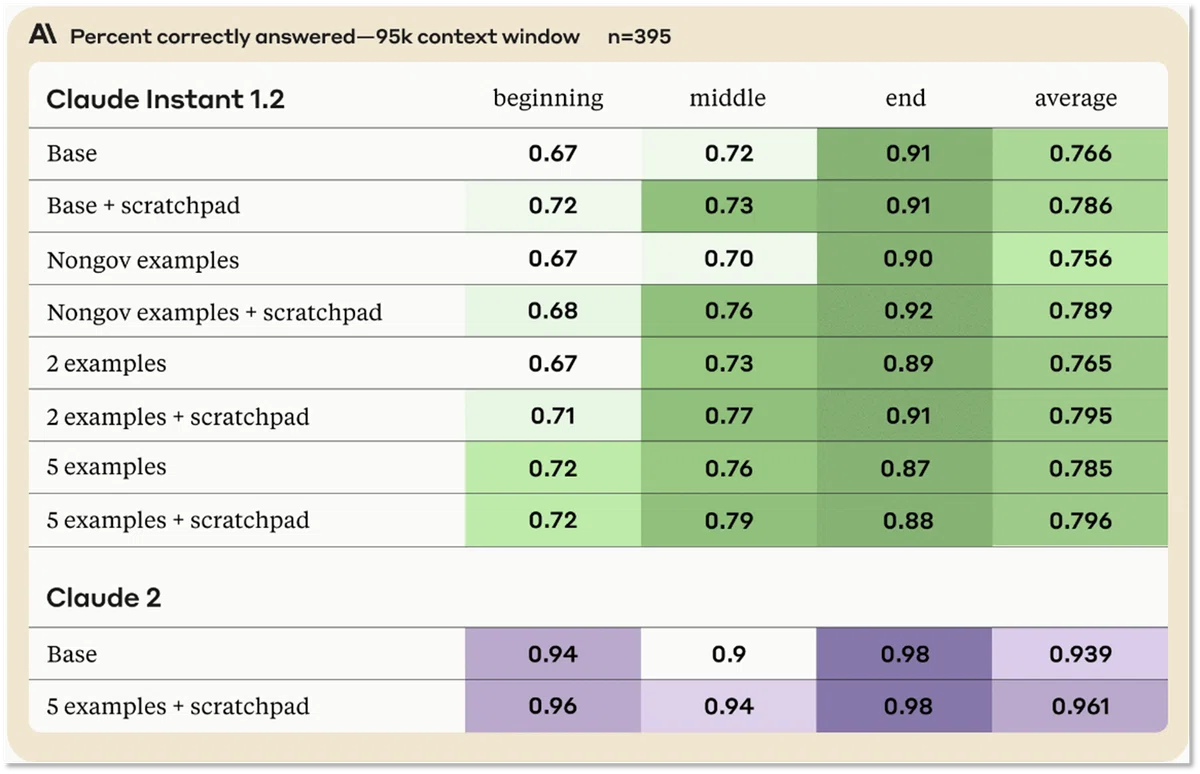

結果は下記となりました。

Baseが普通のプロンプト、scratchpadが引用箇所の提示、Nongovが関連していない回答例の入力、2-5 examplesが他のセクションの回答例を入力した場合の結果になっています。

また、beginning, middle, end でそれぞれ、関連文書の位置により精度が変わるのかも検証されています。

実験の結果をまとめると下記の事が明らかになりました。

文章の最初よりも最後の情報の方が、Claudeは扱いが得意

(endのスコアが高い)回答の引用元を提示させることで、精度が向上する

(scratch padによる効果から)関係ない回答例を含めても、精度はあまり変わらない

(Nongovで精度が上がっていない)文章に関連する回答例は、多く含めるほど精度が高くなる

(5exampleにすると精度が上がるため)

特に、回答例を5個含めた場合と引用元を提示させた場合の精度が最も高くなっていますね。

また、より性能の高いClaude2でも同様の実験が行われ、ベースラインの精度は高いものの、やはり回答例と引用元の提示によって精度が向上することが確認されました。

4. まとめ

今回は、Claudeで長文を扱う時のコツについて解説しました。

ポイントは以下の2つです。

関連する回答例を複数含めること

回答の引用元を提示させること

回答例を考えるのは少し面倒かもしれませんが、引用元を提示させるのはプロンプトに単純に入れるだけなので、個人的にはおすすめです。

精度が上がるだけでなく、ハルシネーションの対策にもなります。

Claudeのモデルは日々進化しているので、今後もどんな使い方ができるのか楽しみです。

皆さんも是非色々試してみてください。以上、Claudeで長文を扱う時のコツについての解説でした。

最後まで読んでくださりありがとうございました😆

最後にLINE 公式を始めたので興味があったら見てみてください。

https://liff.line.me/2004040861-3Jvq4bAG

ChatGPT, Claude3のプロンプトテクをまとめたプレゼントを無料で配布中です!(キーワード「プロンプト」と入力してください)

この記事が気に入ったらサポートをしてみませんか?