PerplexityAIは本家のChatGPTとClaude3と何が違うのか?

こんにちは、私はにゃんたという名前でYouTubeで発信をしています。

今回は、話題のPerplexity AIについて本家のChatGPTやClaude3のサービスとの違いなどを解説していきたいと思います。

生成AIに興味がある方にとって、Perplexity AIは非常に魅力的なサービスです。しかし、本家との違いや長文入力時の注意点など、知っておくべきポイントもあるので、それらを簡単にまとめます!

1. Perplexity AIとは

Perplexity AIは、GPT-4とClaude-3という2つの強力な言語モデルが使えるサービスです。

通常、これらのモデルを個別に利用するには、それぞれのサービスに登録し、料金を支払う必要があります。しかし、Perplexity AIなら1つのサービスで複数のモデルを使うことができるのです。(月額20ドルかかります)

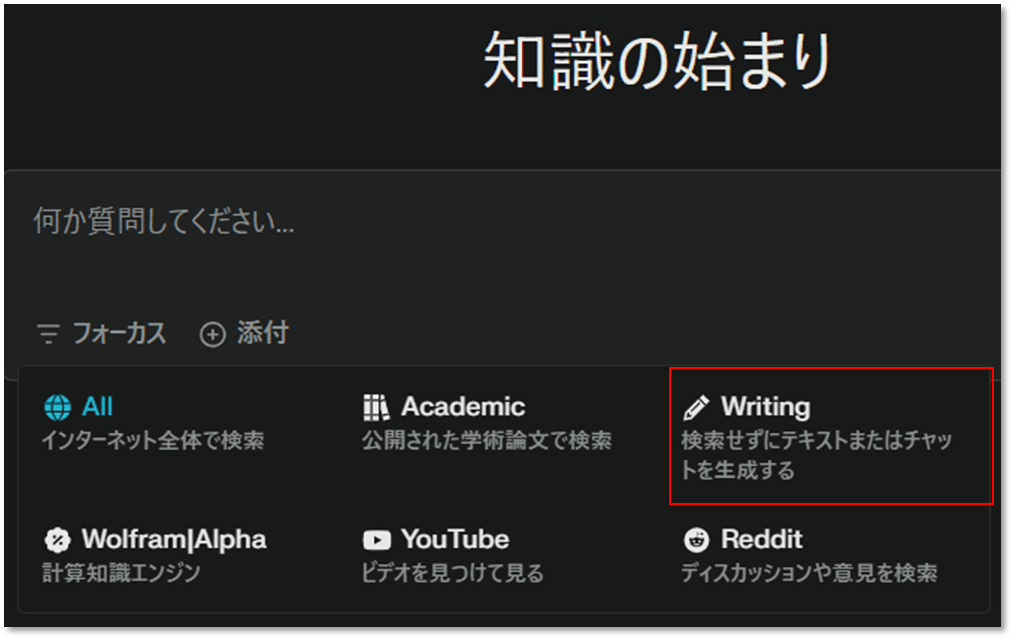

これは、各社の言語モデルをAPIを通じてアクセスしているからこそ実現できる強みといえるでしょう。特に、writingモードを使えば、本家のウェブ版と同じように、これらのモデルを活用できます。

2. Perplexity AIと本家の違い

Perplexity AIと本家のサービスには、いくつかの違いがあります。その中でも特に重要なのが、システムプロンプトの違いです。

システムプロンプトとは、言語モデルにデフォルトで設定されている指示のことで、これによって生成される文章の特徴が変わってきます。

本家のサービスでは、かなり詳細なシステムプロンプトが設定されています。例えば、GPT-4の場合はこのようなプロンプトが設定されています。

一方、Perplexity AIでは、よりシンプルなシステムプロンプトが使われています。

ユーザーが入力した文章は、このようなシステムプロンプトの後に続いて言語モデルに入力されます。違いによって、同じ入力を与えても、生成される文章が異なる可能性があるのです。

もう1つの大きな違いは、入力できるトークン数の上限です。

GPT-4 Turboの場合、スペック上はAPIを使えば最大で約13万トークンまで入力できるとされています。しかし、実際に本家のサービスで試してみたところ、24,000トークンでエラーが出ることがわかりました。

従って、ウェブ版では単純にGPT4-TurboのAPIが使用されているわけではないということがわかります。

一方、Perplexity AIでは、なんと25万トークン以上の入力でもエラーが出ませんでした。これは驚きですよね。

ただし、後述するように、Perplexity AIで極端に長い文章を入力した場合、別の仕組みが使われている可能性があります。

3. 長文入力時の注意点

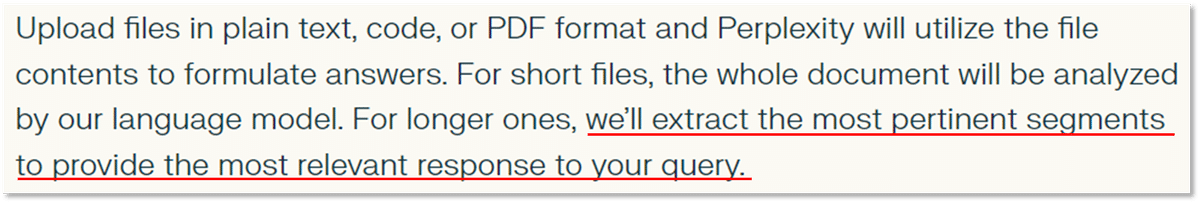

Perplexity AIで非常に長い文章を入力する場合、いくつか注意点があります。

まず、極端に長い文章では、本家のサービスの方が精度が良くなる可能性があるということです。

これは、Perplexity AIでは長文になると何らかの処理で全ての情報をモデルに入れていないと考えられるからです。

恐らくこれはRAGと呼ばれる仕組みが使われ、全ての文章がモデルに直接入力されないのではないかと推測されます。

では、どのくらいの長さでRAGが使われ始めるのでしょうか?

残念ながら、公式からの明確な情報はありません・・・。

ただし、海外の掲示板情報などを総合すると、30,000トークン程度が分岐点ではないかと推測されています。

つまり、30,000トークンあたりを超えるとRAGのような処理が使われ全てが入力されず、より短い文章ではモデルに直接入力されるのではないか?ということです。

ここら辺に関しては、まだ継続的に確認する必要があるため何かわかったらまた記事にしたいと思います。

とはいえ、30,000トークンというのは、かなり長いですよね。多くの場合、これより短い文章を扱うことが多いでしょう。その場合は、Perplexity AIでも十分に高い精度が期待できます。

4. まとめ

今回は、Perplexity AIの特徴と本家のサービスとの違いについて詳しく解説しました。

Perplexity AIは、GPT-4とClaude-3という2つの強力な言語モデルが使えるサービスです。APIを通じてモデルにアクセスしているため、本家のウェブ版と同じように使えることが期待できます。

ただし、システムプロンプトや入力トークン数の上限など、本家との違いもあります。特に、極端に長い文章を入力する場合は、本家の方が精度が良い可能性があるので注意が必要です。

とはいえ、多くの場合、Perplexity AIでも十分に高い精度が期待できるでしょう。生成AIを活用する上で、Perplexity AIは非常に魅力的なサービスといえます。

最後まで読んでくださってありがとうございました😆

最後にLINE 公式を始めたので興味があったら見てみてください。

https://liff.line.me/2004040861-3Jvq4bAG

ChatGPT, Claude3のプロンプトテクをまとめたプレゼントを無料で配布中です!(キーワード「プロンプト」と入力してください)

この記事が気に入ったらサポートをしてみませんか?