ラビットチャレンジ_機械学習1

・線形回帰モデル

・教師あり学習の1つで、予測問題を解く際に使用する。

・扱うデータ

・入力(説明変数):m次元ベクトル

・出力(目的変数):スカラー値

・パラメーターの推定方法

・最小二乗法を用いて推定を行う(最小二乗法以外にも方法はある)

⇒データとモデル出力の二乗誤差に和が最小になるような

パラメーターを推定する

※線形回帰の場合は、推定結果が最尤法の推定結果と同じになる

※外れ値には弱いため注意が必要

⇒Huber損失、Tukey損失は外れ値も考慮されている

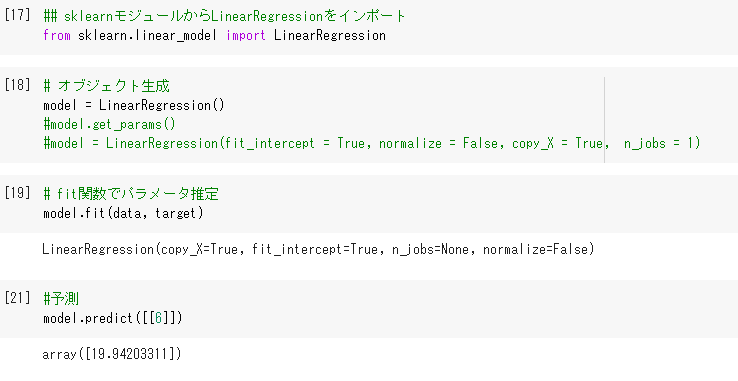

演習:ボストンハウジングデータを使った住宅価格の予測

・説明変数が「部屋数」の単回帰分析を行った場合

sklearnのLinearRegressionを使用すると簡単に学習と予測ができる。

※sklearnを使うと簡単に実装できてしまうが、中で何をやっているか

理解することが必要。

そのため、numpyのみで実装できるぐらいになることが大切!

・Numpyで実装した場合

(訓練データ:y = 2*x + 5にノイズを付加したデータを1000個準備)

この記事が気に入ったらサポートをしてみませんか?