Stable Diffusionを学ぶ、使いこなす

そもそも画像生成AIに関する知識

概要・種類

Stable Diffusion

OSS

一応DreamStudioというサービスもあっった

MidJourney

一番利用されているSaas

25枚まで無料、200分月10ドル

差 https://manamina.valuesccg.com/articles/2043

「Stable Diffusion」は写実的、「Midjourney」は抽象的

仕組み https://note.com/it_navi/n/ne238a3253b11

GANやDALLなども手法の発展によりこれがサービスやOSS化が進んだ

拡散モデルの画像生成AI

訓練済のAIモデル(Diffusion Model)

テキストと画像の類似度をとらえる CLIPと、潜在空間上で高解像度・高速な生成を実現する拡散モデルLDMを組み合わせたもの

LAION-Aesthetics と呼ばれる「美しい」画像のみを集めたデータセットを用いて訓練されているという特徴がある

https://ai-scholar.tech/articles/image-generation/DiffusionModels

Stable Diffusion

どのように画像を作っていくのか

利用方法

生成には時間がかかるのでやりやすい環境を作る・用意する

ローカル(PCスペックに依存する)

Mochi Diffusionなどのデスクトップアプリ

vscode + JupyterNotebook のような自前の実行環境

stable diffusion web ui のようなローカルでビルド+起動するアプリケーション(私の環境だとエラーが解決できなかった、GPU関連の閑居依存が・・・)

ブラウザ(いずれも無料)

指定できる設定

モデル

既存

公開されているモデルファイル(SafeTensors版は、セキュリティ面も安全で、読み込み速度も若干速い)

自作、改変手段

好きな絵柄・キャラクターのイラストを生成しできてしまう

Guidance Scale

プロンプトにどれくらい忠実に描画を行うか

Steps

どれくらい精細に描画するか

パラメータによって品質が異なる

Seed

再現性の固定

Negative Prompt, Prompt

言わずもがな

一通り触ってみて

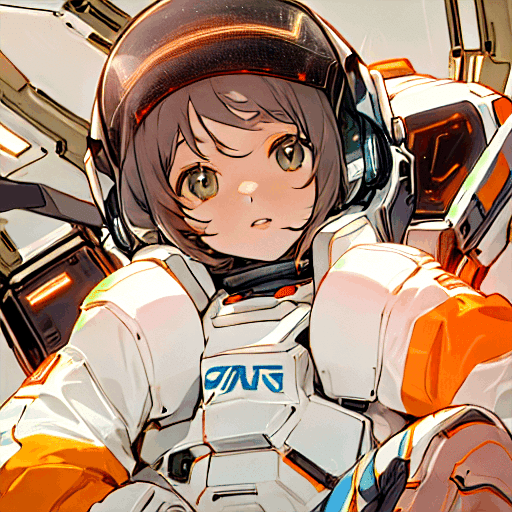

自分がビールを飲んでいる写真をアストロ美女に転生させることに成功した。基本は

プロンプトの指定(ネガティブも含めて

パラメータの指定

モデルの指定

の勘所を探りつつ、DTMの音源を探すようにほしいものに近い実績のあるモデルを探すのが近道。あとは人のプロンプトを真似て変えてみる。プログラミングに近いものを感じた

この記事が気に入ったらサポートをしてみませんか?