mocopi を使うにあたって知っておいた方がいいこと、あるいはトラッキングの民主化について

先日、ついに mocopi が発売されました。

モーショントラッキング用のデバイスといえば、

こんなんだったり、

こんなんだったり、

メカメカしいものが多い中での

これ。

これは万人受け間違いなし。この mocopi、実際どうなの? という点について色々と述べていきます。

なぜこんな記事を書いたのかというと、比較過程のビデオで(意図せず結果的に)mocopi に不利な条件で比較をして、それがけっこう拡散してしまったので訂正というか罪滅ぼしに。あきらさんごめん……。

ハードウェアの完成度

まず、ハードウェアの完成度はダントツです。小さいし、パッケージングも今までにないポップ感。ここら辺はさすが Sony。スマホで完結するからチュートリアルもすぐ。特に、装着していることを忘れるほどの快適さは他のデバイスにはないものです。

引き合いに出して悪いですが、HaritoraX はパワードスーツを着てるみたいでした……。

すでに、「全部のデバイスを外したつもりが Hip トラッカーだけつけっぱなしにしていた」という mocopi あるあるを経験しています。これはユーザーなら絶対に一度はやると思います(断言)。

次に、肝心のトラッキング性能について。

トラッキング性能

忖度抜きで言うと、トラッキング性能は良くないです。

端的に言って、mocopi は買いか? については、結論としては

ダンス用、もしくは動きにこだわるならNG

それほど大きく動かないならあり

この比較動画を見れば一目瞭然かと思います。

バグ対策をして、mocopi x HaritoraX x ViveTracker の BeatSaber 実地試験、第四段になります!

— hibit (@hibit_at) January 26, 2023

これで大分フェアな条件になったと思います。

不手際が多くてすいません。お詫びに……背面斬りします!

正面カメラもあるよ。#mocopi#HaritoraX#バーチャルモーションキャプチャー#BeatSaber pic.twitter.com/ySAbFlhKF1

方式の違い

トラッキング精度だけを求めるなら Vive Tracker が依然として最強です。それは外部にベースステーションを持っているという優位性があるからです(その分、ハードウェアを購入・設営するのが大変)。HaritoraX、Uni-Motion、mocopi といった、相対的な位置しか取れない機器は、

自分の絶対的な位置が分からない

積算値がズレる

といった根本的な弱点があります。なので、動きにこだわるなら「mocopi がNG」というよりは、「Vive Tracker 以外のすべてが NG」 といった方が正確です。Tundra は Vive と同じライトハウスを使ってるけど、まあ話がややこしくなるから今回は割愛で……。

適した用途

逆に、適した用途はこの逆です。

自分の絶対的な位置を気にしなくていい

積算値が蓄積するのが遅い

端的に言うと、VTuber の放送や、VR セミナーでの発表のような、その場で話し続けるだけのシチュエーションです。

じゃあ、そういう用途だったら HaritoraX や Uni-Motion よりデバイスが小さくてアドじゃん!……と思いきや、HaritoraX と比較したところ、ドリフト(積算値の計算により、肉体は動いていないのにアバターは動いて見える現象)の度合いが激しいし、再キャリブレーションが必要な頻度も大きいように感じます。

やはり、センサーが小型である分、そこはトレードオフなのかもしれません。

スタンドアロンはすごいけど

Vive Tracker は言わずもがなですが、HaritoraX だって Uni-Motion だって、PC がなければ、というか SteamVR がなければ意味がないものになります。あくまで PC という演算装置があって、それを補助する「トラッキングデータ発信装置」です。そして、多くの場合はそれがキャプチャを介して最終的なコンテンツ(配信とか動画とか)になります。

その点、mocopi はそれ単体で動画を作成できるのが特筆すべき点です。スマホ片手に散歩に出て音声つきのアバター動画を撮る、ということもできます。

ただ、あくまで、スタンドアロンでの動画撮影はチュートリアルのようなものだと思います。入り口としてはいいかもしれませんが、本当にただ動画を撮影するだけだったら、たぶんすぐ飽きます。それなりの配信画面にするなら、3Dモデルの変更とか背景との合成とかが必要です。

いや俺は自分一人で Raynos ちゃんが踊っている動画を見てニヤニヤしたいんだ! という人もいるかもしれませんが、多くの人にとってはモーションキャプチャーは目的ではなく手段であるはずです。配信でも VRChat でも何でもいいですけど、結局それを使って何をしたいかが大事です。

その時に、スマホだけでそれが実現できない可能性もあります。それを実現するためには、他のデバイスと同じようにトラッキングデータ発信装置として使う、つまりモーションモードで使うことも必要になるでしょう。

問題対処も必要

ちょっとここだけ技術的な話。

モーションモードだと色々なことを気にする必要があります。IPアドレス、ポート番号の指定。ここら辺は Sony のマニュアルにあります。

現状、PC と連携するにはばもきゃを使うことが多いと思います。そこで、頭と手は Vive や Oculus に合わせたい! みたいな時は、ばもきゃ側の設定で「VR機器の併用」をチェックする必要があります。というか、そうしないとドリフトでどんどんズレていきます。初期設定だと mocopi オンリーの設定になっているので注意。

また、Vive トラッカーや Haritora トラッカー等のデバイスが SteamVR 上に残っていると、それらと混同してトラッキングがおかしくなってしまうバグが存在するようです。

一つ教えていただきたいのですが、SteamVR上でHMDとコントローラー以外にHaritoraX等のデバイスがグレーアウトして表示された状態でキャリブレーションされてるでしょうか。トラッカー割り当てで腰と足を割り当て無しにしないとそれを自動で拾ってしまい、変な動きになってしまうバグがあります

— あきら☎︎@VMC (@sh_akira) January 22, 2023

これを防ぐには、そもそもアドオン管理でトラッカーが発生しないようにするか、ばもきゃ側のトラッカー割り当てを「なし」にする必要があります。

こういうのって、必要な情報がすぐには出てこなかったり、そもそも公開されていなかったり、開発者さんや詳しい人と直接話す必要があったりで、能動的な問題対処能力が必要になります(助言くれた Reiya さん、あきらさん、ありがとうございました!)。黎明期の技術にはありがちなことですが。

まあ、スマホ単体で動画撮影している限りでは「お客様」でいいと思いますが、モーションモードを使い始めたら「こっち側」に入ったとみなしていいですよね……?

なんかハードルを上げる言い方をしてしまいましたが、ある程度明確な目的がないと結局「動画を取って数分楽しむだけのコンテンツ」になってしまいます。それではもったいないので、皆様にはぜひともモーションキャプチャーのポテンシャルをフル活用して、より深みにハマって欲しいなと、既に沼に両足を突っ込んでいる身からは思う次第です。

民主化に向けて

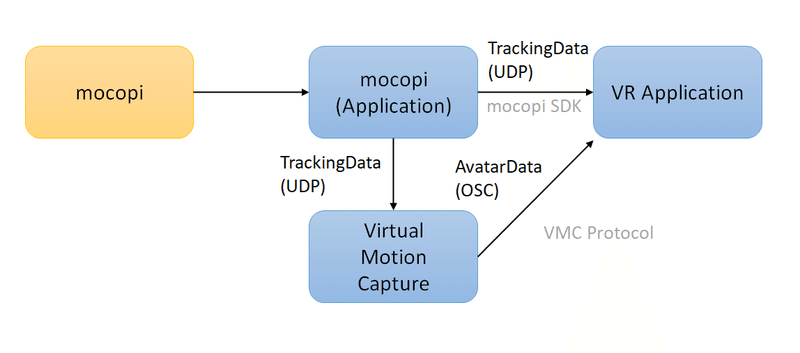

改めて注目したいのは、mocopi が SteamVR に依存しないシステムとしてトラッキングデータを受け渡すプロトコルを成立させているという点です。

以前から、ユーザーは質の高いモーションキャプチャーを実現できていま

したが、それには「SteamVR を介して」という枕詞がついていました。

対して、mocopi は、スマホアプリの時点からモーションデータを UDP 送信できます。

それをばもきゃプロトコルを介して送信することもできますし(この場合は VRM のアバターごと送れます)、mocopi SDK を使えば mocopi から直で受け取ることもできます。この間に SteamVR は一切介在していません。

ばもきゃがリリースされた当時、モーションキャプチャーを民主化すると言われましたが、その時はまだ事実上 SteamVR でのトラッキングを前提としていました。しかし、現在では mocopi を使うことで、より低いハードルでモーションキャプチャーを扱うことができます。より民主化したと言えるのではないでしょうか。

なお、これで mocopi SDK がオープンソースだったりしたら本当の意味で民主化ですが、さすがにそんな話はなく、規約によると商用利用は別途契約が必要とのことです。Sony も企業なのでこれは当然ですが。

そのため、mocopi が実現したのは「二大政党制」といった方が正しいと思いますが、SteamVR の独占でないというだけでも意味は大きいと思います。

もしかしたら、将来の VR ゲームは、mocopi SDK が一般的になって、ARグラスにスマホと mocopi だけでやるのが当たり前になっているかもしれません。コアゲーマー向けの SteamVR とライトユーザー向けの mocopi みたいな。ここら辺は妄想です。

要約

mocopi のハードウェアはとても良い

mocopi のトラッキング性能はあまり良くない

精度を求めるなら Vive Tracker 一択

講演や配信なら適任かも

PC連携で更に世界が広がる

ある程度目的意識とスキルが必要

SteamVR に依存しないプロトコルであり、将来性がある(かも)

この記事が気に入ったらサポートをしてみませんか?