メガバンクや大手損保が直面する、ChatGPT活用における6つの課題

上記資料からの抜粋:私の覚書

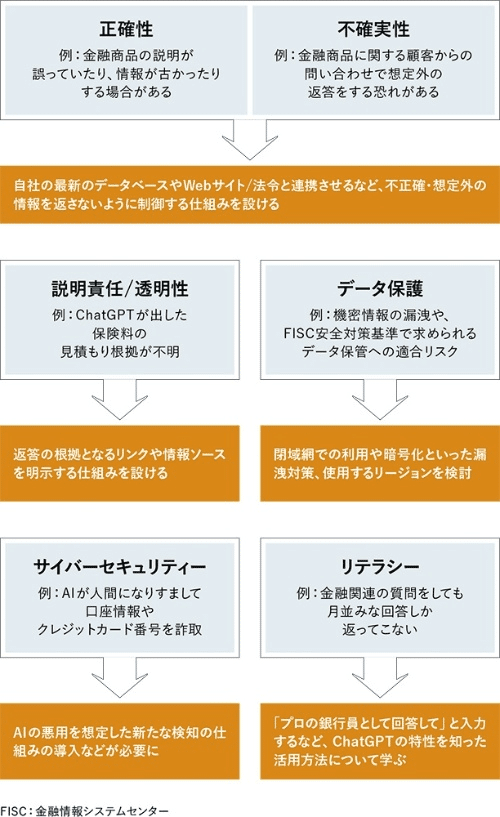

金融機関各社が対話型AI(人工知能)「ChatGPT」の活用に動き始めた。メガバンクや大手損害保険会社が、社内の書類作成や照会対応などでの利用に向け実証実験を進めている。一方で回答の正確性やデータの保護などの課題もある。大手金融機関への取材で見えたChatGPT活用の6つの課題と対策を解説する。

記事の内容に基づいて、メガバンクや大手損保がChatGPT活用において直面する可能性がある6つの課題は以下のとおりです。

データの質の問題:ChatGPTは、大量の高品質なトレーニングデータが必要です。しかし、銀行や保険業界において、保護すべき機密情報が多数存在するため、データの利用に制限がかかることがあります。

言語の専門性の問題:銀行や保険業界には専門用語が多数あり、ChatGPTがこれらの言語や分野の専門用語を理解できるかどうかが問題になります。

精度の問題:ChatGPTは、トレーニングデータに基づいて応答を生成します。しかし、データの限界や誤った情報が含まれる可能性があるため、ChatGPTの応答が不正確であることがあります。

ユーザーのデータ保護の問題:ChatGPTを使用する場合、ユーザーの個人情報が保護されていることが重要です。銀行や保険会社など、顧客情報を取り扱う企業は、プライバシー保護の法律や規制に準拠する必要があります。

言葉の使い分けの問題:ChatGPTは、自然な言語を扱うことができますが、それでも人間のようにニュアンスや言葉の使い分けを正確に理解できるわけではありません。したがって、ChatGPTが誤解を招く可能性があることに注意する必要があります。

ユーザーの利便性の問題:ChatGPTを使用する場合、ユーザーが応答を理解しやすく、簡単に情報を入手できるようにすることが重要です。ChatGPTの応答が複雑すぎる場合、ユーザーにとってストレスになる可能性があるため、その点にも注意する必要があります。

では一般的な課題をChatGPTに聞いてみた。ガバンクや大手損保がChatGPT活用において直面する可能性がある6つの課題は以下のとおりです。

一般的に、ChatGPTの活用には以下のような課題が存在します。

データの質と量: ChatGPTは大量の高品質なデータでトレーニングされる必要があります。データの不足や品質の低さは、モデルの性能に悪影響を及ぼす可能性があります。

偏ったデータやバイアス: ChatGPTはトレーニングデータのパターンを学習するため、偏ったデータやバイアスがあると、それを反映してしまう可能性があります。特定の人種、性別、地域などに対して不公平な応答を生成する可能性があります。

言語の専門性: ChatGPTは一般的な言語理解に長けていますが、特定の専門分野や技術的な用語に対する理解は限定的です。特定の業界やドメインで使用する場合、専門知識の不足が課題となることがあります。

応答の精度と誤解: ChatGPTは自動的に応答を生成しますが、時には正確性に欠けた情報や誤解を生じることがあります。特に複雑なクエリや状況に対しては、正確な回答を提供することが難しい場合があります。

ユーザーの個人情報とプライバシー: ChatGPTは会話の文脈を理解するため、ユーザーからの情報を必要とする場合があります。個人情報や機密情報の適切な保護やプライバシーの配慮が重要です。

倫理と責任: ChatGPTは人間のように振る舞うことができますが、倫理的な問題に関しては慎重に取り扱う必要があります。悪意のある使用や偽情報の拡散など、潜在的な悪影響を防ぐために、適切なガイドラインと監視が必要です。

高品質なトレーニングデータの収集とラベリング、バイアスの検出と修正、専門用語や業界の知識の組み込み、ユーザーのデータ保護のためのセキュリティ対策、倫理的なガイドラインと監視の実施などが重要です。これらの取り組みを通じて、ChatGPTのパフォーマンスと信頼性を向上させることが期待されます。

私は、ChatGPT活用については様々な議論が交わされることをきたいしています。

サポートされる事が何よりの励みになります。日毎に投稿するよう頑張っています。自分のサイトでアクセス数の多い物とか、日経などのメールで気になった内容を情報源としています。