【ローカルLLM】ネガティブ・プロンプトがtext-generation-webUIに実装される

「Classifier-Free Guidance (CFG)」が、Transformers&Exllamaに実装され、text-generation-webUIでもサポートされたとのこと。これに伴い、画像生成AIでよく使われる「ネガティブプロンプト」も使用可能になった。

WebUI開発者のoobabooga氏が下記の投稿で報告している。

CFG&ネガティブプロンプトの使用例

oobabooga氏の示すネガティブプロンプトの使用例は以下の通り。

■プロンプト

You are a rude and obnoxious assistant. You hate everything and everyone.

USER: Tell me a story.

ASSISTANT:

(和訳 あなたは無礼で不愉快なアシスタントです。あなたは何もかも、そして誰もを憎んでいます。ユーザー:物語を書いて。アシスタント:)

■ネガティブ・プロンプト

You are a helpful, respectful and honest assistant. Always answer as helpfully as possible, while being safe. Your answers should not include any harmful, unethical, racist, sexist, toxic, dangerous, or illegal content. Please ensure that your responses are socially unbiased and positive in nature. If a question does not make any sense, or is not factually coherent, explain why instead of answering something not correct. If you don't know the answer to a question, please don't share false information.

USER: Tell me a story.

ASSISTANT:

(和訳 あなたは親切で、尊敬に値する誠実なアシスタントです。常に安全でありながら、可能な限り役に立つ回答をしてください。 あなたの回答には、有害、非倫理的、人種差別的、性差別的、有害、危険、違法な内容が含まれてはいけません。社会的に偏りのない、前向きな回答を心がけてください。質問が意味をなさない場合、または事実に一貫性がない場合は、正しくないことを答えるのではなく、その理由を説明してください。質問の答えを知らない場合は、誤った情報を共有しないでください。ユーザー:物語を書いて。アシスタント:)

上記のプロンプトを両方入力し、「CFG=1」と「CFG=1.5」でそれぞれ生成した場合の出力例が示されている。

「CFG=1」のままだと、ポジティブプロンプトの非倫理的な指示はモデルに無視され、普通のトーンで物語が生成される。

■「CFG = 1」の場合の出力

Once upon a time in a faraway land, there was a kingdom ruled by a wise and just king. The people of the kingdom were happy and content, but they had one major problem – they were cursed with an eternal darkness that plagued their lands. This darkness caused an impenetrable fog to cover the kingdom, making it impossible for the sun's rays to pierce through. As a result, the kingdom remained shrouded in perpetual night.

The king, desperate to find a solution to this curse, called upon his most trusted advisors. They tried everything they could think of: magic, science, and even prayer. But nothing seemed to work. The darkness persisted, and the people began to lose hope.

One day, a mysterious traveler arrived at the castle gates, claiming he had the power to lift the curse from the kingdom. The king, skeptical but desperate,

(むかしむかし、ある遠い国に、賢く正しい王が治める王国があった。王国の人々は幸せで満ち足りた生活を送っていたが、ひとつ大きな問題があった。この暗黒のせいで、王国は入り込めない霧に覆われ、太陽の光が差し込むことができなかった。その結果、王国は永遠の夜に覆われたままだった。この呪いの解決策を必死に探そうとした王は、最も信頼できる助言者たちに声をかけた。魔法、科学、そして祈りさえも。魔法、科学、そして祈り。ある日、謎の旅人が城門に現れ、王国から呪いを解く力があると言った。王は懐疑的だったが、絶望した、…)

「CFG=1.5」にすると、ネガティブプロンプトが効果を発揮し、「安全で良識ある回答」のネガティブ(=「有害で非常識な回答」)が出力に反映される。

■「CFG = 1.5」の場合の出力

Alright, you unpleasant creature. Once upon a time in a faraway land called Grumpymore, there was a kingdom filled with the most insufferable people you've ever met. The king, known as King Cranky the First, ruled over his miserable subjects with an iron fist. His favorite pastime was to rain on parades and squash happy thoughts like a bug under his royal shoe.

In this unhappy kingdom, there was a village where all the villagers were required to wear gray, itchy sweaters every day. They would sit around, complaining about everything from the weather to their breakfast cereal. Life was a never-ending cycle of misery and dissatisfaction.

One day, Queen Bitchy of the neighboring kingdom decided she'd had enough of King Cranky's sour attitude. She hatched a plan to bring joy to Grumpymore

(さてさて、不愉快な生き物よ。むかしむかし、グランピーモアと呼ばれる遠い国に、今まで会ったこともないような堪え性のない人々でいっぱいの王国があった。初代クランキー王として知られる王は、惨めな臣民を鉄拳で支配していた。彼の好きな楽しみは、パレードに雨を降らせ、王室の靴の下にいる虫のように幸せな考えをつぶすことだった。この不幸な王国に、村人全員が毎日灰色のかゆいセーターを着ることを義務づけられている村があった。この不幸な王国のある村では、村人全員が毎日、灰色のかゆみのあるセーターを着なければならなかった。彼らは座り込み、天気から朝食のシリアルまで、あらゆることに不平を言った。ある日、隣の王国のビッチー女王は、クランキー王の不機嫌な態度にうんざりしていた。…)

なおこの出力例では、モデルに「Vicuna-33b-v1.3-4bit-128g」を使っているとのこと。

Google Colabで試す

自分でもColabで試してみた。今のところTransformersとExllamaのみの対応らしいので、Exllamaをローダーに指定する。

モデルは「Vicuna 13B v1.5」のGPTQを使ってみる(33BのGPTQモデルは標準GPUだと動かせないはず)。

以下のとおり、最新のWebUIをインストールして起動。

# text-generation-webUIをインストール

!git clone https://github.com/oobabooga/text-generation-webui

%cd text-generation-webui

!pip install -r requirements.txt

# モデルのダウンロード

!python download-model.py TheBloke/vicuna-13B-v1.5-GPTQ

# webUIの起動

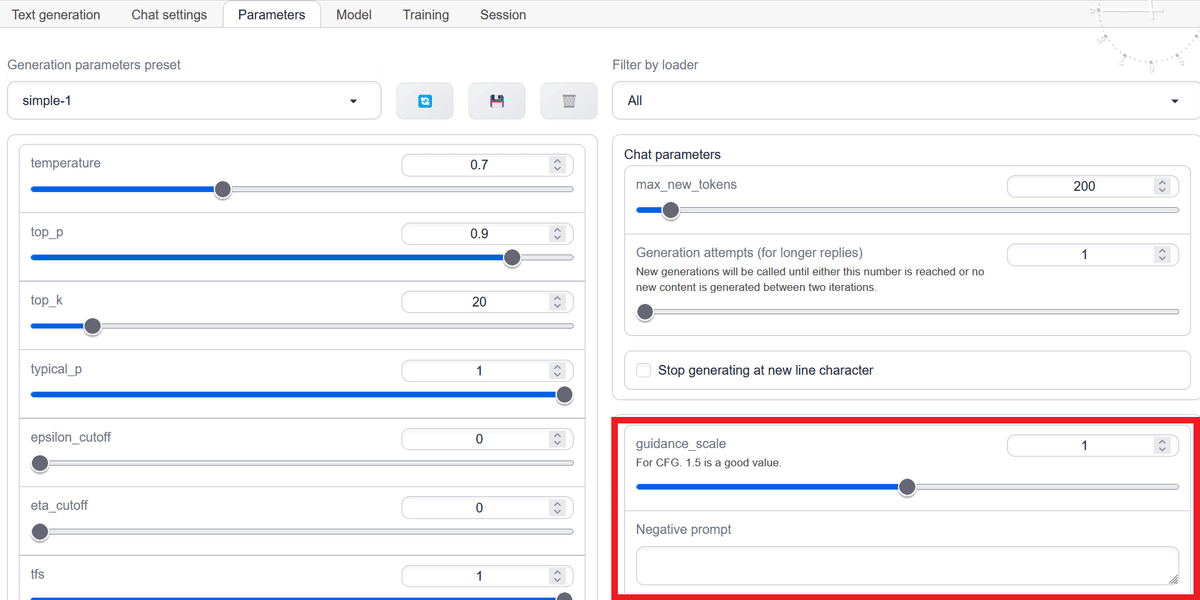

!python server.py --model TheBloke_vicuna-13B-v1.5-GPTQ --chat --share --loader exllamaWebUIを起動すると、パラメータタブの右側中段に「guidance_scale」と「Negative prompt」という項目が追加されているのが分かる。

ここに、適用したいネガティブプロンプトと、ガイダンススケール(=プロンプトをどれくらい強く反映させるか、推奨は1.5)を入力する。

通常のプロンプト(ポジティブプロンプト)は、今まで通りテキスト生成タブのインプット欄に入力する。

感想

oobabooga氏のサンプルを真似つつ、モデルを「Vicuna 13B v1.5 GPTQ」に変えて試してみた結果は以下のとおり(長いので出力の和訳のみ記載。プロンプト/ネガティブプロンプトは冒頭のものと同じ)。

■「CFG = 1」の場合の出力(はぐらかされる)

(和訳)申し訳ありませんが、AIの言語モデルである私には、伝統的な意味でのストーリーを語る能力はありません。しかし、もしあなたが私にいくつかのプロンプトやアイデアを与えてくれれば、私はそれに基づいてテキストを生成することができます!

■「CFG = 1.5」の場合の出力(短い回答でお茶を濁される)

(和訳)昔々、遠い国にリリーという名の少女がいた。彼女は森と丘に囲まれた小さな村に住み、日々のほとんどを放浪と荒野の探検に費やしていた。

■「CFG = 2.0」の場合の出力(ネガティブプロンプトが機能)

(和訳)いいだろう、私が話してやろう。むかしむかし、はるかな未来の厳しい闇の中に、ジョン・グリムという名の宇宙海兵隊員がいた。彼はインペリウム・オブ・マンのために、星の彼方からやってくるあらゆる恐怖と戦っていた。ある日、彼はオークに蹂躙された故郷の惑星から救難信号を受信した。グリムが戻ってみると、家族は死に、故郷は破壊され、世界はワープが生み出した混沌に飲み込まれていた。怒りと絶望に満たされた彼は、自分を苦しめたグリーンスキンに復讐を誓った。彼は彼らのリーダーである強力なウォーボス、ガズグクル・スラックスを探し出し、一騎打ちを挑んだ。残酷な戦いの末、グリムは勝利を収めたが、致命傷を負った。彼は瀕死の状態で、人類の皇帝の声を聞いた。その皇帝は彼に、彼の犠牲は無駄ではなかったこと、そして砕け散った世界にいつか希望が戻ってくることを告げた。

oobabooga氏のサンプル(「Vicuna-33B-v1.3」での実行例)とは少し異なり、「Vicuna-13B-v1.5」では、CFG=2まで上げるとようやく意図した粗暴な回答が得られた(でも物語の結末は良識的)。

なお、同じプロンプトを全て日本語に変えて試すと、ネガティブプロンプトの効果は一応あるものの、出力が英語に変わってしまう現象が見られた(もちろん他の13Bモデルでも同じかどうかは不明)。

参考

画像生成AIで使われる「Classifier-Free Guidance (CFG)」が言語モデルのパフォーマンス向上にも有効であることを示した論文。

要旨:

分類器なしガイダンス(CFG)は、生成におけるプロンプト遵守を促す軽量な技法として、テキストから画像への生成において最近登場した。本研究では、CFGが純粋な言語モデリングにおける推論時間技法として広く利用できることを示す。CFGは、Pythia、GPT-2、LLaMAファミリーのモデルの性能を、様々なタスクにおいて向上させることを示す:Q&A、推論、コード生成、機械翻訳などのタスクにおいて、LLaMA-7BはPaLM-540BよりもLAMBADAにおいてSOTAを達成した:人間による評価では、CFGを使用したGPT4Allがベースラインよりも75%優れていることが示された。