Xlabs Flux ControlNet V3 with ControlAltAI sampler

Flux1用のControlNetモデルを世界に先駆けて公開したXlabsですが、V3で相当完成度を上げてきました。

前回記事でも書きましたが、V2では、特にcannyにおいて相当ストレスを感じる仕上がりでしたが、

V3では強度を上げても絵が破綻しにくく、かつ強度を下げた設定でも追随性がかなり向上しています。

一方、ControlNetとLoRAをロードする為のノードはxlabs独自の取り回しに依存する為に、私自身がサポートメンバーにもなっているControlAltAIは、Xlabsの排他的なノードにはやや批判的な見解を持っているようで、近日のFlux1用ワークフローの公開を予告しつつ、Github上では独自のSamplerやControlNetローダーを投入しています。

こちらは、彼ら自身が宣言した通り、従来のノードとの互換性を意識した作りになっています。

(※モデルは作成していないが、Xlabs V3がそのまま使用できる)

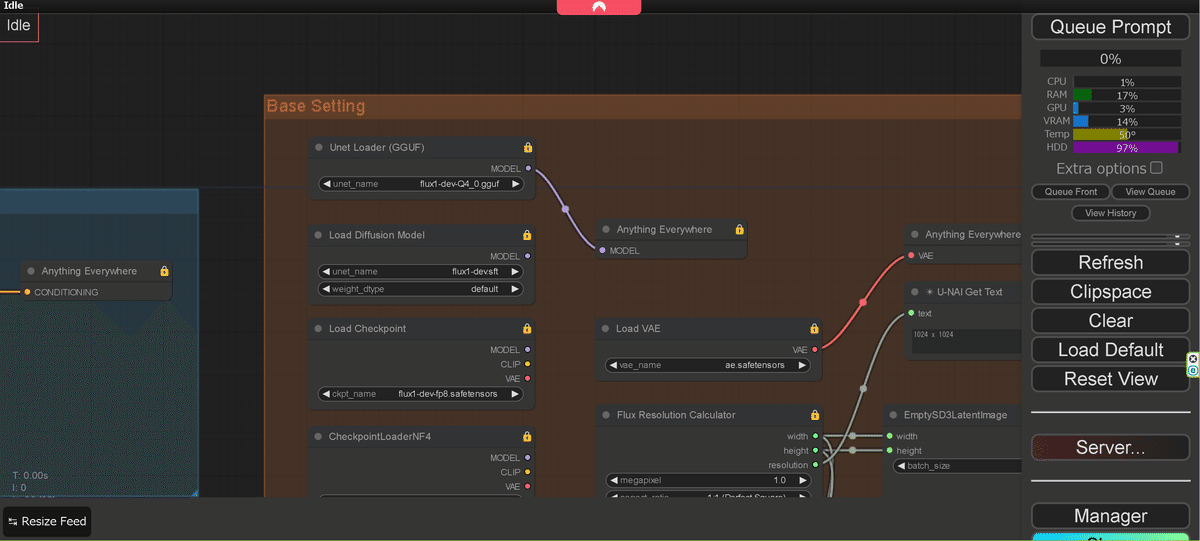

上を踏まえて、Xlabs ControlNet V3を想定したワークフローを、Xlabs SamplerとControlAltAI Samplerの二種類作成しました。

今回は双方ともにLoRA併用を想定しています。

ControlAltAI Sampler

Xlabs Sampler

尚、上の2つのワークフローでは下の記事でも一例解説していますが、私が独自に改造したノードを使用しています。

上の記事から更に改造を加えていますが、下のファイルを使用してください。使用する場所は、上の記事内で解説しています。尚、下のファイルでは上記事で一度改造したcondition用のコードは元に戻し、別のノードを改造しています。

Xlabsの排他性の問題はForgeでも露呈しています。実は、Xlabsが公開しているLoRAモデルはForgeではロードされないのです。

NF4でもGGUFでもLoRAを使用できるKModelという形式へのコンバートがForgeの売りですが、Xlabsが公開したLoRAは何れもKModel変換に対応できないようなのです。

また、ComfyUIでも従来のローダーでは使用できず、Xlabs専用のローダーでしか使用できません。

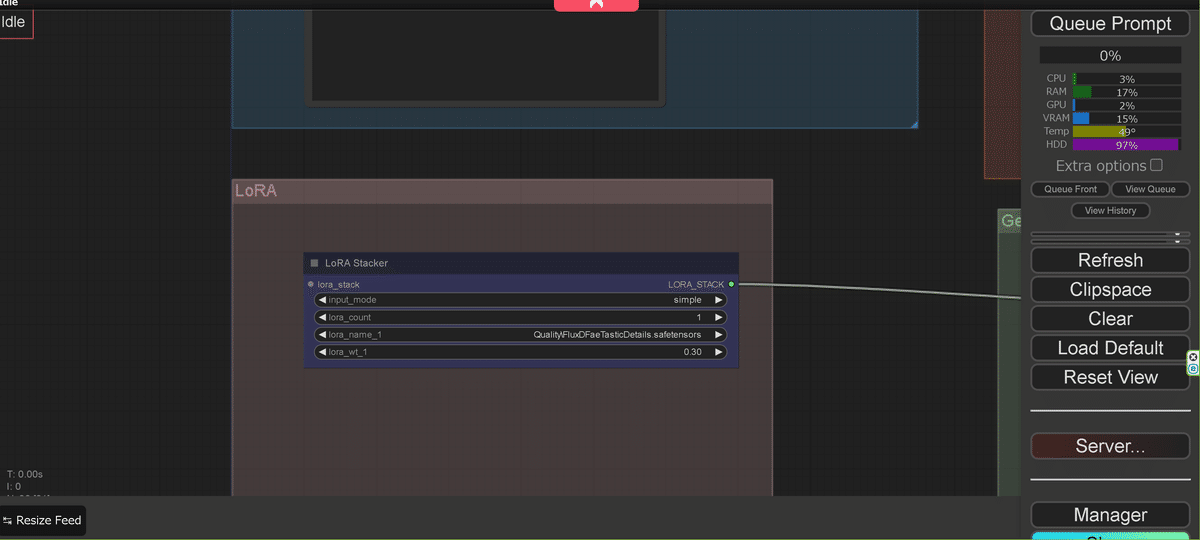

一方、ControlAltAIのノードでは、下図のように従来のLoRA Loader各種がそのまま使用できます。

ちなみに現状、ComfyUIではNF4モデルでのLoRA使用はできませんが、GGUF形式ではLoRAが動作します。これはXlabs SamplerでもControlAltAI Samplerでも同様です。

VRAM消費ですが、GGUF-Q4_0であれば、LoRAとControlNetを併用しても、ギリ12GBに収まっています。

この記事が気に入ったらサポートをしてみませんか?