特殊な辞書の電子テキスト化に苦戦

電子データにしたいものってけっこうあり,そのひとつがかつてでた『全国アクセント辞典』(平山輝男,1960)です。

これは東京・京都・鹿児島のアクセントが一気に調べられるとても便利な辞書なんです。電子化して検索できるようにできたらとても便利ですよね。ただ10万語もあるので手入力は手間です。なのでスキャンしてOCRにかけて手間を省けないか考えました。

しかし、その表示がちょっと特殊でうまく行きません。

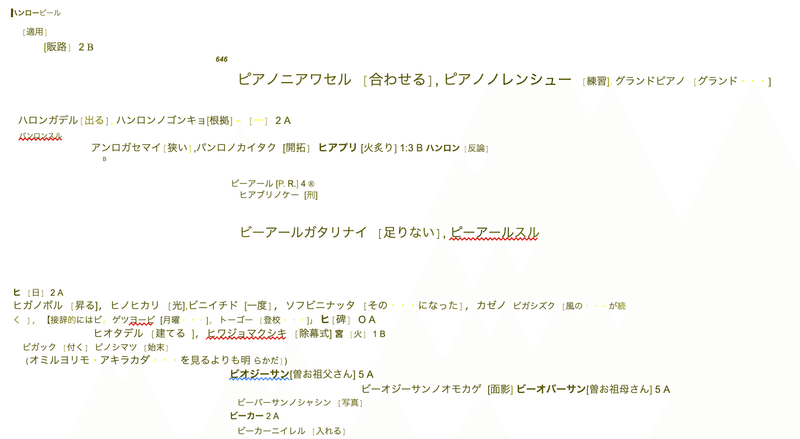

見出しのカタカナの上線が東京のアクセント(※最近のアクセント辞典だと下がり目の有無と位置だけですが)、右の丸数字が京都のアクセント、その右の丸の中のAとBが鹿児島のアクセントです。

やってみたこと

Macのプレビュー(Windowsのエクスプローラ相当)に付属のOCR機能を使うとこうなります。

丸文字はほぼ全滅(○Bは8と認識etc.)

左右の段組を反映せず(「適用」の直後に右段の「ビアノニ〜」がある)

余分なスペースが多い

上線は出ない

スマホ(iPhone)のカメラによるテキスト認識もこうなります。

丸数字はほぼ全滅(プレビューよりまし?)

段組は反映している

余分なスペースはない

上線は出ない

Google DriveにもOCRがついていて,PDFを読みDocsから開くと文字を認識します。

フォントの大きさは調整可能なので無視します。

丸数字はましになってきた

段組は反映していない

余分なスペースはないが,テキストが前後しているところがある(例:反論と反論が出る)

上線は出ない

ChatGPTも有料版についているAdvanced Data Analysis機能の中にOCR機能があります。これは日本語学習データで学習させることで日本語の認識も出来るようになるはずですが,何度やっても失敗しました。

Tesseractという多言語対応のOCRソフトがあります(無料)。上のChatGPTの中で動いているのもこれのようです。Python上でも使えてなかなか優秀なようなので思い試してみました。

丸数字はわりとましだが○A・Bはダメ。○ゼロもダメ。

段組は反映している

余分なスペースが入る

上線は出ない

そのまま使えるのはあまり期待していませんでしたが,だいぶ厳しそうです。

まだやってないこと

ただTesseractは学習データを用意すれば追加学習できるようです。

まだ試していませんが,もし数ページ分のデータで精度が改善されるならだいぶ助かります。こりゃお勉強が必要ですね。

この記事が気に入ったらサポートをしてみませんか?