最近の記事

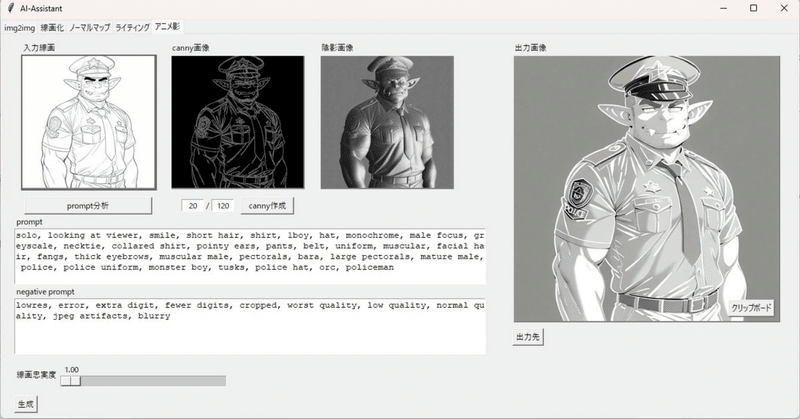

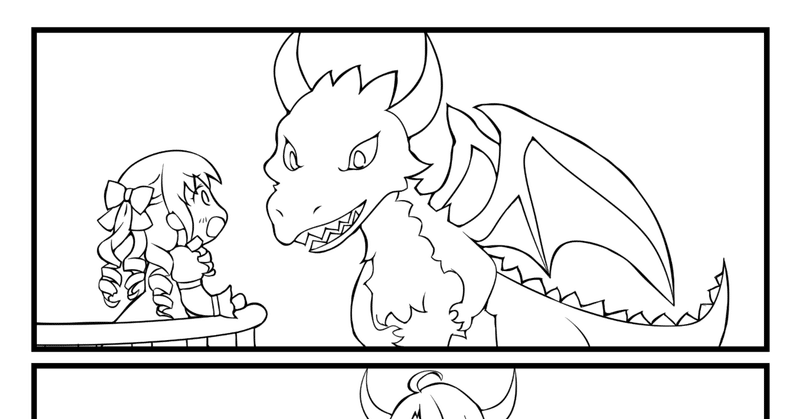

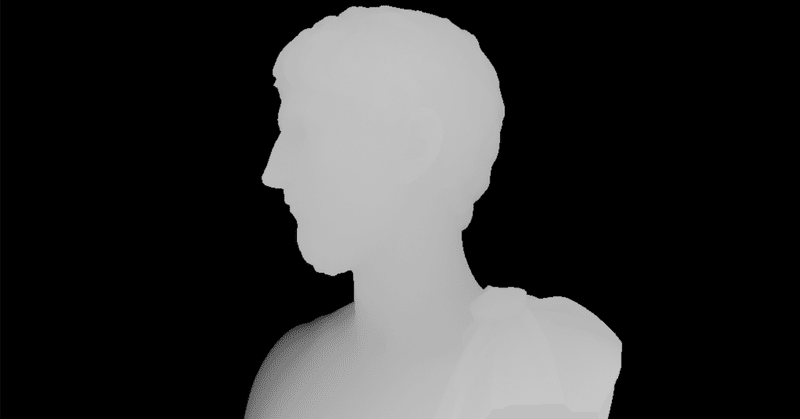

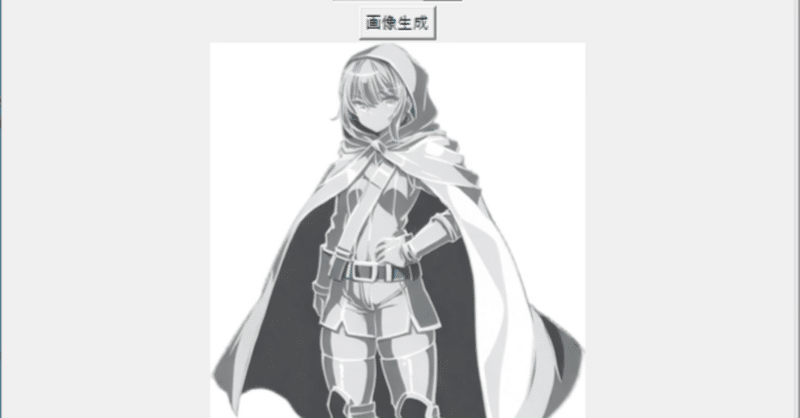

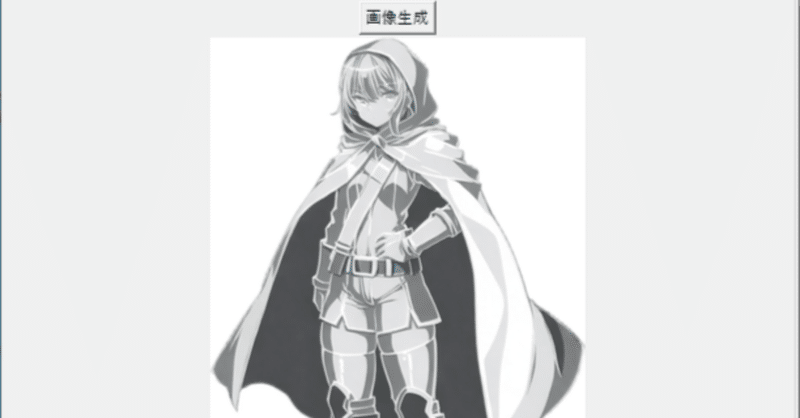

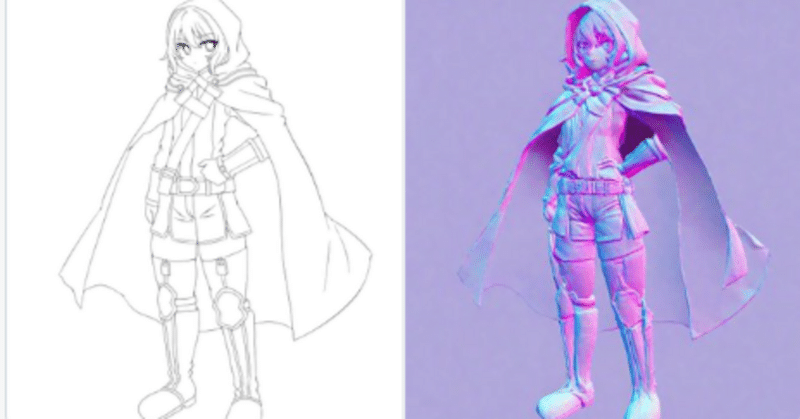

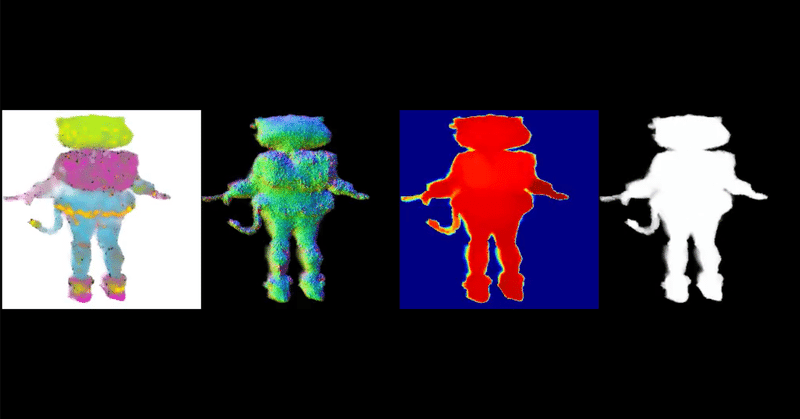

線画から疑似3D画像を出力するアプリ『Line2Normalmap』&それをライティングするアプリ『NormalmapLighting』公開!

2024/04/06フリー公開しました!!! 新しいアプリを作ったので機能の紹介です。こちらのアプリは現在(2024/4/3時点)でfanboxのみで公開(ソースコード自体はgithubで公開)しています。 3日後の2024/04/06にはフリー公開しますので、それまでお待ちください。 【DL先】https://drive.google.com/file/d/1_LPHAFgs4lzDYGdZmv23aVDiTMnV9Y3t/view?usp=sharing ファンボックス

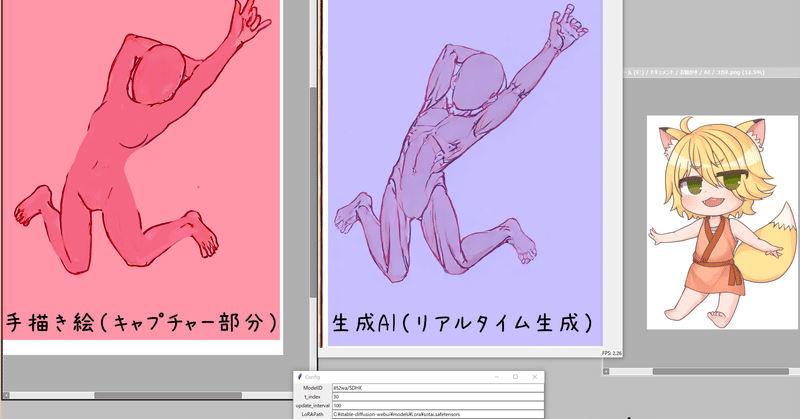

【ヘルプ】diffusers(SDXL)でcontrol-lora(control-lora-canny-rank256.safetensors)を使いたい【助けて】

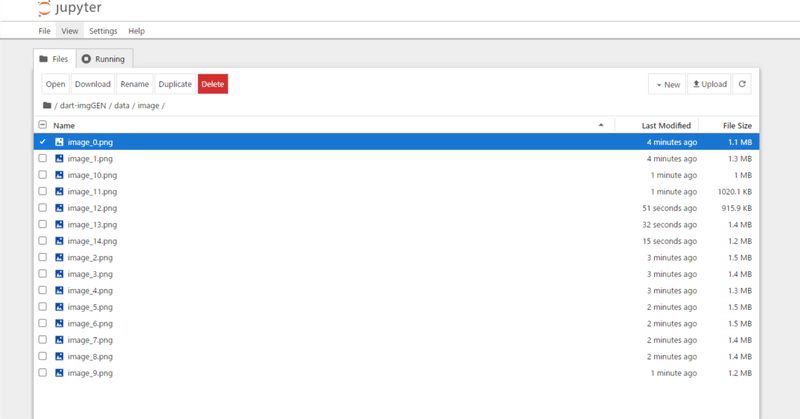

わははははタイトル通りです。なにもわからん!!!!!!!!!! 何をしてもうまくいかなかったので備忘録です。参考になりそうなコードを見つけたのでいくつかググってでてきたのでぺたり https://github.com/Mikubill/sd-webui-controlnet/blob/main/scripts/controlnet_lora.py https://github.com/HighCWu/control-lora-v2/blob/master/models/c