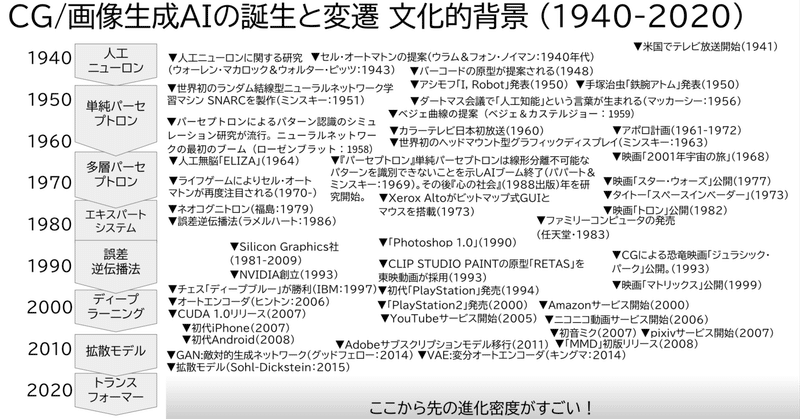

画像生成AIの誕生と変遷(2)画像生成技術の歴史年表

画像生成AIの誕生と変遷

前回は「初期の画像生成技術」について紹介しました。

今回は

画像生成技術の歴史年表 と題して、画像生成技術の研究をざっくりと年代で表現してみました。

1950年: 初期のコンピュータとディスプレイの研究の時代です。現代の人工知能のベースとなる初期の概念も提案されています。当時は「パーセプトロン(Perceptron)」といった人間の視覚と脳の機能をモデル化した概念で、大型の電子計算機でパターン認識を行うシミュレーションを行っていました。

1960年:トランジスタと集積回路の時代から、文字と計算機としてのコンピュータのメモリ空間が大容量になっていく時代。まだパーソナルコンピュータは登場しておらず、ミサイルの弾道計算や、 Bézier spline という(現在のベジェ曲線)と呼ばれる数学を使った曲線が一部の研究で提案されていた頃です。

1970年代:コンピュータがパーソナルになっていく時代です。ミニコンピュータ Xerox Alto (1973)にビットマップ式のグラフィカルユーザインタフェース (GUI)とマウスが搭載されました。生成AIの歴史としては「セル・オートマトン」という細胞を模した人工知能によるグラフィックス表現が提案されました。0か1の結果を持つ論理演算を白黒のドットに置いて、任意の入力データに対する演算結果を表現した「動くドット絵」と説明できますが、状態から状態に遷移する「アルゴリズム」によっては単純なルールから複雑な結果が生成され、パズルや魂を持ったゲームグラフィックスのようにも見える結果を生み出します。セル・オートマトンのもっともよく知られた例である「ライフゲーム」(Conway's Game of Life)は生命の誕生、進化、淘汰などのプロセスを連想させるパターンもあり、フラクタル画像やアルゴリズムアートといった多くの研究を生み出します。

1980年代:第4世代コンピュータと呼ばれる、現在のPCやMacの中心にあるようなCPUが普及し、現在のパソコンの原型になるような普及型のコンピュータが誕生します。TVゲーム専用機としての家庭用コンピュータも普及し、1983年には任天堂からファミリーコンピュータも発売されます。ただし当時のゲーム機のリアルタイムグラフィックス表現はドット列をROMに格納されたデータからスプライトと呼ばれる2Dの高速描画用レイヤーで表現するに留まるため、コンテンツとしての市場は拡大しましたが、ROMやRAMのメモリ容量、プラットフォームの最大色表現性能に制約を受けました。1982年に公開された映画「トロン」は世界で初めて全面的にコンピューターグラフィックス(CG)を導入した映画で各界に大きな影響を与えました。AppleのMacintoshシリーズはマウスを使ったGUIを標準としたOSとともに1984年末に発表し、グラフィックス愛好家に人気となります。最初のPhotoshopが1988年にノール兄弟によって開発され、1989年にAdobeから発表されます。当時はスキャナの画像を処理するためのソフトウェアとしてバンドルされて普及しました。

【 https://winworldpc.com/product/ad-ps/0x-beta】

1990年代:CGの専門家や映画業界による研究で3Dグラフィックスが扱われるようになりました。1993年公開の「ジュラシック・パーク」は実写映画史上はじめてフルCGで生物としての「恐竜」が描かれ世界中を震撼させました。パソコンの市場は急速に拡大し、フロッピーディスクのような保存メディアから、ハードディスクといった大容量外部記憶装置が搭載されるようになりました。現在のPCのOSに近い、Windows3.1(1992)、Windows95(1995)、Windows98(1998)といった、インターネットにアクセスできるOSが次々に発売されWindowsPCとして普及し、「Microsoftペイント」のようなお絵かきソフトがマウスの練習として広く知られるようになりました。現在、デジタルイラストレーションの分野で広く使われている「CLIP STUDIO PAINT」(クリスタ)の原型となる「RETAS」がアニメーション製作会社の東映アニメーションに採用され、テレビシリーズアニメ作品のデジタル化に使われ業界に普及し、はじめたのが1997年です。1983年に創業して、既にワイヤレスペンタブレットを開発・販売していたワコム社もパソコン市場の広がりとともに大きくシェアを伸ばしていきます。リアルタイムグラフィックスではJensen Huangが1993年にAMDから独立してNVIDIAを創立します。当時はPCのグラフィックスを拡張するビデオカードとして需要が拡大しており、最初のGeForceシリーズである「GeForce 256 DDR」が1999年に発売されます。一部のPCゲームで3DCGが使われ始めてきた時代でしたが、1994年にソニーから「PlayStation」、1996年には「ニンテンドー64」が発売されます。ゲームボーイのようなドットグラフィックスの携帯ゲーム機ととともに、子供時代から3Dによって生成されたリアルタイムグラフィックスに親しんだ世代が拡大していきます。CGの研究ではパラメーターによって風景やテクスチャーを無限に生成する技術や、フォトリアルなだけではなく、多様な画像、特にアニメーション風の画像を生成する技術の研究が盛んになります。PIXARが最初の劇場用長編CG映画「トイ・ストーリー」を公開したのが1995年です。

2000年代:AdobeはPhotoshopやIllustratorといったツールを統合し、サブスクリプションモデルに移行していきます。2000年3月にPlayStation2が発売され、3DCGとリアルタイムグラフィックスはより一般的になります。グラフィックスカードという呼び名からGraphics Processing Unit、「GPU」という略称が一般的に普及します。3DCGは産業になり、コンシューマー(消費者)は当たり前のように3DCGをTVやゲームなどで観るようになってきましたが、まだまだ一般的とはいいづらい、一部のクリエイティブ産業のクリエイターのみが触れる事ができる分野でした。また一部の研究者や開発者はGPUをグラフィックスのためではなく、より汎用的な計算機「GPGPU」として使う動きが出てきました。

このあたりから一般のコンシューマの中でもクリエイティブなホビーを嗜好するユーザが顕著に現れる時代がやってきます。ユーザーによるコンテンツ生成(User Generated Contents)「UGC」というムーブメントが起きます。それまで個人は日記に写真を添えて公開する場合はHTMLを直接書いて、レンタルサーバー等を契約して個別に発信していましたが、より簡単にブログが書けるサイトが「Web2.0」として拡大していきました。2005年2月15日にスタートした「YouTube」がその代表的な存在で、ユーザーが撮影した動画をYouTube、つまり「あなたがTVになる」というコンセプトで動画を共有することができるサイトが登場します(当時はまだTVは液晶フラットパネルではなくブラウン管、つまりチューブでした)。YouTubeは2006年10月9日にGoogleに買収され、さらに人気になります。日本では2006年12月12日に「ニコニコ動画」がスタートしました。当時はまだYouTubeの動画に乗っかってコメントを流すだけのサイトでしたが、徐々にオリジナルコンテンツを投稿するユーザが増え、2007年にVOCALOID「初音ミク」がリリースされてからはオリジナル楽曲やアニメーション作品が人気になり、2008年2月23日に「MikuMikuDance」(MMD)がリリースされます。パソコンで誰でも美麗な歌声を生成できる「初音ミク」と、その楽曲を作れるプロデューサーは中高生のヒーローになりました。従来は「商業製作のコンテンツのほうが品質が高い」という常識がありましたが、多くの個人制作のアニメーション作品がニコニコ動画で親しまれ、人気になります。商業的にもUGCを戦略にすることで成功する事例が出てきました。2007年9月にpixivがサービス開始し、イラストレーションや漫画をUGCで公開することが一般的になっていきます。美術系の大学や専門学校でもデジタルイラストレーションとしての市民権を得ていきます。

2010年代:この時代はコンシューマのハードウェアはスマートフォン全盛期になっていきます。2008年にサービス開始したミニブログサービス「Twitter」は、日本では東日本大震災を機会に公共・自治体でも公式アカウントが作られるようになります。初代iPadが2010年に発売され、2011年6月21日よりお絵描きアプリのアイビスペイントがリリースされました。2015年11月11日にApple Pencil初代が発売されます(この頃、多くの中高生はタッチペンを使ってスマホでデジタルイラストレーションを描いていました)。この時代はゲーム開発の技術面ではプロもアマチュアも無料で学習できる「Unity」や「Unreal Engine」といったゲームエンジンが登場し、従来のような難度の高いプログラミング環境ではなく、無料で誰もがリアルタイム3Dグラフィックスでアプリやコンテンツを作ることができるようになりました。

2014年「GAN」以降の画像生成AIの急速な進化

UGCによって世界中のコンテンツクリエイターがインターネット上に作品をシェアしていく一方で、機械学習やパターン認識、画像生成の研究者の間では、大きな変革が起きていました。2014年に 敵対的生成ネットワーク(Generative Adversarial Networks)「GAN」の概念が初めて提案され、現在の「生成AI」、つまり入力データから新たに別のデータを作り出すタスクが注目され始めます。この研究が、画像・音声・自然言語など各分野で成果を出すようになっていきます。ここから先の画像生成AI技術にについては次の章で詳細な説明を行いますが、GAN登場以降の生成AI技術は以下のような進化を遂げます。

2015年: 最初の実用的なGANが開発され、リアルな画像生成が可能に。

2016年:GANを利用して画像の解像度を超解像化する「SRGAN」が発表される。

2017年:GANを利用してモノクロ写真や線画の着色に使う研究が発表される。Googleの研究者らが機械翻訳の研究で従来のニューラルネットワークと全く異なる発想の「Transformer」アーキテクチャを論文「Attention Is All You Need」で発表。

2018年:OpenAI社がTransformerを使用した生成事前学習モデル(Generative Pre-trained Transformer)「GPT1」を発表。1億1700万個のパラメータを持ち、これまでの言語モデルを大幅に改善。画像生成では「StyleGAN」が登場、画像生成の質が大幅に向上。

2019年:OpenAIがGPT-2が発表される。GPT1で学習された7,000 冊以上の自費出版フィクション本のデータセットに加え、800 万の Web ページのデータセットでトレーニング。

2020年:コロナ禍で世界中の研究者が混乱します(分野によってはむしろ研究は進んだという説が有力です)。OpenAIによってGPT-3がリリースされます。1750億パラメータを学習したこのモデルはMicrosoft が独占的ライセンス取得し、他のユーザーはパブリック API経由で出力を受け取ることができる一方で、ベースモデルにアクセスできるのは Microsoft だけという状態になりました。

2021年:OpenAIは1月5日のブログ投稿で画像を生成する「DALL-E」を発表します。この内部では修正されたバージョンのGPT-3を使用しており、テキストから画像を生成することを示唆しています。

2022年:4月 6日、OpenAI は、「コンセプト、属性、スタイルを組み合わせることができる」高解像度でよりリアルな画像を生成するように設計された「DALL・E 2」を発表しました。7月20日にベータ公開し、100 万人の招待ユーザーのみが毎月一定数の画像を無料で生成でき、さらに購入することができるようになりました。その時点では、倫理と安全性への懸念から、アクセスは事前に選択されたユーザーに制限されていました。7月12日には米国「Midjourney」がリリース、8月22日には英国の「Stability AI」を中心とした研究チーム(CompVis,Stability AI,LAION)がテキスト画像生成モデル「Stable Diffusion」を公開します。その後OpenAIは9月28日に「DALL・E 2」を誰でも利用できるように制限を緩和。さらに9 月、OpenAI は、以前のバージョンよりも「はるかに多くのニュアンスと詳細」を理解できる最新の画像モデル「DALL・E 3」、そして11月30日に「ChatGPT-3.5プロトタイプ」を発表しました。この流れは2024年現在も続く「生成AIの春」を創り出しました。

2023年:3月15日、OpenAIから「GPT-4」がリリースされました。3月20日には画像AI「Stable Diffusion」の開発に携わったAIスタートアップのRunway Researchが、テキストからビデオクリップを生成する「Gen-2」をリリースし、10年近くかかると言われていた動画の生成も現実味を帯びてきました。Stability AIも、7月には本書で中心的に扱う「Stable Diffusion XL (SDXL)」、動画生成モデル「Stable Video Diffusion」の他、SDXLの超高速版「SDXL Turbo」、日本語画像言語モデル「Japanese Stable VLM」、3Dモデル生成、音楽生成といった多様なモデルを公開しています。

2024年:2月、Googleが従来の対話型AIサービスであった「Bard」をリブランドし「Gemini」を公開する中、Stability AIは新しいテキスト画像変換モデル「Stable Cascade」公開、さらにOpenAIは2月15日に動画生成モデル「Sora」を発表します。Transformerが大規模に使用されたフェイク動画以上の機能と品質を持った「世界シミュレーター」として説明される技術ですが、これからも「画像生成AI」の進化はしばらく止まりそうにありません。

この記事が気に入ったらサポートをしてみませんか?