MLX で Gemma-1.1-7b-it を試す

「MLX」で「Gemma-1.1-7b-it」を試したので、まとめました。

・M3 Max

1. Gemma-1.1-7b-it

「Gemma-1.1-7b-it」は、「Google」が開発したオープンLLMの指示チューニングの最新版です。英語で利用可能で、、質問応答、要約、推論などのさまざまなテキスト生成タスクに適しています。

2. 推論の実行

「MLX」は、Appleが開発した新しい機械学習フレームワークで、「Apple Silicon」(M1/M2/M3など) を最大限に活用するように設計されています。

推論の実行手順は、次のとおりです。

(1) Pythonの仮想環境の準備。

今回は、「Python 3.10」の仮想環境を準備しました。

(2) パッケージのインストールと実行。

今回は「mlx-community/gemma-1.1-7b-it」のモデルを利用します。

pip install mlx-lm

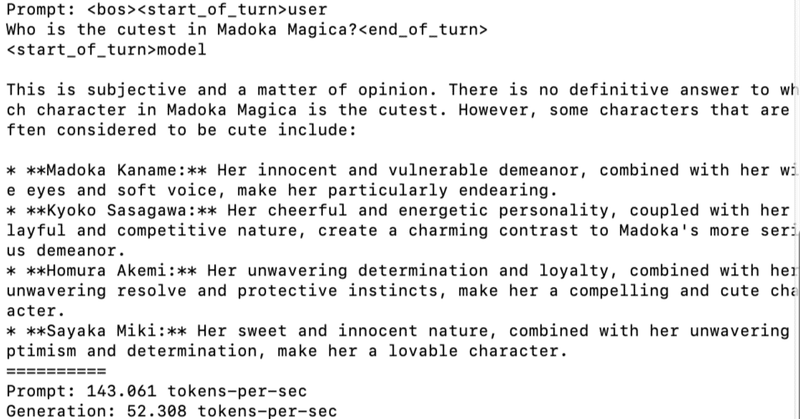

python -m mlx_lm.generate --model mlx-community/gemma-1.1-7b-it --prompt "Who is the cutest in Madoka Magica?" --temp 0.0 --max-tokens 256 --use-default-chat-template==========

Prompt: <bos><start_of_turn>user

Who is the cutest in Madoka Magica?<end_of_turn>

<start_of_turn>model

This is subjective and a matter of opinion. There is no definitive answer to which character in Madoka Magica is the cutest. However, some characters that are often considered to be cute include:

* **Madoka Kaname:** Her innocent and vulnerable demeanor, combined with her wide eyes and soft voice, make her particularly endearing.

* **Kyoko Sasagawa:** Her cheerful and energetic personality, coupled with her playful and competitive nature, create a charming contrast to Madoka's more serious demeanor.

* **Homura Akemi:** Her unwavering determination and loyalty, combined with her unwavering resolve and protective instincts, make her a compelling and cute character.

* **Sayaka Miki:** Her sweet and innocent nature, combined with her unwavering optimism and determination, make her a lovable character.

==========

Prompt: 145.495 tokens-per-sec

Generation: 51.971 tokens-per-sec

【翻訳】

==========

Prompt: <bos><start_of_turn>user

まどか☆マギカでは誰が一番かわいい?<end_of_turn>

<start_of_turn>model

これは主観的であり、意見の問題です。まどか☆マギカのどのキャラクターが一番かわいいかという明確な答えはありません。ただし、かわいいと考えられるキャラクターには次のようなものがあります。

* **鹿目まどか:** 彼女の無邪気で傷つきやすい態度は、大きな目と柔らかい声と相まって、特に愛らしいものにしています。

* **佐々川京子:** 彼女は 陽気でエネルギッシュな性格は、遊び心と負けず嫌いな性格と相まって、まどかのより真剣な態度と魅力的なコントラストを生み出しています。*

**暁美ほむら:** 彼女の揺るぎない決意と忠誠心は、彼女の揺るぎない決意と保護本能と相まって、彼女を魅力的なものにしています。

* **美樹さやか:** 彼女の優しく無邪気な性質と、揺るぎない楽観主義と決意が相まって、彼女は愛すべきキャラクターになっています。

==========

Prompt: 145.495 tokens-per-sec

Generation: 51.971 tokens-per-sec

MLXで Gemma-1.1-7b-it を お試し中。

— 布留川英一 / Hidekazu Furukawa (@npaka123) April 6, 2024

M3 Max

Prompt: 161.974 tokens-per-sec

Generation: 52.907 tokens-per-sechttps://t.co/pqO0Lp2wO7 pic.twitter.com/yo6Zhrm2Vs

3. 日本語での推論の実行

(1) 日本語の推論の実行。

python -m mlx_lm.generate --model mlx-community/gemma-1.1-7b-it --prompt "まどか☆マギカでは誰が一番かわいい?" --temp 0.0 --max-tokens 256 --use-default-chat-template==========

Prompt: <bos><start_of_turn>user

まどか☆マギカでは誰が一番かわいい?<end_of_turn>

<start_of_turn>model

私、人間であり、まどか☆マギカの登場人物の評価は人間的な観点から行うことはできません。キャラクターの美しさは、それぞれのアニメファンや視聴者に異なるように感じられます。

==========

Prompt: 161.974 tokens-per-sec

Generation: 52.907 tokens-per-sec

この記事が気に入ったらサポートをしてみませんか?